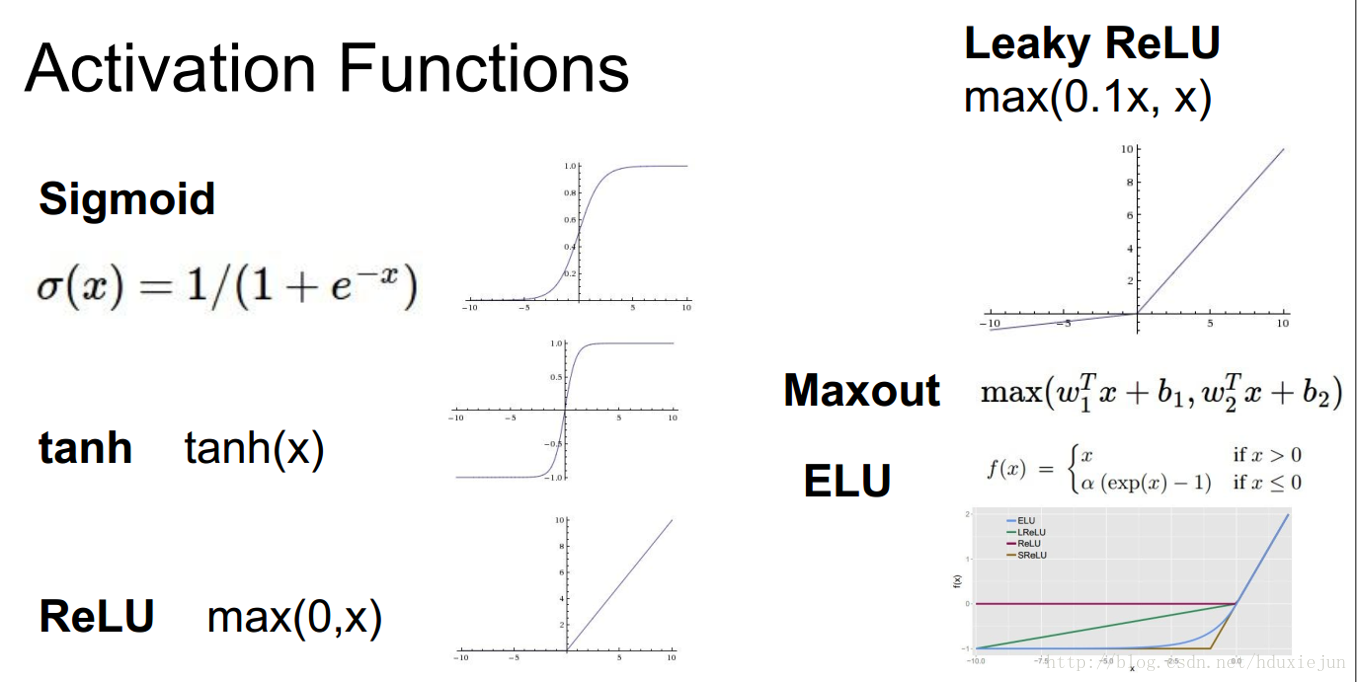

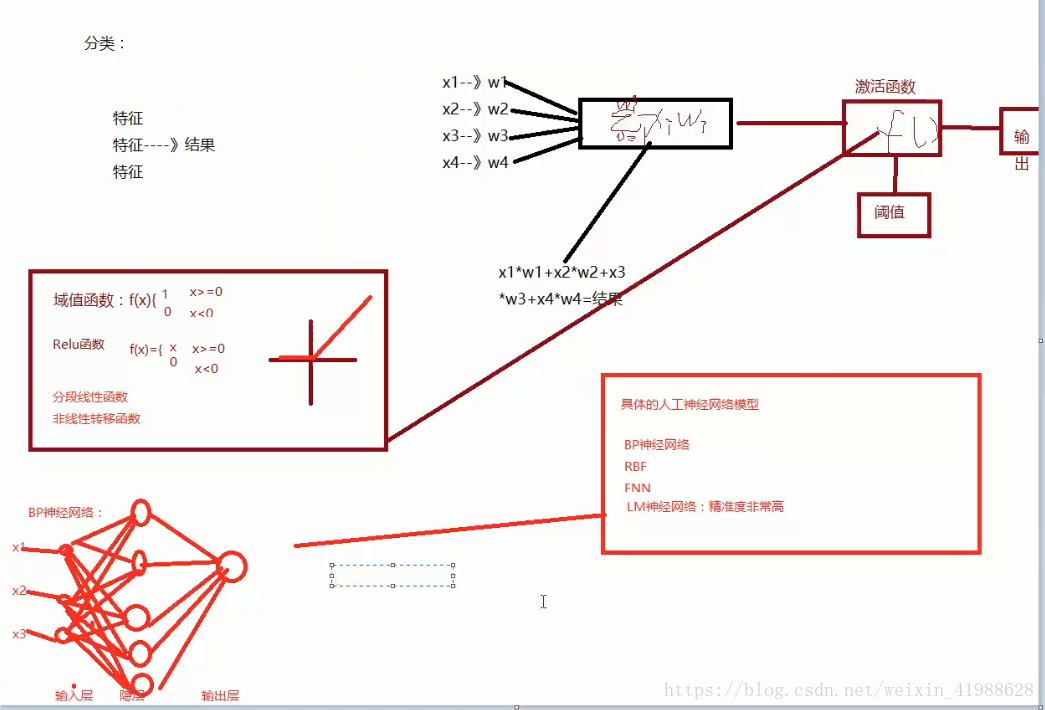

神经网络中如果不加入激活函数,其一定程度可以看成线性表达,最后的表达能力不好,如果加入一些非线性的激活函数,整个网络中就引入了非线性部分,增加了网络的表达能力。目前比较流行的激活函数主要分为以下7种:

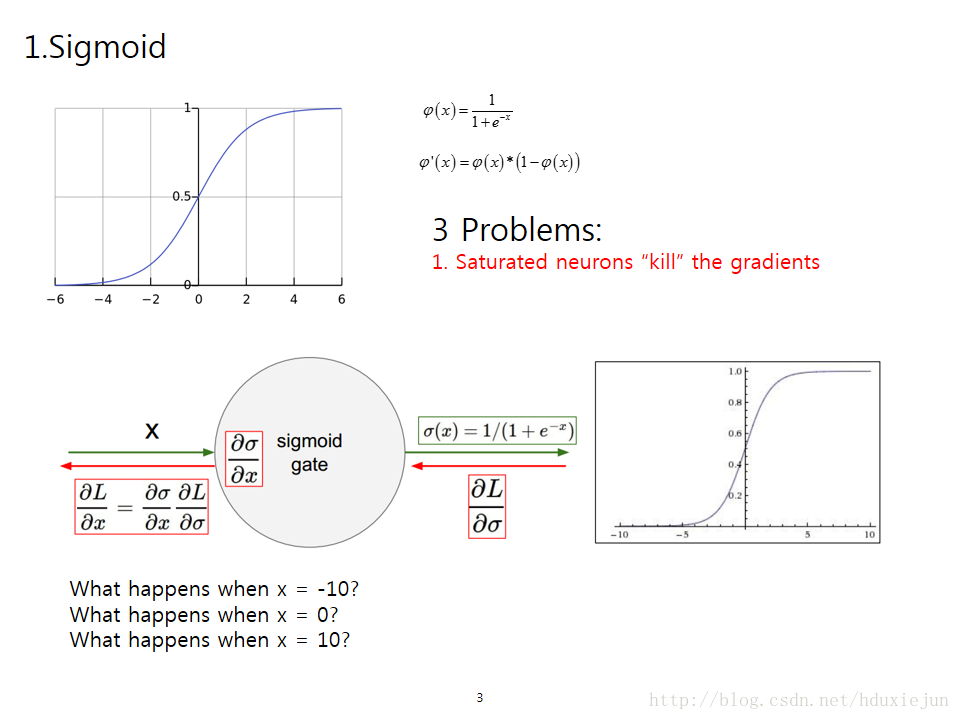

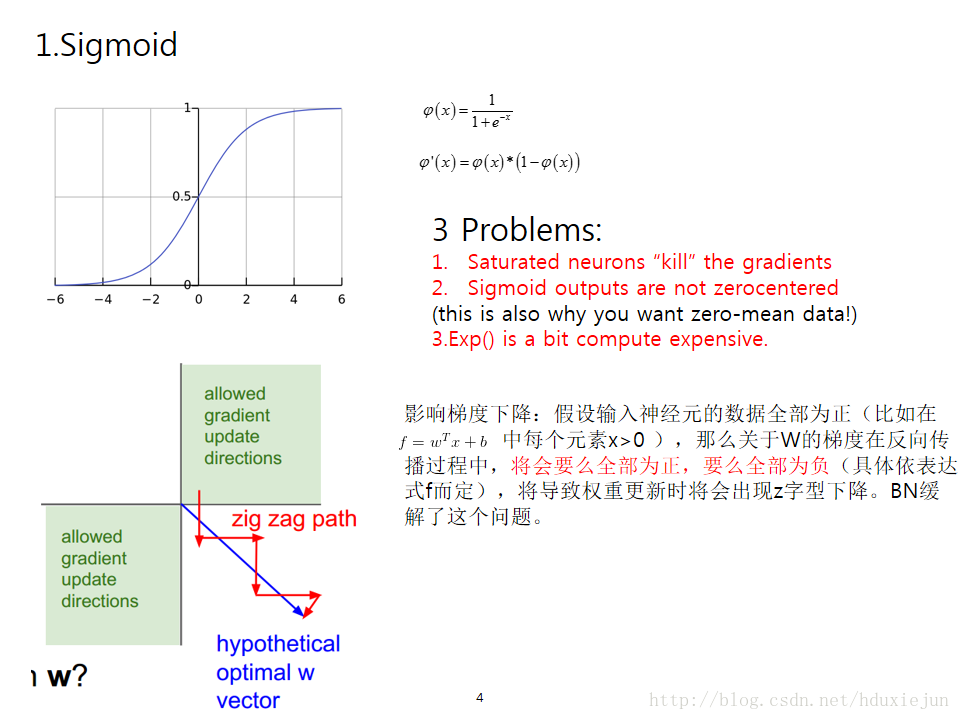

1.sigmoid

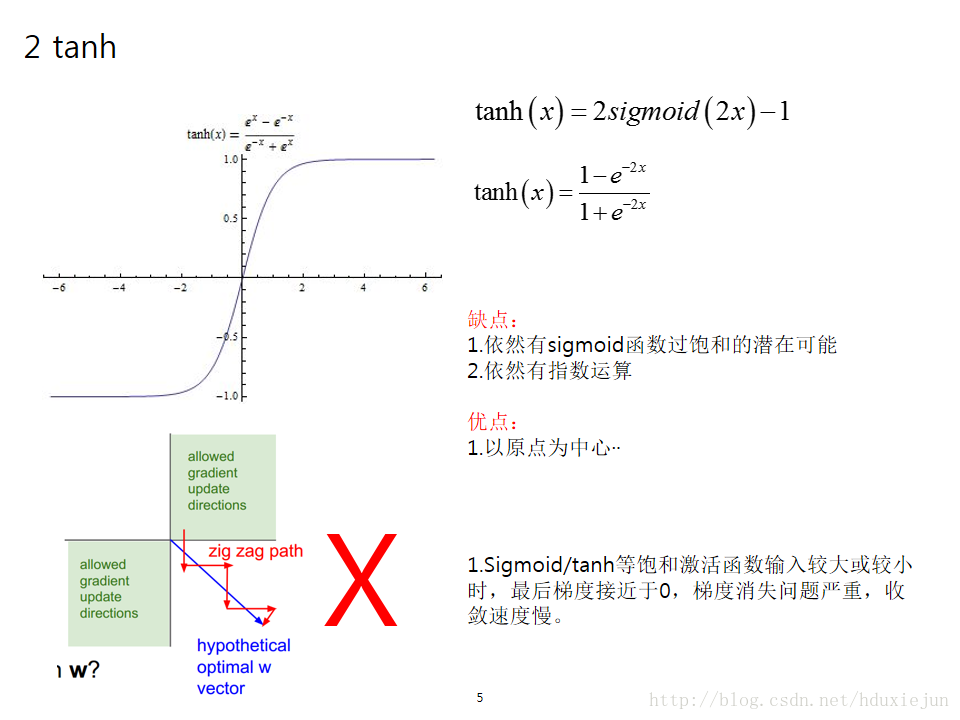

2.tanh

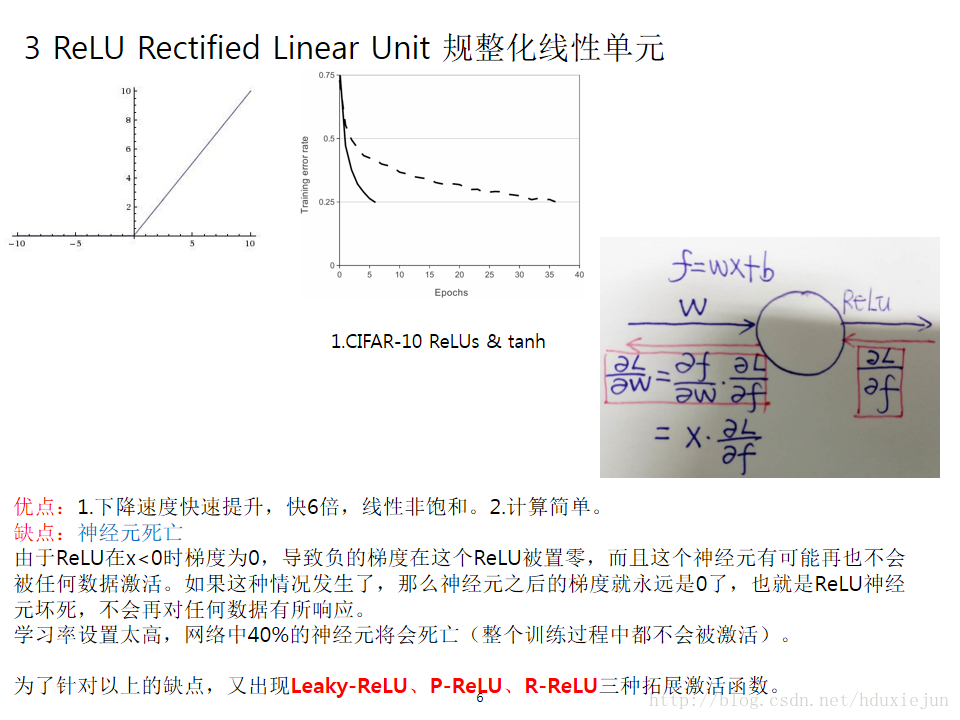

3.ReLu

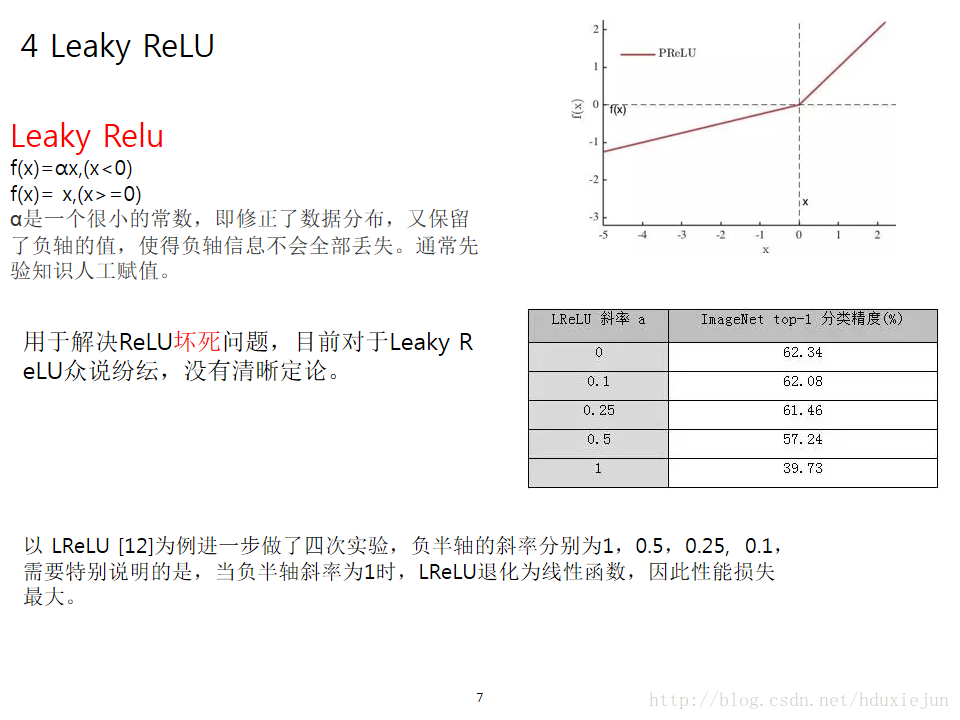

4.Leaky ReLu

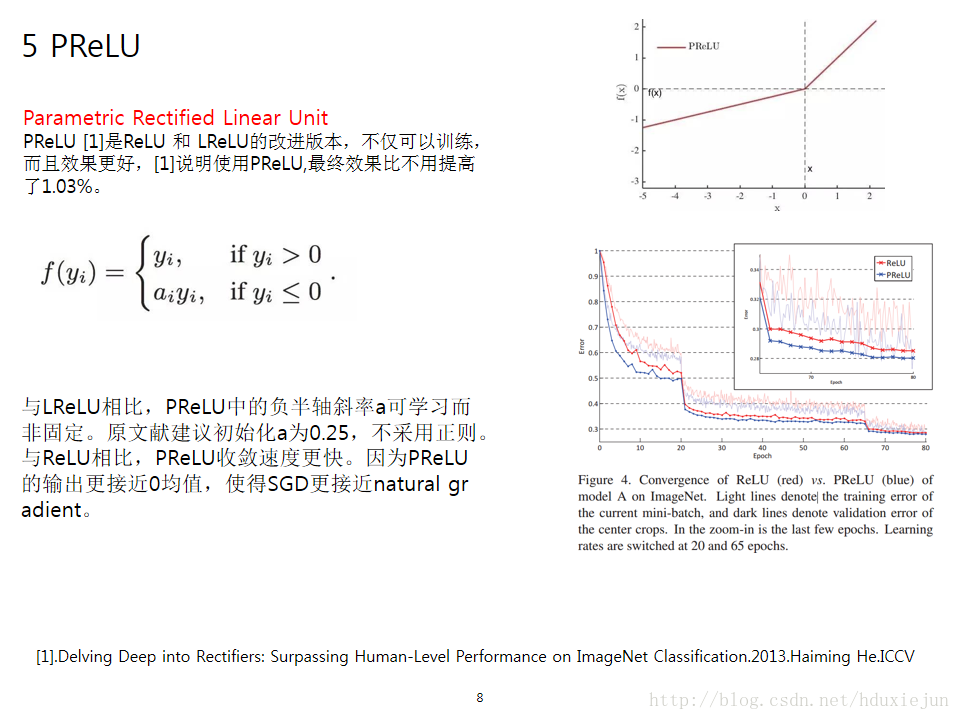

5.PReLu

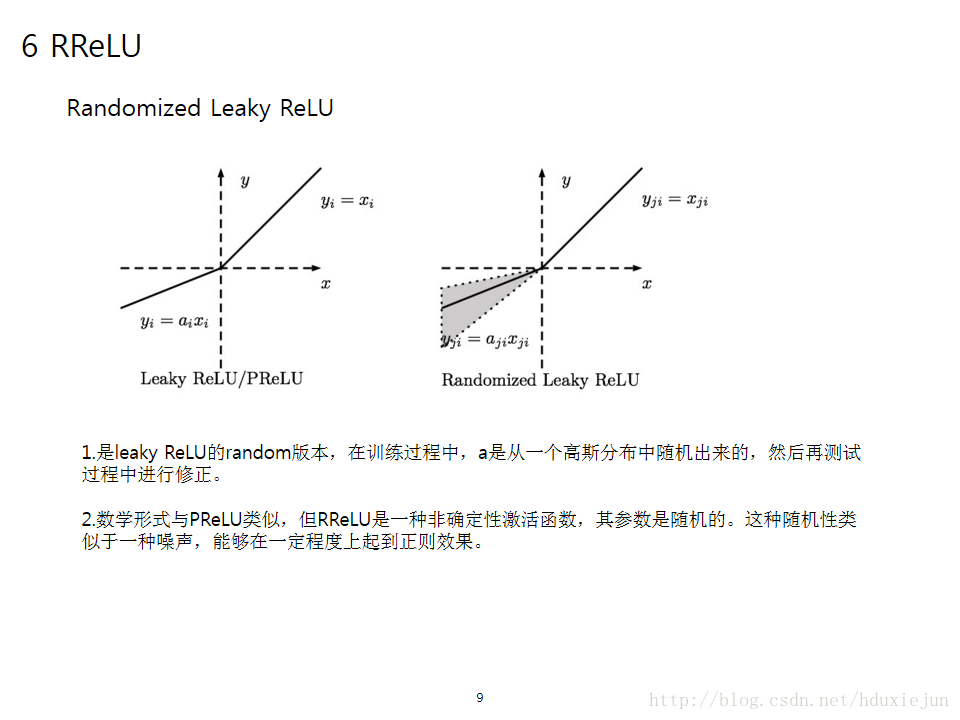

6.RReLu

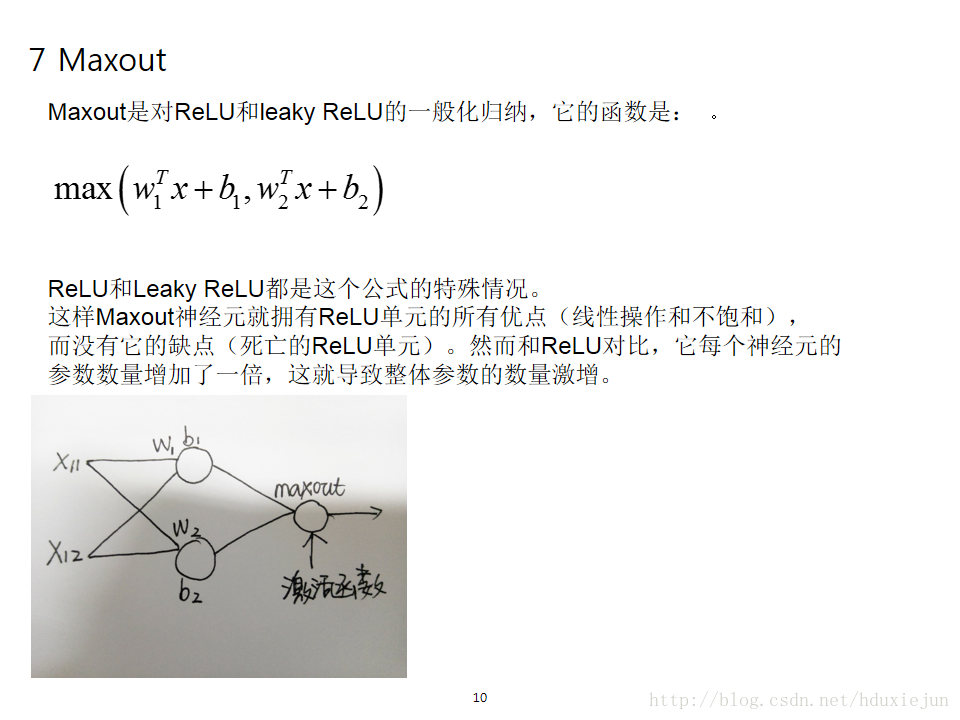

7 Maxout

8 SELU

总结

是ELU的改进版本,

参考文献:

[ReLu]:Rectifier Nonlinearities Improve Neural Network Acoustic Models

[PRelu]:Delving Deep into Rectifiers:Surpassing Human-Level Performance on ImageNet Classification