一、WiCoNet

Looking_Outside_the_Window:Wide-Context Transformer for the Semantic Segmentation of High-Resolution Remote Sensing Images用于高分辨率遥感图像语义分割的宽上下文转换器

发文单位:国防科技大学

发表日期:2022.4.18

数据集:有用到Potsdam

Code: code

刊名:IEEE TRANSACTIONS ON GEOSCIENCE AND REMOTE SENSING

主要贡献:

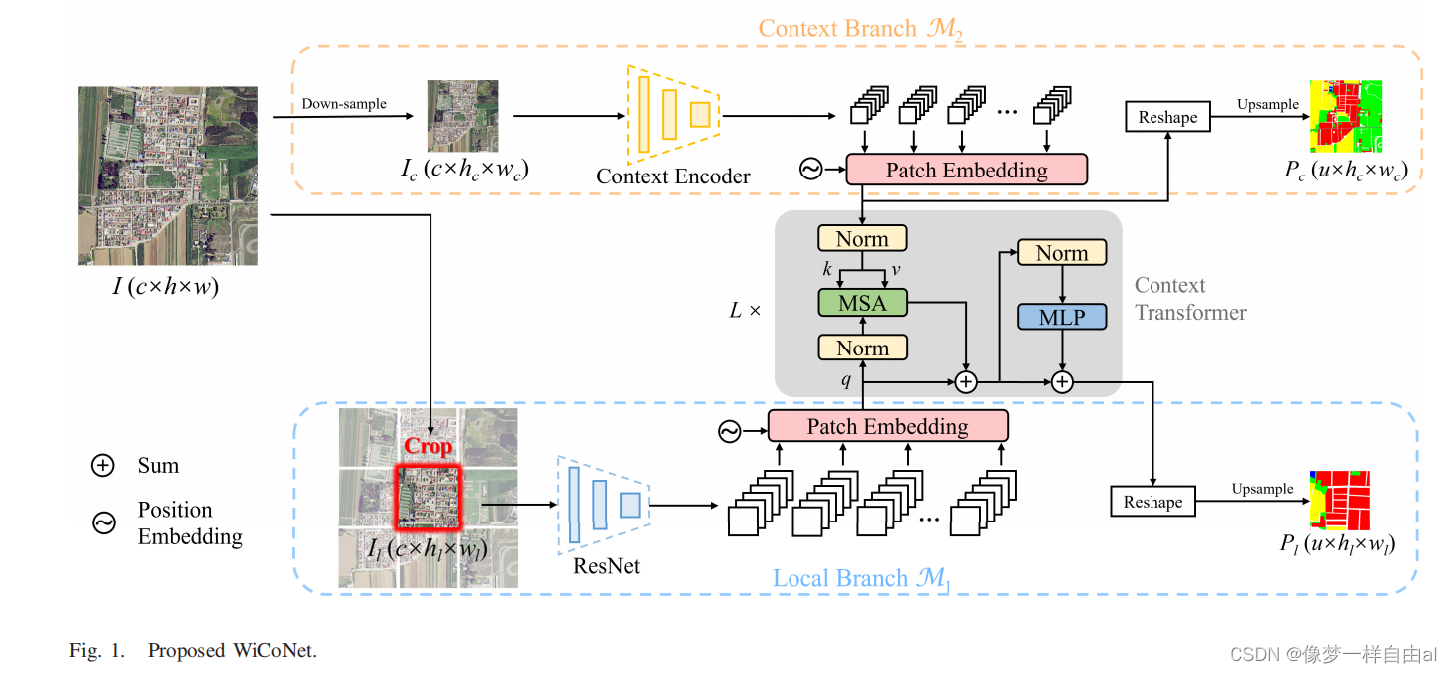

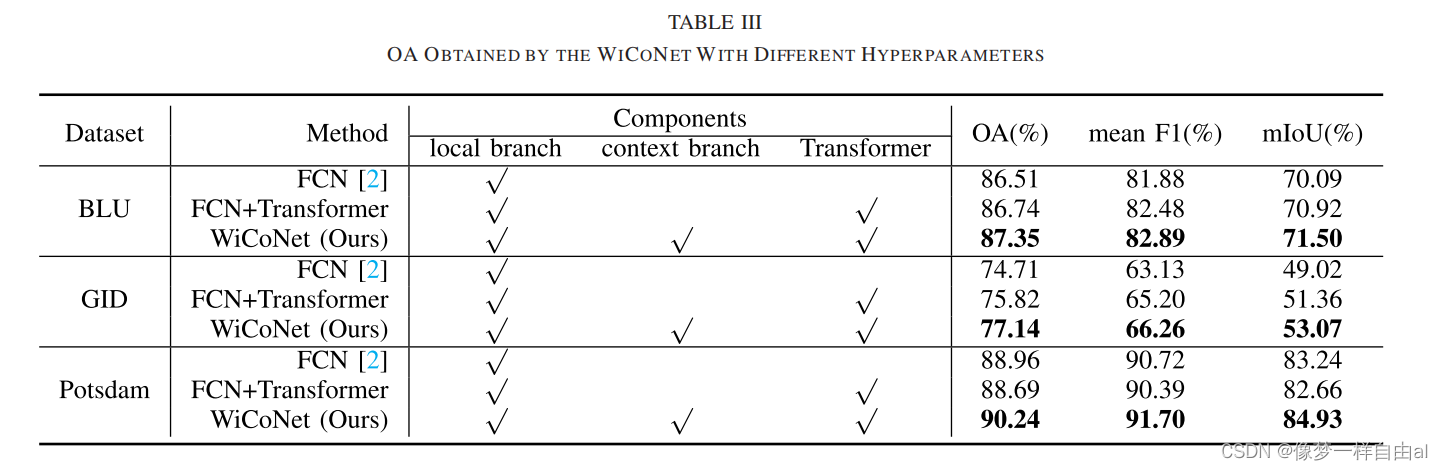

- 提出了一种用于HRrsi语义分割的宽上下文网络(WiCoNet)。WiCoNet包括两个cnn,它们分别从局部和全局图像级别中提取特征。这使得WiCoNet可以同时考虑局部细节和考虑宽上下文

- 提出一个上下文转换器来建模双分支语义依赖关系。上下文转换器将双分支CNN特征嵌入到扁平的标记中,并通过跨局部和上下文标记的重复注意操作来学习上下文相关性。因此,投影的局部特征知道广泛的上下文信息

- 提出一个基准数据集(即北京LandUse(BLU)数据集),用于RSIs的语义分割。这是一个根据土地利用类型标注的人力资源卫星数据集。我们相信,这个数据集的发布可以极大地促进未来的研究

二、DCFAM

A Novel Transformer Based Semantic Segmentation Scheme for Fine-Resolution Remote Sensing Images一种新的基于变换器的精细分辨率遥感图像语义分割方案

发文单位:武汉大学

发表日期:2022.1.14

数据集:有用到Potsdam

刊名:IEEE GEOSCIENCE AND REMOTE SENSING LETTERS

主要贡献:

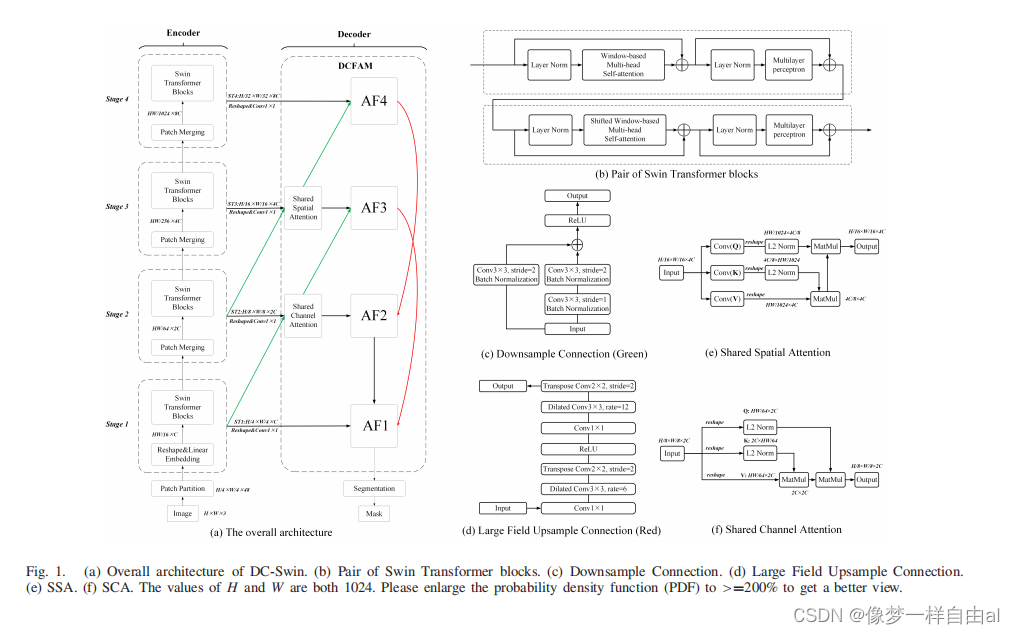

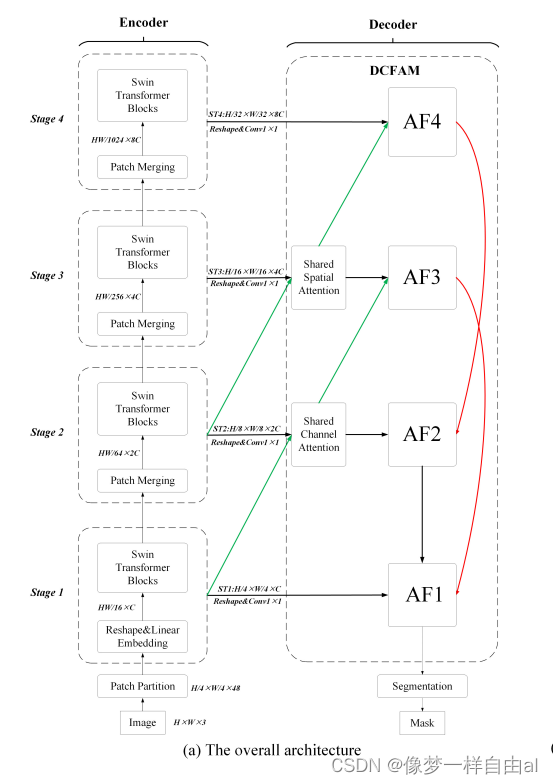

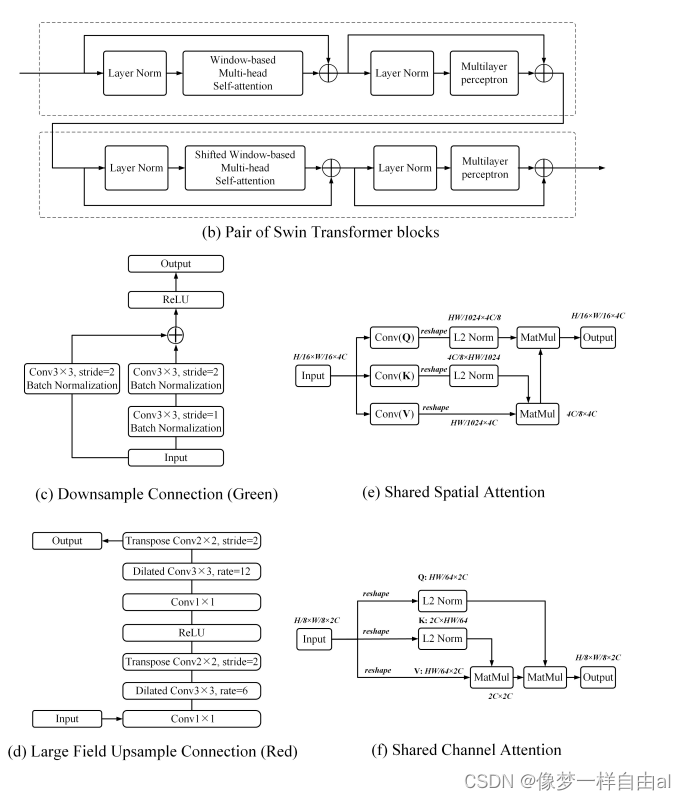

- 提出了一种密集连接的特征聚合模块(DCFAM),以提取多尺度关系增强的语义特征,用于精确分割

- 结合Swin Transformer和DCFAM,建立了一种新的密集连接Swin(DC Swin)Transformer语义分割方案。

三、UDA Transformer

Unsupervised Domain Adaptation for Remote Sensing Semantic Segmentation with Transformer使用Transformer进行遥感语义分割的无监督域自适应

发文单位:电子科技大学

发表日期:2022.10.3

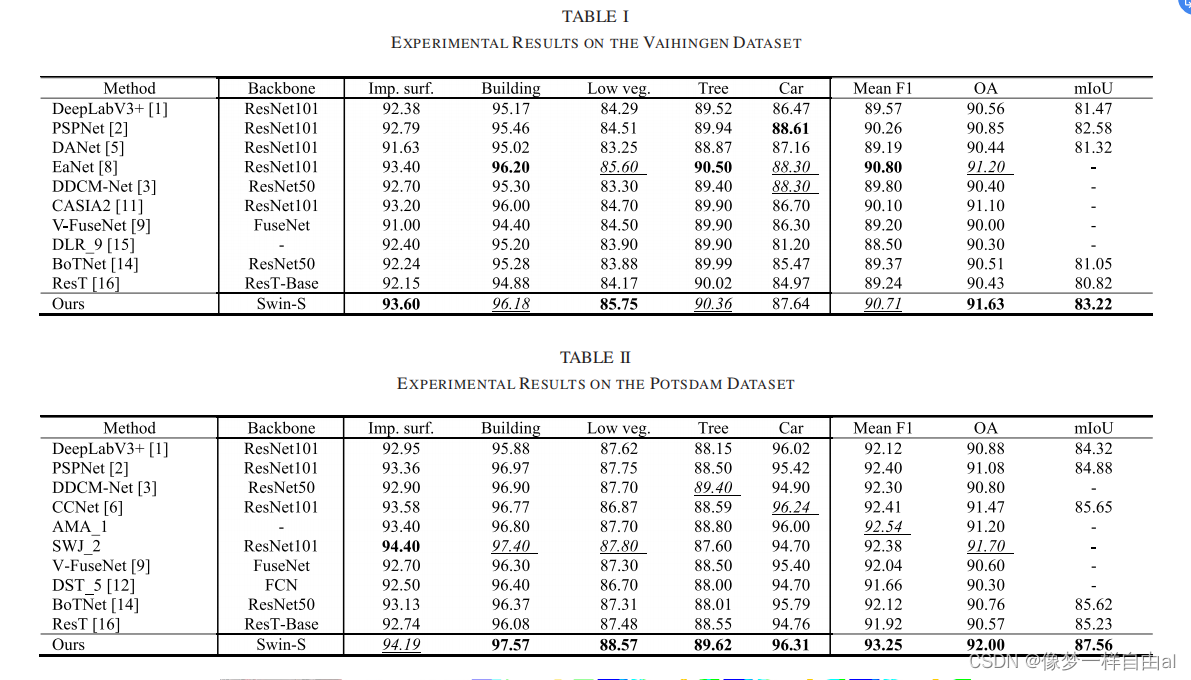

数据集:Vaihingen & Potsdam

Code:code

刊名:Remote Sens.

主要贡献:

- 与之前使用DeepLabV3+的方法相比,我们证明了Transformer在遥感图像的自训练UDA中的显著性能;

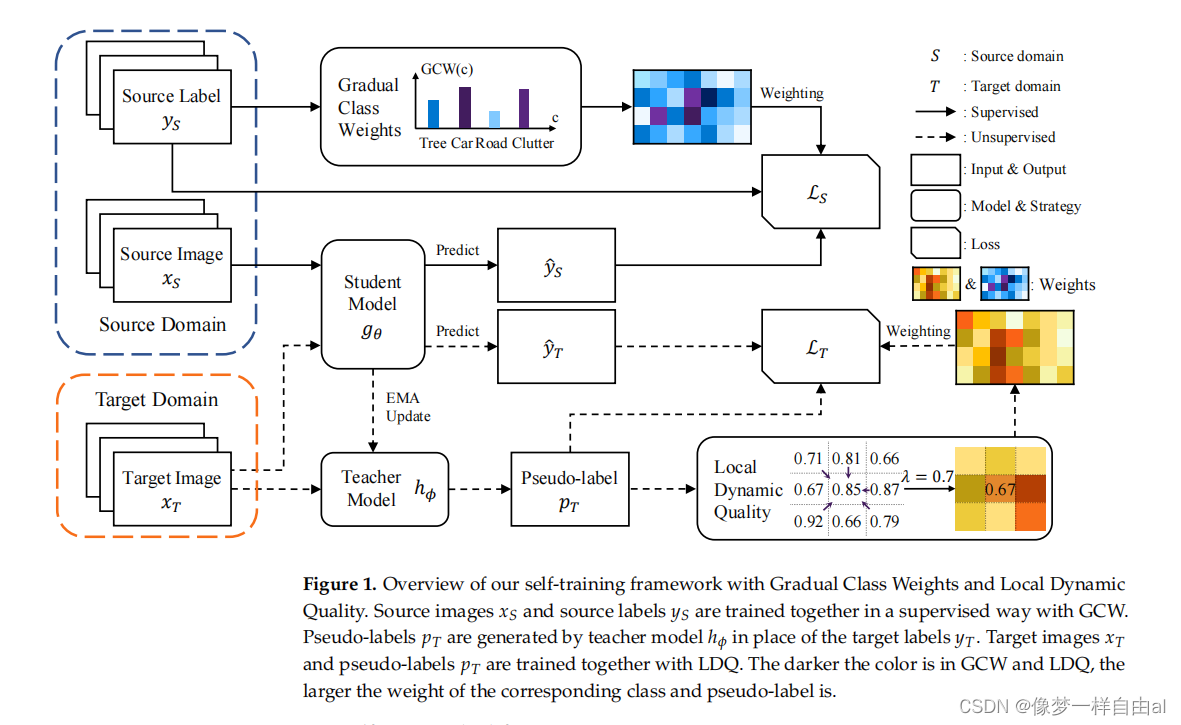

- 提出了两种策略,渐进类权重和局部动态质量,以提高自训练UDA框架的性能。它们都易于实现并嵌入任何现有的语义分割模型中;

- 我们在Potsdam和Vaihingen数据集上优于最先进的遥感图像UDA方法,这表明我们的方法可以提高跨域语义分割的性能,并有效地最小化域差距

自我训练的UDA框架:

- 源图像xS和源标签yS在GCW中以一种有监督的方式一起进行训练。

- 伪标签pT由教师模型hφ代替目标标签yT生成。

- 目标图像xT和伪标签pT与LDQ一起进行训练。

- GCW和LDQ中的颜色越深,对应的类和伪标签的权重就越大。

无监督域自适应(UDA)补课:

在Self-training中,利用目标域的伪标签对网络进行训练。

大多数的UDA方法都是离线预计算伪标签,训练模型,然后重复这个过程。

或者,伪标签可以在训练期间在线计算。

为了避免训练不稳定性,采用了基于数据增强或域混淆的伪标签原型或一致性正则化方法。