论文:3D Scene Geometry Estimation from 360◦ Imagery:A survey

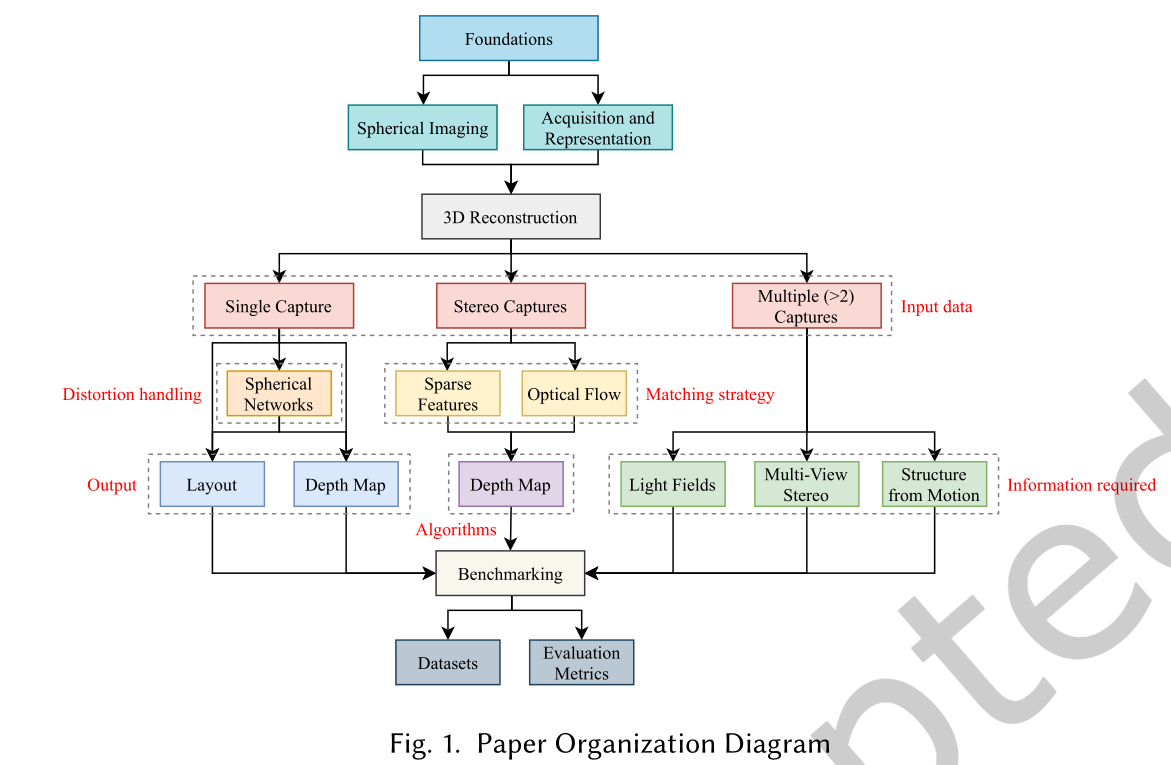

- 本文综述了omnidirectional optics捕获的单个、两个或多个图像的三维场景几何估计方法。

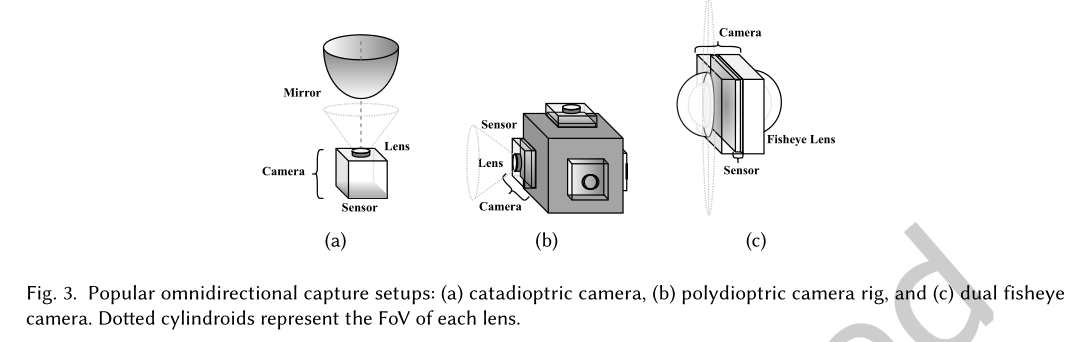

首先叙述了spherical camera model 、 common acquisition technologies 和epresentation formats suitable for omnidirectional (also called 360◦, spherical or panoramic) images and videos。这部分在面向全方位视野(Omnidirectional Vision)的深度学习中提到过:

主要脉络

- 调查了monocular layout and depth inference approaches,重点介绍了适用于球形数据的基于学习的解决方案的最新进展。

- 在球面域上对经典的stereo matching方法的改进,这对在球面域中检测和描述稀疏和密集特征很重要。

- 然后stereo matching概念拓展到多视点相机设置中,将其分类为 light ields, multi-view stereo, and structure from motion (or visual simultaneous localization and mapping)。

- 总结了常用的数据集和各种用途的优缺点,并列出了相关结果。

事实上,大多数论文(尤其是那些需要单全景图的论文)并没有提到捕获过程本身,而是将重点放在球形图像的表示上。 - 大多数计算方法更喜欢使用规范的、获取不可知的球体格式表示。

- 等矩形投影(equirectangular projection)被称为球体到平面的标准映射。

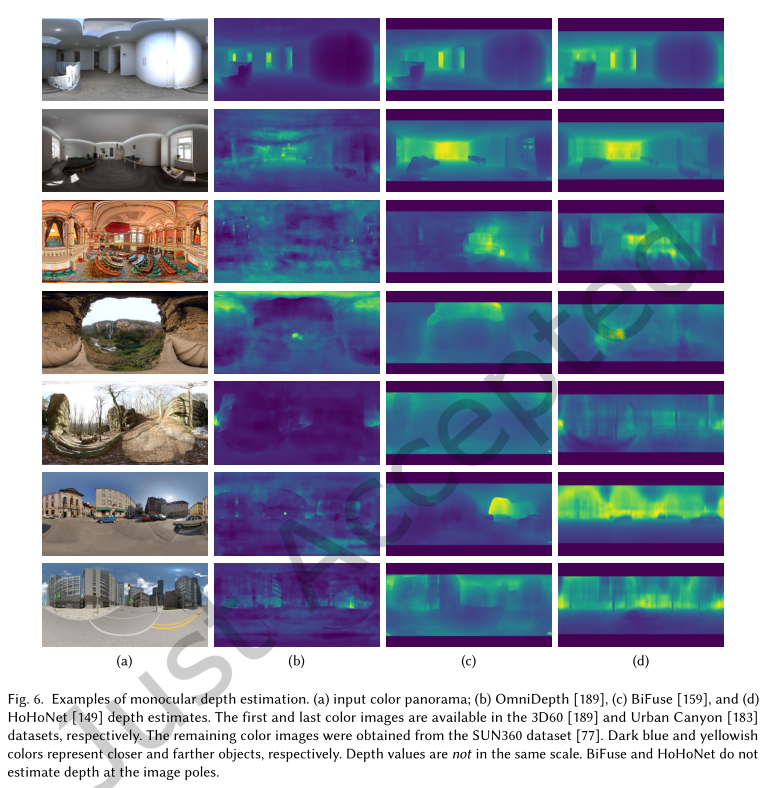

Monocular depth estimation

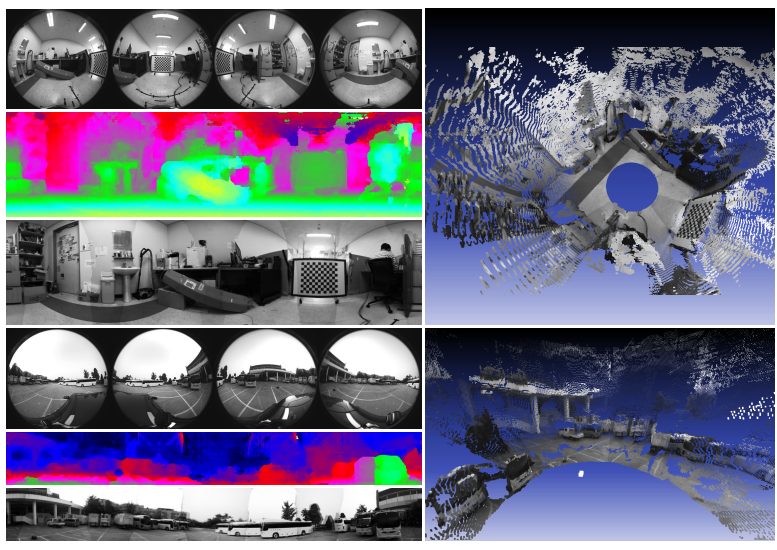

Depth maps produced by three state-of-the-art monocular depth estimation methods :

-

OmniDepth: Dense Depth Estimation for Indoors Spherical Panoramas. 2018 ECCV

-

BiFuse: Monocular 360 Depth Estimation via Bi-Projection Fusion. 2020 CVPR

-

Hohonet: 360 indoor holistic understanding with latent horizontal features. 2021 CVPR

分析:室外场景难以把握,因为深度值的范围更大,并且可能呈现具有“infinite”深度的像素(通常在合成室外场景的地面真实深度图中误报)。这可能需要改变方法设计和参数化。此外,single-panorama approaches present scale ambiguity。

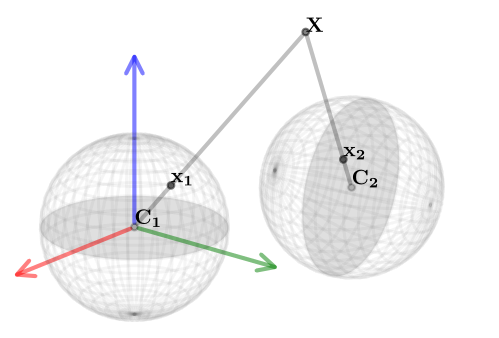

stereosopic 3d geometry estimation

- 两幅全景图捕捉到的信息之间存在着强烈的信息重叠

- 球面投影引入的 non-affine distortions使两幅全景图之间的对应关系更难识别

一些工作针对球形域定制的稀疏和密集特征匹配方法,使用全景图进行立体深度估计。

- “Scale invariant feature transform on the sphere: Theory and

applications”2012- 提出S-SIFT,SIFT in spherical coordinates

- 提出同时计算局部球面描述子和局部平面描述子,以实现透视图像和球面图像的匹配

- “SPHORB: A Fast and Robust Binary Feature on the Sphere” 2014

- 提出SPH-ORB

- “BRISKS: Binary Features for Spherical Images on a Geodesic Grid” 2017

- 提出BRISKS,FAST in spherical coordinates

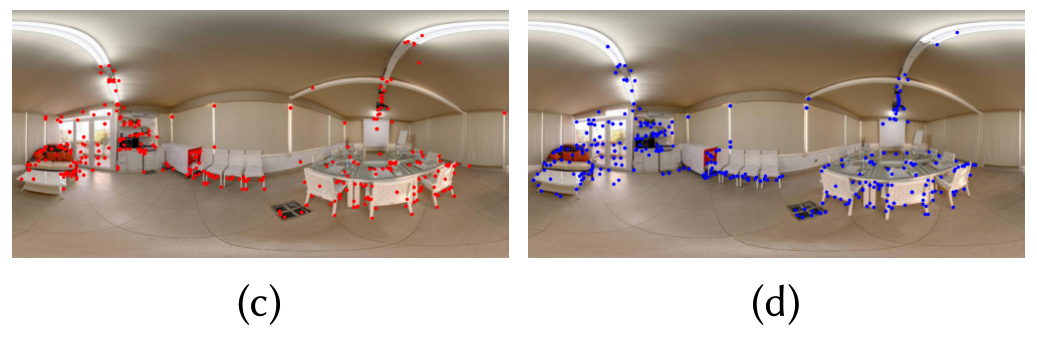

- 效果对比:“Evaluation of Keypoint Extraction and Matching for Pose Estimation Using Pairs of Spherical Images” 2017

迄今为止的球面特征提取匹配算法都是手工设计的,还没有针对omni的深度学习提取或匹配算法

- 但可以通过360度的tangent planes projection(TPP)投影嵌入基于平面深度学习的方法,如“Tangent Images for Mitigating Spherical Distortion” 2020 CVPR

(a)ORB+TPP(b)SPHORB(c)SIFT+TPP(d)S-SIFT

- 在单个图像中很难看出差异

- 但平面关键点匹配算法在应用于通过平移和/或旋转产生差异的球形图像对时,重复性、精度和召回指标较差

特征匹配的中间步骤往往在室外更具挑战性,因为有些对象往往太远,只占用几个像素。

- 在后处理步骤中,可以过滤导致3D点离虚拟相机太远的最小差异或三角剖分

光流相关研究略

“Variational Fisheye Stereo” 2020 RAL 引入了一种Variational 方法,用于从配备鱼眼镜头的立体相机估计深度

深度估计倾向于沿face edges产生不连续性,需要进行后处理才能获得场景的完整3D模型

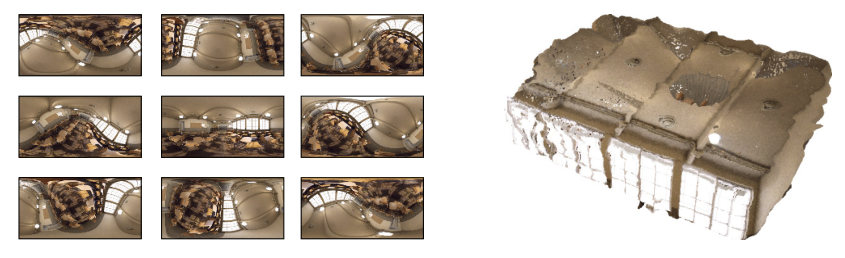

“Dense 3D Scene Reconstruction from Multiple Spherical Images for 3-DoF+ VR ” 2019 IEEE VR 室内三维重建

在深度学习的方向上,“Self-supervised Learning of Depth and

Camera Motion from 360◦ Videos” 2018 ACCV 提出了一种球形SfM的自监督方法。

- 模型使用CMP图像,并将每个立方体面视为平面(在立方体边缘进行特殊处理)。

- 两个网络(一个用于深度,另一个用于摄影机运动估计)作用于每个单独的立方体面,然后将其组合,以结合光度和姿势约束,探索其中的相对(已知)姿势差异

Omni SLAM 2020 :