本文主要介绍清华大学武楚涵博士等人于2022年6月在Nature Communications上发表的论文《A federated graph neural network framework for privacy-preserving personalization》

前沿领域

推荐系统 / 图神经网络 / 联邦学习

推荐系统

随着人工智能、云计算等领域的蓬勃发展,大数据时代已经到来,推荐系统(Recommender System,RS)作为解决“信息过载”的有效工具得以广泛应用。推荐系统根据用户的需求、兴趣等,通过推荐算法从海量数据中挖掘出用户感兴趣的信息、服务等,并将结果智能化、个性化地推送给用户。

图神经网络

图神经网络(Graph Neural Network,GNN)是近年来出现的一种利用深度学习直接对图结构数据进行学习的框架。通过在图中的节点和边上制定一定的策略,图神经网络将图结构数据转化为规范而标准的表示,并输入到多种不同的神经网络中进行训练,在推荐系统任务上取得优良的效果。

联邦学习

面对推荐系统中数据渴求与隐私安全的矛盾,联邦学习(Federated Learning,FL)作为一种隐私保护的机器学习技术引起了广泛关注和研究。联邦学习结合了分布式机器学习、密码学和博弈论模型的优点和特征,使数据“可用但不可见”,不仅关注模型的效率效果,也关注数据的安全隐私。

最新研究

清华大学武楚涵博士等人于2022年6月在Nature Communications上发表相关论文

期刊:Nature Communications

作者:Wu Chuhan,Wu Fangzhao,Lyu Lingjuan,Qi Tao,Huang Yongfeng,Xie Xing

发表日期:2022/06/02

原文链接:https://doi.org/10.1038/s41467-022-30714-9

01

INTRODUCTION

✦

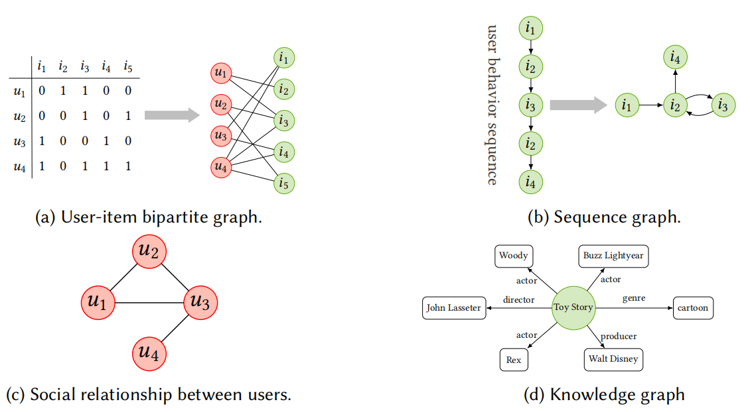

图1 生活中图的表示

现实生活中,人和物的交互、人和人的关系等都可以用“图”的形式表示(这篇文章主要研究图1(a)所示的“用户-项目”交互二部图)。推荐系统的原理恰是利用这些图中已有的节点关系去寻找潜在的节点关系作为推荐内容,因此图神经网络技术非常适合推荐任务,作者认为可称之“天作之合”。

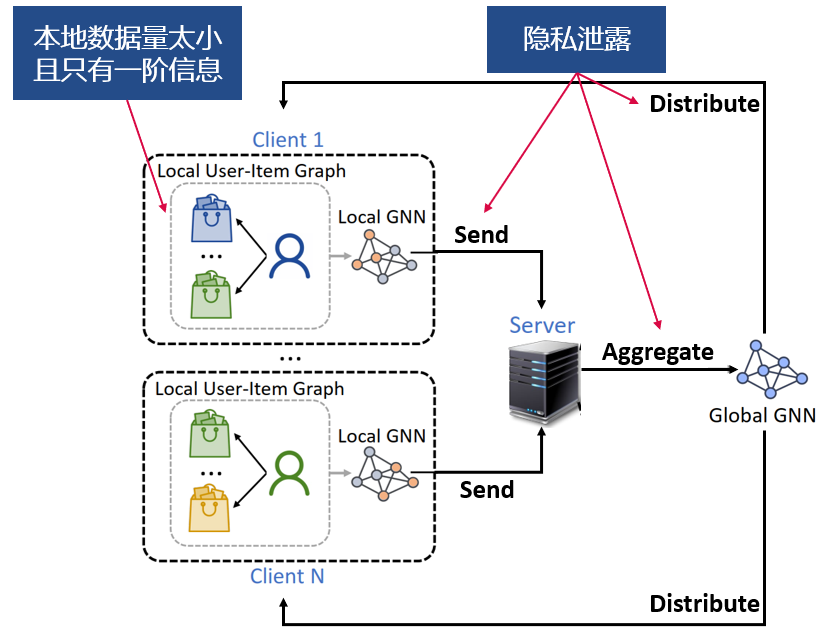

图2 联邦学习应对隐私保护

推荐系统将用户的数据收集起来做集中化GNN模型训练固然方便高效,但是却时刻面临着隐私泄露的风险,且要应对日益严苛的数据保护法规。此时联邦学习的出现为这一问题提供了解决思路,其可以做到隐私信息不出本地,本地训练GNN模型再聚合为全局GNN模型并迭代。

图3 联邦推荐系统面临挑战

目前联邦学习框架下,基于图神经网络的推荐系统主要面临着3个严峻挑战:

①本地GNN模型在传递、聚合过程中可能泄露隐私。

②本地的“用户-项目”交互数据量太小,无法训练出准确的GNN模型。

③本地用户数据只包括一阶“用户-项目”交互信息,无法扩展到高阶信息。

02

METHODOLOGY

✦

2.1 Problem Formulation

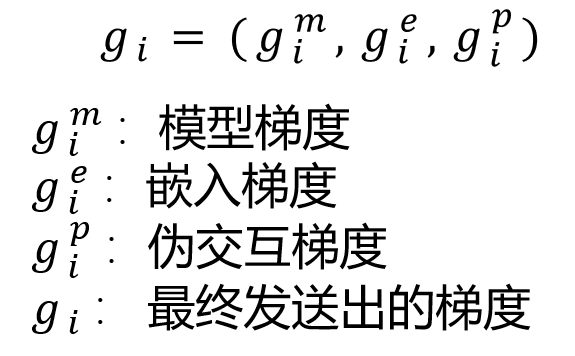

图4 方案形式化定义

先将本文方案进行形式化定义。用户和项目分别定义为P维和Q维向量,用户对项目的评分则构成P×Q的矩阵,评分矩阵可以映射为“用户-项目”的交互二部图,用户与多个项目的交互、评分分别构成相应集合。任务定义是在隐私保护前提下利用已有交互数据预测未观察到的评分矩阵。

2.2 FedPerGNN Framework

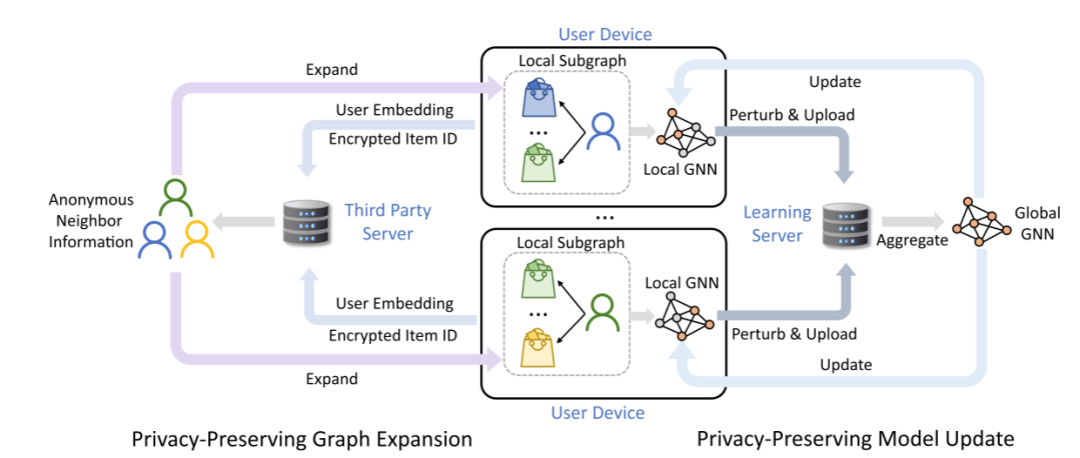

图5 FedPerGNN框架

框架参与方包括协调模型学习的学习服务器(Learning Server)、查找和分发匿名邻节点信息的第三方服务器(Third Party Server)以及联邦学习GNN模型的大量用户客户端(User Device)。

用户客户端保存一个本地子图,该子图由用户与项目的交互历史以及该用户与其邻节点(邻节点信息由“隐私保护的图拓展”过程周期性执行并提供)都交互过的项目ID组成。为了保护用户交互历史的隐私,在本地子图中加入了许多“伪交互项目”(即系统给用户并未实际交互过的项目打分)。用户客户端通过本地子图学习本地GNN模型获取梯度,并使用本地化差分隐私技术对梯度进行加噪扰动,然后将扰动后的梯度上传到中央学习服务器。学习服务器负责聚合接收到的所有梯度,并将聚合后的梯度分发给用户客户端。这个过程进行多次迭代直到模型收敛。最后,将用户客户端上的用户embedding上传到学习服务器,用于提供个性化服务。该方案可以利用分布在不同用户客户端上的高阶信息来缓解数据隔离问题,并很好地保护了用户隐私。

2.3 Method Module

作者认为,与传统的联邦学习框架相比,该方案的创新主要体现在上文2.2节蓝色字体的三部分,这也是本文想要重点介绍的内容。

隐私保护的图拓展

图6 隐私保护的图拓展

问题

本地用户客户端只存储一阶交互信息,无法满足GNN模型训练,且用户间无法自由交换交互信息以构成高阶交互信息。

方法

将具有类似交互项目的用户定义为邻节点,在本地交互子图中加入匿名邻节点以拓展交互子图。

流程

①服务器给每位用户分发公钥

②用户本地使用公钥对交互项目的ID进行同态加密

③将加密后的项目ID和自己的用户embedding发送给第三方服务器

④第三方服务器分发匿名已匹配用户的用户embedding

⑤本地将匿名用户embedding纳入到交互子图中完成交互图拓展

安全

推荐服务器不会接收ID密文,且第三方服务器无法解密ID密文

伪交互项目模糊化

问题

只有与用户有交互的项目才有非零的梯度来更新其embedding ,服务器可根据非零梯度直接恢复完整的用户-项目交互历史。

方法

对未交互的项目集合抽样,使用与真实交互相同的分布生成伪交互梯度,与真实梯度结合后一起发送给服务器。

公式

安全

即使用户最终发送的梯度被获取,因为有伪交互梯度的干扰,无法准确反推出其交互历史。

本地化差分隐私

问题

发送给服务器的梯度可能被截取,对梯度进行反推解码获取预测评分等隐私信息。

方法

在发送前进行本地化差分隐私操作,给梯度增加零均值拉普拉斯噪声。

公式

安全

即使用户最终发送的梯度被获取,因为加入了噪声扰动,无法准确反推出其预测评分。

03

EXPERIMENTS

✦

3.1 Dataset and Experimental Settings

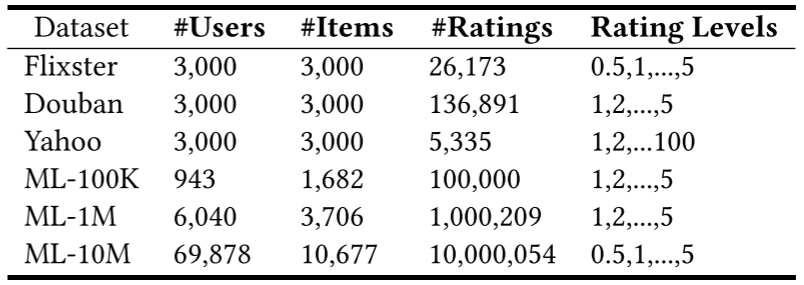

图7 实验数据集

实验所用数据集是MovieLens、Flixster、Douban、YahooMusic等影音平台评分数据。模型选取的图神经网络为图注意力网络(Graph Attention Network,GAT),使用常用的点积方法做评分预测器,SGD做优化算法。每轮模型训练随机选取128位用户,训练三轮,使用10次平均的均方根误差(RMSE)作为评估参数。

3.2 Experimental Evaluation

图8 不同模型实验对比结果

通过实验对比各个模型在各个数据集上的表现,使用RMSE做评估指标(数值越低说明推荐效果越好),可以得出以下3个结论:

①包含用户-项目图高阶信息的方法比仅基于一阶信息的方法性能更好

②FedPerGNN可以达到与“高阶模型”相当甚至更好的性能

③与其他联邦推荐算法相比性能更好,且同时保护评分和交互历史

图9 图神经网络和邻节点设置的实验对比结果

使用GGNN、GCN、GAT三种图神经网络模型分别在6个数据集上实验,使用RMSE做评估指标(数值越低说明推荐效果越好),并且区分是否加入邻节点信息和加入邻节点信息的方式——同步更新和周期更新,可以总结出以下两个结论:

①不同GNN网络的效果都不错,GAT最好,其能更好地反应节点之间交互重要性

②拓展交互子图获取高阶信息后效果更好,且周期性更新邻节点用户信息更佳

3.3 Hyperparameter Analysis

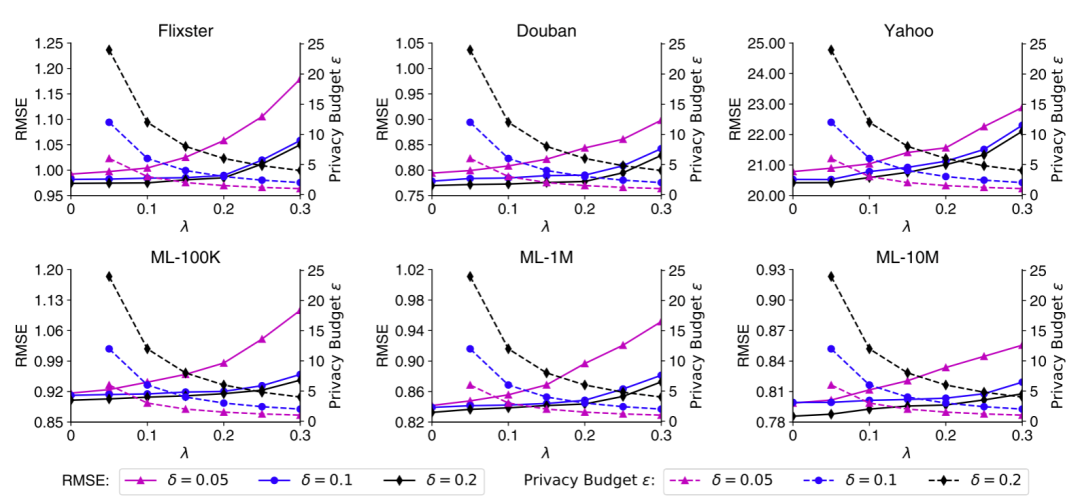

图10 两个超参数的调整过程

更低的RMSE代表更好的推荐效果,更低的隐私预算e、更低的加噪阈值δ、更大的加噪强度λ代表更好的隐私保护能力。通过实验对比可以总结出以下两个结论:

①加载阈值δ=0.05时精度损失过大,0.1和0.2时相差无几,为了更好地保护隐私选取δ=0.1

②加载强度λ=0.2之前精度损失变化不大,之后损失上升较快,为了更好地保护隐私选取λ=0.2

04

Discussion

✦

这篇文章的主要工作是提出了FedPerGNN框架,这是一个致力于推荐系统隐私保护的个性化联邦学习框架,旨在通过以隐私保护的方式利用高阶交互信息,在去中心化的用户数据上联合训练GNN模型。该方法不限制个性化场景,可以作为去中心化图数据隐私保护数据挖掘的基础技术。FedPerGNN可以在模型准确性、隐私保护能力和通信成本之间取得很好的平衡。其有望在许多其他涉及私有图数据的场景上发挥作用,例如智能医疗、城市计算和量化金融。但是,FedPerGNN也有缺陷和限制,其依赖于匹配邻节点的第三方服务器是可信的且不与中央学习服务器相勾结的假设;其次,在大量恶意客户端攻击的情况下,FedPerGNN的防御性比较脆弱,这也是作者想要在未来解决的问题。

研究展望

(图神经网络 + 推荐系统) + 联邦学习

无数的研究成果充分证明图神经网络应用于推荐系统上的优越性,以联邦学习为代表的隐私计算技术体系正在快速建立并广泛应用于中心化的模型训练场景,但这两者的交叉结合研究从论文发表的情况来看才刚刚起步,截止目前包括预印本文章在内的公开文章不足40篇。不过值得注意的是,该领域的文章数量少但增速快,2020年仅8篇,2021年已有30余篇公开文章,这个数字在2022年还在快速增长。

据作者总结,目前该领域的主要研究点有两个,一个是通信和计算资源的需求较集中式方法而言较大,在推荐系统中如何选取合适的客户端参与训练至关重要,仅使用随机选取的方法显然不是最优解。另一个则是安全性问题,也是刚刚介绍论文的最大问题,邻节点的匹配和联合是保障推荐效果的关键,但是如何在拓展交互图的同时保障“邻居”之间充分匿名化和匹配结果可信是个棘手的问题。

#

参考文献

[1] Wu, Chuhan, Fangzhao Wu, Lingjuan Lyu, Tao Qi, Yongfeng Huang, and Xing Xie. "A federated graph neural network framework for privacy-preserving personalization." Nature Communications 13, no. 1 (2022): 1-10.

[2] Wu, Chuhan, Fangzhao Wu, Yang Cao, Yongfeng Huang, and Xing Xie. "Fedgnn: Federated graph neural network for privacy-preserving recommendation." arXiv preprint arXiv:2102.04925 (2021).

译者简介:

谢彪,重庆大学大数据与软件学院硕士一年级研究生。主要研究兴趣包括联邦学习、数据安全、隐私保护。知乎:执者失之。