声明:语音合成论文优选系列主要分享论文,分享论文不做直接翻译,所写的内容主要是我对论文内容的概括和个人看法。如有转载,请标注来源。

欢迎关注微信公众号:低调奋进

Expressive Neural Voice Cloning

本文是加州大学圣地亚哥分校在2021.01.30更新的文章,主要工作做语音复刻和个性化,但本文主要添加情感的迁移,具体的文章链接

https://arxiv.org/pdf/2102.00151.pdf

(文章看着挺长,洋洋洒洒12页,但其实很简单)

1 研究背景

现在的语音合成系统可以通过使用GST来进行情感控制,但原始的tacotron2+GST来进行一句话复刻或者个性化定制的效果并不理想,因此本文的目标是在一句话复刻系统上进行风格的迁移控制。

2 详细设计

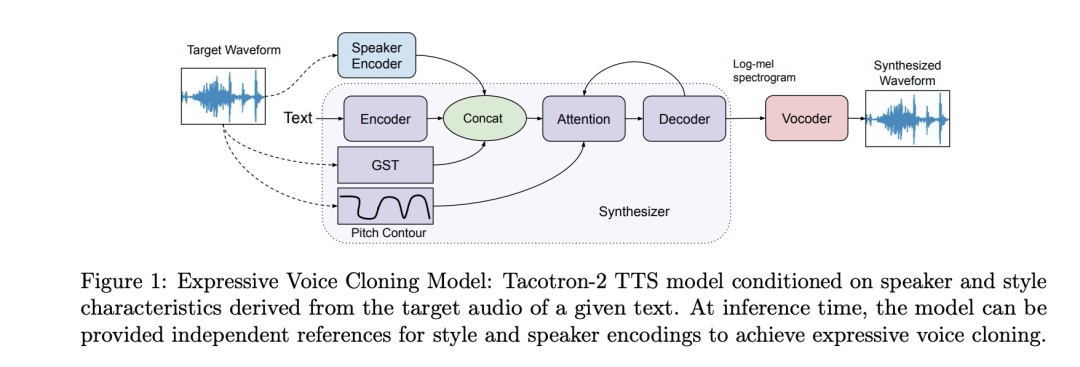

本文的系统架构如下图所示,系统的输入条件包括四个部分:text, speaker embedding, GST和Pitch contour,其中speaker encoder是用来学习说话人特征信息,encoder是进行语言特征进行编码表征,GST是学习音频的隐含特征,Pitch Contour是学习音频的基频轮廓。本文主要使用GST和Pitch Contour进行情感的迁移学习。

3 实验

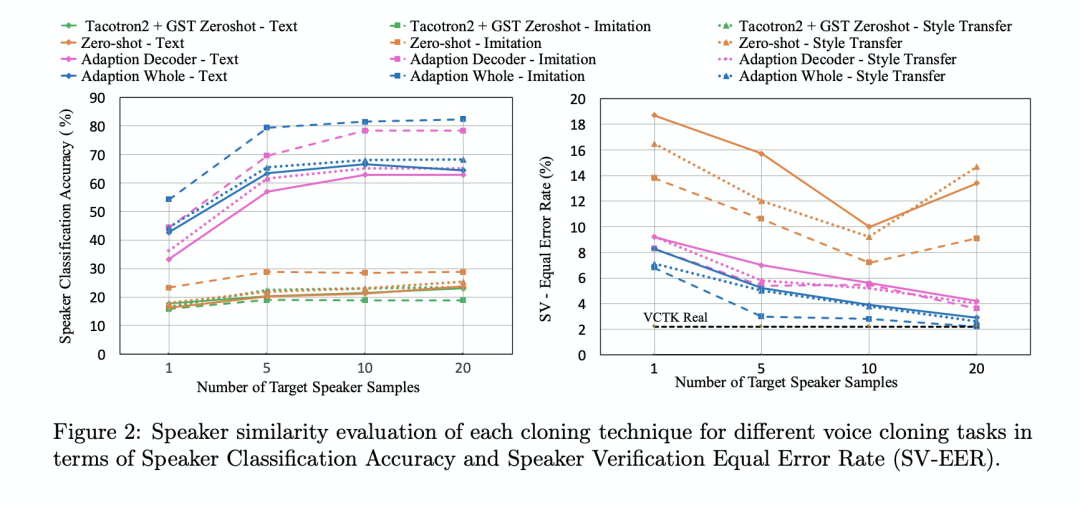

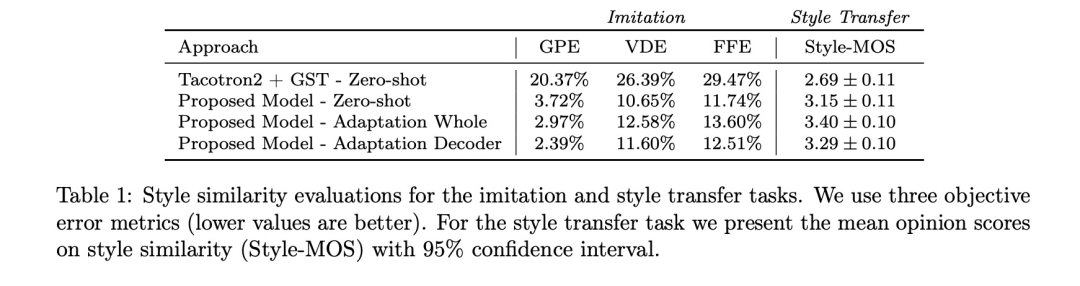

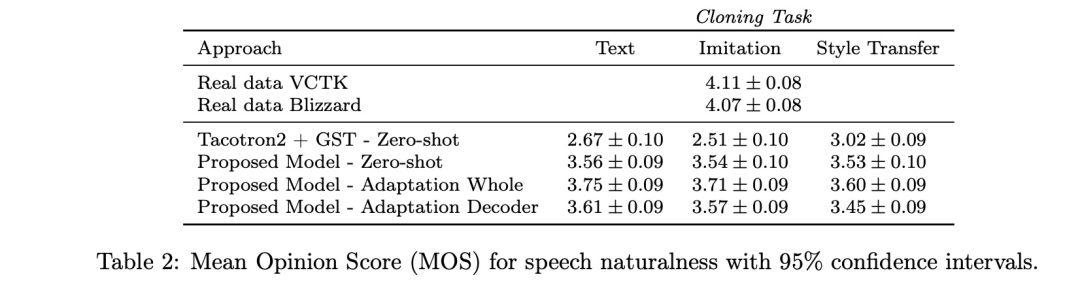

本文实验先验证合成音频与原始音频相似性,其结果如图2所示:使用本文提出的方案比原始的taoctron2+GST效果较好,使用少量训练语料进行自适应比zero-shot较好,自适应方案更新整个模型比只更新decoder效果较好。table1和table2对比风格迁移的一些准则和MOS值,结果和以上一致。

4 总结

本文主要在一句话或者少数量数据的语音合成系统上进行情感的迁移优化,使系统不仅仅复刻音色,也可以进行风格迁移。