文章目录

(6号上午整理完毕)

问题场景-扔不均衡硬币

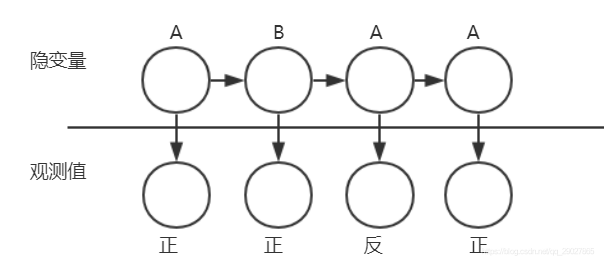

假设现在有两枚质地不均匀的硬币A和B,硬币A为正的概率是 μ 1 \mu_1 μ1,硬币B为正的概率为 μ 2 \mu_2 μ2。那么现在有这样一种情况:小明在扔硬币,我不知道小明扔的什么硬币(A或B),我只能看到硬币抛出后得到的结果正反的观测序列。

在这个场景下,有三个不确定的要素:小明第一次扔时选择扔硬币A还是扔硬币B的概率;小明当下选了某硬币后接下来可能要选扔哪枚硬币的转移概率;扔出的硬币得正反面的概率。

上述隐变量生成观测序列的过程,即称为隐马尔可夫模型。隐马有三个基本问题:

Q1 Inference Problem

假如知道模型参数的情况下,如何去根据观测值来反推背后隐藏变量的值? --> 维特比算法

(通过硬币的正反来推出这个硬币是A还是B)

Q2 估计参数的过程

知道观测到的序列值,估计模型的参数; --> EM算法

(通过硬币的正反序列来推出硬币A和B的正反面的概率,以及第一次选硬币是A还是B的概率)

Q3:预测序列

已知模型参数的情况下,如何计算一个观测序列的概率?

(求硬币某一个正反序列发生的概率)

应用场景:词性标注Pos

问题一:给定模型参数,找出最适合的z

方案一:考虑所有可能的值;

方案二:FB Algorithm

方案三:维特比