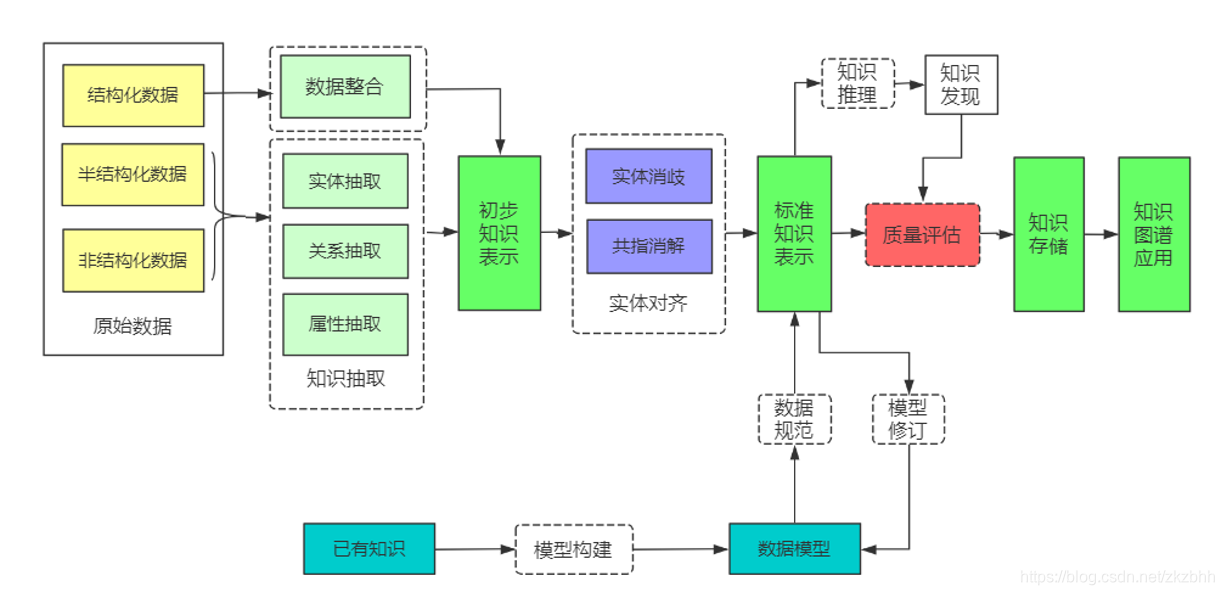

将结构化、半结构化和非结构化数据中的实体、关系和属性进行提取。之后就要进行知识表示。本文主要介绍知识表示的概念、常见的代表模型:距离模型、单层神经网络模型、能量模型、双线性模型、张量神经网络模型、矩阵分解模型和Trans系列模型。

说明:

摘自刘知远:知识表示学习研究进展(DOI;10.7544/issn1000-1239.2016.20160020)

导读:

目录:

- 一、知识表示学习概念

- 二、知识表示学习主要方法

一.知识表示学习的概念

one-hot representation:将研究对象表示为向量,该向量只有某一维非零,其它维度上的值均为0,独热表示是信息检索和搜索引擎中广泛使用的词袋模型的基础。优点是无需学习过程,简单高效,在信息检索和自然语言处理中得到广泛应用。缺点是会丢失大量有用信息,无法有效表示短文本、容易受到数据稀疏问题的影响。

表示学习的目标:通过机器学习将研究对象的语义信息表示为稠密低维实值向量。将实体e和关系r表示为两个不同向量,在向量空间中,通过欧式距离或余弦距离等方式,计算任意两个对象之间的语义相似度。

知识表示学习得到的分布式表示,我们可以快速计算实体间的语义相似度,这对于自然语言处理和信息检索的很多任务有重要意义;我们还可以知识图谱补全,构建大规模知识图谱,需要不断补充实体间的关系,利用知识表示学习模型,我们可以预测2个实体的关系;除此之外,还可以用于关系抽取,自动问答,实体链指等任务,展现出巨大的应用潜力。

知识表示学习的优点:显著提升计算效率,知识库的三元组表示实际就是基于独热表示的,在这种表示方式下,需要设计专门的图算法计算实体间的语义和推理关系,计算复杂度高、可扩展性差。而表示学习得到的分布式表示,能够高效地实现语义相似度计算等操作,显著提升计算效率;有效缓解数据稀疏;实现异质信息融合。

二.知识表示学习的主要方法

知识表示学习的代表模型,包括距离模型、单层神经网络模型、能量模型、双线性模型、张量神经网络模型、矩阵分解模型和翻译模型,还有最重要的Trans系列模型。

1.距离模型(SE)

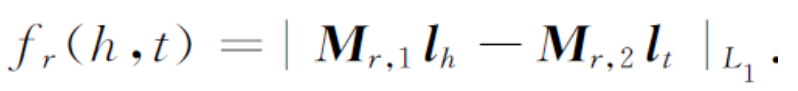

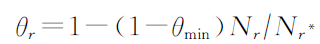

每个实体用d维的向量表示,所有实体被投影到同一个d维向量空间中,同时,距离模型还未每个关系r定义2个矩阵,用于三元组中头实体和尾实体的投影操作。最后,距离模型为每个三元组(h,r,t)定义了如下损失函数:

距离模型的损失函数

距离模型将头实体向量和尾实体向量通过关系r的2个矩阵投影到r的对应空间中,然后在该空间中计算两投影向量的距离。这个距离反映了2个实体在关系r下的语义相似度,他们距离越小,说明这2个实体存在这种关系。

距离模型能够利用学习得到的知识表示进行链接预测,即通过计算,找到让两实体距离最近的关系矩阵。

距离模型的缺陷:协同性差,无法精确刻画两个实体之间的语义联系

2.单层神经网络模型(SLM)

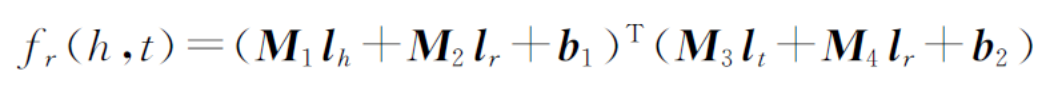

采用单层神经网络的非线性操作,来减轻距离模型无法协同精确刻画实体与关系的语义联系的问题。SLM为每个三元组(h,r,t)定义了评分函数:

SLM是SE模型的改进版本,但是它的非线性操作仅提供了实体和关系之间比较微弱的联系,与此同时,引进了更高的计算复杂度。

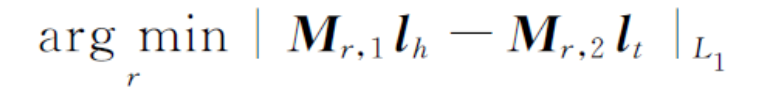

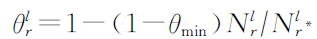

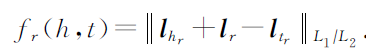

3.能量模型(SME)

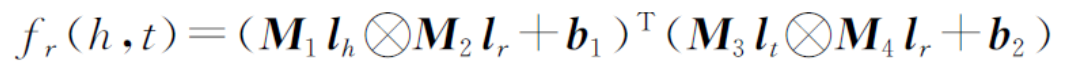

语义匹配能量模型,提出更复杂的操作,寻找实体和关系之间的语义联系。在SME中,每个实体和关系都用低维向量表示,在此基础上,SME定义若干投影矩阵,刻画实体与关系的内在联系,SME为每个三元组(h,r,t)定义了2种评分函数,分别是线性形式:

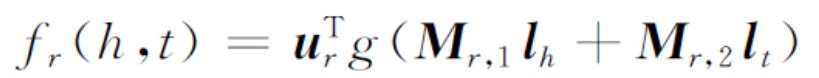

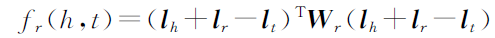

和双线性形式:

此外,也可以用三阶张量代替SME的双线性形式。

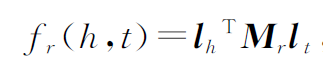

4.双线性模型(LFM)

隐变量模型提出利用基于关系的双线性变换,刻画实体和关系之间的二阶关系,LFM为每个三元组(h,r,t)定义了如下双线性评分函数:

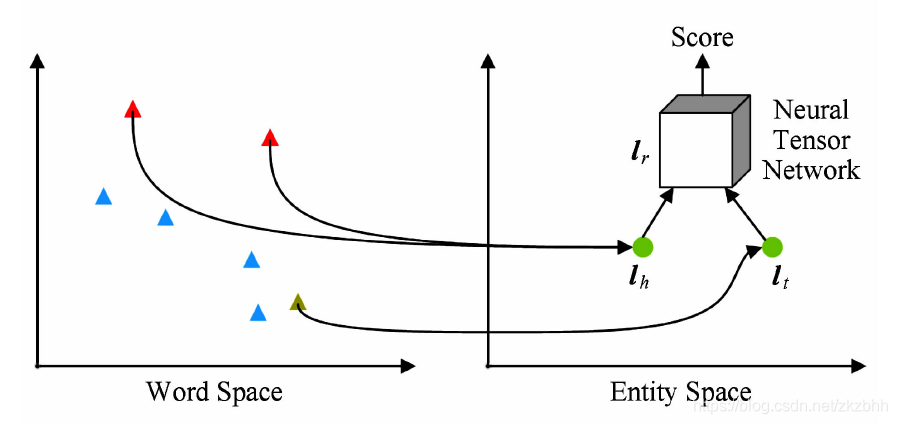

5.张量神经网络模型(NTN)

张量神经网络模型的基本思想是,用双线性张量取代传统神经网络中的线性变换层,在不同的维度下将头、尾实体向量联系起来。基本思想如下图:

张量神经网络模型

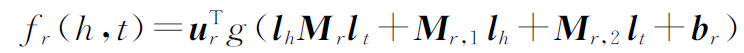

NTN为每个三元组(h,r,t)定义了如下评分函数,评价2个实体之间存在的某个特定关系r的可能性:

NTN中的实体向量是该实体中所有单词向量的平均值,这样做的好处是,实体中的单词数量远小于实体数量,可以充分重复利用单词向量构建实体表示,降低实体表示学习的稀疏性问题,增强不同实体的语义联系。

NTN的缺陷:虽然能够更精确地刻画实体和关系的复杂语义联系,但复杂度非常高,需要大量三元组样例才能得到充分学习,NTN在大规模稀疏知识图谱上的效果较差。

6.矩阵分解模型(RESACL)

知识库三元组构成了一张大的张量X,如果三元组(h,r,t)存在,则X=1,否则为0.张量分解旨在将每个三元组(h,r,t)对应的张量值X分解为实体和关系表示,使得X尽量地接近于LML

RESACL的基本思想与前述LFM类似,不同之处在于,RESACL会优化张量中的所有位置,包括0的位置;而LFM只会优化知识库中存在的三元组。

7.Trans系列模型

7.1TransH模型

在处理1-N,N-1,N-N复杂关系时的局限性,TransH模型提出让一个实体在不同的关系下拥有不同的表示。

损失函数:

7.2TransR/CTransR模型

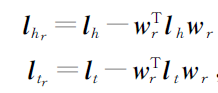

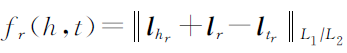

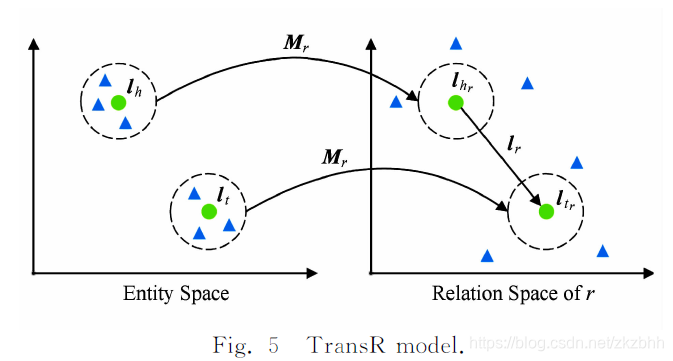

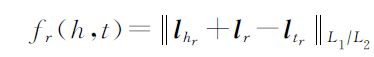

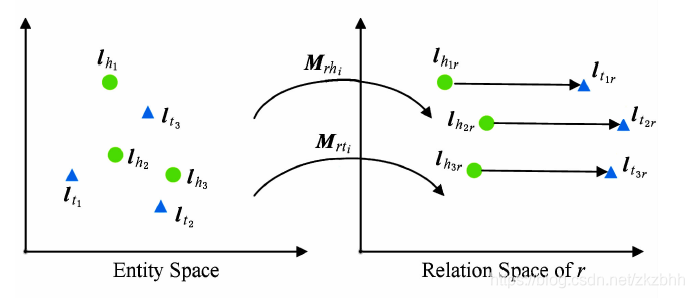

虽然TransH模型使每个实体在不同关系下拥有不同的表示,它仍然假设实体和关系处于相同的语义空间R中,在一定程度上限制了TransH的表达能力。TransR模型认为,一个实体是多种属性的综合体,不同关系关注实体的不同属性。TransR认为不同的关系拥有不同的语义空间,对每个三元组,首先应将实体投影到对应的关系空间中,然后再建立从头实体到尾实体的翻译关系。

上图是TransR模型的简单示例,对于每个三元组(h,r,t),我们首先将实体向量向关系r空间投影,原来在实体空间中与头(圆圈表示)、尾实体相似的实体(三角形表示),在关系r空间内被区分开了。具体而言,对于每一个关系r,TransR表示如下:

![[公式]](https://img-blog.csdnimg.cn/20200810203800147.png)

因此 TransR定义了如下损失函数:

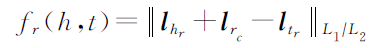

相关研究表明,某些关系还可以进行更细致的划分。于是,Lin等人进一步提出了CTransR模型,通过把关系r对应的实体对的向量差值 进行聚类,将关系r细分为多个子关系.CTransR模型为每一个子关系分别学习向量表示,对于每个三元组,定义了如下损失函数:

TransR模型的缺点:

(1)在同一个关系r下,头、尾实体共享相同的投影矩阵。然而,一个关系的头、尾实体的类型或属性可能差异巨大。例如(美国,总统,奥巴马),美国和奥巴马的类型不同,一个是国家,一个是人物。

(2)从实体空间到关系空间的投影是实体和关系的交互过程。因此TransR让投影矩阵仅与关系有关是不合理的。

(3)与TransE和TransH相比,TransR引入了空间投影,使得TransR模型参数急剧增加,计算复杂率大大提高。

7.3TransD模型

为了解决TransR模型的缺点,Ji等人提出了TransD模型,如下图所示,给定三元组,TransD模型设置了2个分别将头实体和尾实体投影到关系空间的投影矩阵,具体定义如下:

![[公式] , [公式]](https://img-blog.csdnimg.cn/20200810203954891.png)

利用2个投影向量构建投影矩阵,解决了原来TransR模型参数过多的问题。最后,TransD模型定义了损失函数:

![[公式]](https://img-blog.csdnimg.cn/20200810204006764.png)

7.4TransSpare模型

知识库中实体和关系的异质性和不平衡性是制约知识表示学习的难题:

(1)异质性:知识库中某些关系可能会与大量的实体有连接,而某些关系则可能仅仅与少量实体有连接。

(2)不均衡性:在某些关系中,头实体和尾实体的种类和数量可能差别巨大。

为了解决实体和关系的异质性。TransSparse提出使用稀疏矩阵 [公式] 的稀疏度由关系r连接的实体对数量决定。这里头、尾实体共享同一个投影矩阵,投影矩阵的稀疏度定义如下:

这样,投影向量可定义为:

![[公式] , [公式]](https://img-blog.csdnimg.cn/20200810204049578.png)

为了解决关系的不平衡性问题,TranSparse对于头实体和尾实体分别使用2个不同的投影矩阵.;两者的稀疏度定义如下:

这样,投影向量可定义为:

![[公式] , [公式]](https://img-blog.csdnimg.cn/20200810204120186.png)

TranSparse对于以上2种形式,均定义如下损失函数:

7.5TransA模型

加粗样式

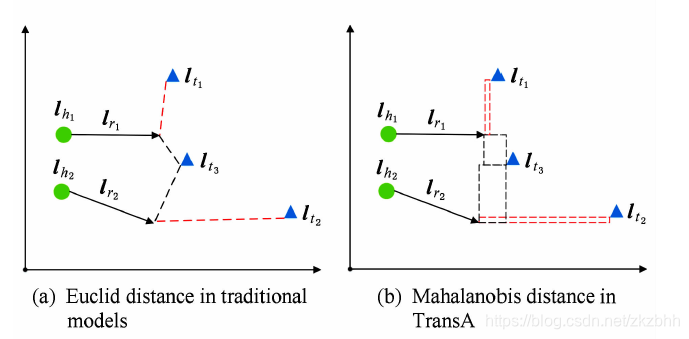

Xiao等人提出TransA模型,将损失函数中的距离度量改为马氏距离,并为每一维学习不同的权重,对于每个三元组.TransA模型定义了如下评分函数:

如下图所示:

7.6 TransG模型

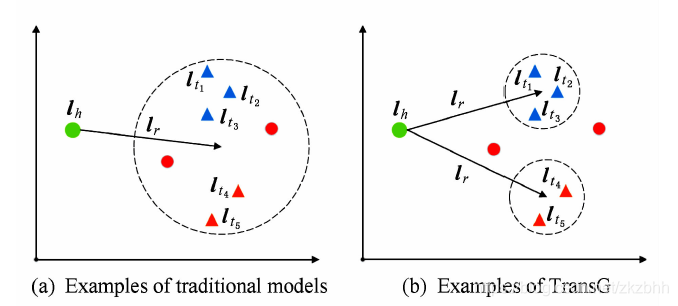

TransG模型提出使用高斯混合模型描述头、尾实体之间的关系。该模型认为,一个关系会对应多种语义,每种语义用一个高斯分布来刻画,其中I表示单位矩阵。

TransG模型与传统模型的对比如下图所示。其中三角形表示正确的尾实体,圆形表示错误的尾实体。

图(a)中为传统模型示例,由于将关系r的所有语义混为一谈,导致错误的实体无法被区分开,而图(b)所示,TransG模型通过考虑关系r的不同语义,形成多个高斯分布,就能区分出正确和错误实体。

7.7KG2E模型

知识库中的关系和实体的语义 本身具有不确定性,这在过去模型中被忽略了。因此He等人提出KG2E,使得高斯分布来表示实体和关系。其中高斯分布的均值表示的是实体或关系在语义空间中的中心位置,而高斯分布的协方差则表示该实体或关系的不确定度。下图为KG2E的模型示例,每个圆圈代表不同实体与关系的表示,其中圈圈大小表示的是不同实体或关系的不确定度。