前面我们尝试了数据处理部分的代码复现,一般来说此时代码所需要的基础的环境已经配置完成,并且绝大多数文件也都已经下载完成。不过在复现训练代码的时候依旧出现了一些问题。采坑记录,希望帮到后来人!

**

一、bert-base-uncased下载

**

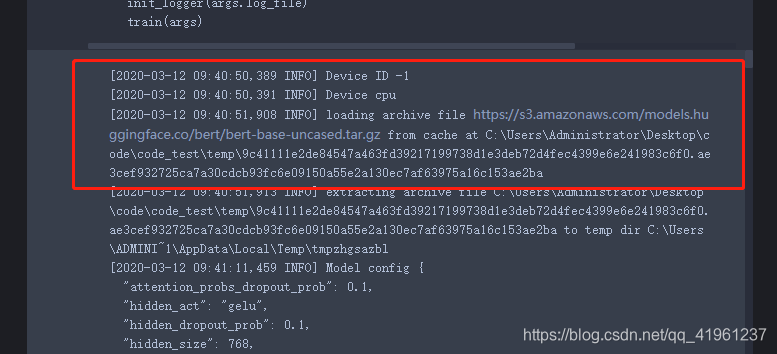

因为我们使用的pytorch版本的bert预训练模型,因此需要下载预训练文件,当我们运行代码的时候就会自动下载。

当时通常需要科学上网,一般用国内的网络是下不动的,好在我已经下载了,并且打包分享。有需要的同学可以下载放在temp目录下即可。

**

二、bug记录

**

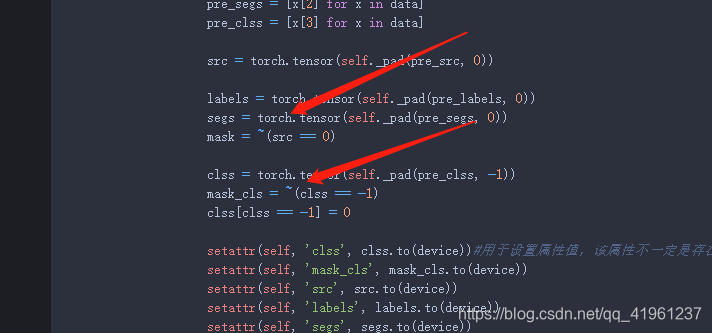

在调试过程中出现一个bug,貌似是因为pytorch版本的问题。报错内容如下:RuntimeError: Subtraction, the - operator, with a bool tensor is not supported. If you are trying to invert a mask, use the ~ or bitwise_not() operator instead.

出现这种问题的小伙伴,需要将Batch模块中的内容稍加修改,具体内容如下:

**

**

三、代码训练

**

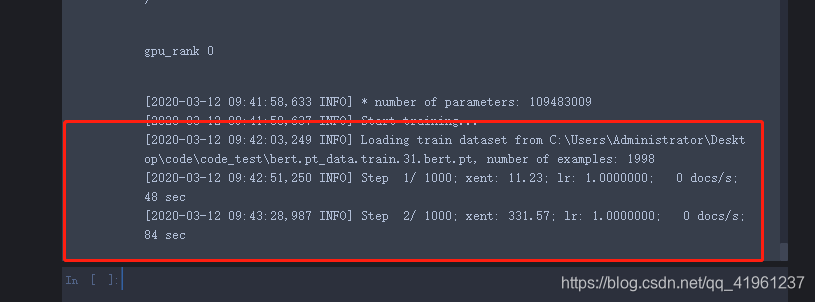

因为疫情的缘故,在家调试代码,并可以硬件设备,只能暂且跑通代码,具体的训练测试阶段等开学回学校了再继续进行。不过好在在家里的电脑能简单的跑一下:

我发现设备不行,真的什么事情都做不了。直接电脑卡死,强制重启了。

我发现设备不行,真的什么事情都做不了。直接电脑卡死,强制重启了。

至于代码中所需要的预训练模型,可以在公众号:江湖硕士,回复关键字:pytorch-bert模型。