1 霍夫变换

霍夫变换是一个特征提取技术。其可用于隔离图像中特定形状的特征的技术,应用在图像分析、计算机视觉和数字图像处理领域。目的是通过投票程序在特定类型的形状内找到对象的不完美实例。这个投票程序是在一个参数空间中进行的,在这个参数空间中,候选对象被当作所谓的累加器空间中的局部最大值来获得,所述累加器空间由用于计算霍夫变换的算法明确地构建。最基本的霍夫变换是从黑白图像中检测直线(线段)。Hough变换主要优点是能容忍特征边界描述中的间隙,并且相对不受图像噪声的影响。

1.1霍夫直线变换原理

霍夫变换最简单的是检测直线。我们知道,直线的方程表示可以由斜率和截距表示(这种表示方法,称为斜截式),如下所示:

y = mx+b

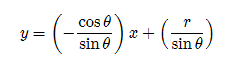

但是这样会参数问题,垂直线的斜率不存在(或无限大),这使得斜率参数m的值接近于无限。为此,为了更好的计算,Richard O. Duda和Peter E. Hart在1971年4月,提出了Hesse normal form(Hesse法线式)

化简得到:

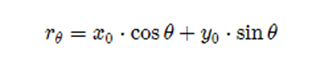

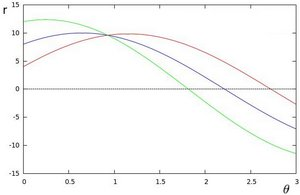

其中r是原点到直线上最近点的距离(其他人可能把这记录为ρ,下面也可以把r看成参数ρ),θ是x轴与连接原点和最近点直线之间的夹角。如下图:

因此,可以将图像的每一条直线与一对参数(r,θ)相关联。这个参数(r,θ)平面有时被称为霍夫空间,用于二维直线的集合。

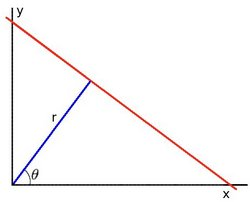

经过Hough变换,将图像空间中的一个点映射到Hough空间,如图下图所示:

因此,对于霍夫变换,通俗来讲,就是对直线上的任意一点,画经过此点的任意直线(0~360度),然后找到对应极坐标空(r, theta),然后在绘制图像。

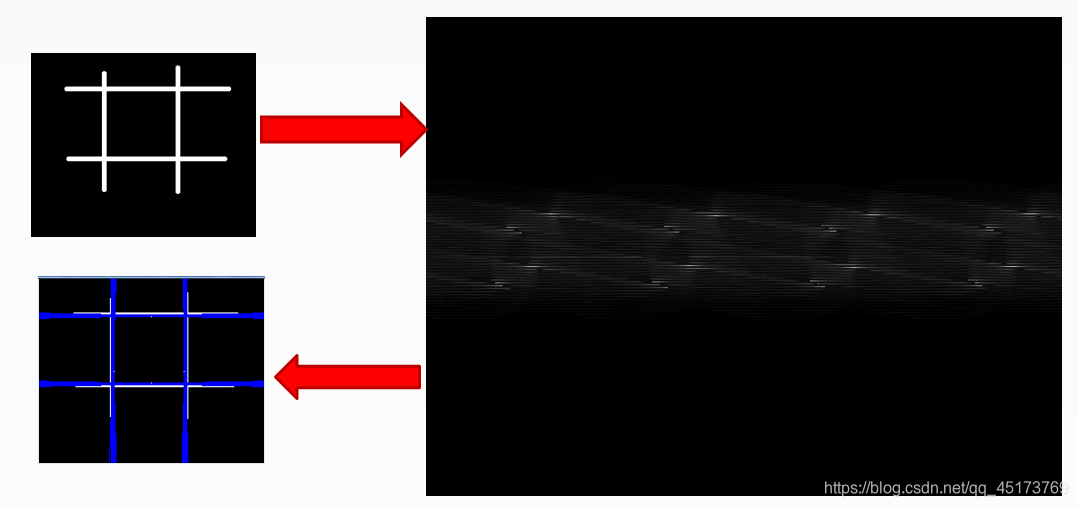

属于同一条直线上点在极坐标空(r, theta)必然在一个点上有最强的信号出现,根据此反算到平面坐标中就可以得到直线上各点的像素坐标。从而得到直线。如下图所示:

实际例子:

该变换的结果存储在矩阵中。单元格值表示通过任意点的曲线数量。更高的单元格值变得更亮。图中明显的亮点是直线的霍夫参数。从这些点的位置,可以确定输入图像中两条线的图像中心的角度和距离。

1.2相应的API

标准的霍夫变换 cv::HoughLines从平面坐标转换到霍夫空间,最终输出是 表示极坐标空间;

霍夫变换直线概率 cv::HoughLinesP最终输出是直线的两个点(x0,y0.x1,y1)。

cv::HoughLines(

InputArray src, // 输入图像,必须8-bit的灰度图像

OutputArray lines, // 输出的极坐标来表示直线

double rho, // 生成极坐标时候的像素扫描步长

double theta, //生成极坐标时候的角度步长,一般取值CV_PI/180

int threshold, // 阈值,只有获得足够交点的极坐标点才被看成是直线

double srn=0;// 是否应用多尺度的霍夫变换,如果不是设置0表示经典霍夫变换

double stn=0;//是否应用多尺度的霍夫变换,如果不是设置0表示经典霍夫变换

double min_theta=0; // 表示角度扫描范围 0 ~180之间, 默认即可

double max_theta=CV_PI

) // 一般情况是有经验的开发者使用,需要自己反变换到平面空间

cv::HoughLinesP(

InputArray src, // 输入图像,必须8-bit的灰度图像

OutputArray lines, // 输出的极坐标来表示直线

double rho, // 生成极坐标时候的像素扫描步长

double theta, //生成极坐标时候的角度步长,一般取值CV_PI/180

int threshold, // 阈值,只有获得足够交点的极坐标点才被看成是直线

double minLineLength=0;// 最小直线长度

double maxLineGap=0;// 最大间隔

)

实例:

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace cv;

using namespace std;

int main(int argc, char** argv) {

Mat src, src_gray, dst;

src = imread("D:/vcprojects/images/lines.png");

if (!src.data) {

printf("could not load image...\n");

return -1;

}

char INPUT_TITLE[] = "input image";

char OUTPUT_TITLE[] = "hough-line-detection";

namedWindow(INPUT_TITLE, CV_WINDOW_AUTOSIZE);

namedWindow(OUTPUT_TITLE, CV_WINDOW_AUTOSIZE);

imshow(INPUT_TITLE, src);

// extract edge

Canny(src, src_gray, 150, 200);

cvtColor(src_gray, dst, CV_GRAY2BGR);

imshow("edge image", src_gray);

vector<Vec2f> lines;

HoughLines(src_gray, lines, 1, CV_PI / 180, 150, 0, 0);

for (size_t i = 0; i < lines.size(); i++) {

float rho = lines[i][0]; // 极坐标中的r长度

float theta = lines[i][1]; // 极坐标中的角度

Point pt1, pt2;

double a = cos(theta), b = sin(theta);

double x0 = a*rho, y0 = b*rho;

// 转换为平面坐标的四个点

pt1.x = cvRound(x0 + 1000 * (-b));

pt1.y = cvRound(y0 + 1000 * (a));

pt2.x = cvRound(x0 - 1000 * (-b));

pt2.y = cvRound(y0 - 1000 * (a));

line(dst, pt1, pt2, Scalar(0, 0, 255), 1, CV_AA);

}

/*

vector<Vec4f> plines;

HoughLinesP(src_gray, plines, 1, CV_PI / 180.0, 10, 0, 10);

Scalar color = Scalar(0, 0, 255);

for (size_t i = 0; i < plines.size(); i++) {

Vec4f hline = plines[i];

line(dst, Point(hline[0], hline[1]), Point(hline[2], hline[3]), color, 3, LINE_AA);

}*/

imshow(OUTPUT_TITLE, dst);

waitKey(0);

return 0;

}

1.3霍夫圆变换原理

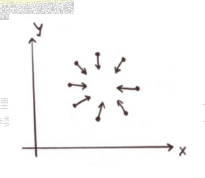

霍夫变换检测圆形的原理跟检测直线的原理是一样的。圆的表达式为 (x-a)2+(y-b)2=r2 , 把问题转换成在求解经过像素点最多的 (a,b,r) 参数对。这里会发现(a,b,r)的参数空间特别大,计算量特别大。我们一般使用霍夫梯度法来解决圆的变换。

如上图所示,如果我们对一个圆求梯度,那么圆上所有的点的梯度的方向均朝向圆心。

基于此有如下原理:

(1)首先对图像应用边缘检测,比如用canny边缘检测

(2)使用sobel算子计算所有像素的梯度

(3)遍历canny之后的所有非0的像素点,沿着梯度方向画线,每个点有是一个累加器,有一个线经过该点,累加器加1,对所有累加器进行排序,根据阈值找到所有可能的圆心

(4)计算canny图像中所有的非0像素点距离圆心的距离,距离从小到大排序,选取合适的半径

(5)对选取的半径设置累加器,对于满足半径r的累加器+1

1.4检测步骤

因为霍夫圆检测对噪声比较敏感,所以首先要对图像做中值滤波。

基于效率考虑,Opencv中实现的霍夫变换圆检测是基于图像梯度的实现,分为两步:

1. 检测边缘,发现可能的圆心

2. 基于第一步的基础上从候选圆心开始计算最佳半径大小

1.5相应的API

HoughCircles(

InputArray image, // 输入图像 ,必须是8位的单通道灰度图像

OutputArray circles, // 输出结果,发现的圆信息

Int method, // 方法 - HOUGH_GRADIENT

Double dp, // dp = 1;

Double mindist, // 10 最短距离-可以分辨是两个圆的,否则认为是同心圆- src_gray.rows/8

Double param1, // canny edge detection low threshold

Double param2, // 中心点累加器阈值 – 候选圆心

Int minradius, // 最小半径

Int maxradius//最大半径

)

实例:

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace cv;

using namespace std;

int main(int argc, char** argv) {

Mat src, dst;

src = imread("D:/vcprojects/images/circle.png");

if (!src.data) {

printf("could not load image...\n");

return -1;

}

char INPUT_TITLE[] = "input image";

char OUTPUT_TITLE[] = "hough circle demo";

namedWindow(INPUT_TITLE, CV_WINDOW_AUTOSIZE);

namedWindow(OUTPUT_TITLE, CV_WINDOW_AUTOSIZE);

imshow(INPUT_TITLE, src);

// 中值滤波

Mat moutput;

medianBlur(src, moutput, 3);

cvtColor(moutput, moutput, CV_BGR2GRAY);

// 霍夫圆检测

vector<Vec3f> pcircles;

HoughCircles(moutput, pcircles, CV_HOUGH_GRADIENT, 1, 10, 100, 30, 5, 50);

src.copyTo(dst);

for (size_t i = 0; i < pcircles.size(); i++) {

Vec3f cc = pcircles[i];

circle(dst, Point(cc[0], cc[1]), cc[2], Scalar(0, 0, 255), 2, LINE_AA);

circle(dst, Point(cc[0], cc[1]), 2, Scalar(198, 23, 155), 2, LINE_AA);

}

imshow(OUTPUT_TITLE, dst);

waitKey(0);

return 0;

}

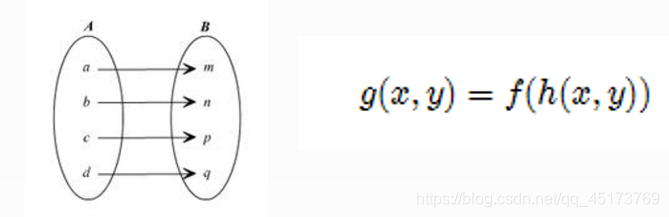

2 像素重映射

简单点说就是把输入图像中各个像素按照一定的规则映射到另外一张图像的对应位置上去,形成一张新的图像。

g(x,y)是重映射之后的图像,h(x,y)是功能函数,f是源图像。假设有一幅图像I,满足后面条件作重映射: h(x,y)=(I.cols - x,y),即进行图像上下颠倒。

为了完成映射过程, 有必要获得一些插值为非整数像素坐标,因为源图像与目标图像的像素坐标不是一一对应的.

简单的说就是改变图片的位置(左,右,上,下,颠倒)

相应的API:

cv::remap (

InputArray src,

OutputArray dst,

InputArray map1,

InputArray map2,

int interpolation,

int borderMode = BORDER_CONSTANT,

const Scalar borderValue = Scalar()

)

```

下面是函数各个参数的解释:

第一个参数,InputArray类型的src,输入图像,即源图像,填Mat类的对象即可,且需为单通道8位或者浮点型图像。

第二个参数,OutputArray类型的dst,函数调用后的运算结果存在这里,即这个参数用于存放函数调用后的输出结果,需和源图片有一样的尺寸和类型

第三个参数,InputArray类型的map1,它有两种可能的表示对象。表示点(x,y)的第一个映射。表示CV_16SC2 , CV_32FC1 或CV_32FC2类型的X值。

第四个参数,InputArray类型的map2,同样,它也有两种可能的表示对象,而且他是根据map1来确定表示那种对象。若map1表示点(x,y)时。这个参数不代表任何值。表示CV_16UC1 , CV_32FC1类型的Y值(第二个值)。

第五个参数,int类型的interpolation,插值方式,之前的resize( )函数中有讲到,需要注意,resize( )函数中提到的INTER_AREA插值方式在这里是不支持的,所以可选的插值方式如下:INTER_NEAREST - 最近邻插值INTER_LINEAR – 双线性插值(默认值)INTER_CUBIC – 双三次样条插值(逾4×4像素邻域内的双三次插值)INTER_LANCZOS4 -Lanczos插值(逾8×8像素邻域的Lanczos插值)

第六个参数,int类型的borderMode,边界模式,有默认值BORDER_CONSTANT,表示目标图像中“离群点(outliers)”的像素值不会被此函数修改。

第七个参数,const Scalar&类型的borderValue,当有常数边界时使用的值,其有默认值Scalar( ),即默认值为0。

**相应实例:**

```cpp

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace cv;

Mat src, dst, map_x, map_y;

const char* OUTPUT_TITLE = "remap demo";

int index = 0;

void update_map(void);

int main(int argc, char** argv) {

src = imread("D:/vcprojects/images/test.png");

if (!src.data) {

printf("could not load image...\n");

return -1;

}

char input_win[] = "input image";

namedWindow(input_win, CV_WINDOW_AUTOSIZE);

namedWindow(OUTPUT_TITLE, CV_WINDOW_AUTOSIZE);

imshow(input_win, src);

map_x.create(src.size(), CV_32FC1);

map_y.create(src.size(), CV_32FC1);

int c = 0;

while (true) {

c = waitKey(500);

if ((char)c == 27) {

break;

}

index = c % 4;

update_map();

remap(src, dst, map_x, map_y, INTER_LINEAR, BORDER_CONSTANT, Scalar(0, 255, 255));

imshow(OUTPUT_TITLE, dst);

}

return 0;

}

void update_map(void) {

for (int row = 0; row < src.rows; row++) {

for (int col = 0; col < src.cols; col++) {

switch (index) {

case 0:

if (col > (src.cols * 0.25) && col <= (src.cols*0.75) && row > (src.rows*0.25) && row <= (src.rows*0.75)) {

map_x.at<float>(row, col) = 2 * (col - (src.cols*0.25));

map_y.at<float>(row, col) = 2 * (row - (src.rows*0.25));

}

else {

map_x.at<float>(row, col) = 0;

map_y.at<float>(row, col) = 0;

}

break;

case 1:

map_x.at<float>(row, col) = (src.cols - col - 1);

map_y.at<float>(row, col) = row;

break;

case 2:

map_x.at<float>(row, col) = col;

map_y.at<float>(row, col) = (src.rows - row - 1);

break;

case 3:

map_x.at<float>(row, col) = (src.cols - col - 1);

map_y.at<float>(row, col) = (src.rows - row - 1);

break;

}

}

}

}

3直方图

图像直方图,是指对整个图像像在灰度范围内的像素值(0~255)统计出现频率次数,据此生成的直方图,称为图像直方图-直方图。直方图反映了图像灰度的分布情况。是图像的统计学特征。

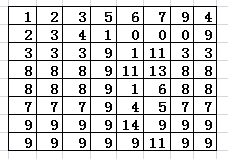

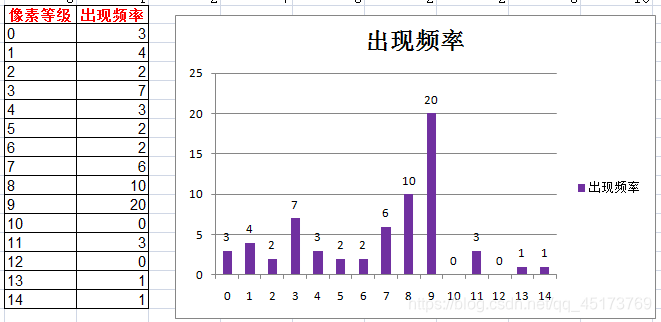

比如:假设有图像数据8x8,像素值范围0~14共15个灰度等级,统计得到各个等级出现次数及直方图如下图所示:

直方图意义:

1. 直方图是图像中像素强度分布的图形表达方式。

2. 直方图统计了每一个强度值所具有的像素个数。

直方图广泛应用于许多计算机视觉应用中。通过标记帧和帧之间显著的边缘和颜色的统计变化,来检测视频中场景的变换。通过在每个兴趣点设置一个有相近特征的直方图所构成的标签,用以确定图像中的兴趣点。边缘、色彩、角度等直方图构成了可以被传递给目标识别分类器的一个通用特征类型。色彩和边缘的直方图还可以用来识别网络视频是否被复制等。直方图是计算机视觉中最经典的工具之一,也是一个很好的图像特征表示手段。

3.1直方图均衡化

直方图均衡化是通过拉伸像素强度的分布范围,使得在0~255灰阶上的分布更加均衡,提高了图像的对比度,达到改善图像主观视觉效果的目的。对比度较低的图像适合使用直方图均衡化方法来增强图像细节。

相应的API:

equalizeHist(

InputArray src,//输入图像,必须是8-bit的单通道图像

OutputArray dst// 输出结果

)

对应实例:

//equalizeHist(直方图均衡化);提高图像对比度

//彩色图像直方图均衡化

#include "stdafx.h"

#include<opencv2/opencv.hpp>

#include<iostream>

#include<cmath>

using namespace cv;

using namespace std;

const char*output = "histogram iamge";

int main(int argc, char*argv)

{

Mat src, dst, dst1;

src = imread("C:\\Users\\zhj\\Desktop\\image\\雾天.png");

if (!src.data)

{

printf("could not load image...\n");

return -1;

}

char input[] = "input image";

namedWindow(input, CV_WINDOW_AUTOSIZE);

namedWindow(output, CV_WINDOW_AUTOSIZE);

imshow(input, src);

//分割通道

vector<Mat>channels;

split(src, channels);

Mat blue, green, red;

blue = channels.at(0);

green = channels.at(1);

red = channels.at(2);

//分别对BGR通道做直方图均衡化

equalizeHist(blue, blue);

equalizeHist(green, green);

equalizeHist(red, red);

//合并通道

merge(channels, dst);

imshow(output, dst);

waitKey(0);

return 0;

}

3.2 直方图计算与绘制

OpenCV里面的直方图计算的API:

split(// 把多通道图像分为多个单通道图像

const Mat &src, //输入图像

Mat* mvbegin)// 输出的通道图像数组

calcHist(

const Mat* images,//输入图像指针

int images,// 图像数目

const int* channels,// 通道数

InputArray mask,// 输入mask,可选,不用

OutputArray hist,//输出的直方图数据

int dims,// 维数

const int* histsize,// 直方图级数

const float* ranges,// 值域范围

bool uniform,// true by default

bool accumulate// false by defaut

)

对应的实例:

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace std;

using namespace cv;

int main(int argc, char** argv) {

Mat src = imread("D:/vcprojects/images/test.png");

if (!src.data) {

printf("could not load image...\n");

return -1;

}

char INPUT_T[] = "input image";

char OUTPUT_T[] = "histogram demo";

namedWindow(INPUT_T, CV_WINDOW_AUTOSIZE);

namedWindow(OUTPUT_T, CV_WINDOW_AUTOSIZE);

imshow(INPUT_T, src);

// 分通道显示

vector<Mat> bgr_planes;

split(src, bgr_planes);

//imshow("single channel demo", bgr_planes[0]);

// 计算直方图

int histSize = 256;

float range[] = { 0, 256 };

const float *histRanges = { range };

Mat b_hist, g_hist, r_hist;

calcHist(&bgr_planes[0], 1, 0, Mat(), b_hist, 1, &histSize, &histRanges, true, false);

calcHist(&bgr_planes[1], 1, 0, Mat(), g_hist, 1, &histSize, &histRanges, true, false);

calcHist(&bgr_planes[2], 1, 0, Mat(), r_hist, 1, &histSize, &histRanges, true, false);

// 归一化

int hist_h = 400;

int hist_w = 512;

int bin_w = hist_w / histSize;

Mat histImage(hist_w, hist_h, CV_8UC3, Scalar(0, 0, 0));

normalize(b_hist, b_hist, 0, hist_h, NORM_MINMAX, -1, Mat());

normalize(g_hist, g_hist, 0, hist_h, NORM_MINMAX, -1, Mat());

normalize(r_hist, r_hist, 0, hist_h, NORM_MINMAX, -1, Mat());

// render histogram chart

for (int i = 1; i < histSize; i++) {

line(histImage, Point((i - 1)*bin_w, hist_h - cvRound(b_hist.at<float>(i - 1))),

Point((i)*bin_w, hist_h - cvRound(b_hist.at<float>(i))), Scalar(255, 0, 0), 2, LINE_AA);

line(histImage, Point((i - 1)*bin_w, hist_h - cvRound(g_hist.at<float>(i - 1))),

Point((i)*bin_w, hist_h - cvRound(g_hist.at<float>(i))), Scalar(0, 255, 0), 2, LINE_AA);

line(histImage, Point((i - 1)*bin_w, hist_h - cvRound(r_hist.at<float>(i - 1))),

Point((i)*bin_w, hist_h - cvRound(r_hist.at<float>(i))), Scalar(0, 0, 255), 2, LINE_AA);

}

imshow(OUTPUT_T, histImage);

waitKey(0);

return 0;

}

3.3 直方图比较

3.3.1直方图比较概述

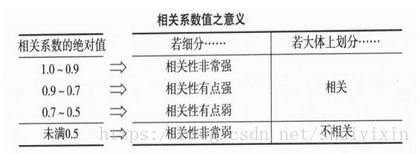

对输入的两张图像计算得到直方图H1与H2,归一化到相同的尺度空间

然后可以通过计算H1与H2的之间的距离得到两个直方图的相似程度进

而比较图像本身的相似程度。

3.3.2直方图比较应用

(1)图像相似度比较

如果我们有两张图像,并且这两张图像的直方图一样,或者有极高的相似度,那么在一定程度上,我们可以认为这两幅图是一样的,这就是直方图比较的应用之一。

(2)分析图像之间关系

两张图像的直方图反映了该图像像素的分布情况,可以利用图像的直方图,来分析两张图像的关系。

3.3.3直方图比较方法

1)相关性比较(Correlation)

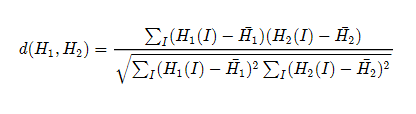

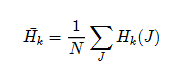

相关性比较公式如下:

其中,

其中N是直方图的BIN个数。

如果H1 = H2,即两个图的直方图一样,分子等于分母,值为1,所以在不严格的情况下,当值为1时,可以认为两个图是一样的。但是也有可能会出现两个图不一样,但是两个图的直方图是一样的情况。因为直方图计算的是像素点个数的分布情况,但是不会显示像素点的位置,所以有可能会出现两幅图片不一样,但是相同像素的个数完全一样,那他们的直方图也是一样的,不过这种情况,不常有。

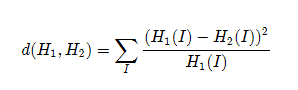

2)卡方比较(Chi-Square)

卡方公式如下:

H1,H2分别表示两个图像的直方图数据。

通过这个公式我们能够发现,卡方比较和相关性比较恰恰相反,相关性比较的值为0,相似度最低,越趋近于1,相似度高;卡方比较则相反,值为0时,说明H1= H2,这个时候相似度最高。

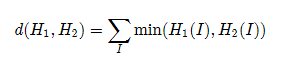

3)十字交叉性(Intersection)

十字交叉性公式如下:

H1,H2分别表示两个图像的直方图数据。

这个就比较简单了,对比H1,H2并求出最小值,最后求和。但是这个效果不好,不易根据计算得到的值判断两张图片的直方图是否相似。

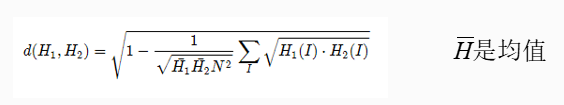

4)巴氏距离(Bhattacharyya distance)

巴氏距离公式如下:

H1,H2分别表示两个图像的直方图数据。

在直方图相似度计算时,巴氏距离获得的效果最好,但计算是最为复杂的。巴氏距离的计算结果,其值完全匹配为1,完全不匹配则为0。

3.3.4函数使用步骤

1)首先把图像从RGB色彩空间转换到HSV色彩空间cvtColor

2)计算图像的直方图,然后归一化到[0~1]之间calcHist和normalize;

3)使用上述四种比较方法之一进行比较compareHist

相应的API:

compareHist(

InputArray h1, // 直方图数据,下同

InputArray H2,

int method// 比较方法,上述四种方法之一

)

综合示例:

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace std;

using namespace cv;

string convertToString(double d);

int main(int argc, char** argv) {

Mat base, test1, test2;

Mat hsvbase, hsvtest1, hsvtest2;

base = imread("D:/vcprojects/images/test.jpg");

if (!base.data) {

printf("could not load image...\n");

return -1;

}

test1 = imread("D:/vcprojects/images/lena.png");

test2 = imread("D:/vcprojects/images/lenanoise.png");

cvtColor(base, hsvbase, CV_BGR2HSV);

cvtColor(test1, hsvtest1, CV_BGR2HSV);

cvtColor(test2, hsvtest2, CV_BGR2HSV);

int h_bins = 50; int s_bins = 60;

int histSize[] = { h_bins, s_bins };

// hue varies from 0 to 179, saturation from 0 to 255

float h_ranges[] = { 0, 180 };

float s_ranges[] = { 0, 256 };

const float* ranges[] = { h_ranges, s_ranges };

// Use the o-th and 1-st channels

int channels[] = { 0, 1 };

MatND hist_base;

MatND hist_test1;

MatND hist_test2;

calcHist(&hsvbase, 1, channels, Mat(), hist_base, 2, histSize, ranges, true, false);

normalize(hist_base, hist_base, 0, 1, NORM_MINMAX, -1, Mat());

calcHist(&hsvtest1, 1, channels, Mat(), hist_test1, 2, histSize, ranges, true, false);

normalize(hist_test1, hist_test1, 0, 1, NORM_MINMAX, -1, Mat());

calcHist(&hsvtest2, 1, channels, Mat(), hist_test2, 2, histSize, ranges, true, false);

normalize(hist_test2, hist_test2, 0, 1, NORM_MINMAX, -1, Mat());

double basebase = compareHist(hist_base, hist_base, CV_COMP_INTERSECT);

double basetest1 = compareHist(hist_base, hist_test1, CV_COMP_INTERSECT);

double basetest2 = compareHist(hist_base, hist_test2, CV_COMP_INTERSECT);

double tes1test2 = compareHist(hist_test1, hist_test2, CV_COMP_INTERSECT);

printf("test1 compare with test2 correlation value :%f", tes1test2);

Mat test12;

test2.copyTo(test12);

putText(base, convertToString(basebase), Point(50, 50), CV_FONT_HERSHEY_COMPLEX, 1, Scalar(0, 0, 255), 2, LINE_AA);

putText(test1, convertToString(basetest1), Point(50, 50), CV_FONT_HERSHEY_COMPLEX, 1, Scalar(0, 0, 255), 2, LINE_AA);

putText(test2, convertToString(basetest2), Point(50, 50), CV_FONT_HERSHEY_COMPLEX, 1, Scalar(0, 0, 255), 2, LINE_AA);

putText(test12, convertToString(tes1test2), Point(50, 50), CV_FONT_HERSHEY_COMPLEX, 1, Scalar(0, 0, 255), 2, LINE_AA);

namedWindow("base", CV_WINDOW_AUTOSIZE);

namedWindow("test1", CV_WINDOW_AUTOSIZE);

namedWindow("test2", CV_WINDOW_AUTOSIZE);

imshow("base", base);

imshow("test1", test1);

imshow("test2", test2);

imshow("test12", test12);

waitKey(0);

return 0;

}

string convertToString(double d) {

ostringstream os;

if (os << d)

return os.str();

return "invalid conversion";

}

3.4直方图反向投影(Back Projection)

3.4.1直方图反向投影概论

opencv docs给出的概念是“一种记录给定图像中的像素点如何适应直方图模型像素分布的方式”。简单的讲, 所谓反向投影就是首先计算某一特征的直方图模型,然后使用模型去寻找图像中存在的该特征。通常用HSV色彩空间的HS两个通道直方图模型

3.4.2反向投影应用

目标检测:

一幅图像的反向投影利用了其原始图像(或目标区域)的直方图,将该直方图作为一张查找表来找对应像素点的像素值,即将目标图像像素点的值设置为原始图像(或目标区域)直方图上对应的bin值。该bin值代表了(目标区域)上该像素值出现的概率。从而得到一幅图像的概率值。从而我们可以通过这幅概率图可以得知在这幅图像中,目标出现可能出现的位置。

3.4.3实现步骤与相应的API

1.建立直方图模型

2.计算待测图像直方图并映射到模型中

3.从模型反向计算生成图像

//1.函数原型

void cv::calcBackProject(

const Mat * images,

int nimages,

const int * channels,

InputArray hist,

OutputArray backProject,

const float ** ranges,

double scale = 1,

bool uniform = true

)

//2.参数解释

//const Mat* images:输入图像,图像深度必须位CV_8U, CV_16U或CV_32F中的一种,尺寸相同,每一幅图像都可以有任意的通道数

//int nimages : 输入图像的数量

//const int* channels : 用于计算反向投影的通道列表,通道数必须与直方图维度相匹配,第一个数组的通道是从0到image[0].channels() - 1, 第二个数组通道从图像image[0].channels()到image[0].channels() + image[1].channels() - 1计数

//InputArray hist : 输入的直方图,直方图的bin可以是密集(dense)或稀疏(sparse)

//OutputArray backProject : 目标反向投影输出图像,是一个单通道图像,与原图像有相同的尺寸和深度

//const float ranges** : 直方图中每个维度bin的取值范围

//double scale = 1 : 可选输出反向投影的比例因子

//bool uniform = true : 直方图是否均匀分布(uniform)的标识符,有默认值true

//另外两种定义

void cv::calcBackProject(

const Mat * images,

int nimages,

const int * channels,

const SparseMat & hist,

OutputArray backProject,

const float ** ranges,

double scale = 1,

bool uniform = true

)

void cv::calcBackProject(

InputArrayOfArrays images,

const std::vector< int > & channels,

InputArray hist,

OutputArray dst,

const std::vector< float > & ranges,

double scale

)

参数解释

const Mat* images:输入图像,图像深度必须位CV_8U, CV_16U或CV_32F中的一种,尺寸相同,每一幅图像都可以有任意的通道数

int nimages : 输入图像的数量

const int* channels : 用于计算反向投影的通道列表,通道数必须与直方图维度相匹配,第一个数组的通道是从0到image[0].channels() - 1, 第二个数组通道从图像image[0].channels()到image[0].channels() + image[1].channels() - 1计数

InputArray hist : 输入的直方图,直方图的bin可以是密集(dense)或稀疏(sparse)

OutputArray backProject : 目标反向投影输出图像,是一个单通道图像,与原图像有相同的尺寸和深度

const float ranges** : 直方图中每个维度bin的取值范围

double scale = 1 : 可选输出反向投影的比例因子

bool uniform = true : 直方图是否均匀分布(uniform)的标识符,有默认值true

//1.函数功能:从输入图像中拷贝某通道到输出图像中特定的通道。

//2.函数原型及参数解释:

void mixChannels(

const Mat*src, //一系列输入图像的数组, 被拷贝的通道的来源一系列输入图像的数组, 被拷贝的通道的来源

size_t nsrcs, //输入图像的个数

Mat* dst, //一系列目的图像的数组, 储存拷贝的通道,所有的数组必须事先分配空间(如用create),大小和深度须与输入数组等同。

size_t ndsts, //目的数组中图像的数目

const int* fromTo, //通道索引对的数组,指示如何将输入图像的某一通道拷贝到目的图像的某一通道。偶数下标的用来标识输入矩阵,奇数下标的用来标识输出矩阵。如果偶数下标为负数,那么相应的输出矩阵为零矩阵。

size_t npairs //fromTo中的序号对数(两个算1对)。

);

综合示例:

1)加载图片imread;

2)将图像从RGB色彩空间转换到HSV色彩空间cvtColor;

3)计算直方图和归一化calcHist与normalize;

4) Mat与MatND其中Mat表示二维数组,MatND表示三维或者多维数据,此处均可以用Mat表示;

5)计算反向投影图像 - calcBackProject。

#include <opencv2/opencv.hpp>

#include <iostream>

#include <math.h>

using namespace std;

using namespace cv;

Mat src; Mat hsv; Mat hue;

int bins = 12;

void Hist_And_Backprojection(int, void*);

int main(int argc, char** argv) {

src = imread("D:/vcprojects/images/t1.jpg");

if (src.empty()) {

printf("could not load image...\n");

return -1;

}

const char* window_image = "input image";

namedWindow(window_image, CV_WINDOW_NORMAL);

namedWindow("BackProj", CV_WINDOW_NORMAL);

namedWindow("Histogram", CV_WINDOW_NORMAL);

cvtColor(src, hsv, CV_BGR2HSV);

hue.create(hsv.size(), hsv.depth());

int nchannels[] = { 0, 0 };

mixChannels(&hsv, 1, &hue, 1, nchannels, 1);

createTrackbar("Histogram Bins:", window_image, &bins, 180, Hist_And_Backprojection);

Hist_And_Backprojection(0, 0);

imshow(window_image, src);

waitKey(0);

return 0;

}

void Hist_And_Backprojection(int, void*) {

float range[] = { 0, 180 };

const float *histRanges = { range };

Mat h_hist;

calcHist(&hue, 1, 0, Mat(), h_hist, 1, &bins, &histRanges, true, false);

normalize(h_hist, h_hist, 0, 255, NORM_MINMAX, -1, Mat());

Mat backPrjImage;

calcBackProject(&hue, 1, 0, h_hist, backPrjImage, &histRanges, 1, true);

imshow("BackProj", backPrjImage);

int hist_h = 400;

int hist_w = 400;

Mat histImage(hist_w, hist_h, CV_8UC3, Scalar(0, 0, 0));

int bin_w = (hist_w / bins);

for (int i = 1; i < bins; i++) {

rectangle(histImage,

Point((i - 1)*bin_w, (hist_h - cvRound(h_hist.at<float>(i - 1) * (400 / 255)))),

//Point(i*bin_w, (hist_h - cvRound(h_hist.at<float>(i) * (400 / 255)))),

Point(i*bin_w, hist_h),

Scalar(0, 0, 255), -1);

}

imshow("Histogram", histImage);

return;

}