一、HA-HDFS

1.1 HA的核心

HA(high avalibility):高可用

Hadoop集群有HDFS和YARN!Hadoop的HA指HDFS和YARN必须保证可用性强(不能轻易故障,保持24h可用)!

以HDFS为例:

必须进程:Namenode(1个)

Danonode(N个)

可选进程: SecondaryNamenode(1个)

HA的核心: 保证Namenode和RecourceManager不能故障或在故障后可以快速容灾恢复!

1.2 HA的实现(以HDFS为例)

- 为了避免Namenode的单点故障,可以启动

多个Namenode! - 保证多个Namenode进程元数据必须同步

元数据: fsimage。

Namenode在格式化时,会生成空白的fsimage文件,此时让Namenode将格式化的Namenode的fsimage文件拷贝即可!

edits:Namenode讲edits文件发送给Journalnode,其他的Namnoede自己从Journalnode同步edits文件!

注意:

- a)journalnode进程采用paxos协议设计,适合运行在奇数台机器!

- b)如果要实现HA,至少要启动3台Journalnode!

- c)如果启动了Journalnode,那么没有必要,也不能再启动 SecondaryNamenode

- 当启动了多个Namenode时,只能选择其中的一个作为active状态的NN

其余的Namenode都只能作为standby状态 采用状态是为了标识哪个namenode是正在工作的,可以为客户端提供服务的NN,只有active状态的

NN可以接收客户端请求!

原则: 不能出现脑裂现象(不能同时出现两个active状态的namenode)

为什么要格式化?

格式化是为了:

- ①生成Namenode工作的目录(存放元数据)

- ②格式化是为了生成fsimage文件,每次NN启动都会先读取fsimage中的元数据

- ③为了生成Namenode的id和clusterId,所有的 Datanode在启动是都会根据clusterId向Namenode上报

1.3 HDFS-HA的搭建

- 安装zookeeper

- 配置ssh

- /opt/module/ha/hadoop-2.7.2

- 配置hadoop-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

- 配置core-site.xml

<configuration>

<!-- 把两个NameNode)的地址组装成一个集群mycluster -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://mycluster</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/ha/hadoop-2.7.2/data/tmp</value>

</property>

</configuration>

- 配置hdfs-site.xml

<configuration>

<!-- 完全分布式集群名称 -->

<property>

<name>dfs.nameservices</name>

<value>mycluster</value>

</property>

<!-- 集群中NameNode节点都有哪些 -->

<property>

<name>dfs.ha.namenodes.mycluster</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn1</name>

<value>hadoop102:9000</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.mycluster.nn2</name>

<value>hadoop103:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn1</name>

<value>hadoop102:50070</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.mycluster.nn2</name>

<value>hadoop103:50070</value>

</property>

<!-- 指定NameNode元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hadoop102:8485;hadoop103:8485;hadoop104:8485/mycluster</value>

</property>

<!-- 配置隔离机制,即同一时刻只能有一台服务器对外响应 -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<!-- 使用隔离机制时需要ssh无秘钥登录-->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/home/atguigu/.ssh/id_rsa</value>

</property>

<!-- 声明journalnode服务器存储目录-->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/opt/ha/hadoop-2.7.2/data/jn</value>

</property>

<!-- 关闭权限检查-->

<property>

<name>dfs.permissions.enable</name>

<value>false</value>

</property>

<!-- 访问代理类:client,mycluster,active配置失败自动切换实现方式-->

<property>

<name>dfs.client.failover.proxy.provider.mycluster</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

</configuration>

- 分发 hdfs-site.xml 、core-site.xml 到其他节点

- 在所有节点上执行 ,启动journalnode服务

sbin/hadoop-daemon.sh start journalnode - 在[nn1]上,对其进行格式化,并启动

bin/hdfs namenode -format

sbin/hadoop-daemon.sh start namenode - 在[nn2]上,同步nn1的元数据信息

bin/hdfs namenode -bootstrapStandby - 启动[nn2]

sbin/hadoop-daemon.sh start namenode - 查看web页面

- 在[nn1]上,启动所有datanode

sbin/hadoop-daemons.sh start datanode - 将[nn1]切换为Active

bin/hdfs haadmin -transitionToActive nn1 - 查看是否Active

bin/hdfs haadmin -getServiceState nn1

1.4 配置HDFS-HA自动故障转移

①借助zookeeper集群

②一般采用ssh fence,需要配置两台Namenode所运行机器的ssh互相联通

- 在hdfs-site.xml中增加

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

- 在core-site.xml文件中增加

<property>

<name>ha.zookeeper.quorum</name>

<value>hadoop102:2181,hadoop103:2181,hadoop104:2181</value>

</property>

3. 启动

- (1)关闭所有HDFS服务:

sbin/stop-dfs.sh - 2)启动Zookeeper集群:

bin/zkServer.sh start - (3)初始化HA[nn1]在Zookeeper中状态:

bin/hdfs zkfc -formatZK - (4)启动HDFS服务:

sbin/start-dfs.sh

- 验证

(1)将Active NameNode进程kill

kill -9 namenode的进程id

(2)将Active NameNode机器断开网络

service network stop

二、YARN-HA

- 具体配置 yarn-site.xml

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!--启用resourcemanager ha-->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!--声明两台resourcemanager的地址-->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>cluster-yarn1</value>

</property>

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>hadoop102</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>hadoop103</value>

</property>

<!--指定zookeeper集群的地址-->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>hadoop102:2181,hadoop103:2181,hadoop104:2181</value>

</property>

<!--启用自动恢复-->

<property>

<name>yarn.resourcemanager.recovery.enabled</name>

<value>true</value>

</property>

<!--指定resourcemanager的状态信息存储在zookeeper集群-->

<property>

<name>yarn.resourcemanager.store.class</name> <value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value>

</property>

</configuration>

- 分发yarn-site.xml到其他节点

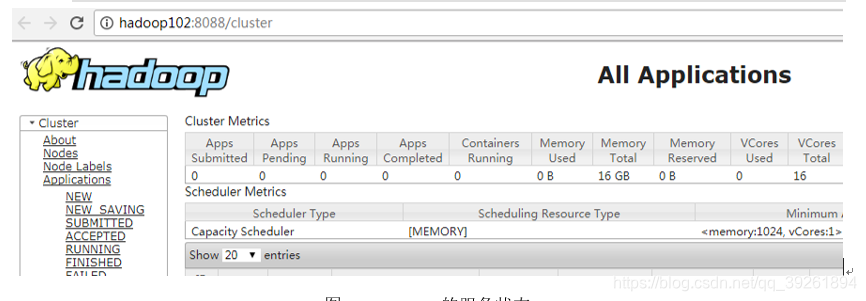

2.1 启动YARN

- 在hadoop102中执行

sbin/start-yarn.sh - 在hadoop103中执行:

sbin/yarn-daemon.sh start resourcemanager - 查看服务状态

bin/yarn rmadmin -getServiceState rm1