requests安装与实战

本博客之前,需要有 正则表达式和 浏览器伪装相关的知识,如果不了解请先点击左方蓝字查看。

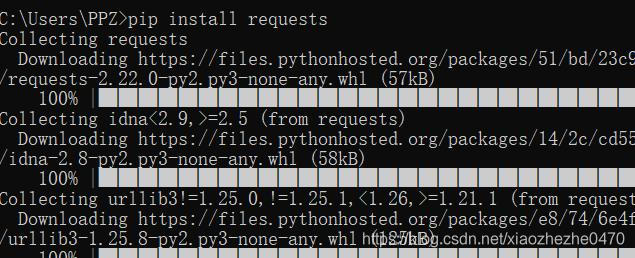

requests安装

windows下安装,首先win+r,输入cmd,进入命令行下,输入语句pip install requests耐心等候即可。

linux下安装直接输入语句pip install requests耐心等候即可。

requests基础讲解

requests请求方式

requests请求方式主要有三种:get、post、put…

requests请求使用方法:

import requests

#get请求

res = requests.get("https://yq.aliyun.com/search/articles/")

#post请求

res = requests.post("链接")

//返回结果:网页源代码

requests参数表1

| 参数 | 参数的含义 |

|---|---|

| text | 获取响应数据 |

| content | 获取响应数据二进制格式 |

| encoding | 获取网页编码 |

| url | 获取当前请求的url |

| status_code | 获取当前状态码 |

| cookies | 获取cookies |

requests参数使用方法:

import requests

#get请求

res = requests.get("https://yq.aliyun.com/search/articles/")

print(res.text)

//返回结果:"<!DOCTYPE html>······</html>"即源文件

print(res.content)

//返回结果:这咋说勒,就是上面文件的文字变成二进制格式了嘿嘿,如"\xe6\x90\x9……"

print(res.encoding)

//返回结果:"utf-8"

print(res.url)

//返回结果:"https://yq.aliyun.com/search/articles/"

print(res.status_code)

//返回结果:200#如果请求错了就会有什么404、505之类的

print(res.cookies)

//返回结果:"<Requests···n.com/>]>"就是你的cookies值

requests参数表2

| 参数 | 参数的意义 |

|---|---|

| params | get请求的参数 |

| header | 头信息,伪装浏览器 |

| proxies | 添加代理,添加代理ip |

| cookies | 保存cookies |

| data | 存储post请求数据 |

requests参数使用方法:

如果下面没看懂点击这里:讲解相关浏览器伪装的爬虫知识

import requests

//params用法#get请求的参数

getdata = {

"q":key,

"p":str(i + 1)

}

requests.get(url,params=getdata)

//headers用法#这里就是将headers伪装成浏览器

UA=("User-Agent","Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.132 Safari/537.36")

requests.get("https://yq.aliyun.com/search/articles/",headers=UA)

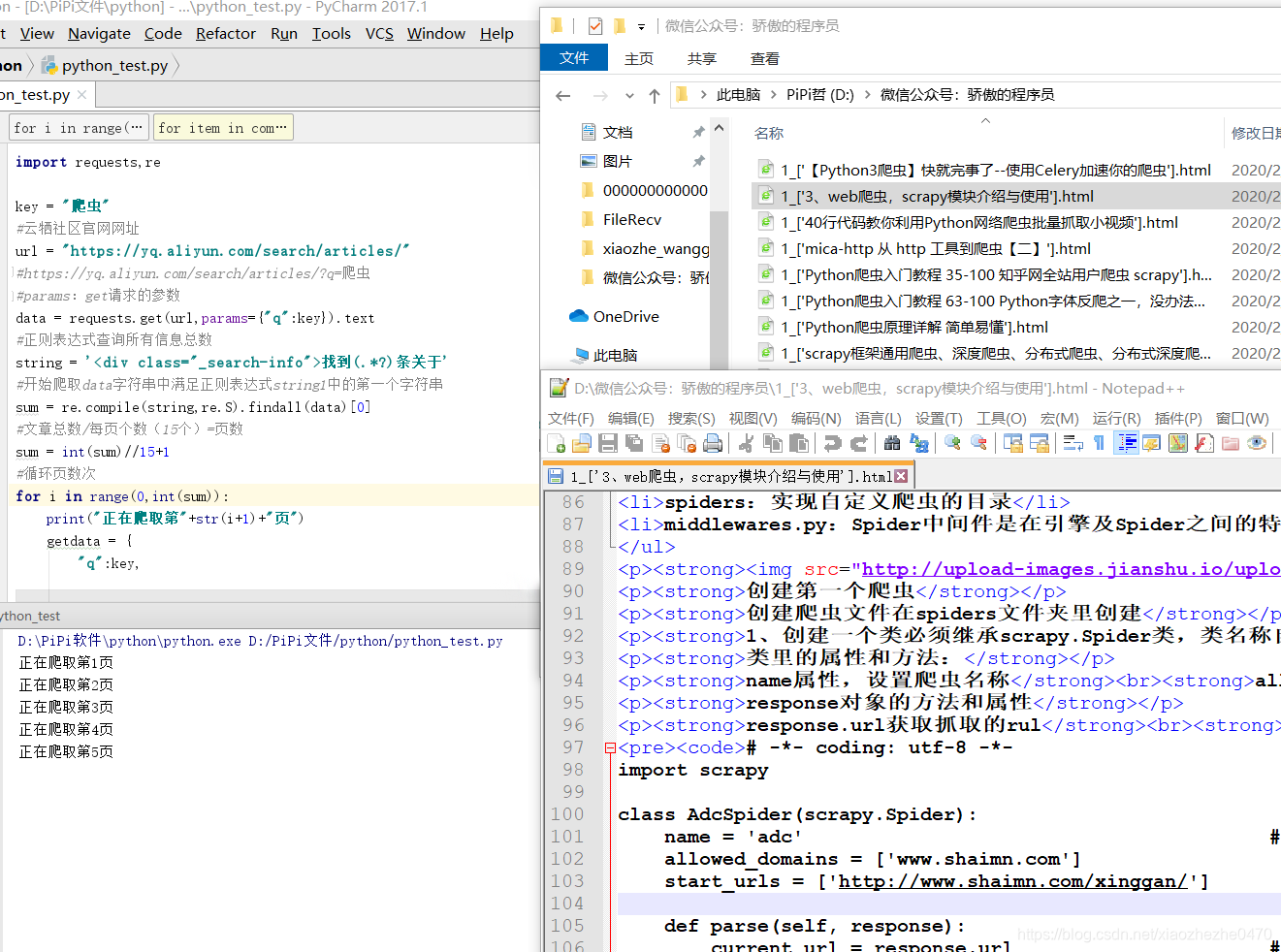

requests实战源码领取

看完本博客如果感觉有点似懂非懂,本人建议做一下requests的相关实战项目,这里有一款爬取某社区所有论文的项目源代码,欢迎大家领取!

微信公众号“骄傲的程序员”回复“爬虫129”领取源代码,更多学习视频等着你哦~