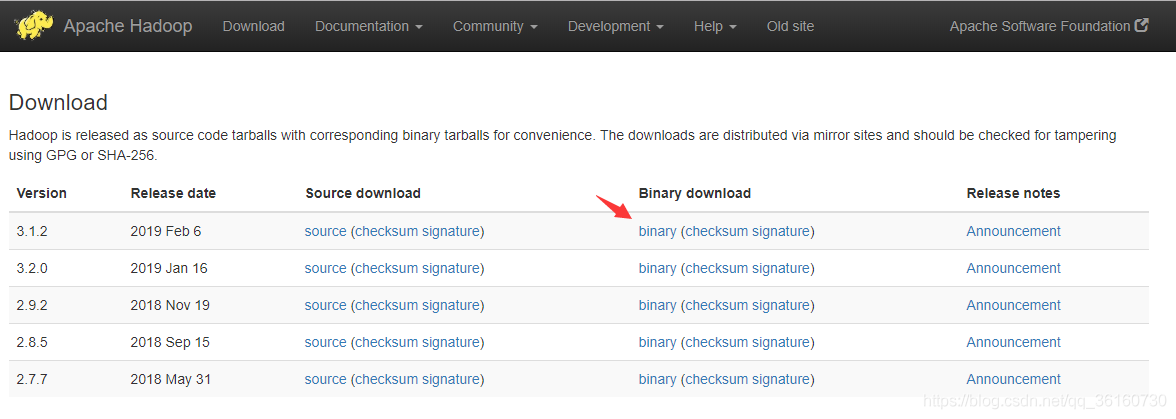

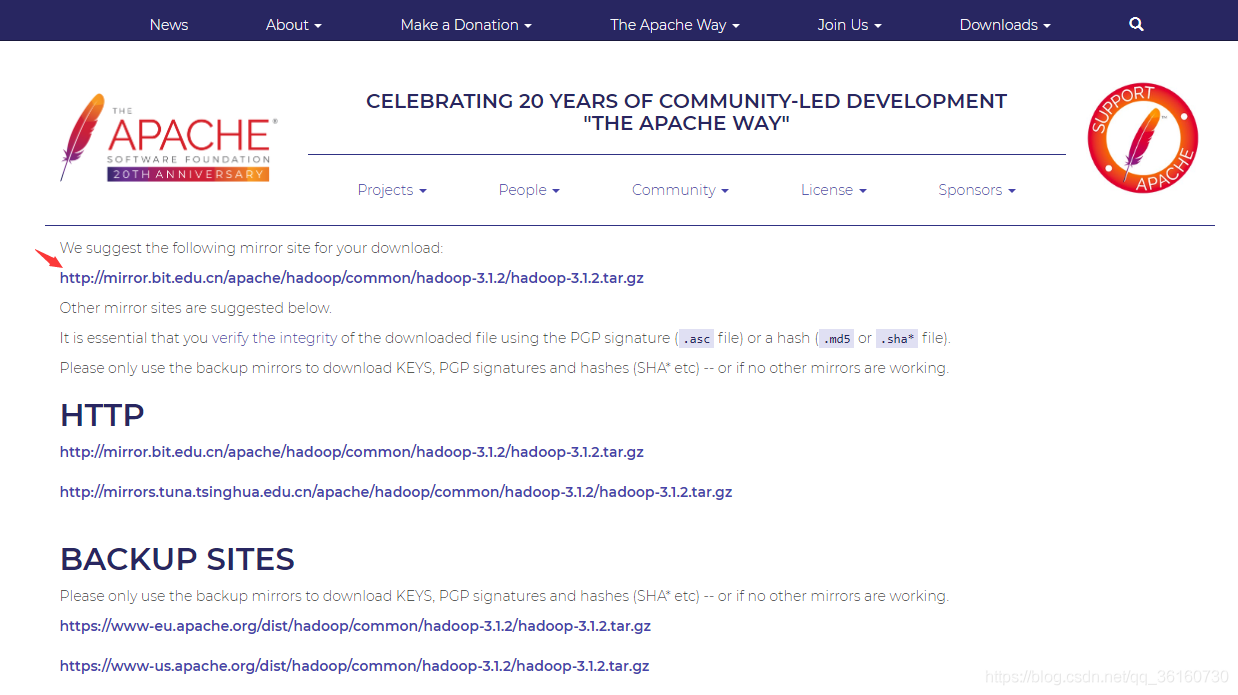

1. 下载

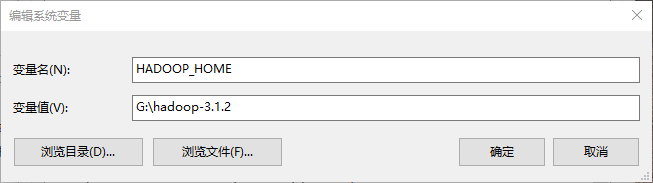

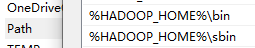

2. 解压与配置

以管理员身份解压

添加环境变量

用户变量path添加

修改 etc/Hadoop/Hadoop-env.cmd,配置JAVA_HOME地址,路径不能有空格

JAVA_HOME=G:\Java\jdk1.8.0_181

修改 etc/hadoop/core-site.xml

data文件夹不用先创建

hadoop.http.staticuser.user 设置和windows管理员相同的用户名比较方便

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>G:\hadoop-3.1.2\data</value>

</property>

<property>

<name>hadoop.http.staticuser.user</name>

<value>hadoop</value>

</property>

修改 etc/hadoop/hdfs-site.xml

dfs.namenode.name.dir 默认 file://${hadoop.tmp.dir}/dfs/name

dfs.datanode.data.dir 默认 file://${hadoop.tmp.dir}/dfs/data

在windows下文件路径和linux不同,所以再单独配置

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.http.address</name>

<value>localhost:9870</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>G:\hadoop-3.1.2\data\dfs\name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>G:\hadoop-3.1.2\data\dfs\data</value>

</property>

修改 etc/hadoop/mapred-site.xml,设置为yarn运行

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

修改 etc/hadoop/yarn-site.xml

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value>

</property>

替换掉原bin文件夹,根据hadoop版本下载windows上二进制文件

3. 运行

以管理员身份运行cmd,否则启动datanode会报错,权限不足

hdfs namenode -format

start-all.cmd

hdfs web http://localhost:9870

yarn web http://localhost:8088

4. 测试

在hdfs创建文件夹hdfsTest,hdfsTest下创建input,上传input.txt

以管理员身份运行cmd,在hadoop目录下运行

hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.2.jar wordcount /hdfsTest/input /hdfsTest/output