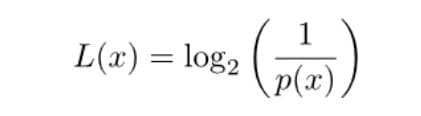

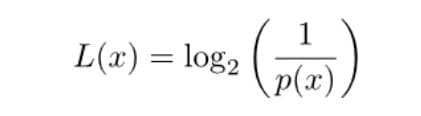

知道一堆词汇里各个字出现的概率pi,则对这些字的最优编码下各字的位长(也即每个字包含的信息)为:

香农公式: ,知道各字的位长后,可依次给他们编码0、10、110...

,知道各字的位长后,可依次给他们编码0、10、110...

这些字的平均编码长度为(也即信息量,或称信息熵):

信息熵:

总结:信息是不确定性的度量,不确定性体现在概率分布上:概率分布越散,不确定性越大,从而信息量越大

知道一堆词汇里各个字出现的概率pi,则对这些字的最优编码下各字的位长(也即每个字包含的信息)为:

香农公式: ,知道各字的位长后,可依次给他们编码0、10、110...

,知道各字的位长后,可依次给他们编码0、10、110...

这些字的平均编码长度为(也即信息量,或称信息熵):

信息熵:

总结:信息是不确定性的度量,不确定性体现在概率分布上:概率分布越散,不确定性越大,从而信息量越大