搭建环境:环境依赖的软件,均可百度找到。虚拟机的安装和JDK安装此处就不多说了,相信学习大数据的朋友都是没问题的。

| VMware | 12.5.9 |

| Centos | 7.6.1810 |

| JDK | 1.8.0_131 |

| hadoop | hadoop-2.6.0-cdh5.14.2 |

| 工具 | xshell |

linux 操作命令

hostnamectl hostname-set linux01 修改主机名

useradd hadoop 使用root创建hadoop用户

mkdir -P /soft/install -P创建多级目录

chown /soft hadoop:hadoop 修改所属用户和用户组

yum install lrzsz 安装这个插件,可以很方便的进行文件上传下载,上传只需要拖拽文件到窗口,下载使用sz 文件名

passwd hadoop 修改密码,并按提示确认密码

su hadoop 切换到hadoop 用户

cd /soft/install/

将hadoop-2.6.0-cdh5.14.2_after_compile.tar.gz 拖拽到xshell窗口,上传hadoop 安装包到虚拟机。

tar -xvf hadoop-2.6.0-cdh5.14.2_after_compile.tar.gz 解压安装包

cd hadoop-2.6.0-cdh5.14.2/etc/hadoop/

下面开始编写hadoop 配置文件

vim hadoop-env.sh

25 line export JAVA_HOME=修改为自己的jdk家目录

温馨提示:如果你的vim没有显示行号,可以,在vim 命令行状态使用:set number 来显示行号,这种方法只对当前文件生效退出后则失效,如果你想让显示行号永久生效可以在root模式下 vim /etc/vimrc 在文件末尾增加一行set nu 保存退出即可

vim hadoop-env.sh

19 line 在<configuration>标签里插入下面的配置</configuration>

<property> <name>fs.defaultFS</name> <value>hdfs://linux01:8020</value> </property> <property> <name>hadoop.tmp.dir</name> <value>soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/tempDatas</value> </property> <property> <name>io.file.buffer.size</name> <value>4096</value> </property> <!-- 检查点被删除后的分钟数。 如果为零,垃圾桶功能将被禁用。 该选项可以在服务器和客户端上配置。 如果垃圾箱被禁用服务器端,则检查客户端配置。 如果在服务器端启用垃圾箱,则会使用服务器上配置的值,并忽略客户端配置值。--> <property> <name>fs.trash.interval</name> <value>10080</value> </property> <!-- 垃圾检查点之间的分钟数。 应该小于或等于fs.trash.interval。 如果为零,则将该值设置为fs.trash.interval的值。 每次检查指针运行时, 它都会从当前创建一个新的检查点,并删除比fs.trash.interval更早创建的检查点。--> <property> <name>fs.trash.checkpoint.interval</name> <value>0</value> </property>

vim hdfs-site.xml

19 line 在<configuration>标签里插入下面的配置</configuration>

<property> <name>dfs.namenode.secondary.http-address</name> <value>linux01:50090</value> </property> <property> <name>dfs.namenode.http-address</name> <value>linux01:50070</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>file:///soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/namenodeDatas</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>file:///soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/datanodeDatas</value> </property> <property> <name>dfs.namenode.edits.dir</name> <value>file:///soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/nn/edits</value> </property> <property> <name>dfs.namenode.checkpoint.dir</name> <value>file:///soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/snn/name</value> </property> <property> <name>dfs.namenode.checkpoint.edits.dir</name> <value>file:///soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/nn/snn/edits</value> </property> <property> <name>dfs.replication</name> <value>3</value> </property> <property> <name>dfs.permissions</name> <value>false</value> </property> <property> <name>dfs.blocksize</name> <value>134217728</value> </property>

cp mapred-site.xml.template mapred-site.xml 复制一份maper-site.xml文件

vim mapred-site.xml

19 line 在<configuration>标签里插入下面的配置</configuration>

<configuration> <!--指定运行mapreduce的环境是yarn --> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> <property> <name>mapreduce.job.ubertask.enable</name> <value>true</value> </property> <property> <name>mapreduce.jobhistory.address</name> <value>linux01:10020</value> </property> <property> <name>mapreduce.jobhistory.webapp.address</name> <value>linux01:19888</value> </property> </configuration>

vim yarn-site.xml

15 line 在<configuration>标签里插入下面的配置</configuration>

<property> <name>yarn.resourcemanager.hostname</name> <value>linux01</value> </property> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <property> <name>yarn.log.server.url</name> <value>http://linux01:19888/jobhistory/logs</value> </property> <!--多长时间聚合删除一次日志 此处--> <property> <name>yarn.log-aggregation.retain-seconds</name> <value>2592000</value><!--30 day--> </property> <!--时间在几秒钟内保留用户日志。只适用于如果日志聚合是禁用的--> <property> <name>yarn.nodemanager.log.retain-seconds</name> <value>604800</value><!--7 day--> </property> <!--指定文件压缩类型用于压缩汇总日志--> <property> <name>yarn.nodemanager.log-aggregation.compression-type</name> <value>gz</value> </property> <!-- nodemanager本地文件存储目录--> <property> <name>yarn.nodemanager.local-dirs</name> <value>/kkb/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/yarn/local</value> </property> <!-- resourceManager 保存最大的任务完成个数 --> <property> <name>yarn.resourcemanager.max-completed-applications</name> <value>1000</value> </property>

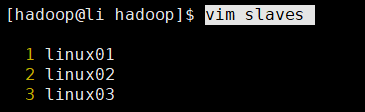

vim slaves配置数据节点, 删除里面默认的localhost,然后插入三条主机名

创建文件存放目录:

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/tempDatas

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/namenodeDatas

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/datanodeDatas

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/nn/edits

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/snn/name

mkdir -p /soft/install/hadoop-2.6.0-cdh5.14.2/hadoopDatas/dfs/nn/snn/edits

配置环境变量

切换到root模式

vim /etc/profile 添加HADOOP_HOME和PATH

HADOOP_HOME=/soft/install/hadoop-2.6.0-cdh5.14.2

PATH=$PATH:$JAVA_HOME/bin:$ZOOKEEPER/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

保存退出,并source /etc/profile

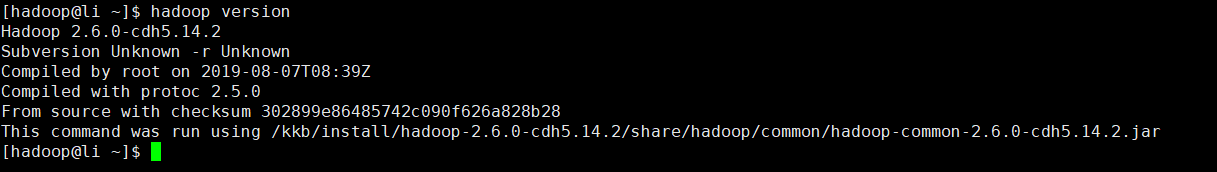

hadoop version 检查环境变量是否配置成功,出现下图所示则表示ok

接下来init 0并克隆2台虚拟主机

在vmares上右键点击linux01 >> 管理 >> 克隆 >> 虚拟机中的当前状态 >> 创建链接克隆 >> 填写虚拟机名称和存储位置 >> 点击完成

将三台虚拟主机打开,并用xshell 远程上,

hostnamectl set-hostname 主机名 新克隆的两台虚拟主机修改主机名称

cd /etc

vim hosts 将主机名和IP地址做一个映射,方便使用

scp /etc/hosts 用户名@ip地址:$PWD 将该文件远程拷贝到另外两台主机,$PWD表示将目标文件存放路径和当前用户所在的pwd路径一致

下面三台虚拟主机都需要执行以下操作

su - hadoop -表示切换到被切换用户的家目录

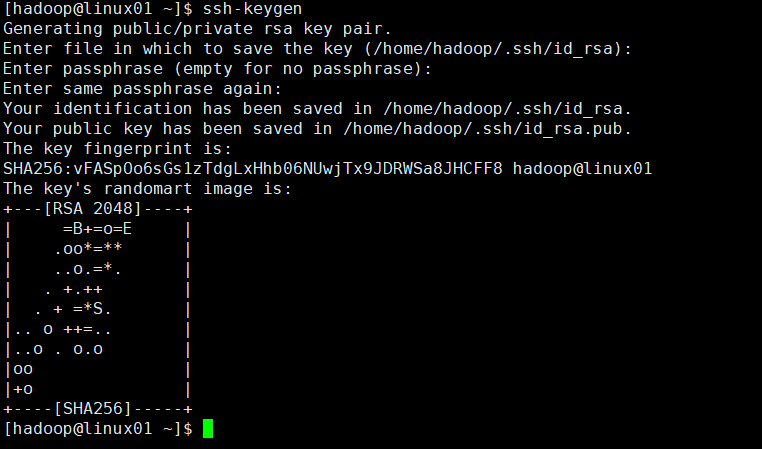

ssh-keygen 一路按回车,提示确认按 y

ssh-copy-id linux01 三台虚拟机的秘钥生成好后,都需要执行这条命令,将公钥拷贝到linux01的/home/hadoop/.ssh/authorized_keys中

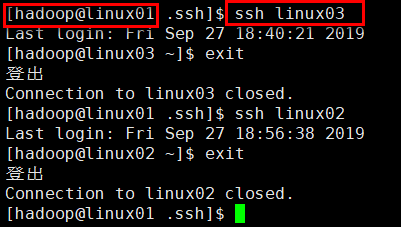

此时进入linux01

cd /home/hadoop/.ssh

scp authorized_keys hadoop@linux03:$PWD 将authorized_keys linux01 拷贝到另外两台主机

拷贝成功后,三台主机即可任意ssh,无需密码

hdfs namenode -format 格式化hadoop,只在linux01执行

接下来启动三台虚拟主机

start-all.sh

启动后执行jps命令查看java进程如下图所示

linux01 有五个进程

另外两台主机如下图所示,如果你看到的进程和图上的一致,那么恭喜你,你已成功搭建好了hadoop集群。

第一次写博客,水平有限,有错误的地方还望不吝指教,欢迎留下你的宝贵意见。谢谢