什么是回归算法

• 回归算法是一种有监督算法

• 回归算法是一种比较常用的机器学习算法,用于构建一个模型来做特征向量到标签的映射。在

算法的学习过程中,试图寻找一个模型,最大程度拟合训练数据。

• 回归算法在使用时,接收一个n维度特征向量,输出一个连续的数据值

简单小案例

输入:x 特征向量

输出:h θ (x)即预测值

在这里我们需要用到一个方法来计算出它的预估值

最小二乘法(又称最小平方法)是一种数学优化技术。它由

两部分组成:

• 一、计算所有样本误差的平均(代价函数)

• 二、使用最优化方法寻找数据的最佳函数匹配(抽象的)

• 最小二乘法是抽象的,具体的最优化方法有很多,比如正规

方程法、梯度下降法、牛顿法、拟牛顿法等等

无论选用哪种方法都不得不知道的几个相关函数:

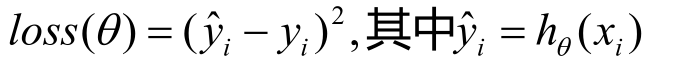

• 损失函数(Loss Function)定义在单个样本上,算的是一个样本的误差。比如:

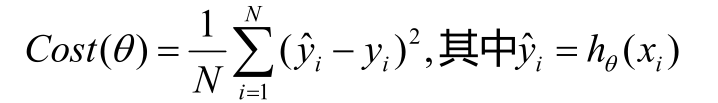

• 代价函数(Cost Function)定义在整个训练集上,是所有样本误差的平均,也就是损失函数的

平均,比如:

• 目标函数(Object Function)是最终需要优化的函数:

• 即:经验风险+正则化项(Cost Function + Regularization)

正题来了!我们通过给定数据集:

• 使用凸优化方法就能找到Cost(w,b)的极小值点,也就是反解出了w、b(相关系数)

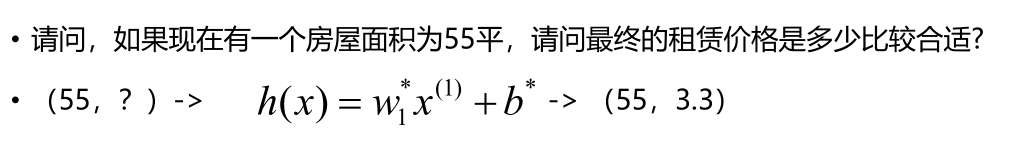

• 那么,线性模型为:h(x)=wx+b

我们用正规方程法求解w、b:

在已给定数据集中,X就是房屋面积,Y就是房屋的租赁价格,通过公式(X.TX).IX.T*Y得到模型相关系数,也就是w,b

求解出相关系数后代入假设函数公式,并将需要预测的房屋面积信息一并代入假设函数公式即可求出预估租赁价格