公司测试环境的CDH 装了spark2.3.0,正好清明节有时间来学习用python来编写spark程序

环境:

python3.6.5 用的是Anaconda3-5.2.0-Windows-x86_64中的python,主要是anaconda自带了许多python库

spark2.3.0 pip install pyspark==2.3.0 安装即可

pycharm

官方文档:

http://spark.apache.org/docs/2.3.0/rdd-programming-guide.html

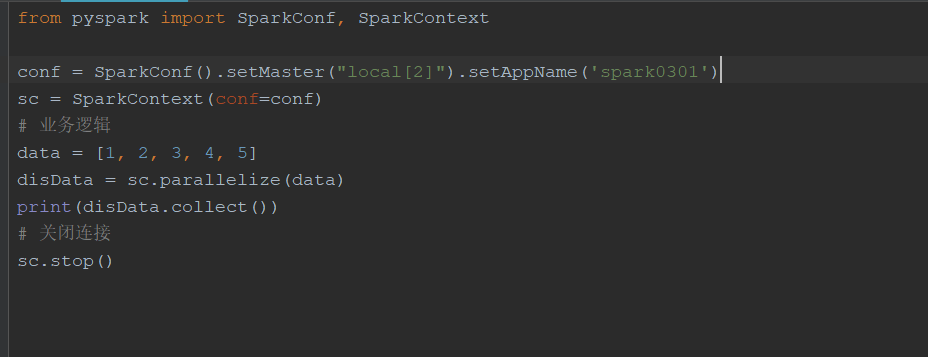

from pyspark import SparkContext, SparkConf conf = SparkConf().setAppName(appName).setMaster(master) sc = SparkContext(conf=conf)

首先,需要导入SparkContext, SparkConf

SparkConf中配置了spark应用的name,配置应用使用的运行模式(是用yarn还是mesos,或者是standalone、本地模式),官方建议的最佳实践是master不要在代码中硬编码,而是在用spark-submit 命令行提交应用的时候去指定:

./bin/spark-submit \ --class <main-class> \ --master <master-url> \ --deploy-mode <deploy-mode> \ --conf <key>=<value> \ ... # other options <application-jar> \ [application-arguments]

那么,根据官方文档,一个简单的demo如下:

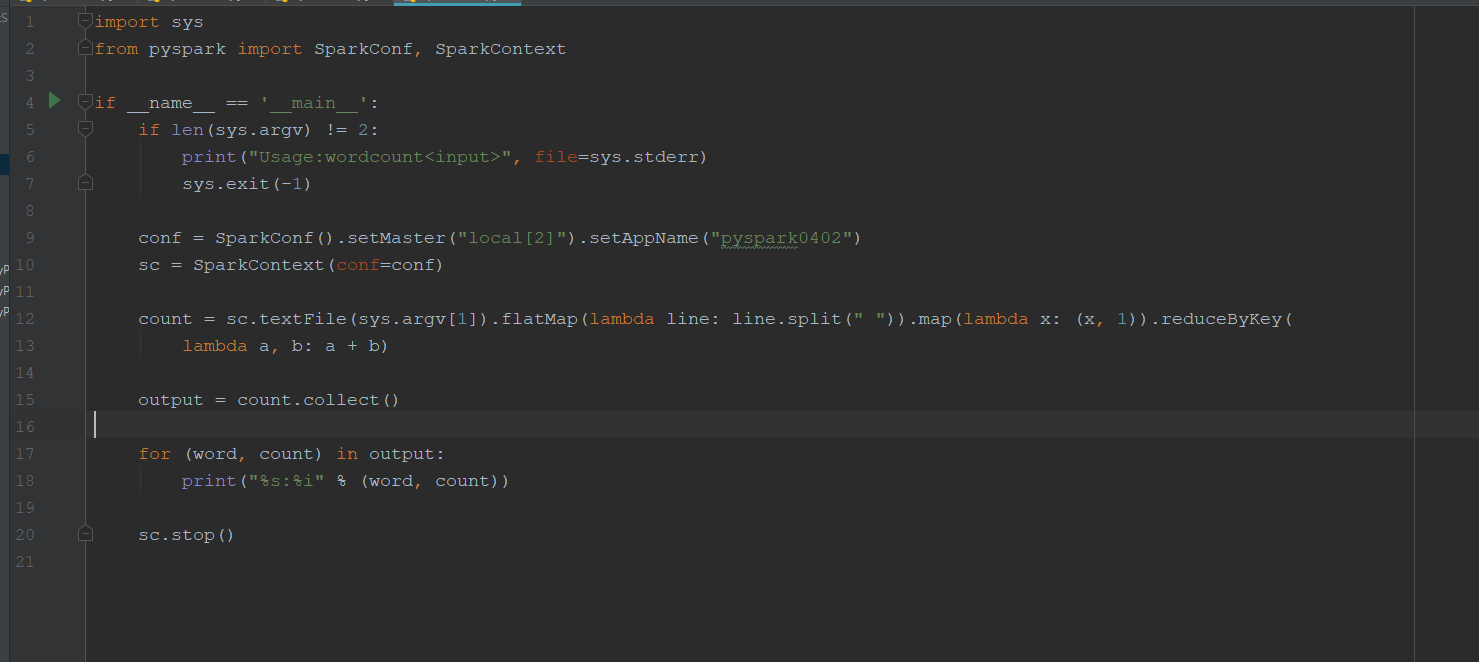

以下是wordcount 的小demo,文件使用参数的形式传入: