1,输入变量可以是数值型或分类型,输出变量也可以是数值型或分类型。如果输出为分类型,则称为分类预测模型;反之,则为回归预测模型。

2,一般拿到的数据为一个矩阵,一行对应一个观测,一列对应一个变量。一般自变量(解释变量)会有多个(x1, x2, …, xp),因变量(被解释变量)只有一个(y)。在预测过程中可以看成是发生在p+1为空间中的事件。

3,建模过程其实就在找p个x与一个y之间的关系,并将这种关系用一个模型表示出来(线性或非线性)。模型确定后,对于给定的新的p个x值,就可以预测出 。

4,对于分类预测模型,实际上是找到p维的超平面,使得位于超平面同侧的点更接近;而对于回归预测模型,也要找到一个p维的超平面,使得预测得到的值位于这个超平面上。

5,对分类预测模型的评价

ROC曲线是很好的评价方式,参考ROC曲线。

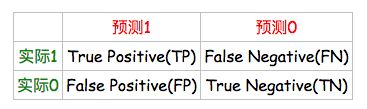

TPR(真阳性率) = TP/(TP+FN),也叫查全率、敏感性;

FPR(假阳性率) = FP/(FP+TN) = 1 - TN/(FP+TN),其中TN/(FP+TN)叫做真阴性率,又叫特异性;

查准率 = TP/(TP+FP);

由于查准率(Precision)和查全率(Recall)无法同时大,可以基于查准率和查全率的调和平均数定义F1值,F1越大预测结果越准确。

1/F1 = 1/2 * (1/Precision + 1/Recall),即

;

准确性(Accuracy) = (TP+TN)/(TP+TN+FP+FN)

6,对回归预测模型的评价

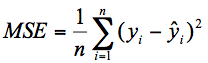

可以计算均方误差去评价回归模型:

其实在进行回归建模时,就是要找到一系列参数使得均方平方和最小。

7,统计建模、机器学习与深度学习

7.1 统计建模数据量一般小,机器学习和深度学习大;

7.2 统计建模对模型的关注度更大,先假定数据的概率分布,再选择模型,接着对参数进行估计,然后对数据进行解释;而机器学习更关注从数据到数据的预测准确性,选定好算法后,不断优化参数,使模型达到理想结果;深度学习更像是一个黑匣子,喂给它数据,它能自己学习出最佳的参数。