摘要

我们训练了一个大型的、深层的卷积神经网络,将ImageNet lsvrc-2010比赛中的120万张高分辨率图像分类为1000个不同的类别。在测试数据上,我们实现了前1位和前5位错误率分别为37.5%和17.0%,这比以前的先进水平要好得多。神经网络,有6000万个参数和65万个神经元,由五个卷积层组成,其中一些是最大池化层,三个完全连接的层,最后是1000路的Softmax。为了使训练速度更快,我们使用了非饱和神经元和一个非常有效的GPU实现卷积运算。为了减少全连接层中的过拟合,我们使用了最近开发的称为“退出”的正则化方法,它被证明是非常有效的。我们还在ILSVRC-2012比赛中加入了该模型的一个变体,并获得了15.3%的前5名的优胜率,而第二名的参赛成绩则为26.2%。

一、引言

当前的目标识别方法主要是利用机器学习方法。为了提高它们的性能,我们可以收集更大的数据集,学习更强大的模型,并使用更好的技术来防止过拟合的发生。直到最近,标记图像的数据集还相对较小-大约有数万幅图像(例如Norb[16]、Caltech-101/256[8,9]和CIFAR-10/100[12])。使用这种大小的数据集可以很好地解决简单的识别任务,特别是如果它们是通过保留标签的转换来增强的话。例如,mnist数字识别任务上当前的最佳错误率(<0.3%)接近人类性能[4]。但是现实环境中的物体具有很大的可变性,因此要学会识别它们,就必须使用更大的训练集。事实上,小图像数据集的缺点已经被广泛地认识到(例如,针叶顶叶[21]),但最近却有可能收集数百万张图像的标记数据集。新的更大的数据集包括Labelme[23]和ImageNet[6],前者包括几十万张完整分割的图像,后者包含超过1500万幅标记为高分辨率的图像,涉及22000多个类别。

为了从数百万张图像中学习数千个物体,我们需要一个具有很大学习能力的模型。然而,目标识别任务的巨大复杂性意味着,即使是像ImageNet这样大的数据集,也无法对这个问题进行规范的处理,因此我们的模型还应该有大量的先验知识来补偿我们没有的所有数据。卷积神经网络(细胞神经网络)构成这类模型[16,11,13,18,15,22 ,26]。它们的容量可以由它们的深度宽度,关于图像的性质andtheyalsomakestrongandmostlycorrectassumptions(即统计数据的平稳性和像素依赖的局部性)来控制。因此,与具有相似尺寸层的标准前馈神经网络相比,CNN具有muchfewerconnectionsandparametersandsotheyareeasiertotrain,而理论上它们的最佳性能可能只是稍微差一些。

尽管如此,anddespitetherelativeef音响ciencyoftheirlocalarchitecture,在大规模应用于高分辨率图像上仍然是非常昂贵的。幸运的是,当前的GPU与高度优化的二维卷积实现结合在一起,它的强大功能足以促进大型CNN的训练,而且最近的数据集(如ImageNet)包含了足够多的标记示例来训练这样的模型,而没有严重的过拟合。

本文的特殊贡献如下:我们在ILSVRC-2010和ILSVRC-2012竞赛[2]中使用的ImageNet子集上训练了迄今为止最大的卷积神经网络之一,并取得了迄今为止在这些数据集上所报道的最好的结果。我们编写了一个高度优化的GPU实现的2d卷积和所有其他操作固有的训练卷积神经网络,并公之于众。我们的网络包含了许多新的和不寻常的功能,这些特性提高了它的性能,减少了它的训练时间。thesizeofournetworkmadeoverfittingasignificantproblem,甚至有120万个标记的训练示例,所以我们使用了几种有效的技术来防止过拟合的发生,这在第4节中已经描述过了。我们的convolutionallayer(eachofwhichcontainsnomorethan1%ofthemodel’sparameters)resultedin nal网络包含5个卷积层和三个全连接层,这个深度似乎很重要:我们发现删除任何一层都会出现糟糕的结果。

最后,网络大小主要受到当前gpu上可用的大量内存的限制,并且限制在了我们愿意容忍的训练时间。我们的网络需要在两个GTX 580,3GB的GPU上训练5到6天。我们所有的实验都表明,只要有更快的GPU和更大的数据集可支持,我们的结果就可以得到改善。

二、数据集

ImageNet是一个拥有1500万多个标签的高分辨率图像的数据集,有大约22000个类别。这些图片是从网络上收集的,并由人类贴上标签,使用的是亚马逊(Amazon)的TURK机械式人群搜索工具。从2010年开始,作为Pascal视觉对象挑战的一部分,每年举行一次名为ImageNet大规模视觉识别挑战(ILSVRC)的竞赛。ILSVRC使用ImageNet的子集,每个类别中有大约1000幅图像。总共大约有120万张训练图像、5万张验证图像和15万张测试图像。

LSVRC-2010是唯一可用测试集标签的ILSVRC版本,因此这是我们进行大部分实验的版本。由于我们也进入了我们的模型在ILSVRC-2012竞赛,在第6节我们报告我们的结果在这个版本的数据集以及测试集标签是不可用的。在ImageNet上,通常报告两个错误率:top-1和top-5,其中前5错误率是测试图像的一部分,而正确的标签不在模型认为最可能的五个标签中。

ImageNet由可变分辨率的图像组成,而我们的系统需要恒定的输入维度。因此,我们对图像进行了下采样,得到了256×256固定分辨率。给定一个矩形图像,我们将图像重新定标,使较短的边长为256,然后从生成的图像中裁剪出中心256×256。除了从每个像素减去训练集上的平均活动外,我们没有以任何其他方式对图像进行预处理。因此,我们将我们的网络训练为像素的(中心)原始RGB值。

三、体系结构

图2总结了我们网络的体系结构。它包含八个层:五个卷积层和三个全连接层。下面,我们将描述我们网络架构中的一些新颖或不寻常的特性。第3.1-3.4节根据我们对其重要性的估计进行排序,其中最重要的是第一节。

3.1 Relu 非线性

将神经元输出作为输入x的函数建模的标准方法是

或

。在梯度下降训练时间上,这些饱和非线性比非饱和非线性

要慢得多。继Nair和Hinton[20]之后,我们将具有这种非线性的神经元称为rectified线性单元(Relus)。带RELUS的深层卷积神经网络的训练速度比它们与tanh单元的等价神经网络快几倍。图1演示了这一点,图1显示了在CIFAR-10数据集上达到特定四层卷积网络的25%训练错误所需的迭代次数。这幅图表明,如果我们使用传统的饱和神经元模型,我们就不能用这么大的神经网络进行实验。

图1:四层卷积神经网络与RELUS(实线)在CIFAR上达到25%的训练错误率-10倍于一个等效的TANA神经元网络(虚线)。每个网络的学习率是独立选择的,以使训练尽可能快。没有采用任何形式的正规化。这里显示的效果的大小因网络结构而异,但具有relus的网络的学习速度总是比具有饱和神经元的等效网络快几倍。

我们并不是第一个在CNN中考虑替代传统神经元模型的人。例如,Jarrett等人。[11]声称非线性特别适用于它们的对比归一化类型,然后在Caltech-101数据集上进行局部平均池化。然而,在这个数据集上,主要关注的是防止过度拟合,因此他们所观察到的效果不同于我们在使用relus时报告的适应训练集的加速能力。快速学习对大型数据集上训练的大型模型的性能有很大的影响。

3.2、在多GPU上进行训练

一个GTX 580 GPU只有3GB的内存,这限制了可以在其上训练的网络的最大大小。事实证明,120万个训练例子已经足够训练网络,因为网络太大,不适合一个GPU。因此,我们将网络分布在两个GPU上。当前的GPU特别适合跨GPU并行化,因为它们能够直接读取和写入彼此的内存,而无需经过主机内存。我们使用的并行化方案基本上将一半的内核(或神经元)放在每个GPU上,还有一个额外的技巧:GPU只在特定的层上进行通信。这意味着,例如,第3层的内核从第2层的所有内核映射中获取输入。但是,第4层中的内核只从驻留在同一GPU上的第3层的内核映射中获取输入。选择连接模式是交叉验证的一个问题,但这允许我们精确地调整通信量,直到它成为计算量的可接受的一小部分。

其结果结构有点类似于由cireSan等人使用的“柱状”CNN的结构。[5],但我们的列不是独立的(见图2)。该方案将前1和前5位错误率分别降低了1.7%和1.2%,而在一个GPU上训练的每个卷积层的核数只有其一半。双GPU网的训练时间比1-GPU网稍短。

注:(2单GPU网与最终卷积层中的双GPU网具有相同的核数。这是因为网络的大部分参数都在第一个全连接层中,该层以最后一个卷积层作为输入。因此,为了使两个网具有大致相同的参数,我们没有将最终卷积层的大小减半(也没有将后面的全连接层的大小减半)。因此,这种比较偏向于一个GPU网,因为它比两个GPU网的一半大。 )

3.3、局部响应归一化

relus具有它们不需要输入规范化以防止它们饱和的可取性。如果至少有一些训练的例子产生了一个正例输入到一个relu,学习将发生在该神经元。然而,我们仍然发现,下面的局部规范化方案有助于推广。用表示神经元的活性,用核i在位置(x,y)计算,然后应用重余非线性,由表达式给出响应归一化活动

:

其中和在n个“相邻”核映射在同一空间位置上运行,n是层中核的总数。当然,内核映射的排序是任意的,并且是在训练开始之前确定的。这种反应归一化实现了一种由真实神经元中的类型激发的横向抑制形式,在使用不同内核计算的神经元输出之间产生了对大活动的竞争。常数k、n、α和β是超参数,其值由验证集确定;我们使用k=2,n=5,α=10−4和β=0.75。在某些层中应用了relu非线性后,我们应用了这种归一化(见第3.5节)。

该方案与Jarrett等人的局部对比归一化方案有一定的相似之处。[11]但我们更准确地称为“亮度正常化”,因为我们不减去平均活动。响应归一化将我们的头1和前5错误率分别降低1.4%和1.2%.我们还在CIFAR-10数据集上验证了该方案的有效性:四层CNN在不进行归一化的情况下获得了13%的测试错误率,在规范化的情况下获得了11%的测试错误率。

3.4、重叠池

CNN中的池层概括了同一核映射中相邻神经元群的输出。传统上,由相邻的集合单元概括的区域不重叠(例如,[17,11,4])。更准确地说,一个池化层可以被认为是由一个集合单元组成的网格,这些单元之间间隔着s个像素,每个像素都概括了一个大小为z×z的邻域,该邻域以池单元的位置为中心。如果设为s=z,则得到CNN中常用的传统本地池。如果设置s <z我们获得重叠池 。这是我们在整个网络中使用的,s=2和z=3。与不重叠方案s=2,z=2相比,该方案的前1位和前5位错误率分别降低了0.4%和0.3%,从而产生了等效尺寸的输出。我们通常在训练期间观察到,具有重叠池的模型会发现更难适应。

3.5、总体结构

现在我们准备描述CNN的总体架构。如图2所示,网络包含八个具有权重的层;前五个层是卷积层,其余三个层是全连接层。最后一个全连接层的输出被馈送给1000路Softmax,它在1000类标签上产生一个分布。我们的网络最大限度地实现了多项式Logistic回归目标,这相当于在预测分布下,最大限度地最大化训练案例中正确标签的对数概率的平均值。

第二层、第四层和第五层的内核仅连接到位于同一GPU上的前一层中的内核映射(参见图2)。第三卷积层的核连接到第二层的所有核映射。全连接层中的神经元连接到前一层的所有神经元。响应-归一化层遵循第一层和第二卷积层。最大池化层,如3.4节所述,遵循响应归一化层和第五卷积层。对每个卷积层和全连接层的输出均采用了非线性.。

图2:我们CNN架构的一个例子,显式地显示了两个GPU之间职责的划分。一个GPU运行图层-部分在图的顶部,而另一个运行层-部件在底部。GPU只在某些层进行通信。网络输入为150,528维,网络剩余层的神经元数为253,440-186,624-64,896-64,896-43,264-4096-4096-1000。

第一卷积层滤除大小为11×11×3的96个核的224×224×3输入图像,步长为4个像素(这是核映射中相邻神经元的接收场中心之间的距离)。第二卷积层以第一卷积层的响应归一化和集合输出为输入,对其进行5×5×48的256核滤波。第三层、第四层和第五层相互连接,没有任何中间的池或规范化层。第三卷积层有384个3×3×256的核,与第二卷积层的(归一化、集合)输出相连接。第四卷积层有384颗3×3×192粒,第五层有256颗3×3×192粒。全连接层各有4096个神经元。

四、减少过拟合

我们的神经网络体系结构有6000万个参数。尽管ILSVRC的1000个类使每个训练示例对从图像到标签的映射施加了10位的约束,但这并不足以学习这么多的参数而不需要大量的过度拟合。下面,我们描述了两种主要的方法来对抗过拟合。

4.1、数据增强

减少图像数据过拟合的最简单和最常见的方法是使用保留标签的变换(例如,[25,4,5])人为地扩大数据集。我们采用了两种不同的数据增强形式,它们都允许从原始图像中生成转换后的图像,而且计算量很小,因此转换后的图像不需要存储在磁盘上。在我们的实现中,转换后的映像是在CPU上用python代码生成的,而GPU正在对前一批映像进行训练。因此,这些数据增强方案实际上是自由计算的。

数据增强的第一种形式是生成图像平移和水平反射。我们通过从256×256图像中随机提取224×224块(以及它们的水平反射)来实现这一点,并在这些提取块上训练我们的网络。这使我们训练的规模增加了2048倍,尽管由此产生的训练例子当然是高度相互依存的。如果没有这一方案,我们的网络就会遭受严重的过度拟合,这将迫使我们使用小得多的网络。在测试时,网络通过提取五个224×224块(四个角点和中心块)以及它们的水平反射(总共10个补丁)进行预测,并将网络的Softmax层对这10个补丁进行平均预测。

第二种数据增强形式是改变训练图像中RGB通道的强度。具体来说,我们对整个ImageNet训练集中的RGB像素值执行PCA。在每幅训练图像中,我们加入了找到的主分量的倍数,其大小与相应的特征值成正比,乘以从均值为零和标准差为0.1的高斯分布中提取的随机变量。因此,每个RGB图像像素我们添加以下数量:

其中和

分别是RGB像素值的3×3协方差矩阵的特征向量和特征值,

是上述随机变量。每个

只为特定训练图像的所有像素绘制一次,直到该图像再次用于训练为止,此时将重新绘制该图像。该方案近似地捕捉了自然图像的一个重要特性,即物体的身份对光照强度和颜色的变化是不变的。该方案使top-1的错误率降低了1%以上。

4.2、正则化

将许多不同模型的预测结合起来是减少测试错误[1,3]的一种非常成功的方法,但对于已经需要几天训练的大型神经网络来说,这似乎太昂贵了。但是,有一个非常有效的模型组合版本,在训练期间只需花费大约两倍的费用。最近引入的技术,称为“Dropout”[10],包括将每个隐藏神经元的输出设定为零,概率为0.5。以这种方式““dropped out”的神经元不参与前传,也不参与反向传播。因此,每次提出输入时,神经网络都会对不同的结构进行采样,但所有这些结构都具有相同的权重。这项技术减少了神经元的复杂共适应,因为神经元不能依赖特定的其他神经元的存在。因此,它不得不学习更健壮的特征,这些特征与其他神经元的许多不同的随机子集相结合是有用的。在测试时,我们使用所有的神经元,但它们的输出乘以0.5,这是一个合理的近似,以几何平均的预测分布产生指数-多“Dropout“网络。

我们在图2的前两个全连接层中使用下拉列表。没有Dropout,我们的网络表现出很大的过度性。退出大约是收敛所需的迭代次数的两倍。

5、学习细节

我们用随机梯度下降训练我们的模型,有128个参数,学习率为0.9,q衰减为0.0005。我们发现这种微小的重量衰减对模型的学习是很重要的。换句话说,这里的重量衰减不仅仅是正则化的:它减少了模型的训练误差。重量w的更新规则是

其中,i是迭代指数,v是动量变量,是学习速率,是目标对w的导数的第1批di的平均值在wi上估计。

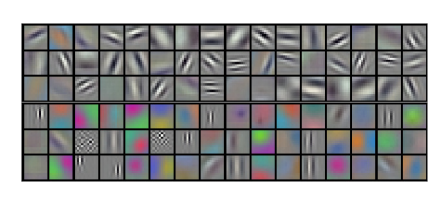

图3:在224×224×3输入图像上,第一卷积层学习到大小为11×11×3的96个卷积核。前48个是在GPU 1上学到的,而下面48个是在GPU 2上学到的。详情见6.1节。

我们从零均值高斯分布中初始化了每一层的权重,标准偏差为0.01.我们用常数1初始化了第二层、第四层和第五层以及全连接的隐藏层中的神经元偏差。这种初始化通过向用户提供积极的输入,加快了学习的早期阶段。我们用常数0初始化剩余层中的神经元偏差。

我们对所有层次都使用了相同的学习速率,在整个训练过程中,我们手动调整了这一比率。我们遵循的启发式方法是,当验证错误率随着当前学习速度的提高而停止提高时,将学习率除以10。学习率在0.01时初始化,终止前降低3倍。我们通过120万张图像训练了大约90个周期,在两个NVIDIA GTX 580 3GB GPU上花费了5-6天的时间。

六、结论

我们关于ILSVRC-2010的结果汇总在表1中。我们的网络实现了TOP-1和TOP-5测试集错误率分别为37.5%和17.0%5.在ilsvrc 2010竞赛中取得的最佳成绩分别为47.1%和28.2%,采用的方法是平均从六个针对不同特征进行训练的稀疏编码模型得出预测[2]。自那时以来,发表的最佳结果分别为45.7%和25.7%,其方法是将两种基于Fisher向量(FVS)训练的分类器的预测平均值从两种密集采样特征中计算出来[24]。

我们还在ILSVRC-2012竞赛中加入了我们的模型,并在表2中报告了我们的结果。由于ILSVRC-2012测试集标签是不可公开的,所以我们不能报告我们尝试过的所有模型的测试错误率。在本段的其余部分,我们交替使用验证和测试错误率,因为根据我们的经验,它们的差异不超过0.1%(见表2)。本文所描述的CNN的误差率为18.2%.平均五个相似的CNN的预测结果的误差率为16.4%。培训一个CNN,在最后一个池层上增加第六个卷积层,对整个ImageNet 2011年秋季发行版(1500万张图像,22k类别)进行分类,然后在ILSVRC-2012上对其进行“微调”,错误率为16.6%。用上述五个CNN对2011年秋季整个发布过程中的两个CNN的预测进行平均,错误率为15.3%。第二次最佳竞赛条目的误差率为26.2%,该方法平均于几个根据不同类型的密集抽样特征计算的fv上训练的分类器的预测[7]。

最后,我们还报告了2009年秋季版ImageNet的错误率,包括10184个类别和890万幅图像。在这个数据集上,我们遵循文献中使用一半图像进行培训和一半用于测试的惯例。由于没有建立测试集,我们的拆分必然与以前的作者使用的拆分不同,但这并不会对结果产生明显的影响。我们在这个数据集上的前1和前5错误率分别为67.4%和40.9%,由上面描述的网络实现,但是在最后一个池层上有一个额外的第六个卷积层。在这个数据集中发表的最佳结果是78.1%和60.9%[19]。

6.1、定性评价

图3显示了网络的两个数据连接层学习到的卷积内核。该网络已经学习了各种频率和方向选择性内核,以及各种彩色斑点。注意这两个GPU显示的专门化,这是3.5节中描述的受限连接的结果。GPU 1上的内核在很大程度上与颜色无关,而GPU 2上的内核主要是特定颜色的.这种专门化在每次运行时都会发生,并且独立于任何特定的随机权值初始化(模块化,GPU的重编码)。

图4:(左)8个ILSVRC-2010测试图像和五个标签被我们的模型认为是最可能的。正确的标签写在每个图像下面,分配给正确标签的概率也用红色条显示(如果它恰好位于前5)。(右)第一栏中的五个ILSVRC-2010测试图像。剩下的列显示了六个训练图像,它们在最后一个隐藏层中生成特征向量,与测试图像的特征向量之间的欧几里德距离最小。

在图4的左边面板中,我们通过计算8个测试图像的前5位预测来定性地评估网络已经学到了什么。注意,即使是偏离中心的对象,如左上角的螨,也可以被网络识别。大多数前五名的标签似乎都是合理的。例如,只有其他类型的猫被认为是豹的合理标签。在某些情况下(格栅,樱桃)有真正的模糊不清的目标的照片。

另一种探索网络视觉知识的方法是考虑图像在最后4096维隐层引起的特征激活。如果两幅图像产生的特征激活向量具有较小的欧氏距离,则可以说神经网络的较高层次认为它们是相似的。图4显示了来自测试集的5个图像和来自培训集的6个图像,它们非常相似。注意,在像素级,检索到的训练图像在L2中通常与第一列中的查询图像不接近。例如,检索到的狗和大象以各种姿势出现。我们在补充材料中给出了更多测试图像的结果。

利用两个4096维实数向量之间的欧氏距离来计算相似度是效率低下的,但通过训练自动编码器将这些向量压缩成短二进制码,可以提高相似度的计算效率。这将产生一种比将自动编码器应用于原始像素[14]更好的图像检索方法,该方法不使用图像标签,因此倾向于检索具有相似边缘模式的图像,无论它们在语义上是否相似。

7、Discussion

我们的结果表明,一个大型的、深卷积的神经网络能够利用单纯的监督学习在极具挑战性的数据集上获得破记录结果。值得注意的是,如果去掉单个卷积层,我们网络的性能就会下降。例如,删除任何中间层会导致网络顶层性能损失约2%。因此,深度对于实现我们的成果来说是非常重要的。

为了简化我们的实验,我们没有使用任何无监督的预训练,即使我们期望它会有所帮助,特别是如果我们获得足够的计算能力来显著增加网络的大小,而没有得到相应的标记数据量的增加。到目前为止,我们的结果已经有所改善,因为我们已经使我们的网络更大,并训练它更长,但我们仍然有许多数量级的去做,以匹配人类视觉系统的下-时间通路。最终,我们希望在视频序列上使用非常大和深的卷积网,其中时间结构提供了非常有用的信息,这些信息在静态图像中是缺失的,或者是不那么明显的。

References [1] R.M. Bell and Y. Koren. Lessons from the netflix prize challenge. ACM SIGKDD Explorations Newsletter, 9(2):75–79, 2007. [2] A. Berg, J. Deng, and L. Fei-Fei. Large scale visual recognition challenge 2010. www.imagenet.org/challenges. 2010. [3] L. Breiman. Random forests. Machine learning, 45(1):5–32, 2001. [4] D. Cire¸san, U. Meier, and J. Schmidhuber. Multi-column deep neural networks for image classification. Arxiv preprint arXiv:1202.2745, 2012. [5] D.C. Cire¸san, U. Meier, J. Masci, L.M. Gambardella, and J. Schmidhuber. High-performance neural networks for visual object classification. Arxiv preprint arXiv:1102.0183, 2011. [6] J. Deng, W. Dong, R. Socher, L.-J. Li, K. Li, and L. Fei-Fei. ImageNet: A Large-Scale Hierarchical Image Database. In CVPR09, 2009. [7] J. Deng, A. Berg, S. Satheesh, H. Su, A. Khosla, and L. Fei-Fei. ILSVRC-2012, 2012. URL http://www.image-net.org/challenges/LSVRC/2012/. [8] L. Fei-Fei, R. Fergus, and P. Perona. Learning generative visual models from few training examples: An incremental bayesian approach tested on 101 object categories. Computer Vision and Image Understanding, 106(1):59–70, 2007. [9] G. Griffin, A. Holub, and P. Perona. Caltech-256 object category dataset. Technical Report 7694, California Institute of Technology, 2007. URL http://authors.library.caltech.edu/7694. [10] G.E. Hinton, N. Srivastava, A. Krizhevsky, I. Sutskever, and R.R. Salakhutdinov. Improving neural networks by preventing co-adaptation of feature detectors. arXiv preprint arXiv:1207.0580, 2012. [11] K. Jarrett, K. Kavukcuoglu, M. A. Ranzato, and Y. LeCun. What is the best multi-stage architecture for object recognition? In International Conference on Computer Vision, pages 2146–2153. IEEE, 2009. [12] A. Krizhevsky. Learning multiple layers of features from tiny images. Master’s thesis, Department of Computer Science, University of Toronto, 2009. [13] A. Krizhevsky. Convolutional deep belief networks on cifar-10. Unpublished manuscript, 2010. [14] A. Krizhevsky and G.E. Hinton. Using very deep autoencoders for content-based image retrieval. In ESANN, 2011. [15] Y. Le Cun, B. Boser, J.S. Denker, D. Henderson, R.E. Howard, W. Hubbard, L.D. Jackel, et al. Handwritten digit recognition with a back-propagation network. In Advances in neural information processing systems, 1990. [16] Y. LeCun, F.J. Huang, and L. Bottou. Learning methods for generic object recognition with invariance to pose and lighting. In Computer Vision and Pattern Recognition, 2004. CVPR 2004. Proceedings of the 2004 IEEE Computer Society Conference on, volume 2, pages II–97. IEEE, 2004. [17] Y. LeCun, K. Kavukcuoglu, and C. Farabet. Convolutional networks and applications in vision. In Circuits and Systems (ISCAS), Proceedings of 2010 IEEE International Symposium on, pages 253–256. IEEE, 2010. [18] H. Lee, R. Grosse, R. Ranganath, and A.Y. Ng. Convolutional deep belief networks for scalable unsupervised learning of hierarchical representations. In Proceedings of the 26th Annual International Conference on Machine Learning, pages 609–616. ACM, 2009. [19] T. Mensink, J. Verbeek, F. Perronnin, and G. Csurka. Metric Learning for Large Scale Image Classification: Generalizing to New Classes at Near-Zero Cost. In ECCV - European Conference on Computer Vision, Florence, Italy, October 2012. [20] V. Nair and G. E. Hinton. Rectified linear units improve restricted boltzmann machines. In Proc. 27th International Conference on Machine Learning, 2010. [21] N. Pinto, D.D. Cox, and J.J. DiCarlo. Why is real-world visual object recognition hard? PLoS computational biology, 4(1):e27, 2008. [22] N. Pinto, D. Doukhan, J.J. DiCarlo, and D.D. Cox. A high-throughput screening approach to discovering good forms of biologically inspired visual representation. PLoS computational biology, 5(11):e1000579, 2009. [23] B.C. Russell, A. Torralba, K.P. Murphy, and W.T. Freeman. Labelme: a database and web-based tool for image annotation. International journal of computer vision, 77(1):157–173, 2008. [24] J. Sánchez and F. Perronnin. High-dimensional signature compression for large-scale image classification. In Computer Vision and Pattern Recognition (CVPR), 2011 IEEE Conference on, pages 1665–1672. IEEE, 2011. [25] P.Y. Simard, D. Steinkraus, and J.C. Platt. Best practices for convolutional neural networks applied to visual document analysis. In Proceedings of the Seventh International Conference on Document Analysis and Recognition, volume 2, pages 958–962, 2003. [26] S.C. Turaga, J.F. Murray, V. Jain, F. Roth, M. Helmstaedter, K. Briggman, W. Denk, and H.S. Seung. Convolutional networks can learn to generate affinity graphs for image segmentation. Neural Computation, 22(2):511–538, 2010.