Mask RCNN是目标分割检测框架--扩展到人体关键点检测

对于原理不清晰的同学,建议你去看一下Kaming He的论文:https://arxiv.org/pdf/1703.06870.pdf

我的博客里也有论文的翻译版:Mask R-CNN 论文翻译

对于视频中的多人进行姿态估计,预训练权重,可以直接下载:链接: mask_rcnn_humanpose.h5 密码: qx8f

我已将Mask rcnn扩展到多人姿态估计的代码上传到我的github上了:Keypoints-of-humanpose-with-Mask-R-CNN

如果觉得对你项目有用的话,点个star吧!

1、安装环境:

1、电脑环境:

Mask R-CNN是基于Python3,Keras,TensorFlow。

- Python 3.4+

- TensorFlow 1.3+

- Keras 2.0.8+

- Jupyter Notebook

- Numpy, skimage, scipy, Pillow, cython, h5py

- opencv 2.0

2、预训练权重下载:链接: mask_rcnn_humanpose.h5 密码: qx8f

3、如果需要在COCO数据集上训练或测试,需要安装pycocotools, clone下来,make生成对应的文件,make之后将生成的pycocotools文件夹复制到项目文件夹中:

Linux: https://github.com/waleedka/coco

Windows: https://github.com/philferriere/cocoapi. You must have the Visual C++ 2015 build tools on your path (see the repo for additional details)

4、MS COCO数据集(Ubuntu 建议采用 wget 命令直接Ubuntu终端下载)

2、人体姿态估计原理:

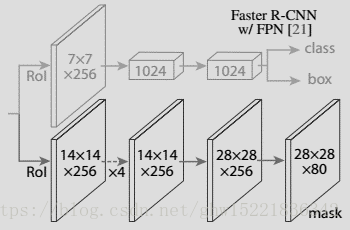

MaskR-CNN在FasterR-CNN的基础上添加了一个掩码分支,同时将Roipool更换为ROIAlign大大提升了目标分割检测的准确率。MaskR-CNN可以扩展到人体姿态估计,将k个关键点的位置进行one-hot编码,利用MaskR-CNN对于K个掩码进行预测其所属类型,对于关键点识别准确,实现像素级的分割。

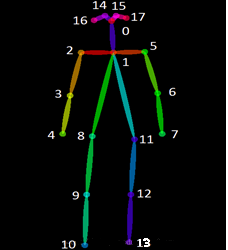

MaskR-CNN可以拓宽到多人姿态估计的领域中。对于每一个生成的候选区域进行检测,当检测到该区域包含人这一种类时,会对人体身上每一个关键点的位置进行独热编码。M个掩码对应于人体的M个关键点类型之一,图3.11所示为关键点检测网络,通过连接3*3的256维的卷积层,与连接的反卷积层进行双线性上采样。最后,为每个关键点的输出一个56*56的特征图。

One-hot独热编码为一位有效编码,利用K位状态寄存器来对N个状态进行编码,每个寄存器都是相互独立的,在任何条件下只有一位one-hot编码可以作为分类变量的二进制向量表示。分配关键点时,人体每个部位的关键点对应于一个one-hot掩码,训练的目标最终是得到一个56*56的二值掩码,当中只有一个像素被标记为关键点,其余像素均为背景。对于每一个关键点的位置,进行最小化平均交叉熵损失检测,K个关键点是被独立处理的。

人体姿态检测中,人本身可以作为一个目标实例进行分类检测。但是,采取了one-hot编码以后,就可以扩展到coco数据集中被标注的17个人体关键点(例如:左眼、右耳),同时也能够处理非连续型数值特征。

3、人体关键数据集:

我采用的是coco keypoint 2017数据集进行训练和测试:

包含(鼻子,左眼,右眼,左耳,右耳,左肩,右肩,左肘,右肘,左手腕,右手腕,左膝盖,右膝盖,左脚踝,右脚踝,左小腿,右小腿):

17个人体关键点标注

4、代码:

如何对于视频中的多人进行姿态检测,请打开项目中的 video_demo.py

可以实现对于视频中的行人进行姿态检测!

cap = cv2.VideoCapture('humantest2.avi')#s视频的名字

size = (

int(cap.get(cv2.CAP_PROP_FRAME_WIDTH)),

int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

)

codec = cv2.VideoWriter_fourcc(*'DIVX')

output = cv2.VideoWriter('human2.avi',codec,25.0,size) #输出视频的名字

i = 0

frame_rate_divider = 1

while(cap.isOpened()):

stime = time.time()

ret, frame = cap.read()

if ret:

if i % frame_rate_divider == 0:

results = model.detect_keypoint([frame], verbose=0)

r = results[0]

# for one image

log("rois", r['rois'])

log("keypoints", r['keypoints'])

log("class_ids", r['class_ids'])

log("keypoints", r['keypoints'])

log("masks", r['masks'])

log("scores", r['scores'])

result_frame = cv2_display_keypoint(frame,r['rois'],r['keypoints'],r['masks'],r['class_ids'],r['scores'],class_names)

output.write(result_frame)

cv2.imshow('frame', result_frame)

i += 1

else:

i += 1

print('FPS {:.1f}'.format(1 / (time.time() - stime)))

if cv2.waitKey(1) & 0xFF == ord('q'):

break

else:

break

cap.release()

output.release()

cv2.destroyAllWindows()大家可以把代码下载下来,然后用我训练好的模型进行预训练,遇到任何问题,在评论区留下你的问题,我会尽力去解决!

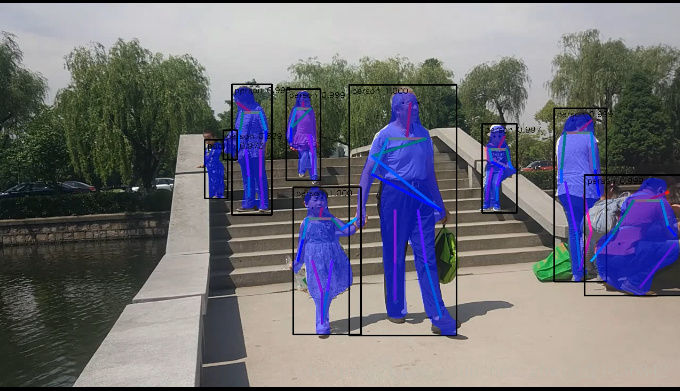

附几张检测效果图:

我后面会更新 mobileNet_v1版的Mask R-CNN,模型更小,运行速度更快,检测精度也很高!