Online Feature Selection: A Limited-Memory Substitution

Algorithm and Its Asynchronous Parallel Variation

在线特征选择:有限存储器替换算法及其异步并行变化

ABSTRACT摘要

基于优化算法的在线特征选择有两个缺点:

-

the penalty term for L1 norm term is hard to choose;usually cross validation

L1正则化的罚函数很难确定,一般用交叉验证来确定 -

the memory usage is hard to control or predict

内存很难管理

提出:

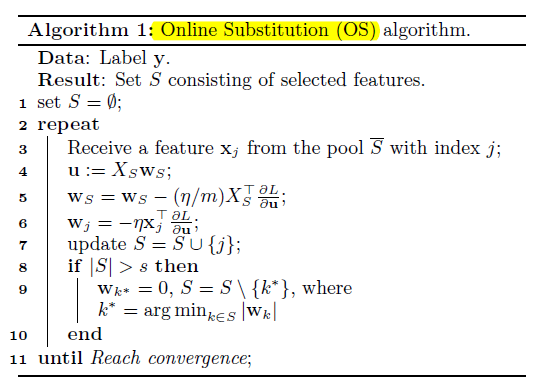

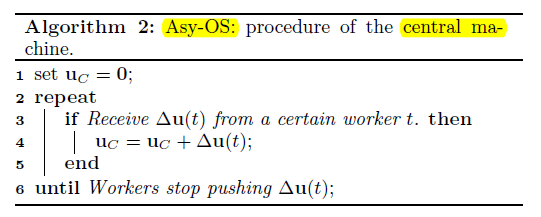

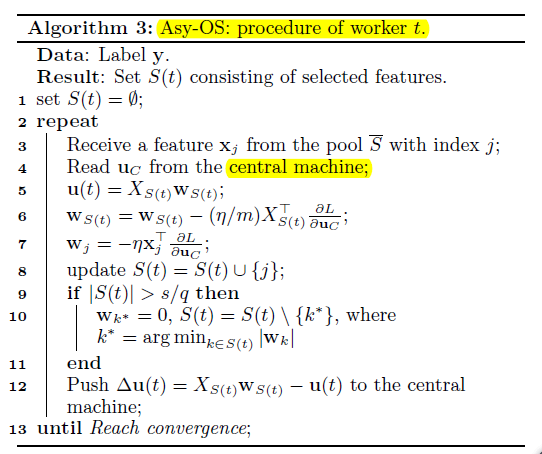

a limited-memory and model parameter free online feature selection algorithm, namely online substitution (OS) algorithm. an asynchronous parallel extension for OS (Asy-OS)

有限内存和模型参数游离在线特征选择算法,即在线替换(OS)算法,并且加入异步平行扩展。

关键词:Feature Selection; Online Learning; Asynchronous Parallel

Optimization

1.INTRODUCTION介绍

*two types of online feature selection algorithms:*一般有两种特选算法:

- statistical algorithms 基于统计学的特选

- optimization based algorithms* 基于优化算法的特选(本文主要讨论)

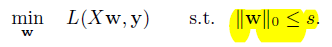

我们引入*online feature selection algorithm,在线特选算法,主要解决以下L0范数约束问题:

其中,X是np的矩阵,n是样本数量,p是特征数量,y是标记向量,s是我们想要选取的特征数量

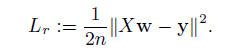

关于损失函数的格式,一般的,对于线性回归, L的形式为平方损失:

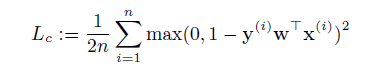

对于分类,L的形式为平方合页损失:

当y属于[-1,+1]的时候,L也可以是logistic regression loss,

SVM regression loss等等,在这篇文章中,不对L做限制。

为了解决第一个问题,主要的思路是使用预测梯度下降projected gradient descent (Proj-GD),这使得正常的梯度下降步骤将当前点投射到L0球上。which makes a normal gradient descent step and projects the current point onto the L0 ball.

但是有个很严重的问题,做这个算法需要得到所有的特征,in order to use Proj-GD to do feature selection, we must have the access to all the features.

解决方法:在线替换 online substitution

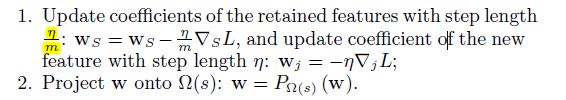

方法:当s不满,特征总是接受,当s满了,则替换的标准是比较新特征的潜力S中最差的特征。在迭代k,如果即将到来的特征具有索引j,那么过程是:

中央机器获得一个u_c,接受各个工人的差分,

以上均没有涉及到异步