版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/chenKFKevin/article/details/79689751

前面所使用的逻辑斯蒂回归和支持向量机模型,都在某种程度上要求被学习的数据特征和目标之间遵照线性假设。然而,在许多现实场景下,这种假设是不存在的。

比如,要借由一个人的年龄来预测患流感的死亡率。如果采用线性模型假设,那只有两种情况:年龄越大死亡率越高;或者年龄越低死亡率越高。然而根据常识判断,青壮年因为更加健全的免疫系统,相较于儿童和老年人不容易因患流感而死亡。因此年龄与因流感而死之间不存在线性关系。在机器学习模型中,决策树是描述这种非线性关系的不二之选。

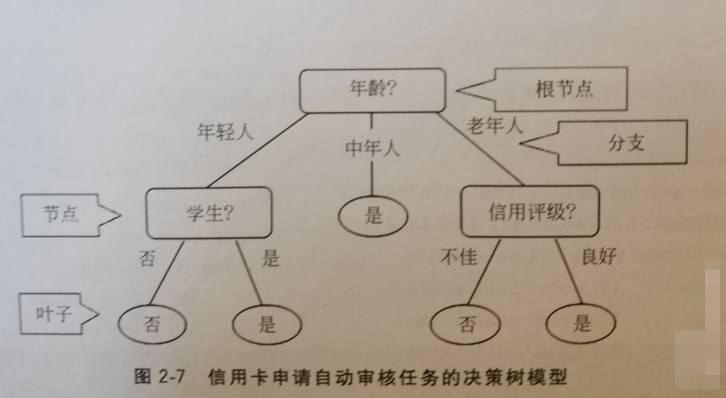

再比如,信用卡申请的审核涉及申请人的多项特征,也是典型的决策树模型。如下图所示,决策树节点代表数据特征;每个节点下的分支代表对应特征值的分类;而决策树的所有叶子节点则显示模型的决策结果。对于是否通过信用卡申请而言,这是二分类决策任务,因此只有yes和no两种分类结果。

下图所示的决策树使用多种不同特征组合搭建多层决策树的情况,模型在学习的时候就需要考虑特征节点的选取顺序。常用的度量方式包括信息熵和基尼不纯度,涉及的算法是ID3,C4.5和CART,这里不做过多引申,可去自行查阅。

数据描述:虽然很难获取到信用卡公司客户的资料,但是也有类似借助客户档案进行二分类的任务。这里使用的数据来自于历史上一件悲惨的灾难事件:泰坦尼克号沉船事故。1912年,当时隶属于英国的世界级豪华客轮泰坦尼克号,因在处女航行中不幸装上北大西洋冰山而沉没。这场事故使得1500多名乘客遇难。后来,这场震惊世界的惨剧被详细地调查,而且遇难乘客的信息也逐渐被披露。在当时的救援条件下,无法在短时间内确认每位乘客生还的可能性。而今,许多科学家试图通过计算机模拟和分析找出潜藏在数据背后的生还逻辑。下面我们通过代码,尝试揭开这尘封了100多年的数据的面纱。

# 导入pandas用于数据分析。

import pandas as pd

# 利用pandas的read_csv模块直接从互联网收集泰坦尼克号乘客数据。

titanic = pd.read_csv('http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt')

# 观察一下前几行数据,可以发现,数据种类各异,数值型、类别型,甚至还有缺失数据。

titanic.head()# 使用pandas,数据都转入pandas独有的dataframe格式(二维数据表格),直接使用info(),查看数据的统计特性。

titanic.info()Int64Index: 1313 entries, 0 to 1312

Data columns (total 11 columns):

row.names 1313 non-null int64

pclass 1313 non-null object

survived 1313 non-null int64

name 1313 non-null object

age 633 non-null float64

embarked 821 non-null object

home.dest 754 non-null object

room 77 non-null object

ticket 69 non-null object

boat 347 non-null object

sex 1313 non-null object

dtypes: float64(1), int64(2), object(8)

memory usage: 123.1+ KB

# 机器学习有一个不太被初学者重视,并且耗时,但是十分重要的一环,特征的选择,这个需要基于一些背景知识。

# 根据我们对这场事故的了解,sex, age, pclass这些都很有可能是决定幸免与否的关键因素。

X = titanic[['pclass', 'age', 'sex']]

y = titanic['survived']

# 对当前选择的特征进行探查。

X.info()Int64Index: 1313 entries, 0 to 1312

Data columns (total 3 columns):

pclass 1313 non-null object

age 633 non-null float64

sex 1313 non-null object

dtypes: float64(1), object(2)

memory usage: 41.0+ KB

# 借由上面的输出,我们设计如下几个数据处理的任务:

# 1) age这个数据列,只有633个,需要补完。

# 2) sex 与 pclass两个数据列的值都是类别型的,需要转化为数值特征,用0/1代替。

# 首先我们补充age里的数据,使用平均数或者中位数都是对模型偏离造成最小影响的策略。

X['age'].fillna(X['age'].mean(), inplace=True)# 数据分割。

from sklearn.cross_validation import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.25, random_state = 33)

# 我们使用scikit-learn.feature_extraction中的特征转换器,详见3.1.1.1特征抽取。

from sklearn.feature_extraction import DictVectorizer

vec = DictVectorizer(sparse=False)

# 转换特征后,我们发现凡是类别型的特征都单独剥离出来,独成一列特征,数值型的则保持不变。

X_train = vec.fit_transform(X_train.to_dict(orient='record'))

print vec.feature_names_# 同样需要对测试数据的特征进行转换。

X_test = vec.transform(X_test.to_dict(orient='record'))

# 从sklearn.tree中导入决策树分类器。

from sklearn.tree import DecisionTreeClassifier

# 使用默认配置初始化决策树分类器。

dtc = DecisionTreeClassifier()

# 使用分割到的训练数据进行模型学习。

dtc.fit(X_train, y_train)

# 用训练好的决策树模型对测试特征数据进行预测。

y_predict = dtc.predict(X_test)

# 从sklearn.metrics导入classification_report。

from sklearn.metrics import classification_report

# 输出预测准确性。

print dtc.score(X_test, y_test)

# 输出更加详细的分类性能。

print classification_report(y_predict, y_test, target_names = ['died', 'survived'])precision recall f1-score support

died 0.91 0.78 0.84 236

survived 0.58 0.80 0.67 93

avg / total 0.81 0.78 0.79 329

上述代码的输出说明,决策树模型总体在测试集上的预测准确性约为78.12%。详细的性能指标进一步说明,该模型在预测遇难者方面性能较好;却需要在识别生还者的精确率方面下功夫。

特点分析:相比于其他学习模型,决策树在模型描述上有着巨大的优势。决策树的推断逻辑非常直观,具有清晰的可解释性,也方便了模型的可视化。这些特征同时也保证了在使用决策树模型时,是无需考虑对数据的量化甚至标准化的。并且,与前一篇的K近邻模型不同,决策树仍然属于有参数模型,需要花费更多的时间在训练数据上。