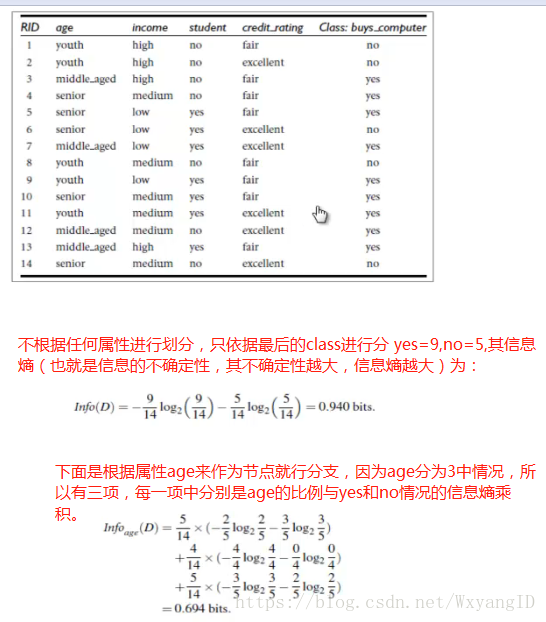

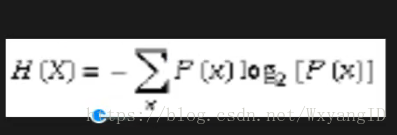

1 信息熵:度量样本集合纯度的。

计算方法:

p(k):每一种情况发生的的概率,变量的不确定性越大,其信息熵越大。

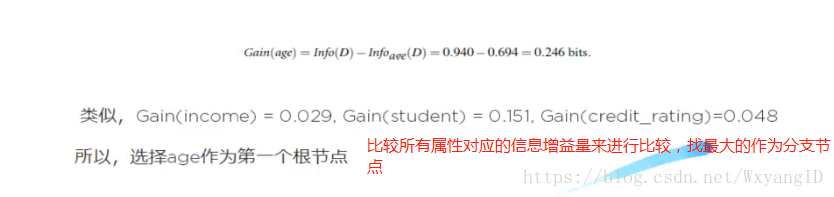

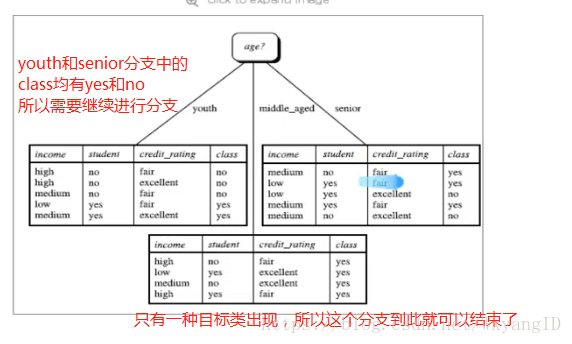

2.信息增益:用来进行决策树的划分属性选择。

著名的ID3决策树算法和C4.5算法最根本的不同就是:属性选择的度量方式不同,ID3:依据信息增益。C4.5根据增益率来进行选择划分的属性。

3.决策树容易出现overfitting的情况,主要通过剪枝操作来避免。

先剪枝:树的深度达到一定程度之后,类别的纯度也达到一定程度之后就不在继续往下进行分枝创建树的操作了。

后剪枝:完完全全的先把树创建出来,然后自底向上对飞叶节点进行考察,若将该节点替换成叶子节点能够提升决策树的泛化能力,则将该子树替换为叶节点。

4.决策树的优点:直观,小规模的数据集有效。

缺点:处理连续变量不好。类别较多的时候错误率也会快速上升。