*准备工作:

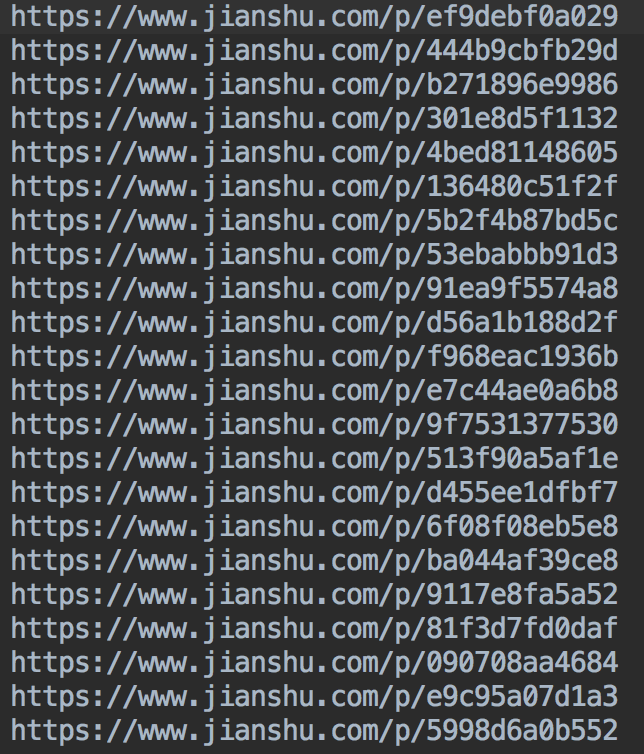

爬取的网址:https://www.jianshu.com/p/7353375213ab

爬取的内容:下图中python库介绍的内容列表,并将其链接的文章内容写进文本文件中

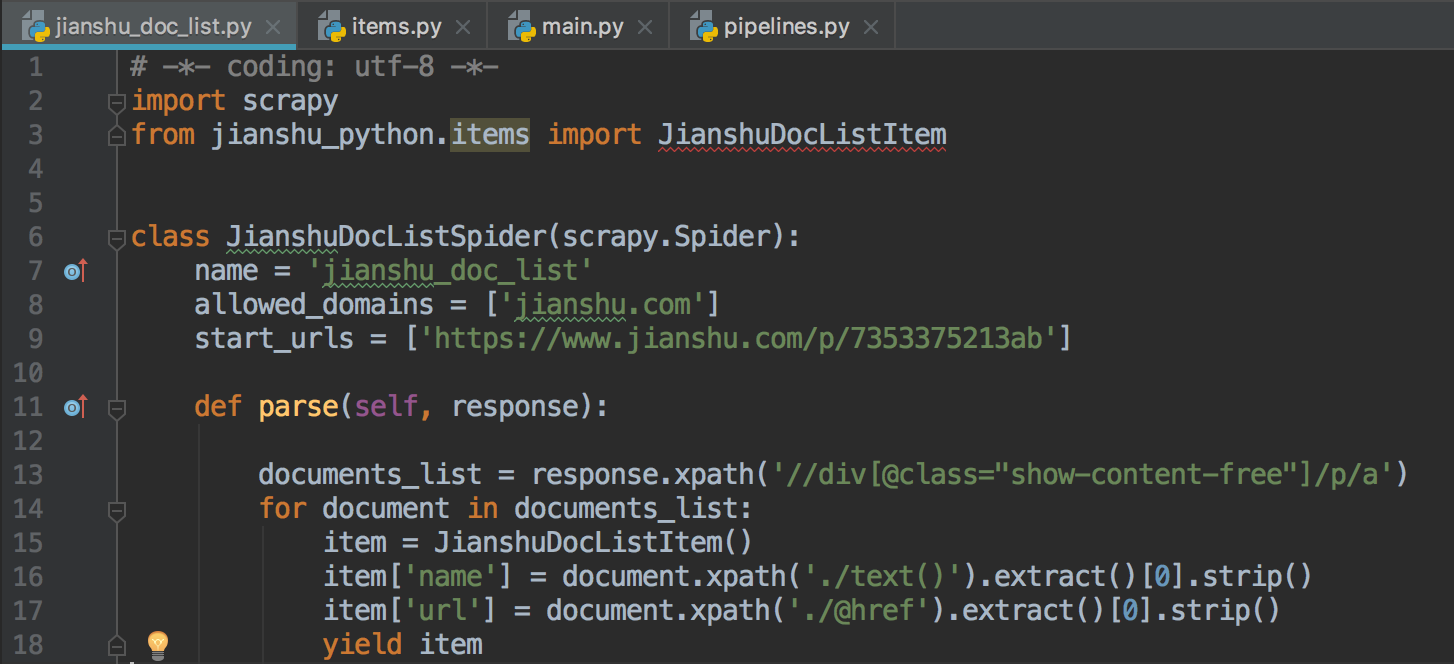

1.同上一篇的步骤:

通过'scrapy startproject jianshu_python'命令创建scrapy工程

通过'scrapy genspider jianshu_doc_list jianshu.com'命令创建一个爬虫

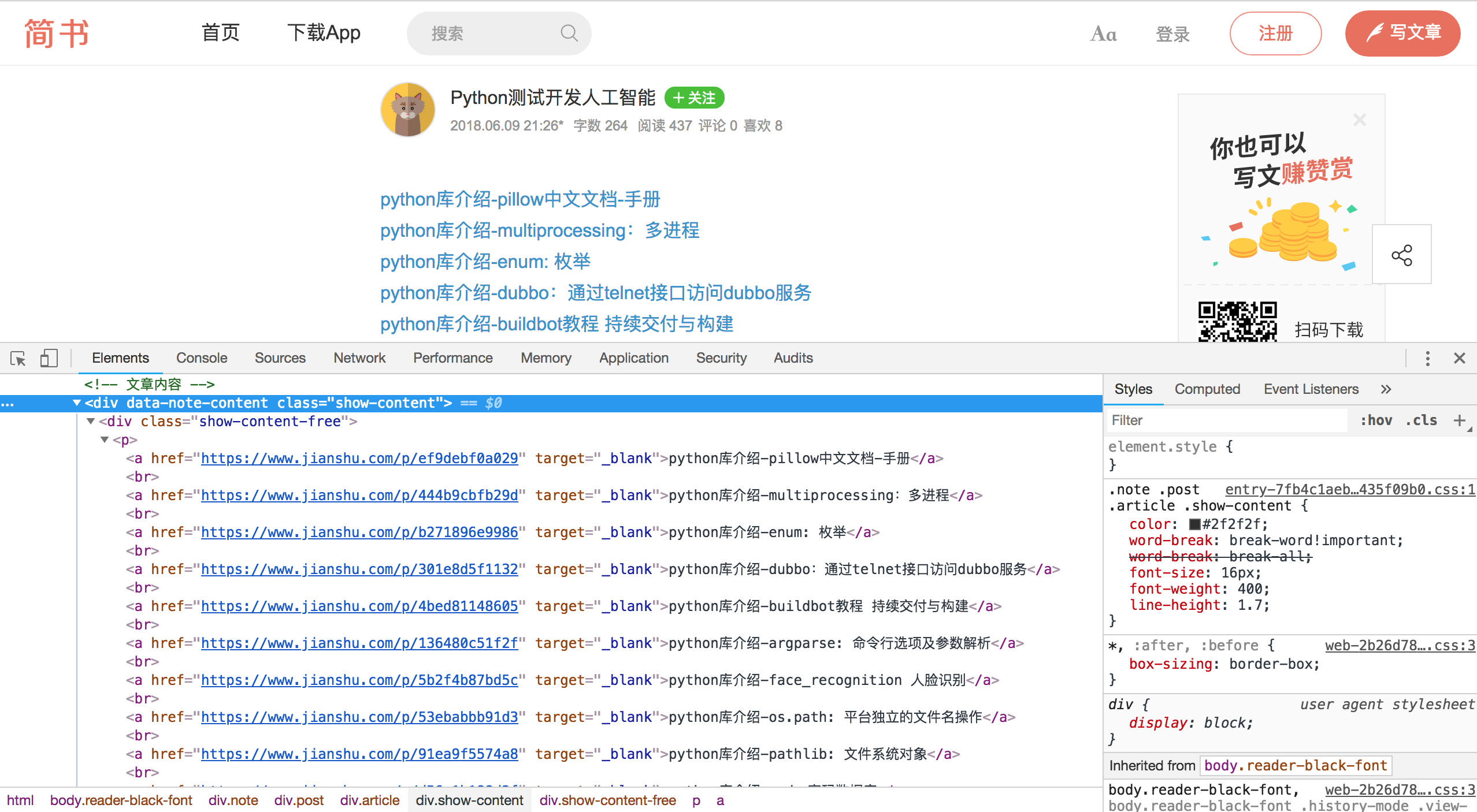

通过'scrapy shell https://www.jianshu.com/p/7353375213ab'命令在命令行窗口里调试得出所需信息的表达式

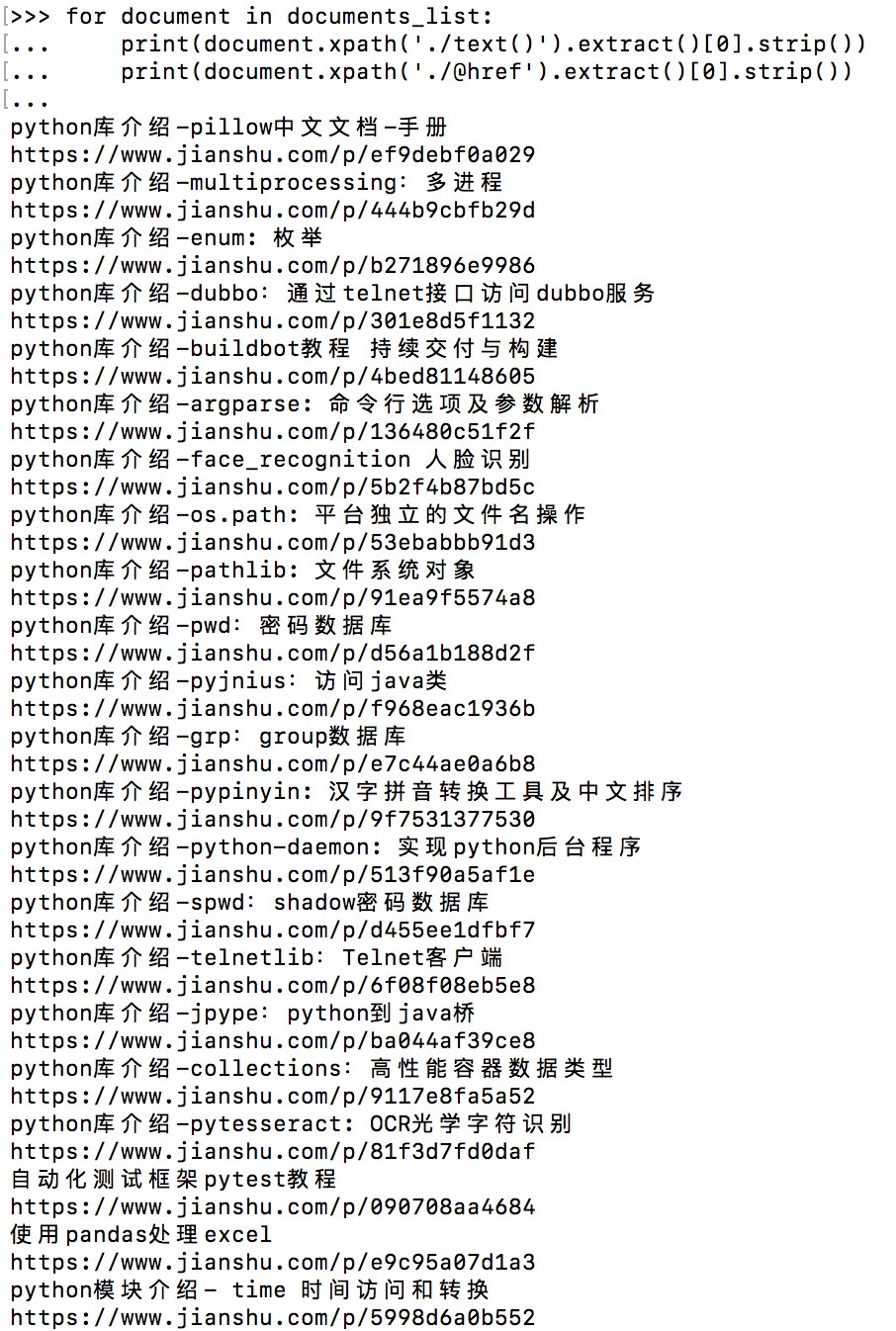

2.调试出xpath表达式,写入爬虫脚本jianshu_doc_list.py中

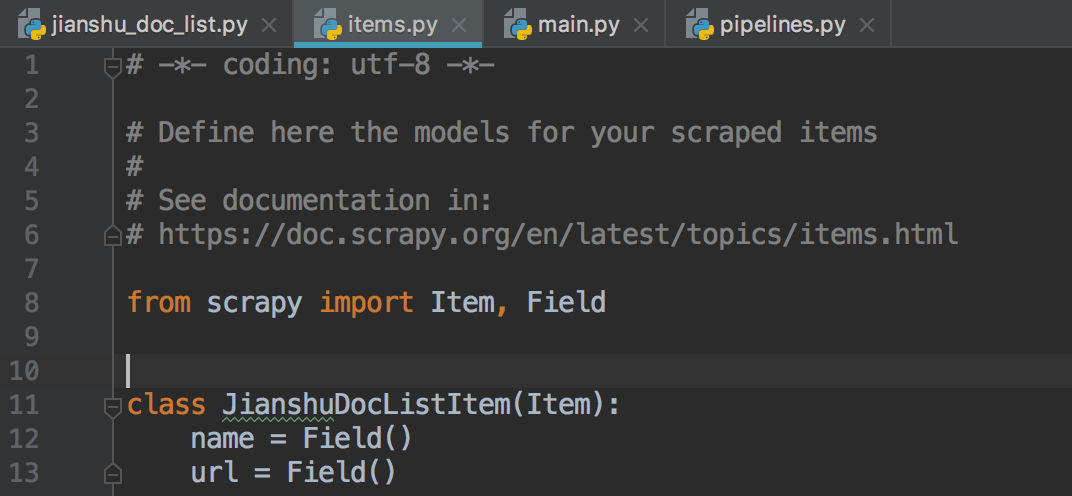

3.同样item的对象声明来自于items.py文件中

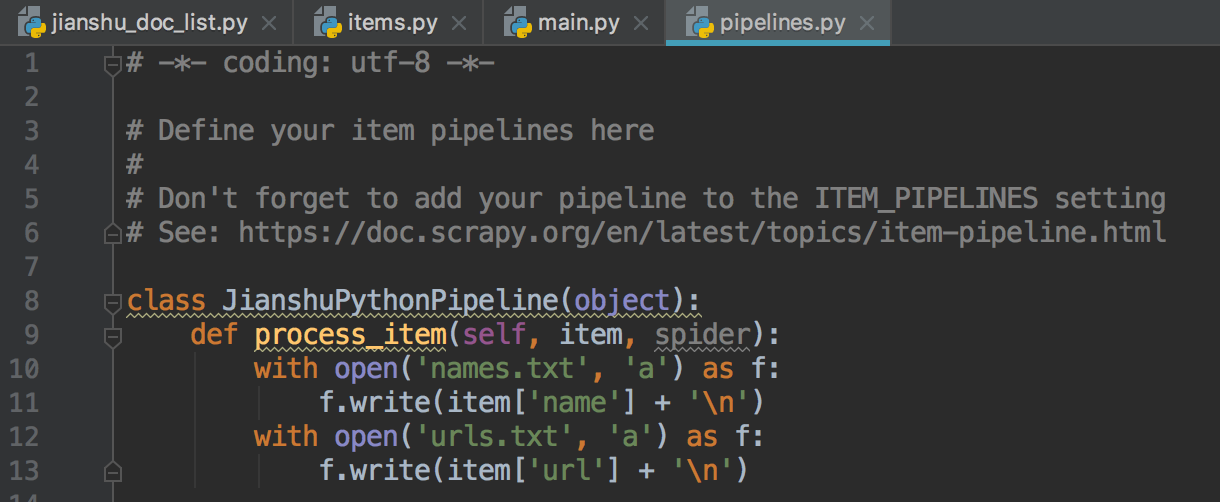

4.在pipelines.py文件里写文件名和链接的url名的数据去处

5.settings.py里的设置和运行方式同上一篇,选择一种即可,结果如下