面对增强现实的实时三维跟踪

实时三维跟踪

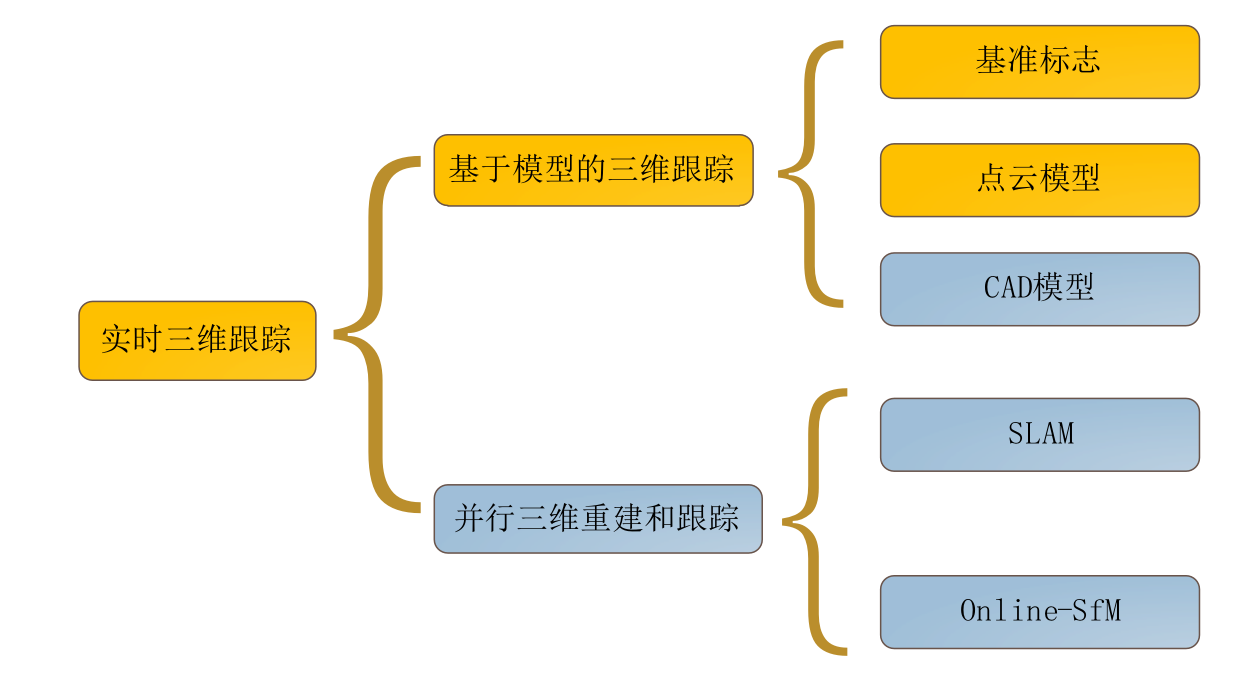

根据场景模型的表达方式,以及是否预先构建场景模型,实时三维跟踪的分类如下图所示。

图 1 实时三维跟踪的分类。按照场景三维是否已知,分为基于模型的三维跟踪和并行三维重建和跟踪。

基于模型的三维跟踪

在针孔相机模型下,给定一系列点的三维坐标及其图像投影坐标,确定相机在世界坐标中的方位,就是PnP问题。P5P一般情况下都可以得到唯一解。

在增强现实的实时三维跟踪过程中,一般可以得到几十上百个匹配点,其中包含一定数目的误匹配,为了快速稳定求解,现在通常的做法是:先用RANSAN等鲁棒估计方法随机选取固定数目的匹配点子集,用非迭代方法计算点子集对应的外参,并剔除误匹配,最后在所得到的正匹配上利用迭代方法优化求解结果。

基于点云模型的三维跟踪

CHIA K W, CHEOK A D, PRINCE S J D. Online 6 DOF augmented reality registration

from natural features[C]. ISMAR ’02: Proceedings of the 1st International Symposium on

Mixed and Augmented Reality. Washington, DC, USA: IEEE Computer Society, 2002: 305.

MOOSER J, YOU S, NEUMANN U, et al. Applying robust structure from motion to mark-

erless augmented reality[C]. IEEE Workshop on Applications of Computer Vision. Snow-

bird, Utah: 2009.

Skrypnyk等使用更多的参考图像。在预处理阶段,他们利用SFM恢复目标场景的点云结构,每个三维点不仅有三维坐标,还附加了SIFT描述量;在实时三维跟踪阶段,输入图像上的SIFT特征点可以与点云特征直接匹配,得到二维-三维对应点,然后通过RANSAC和Lenvenberg-Marquardt算法优化摄像机外参,并利用前一帧求解结果和动态的权值减少参数的抖动。他们的系统提供了基于点云模型的实时三维跟踪的基本框架。

Yuan等的系统框架与Skrypnyk等类似,但他们用KLT方法在连续帧之间跟踪特征点,因此摄像机也不能快速运动。Mooser等在预处理阶段也用KLT方法恢复点云结构,但是他们利用投影基生成特征点的描述量。上述方法共同有一个缺点,如果输入图像的视角与预处理的参考图像相差较大,特征点匹配会很少,难以得到稳定的三维跟踪结果。

Irschara等 [89] 将SIFT三维点云用于快速位置识别,同时求解摄像机外参,而且为了弥补参考图像采样不充分的缺点,他们以点云模型为基础,在摄像机参数空间创建密集的合成视图,并用贪婪法从中选取足够覆盖整个场景的视图集合。

基于CAD模型的三维跟踪

Online-SFM

传统的SfM [82,83,117] 是精确的场景三维和摄像机参数求解方法,但是通常需要很长时间的优化,不能用于实时系统。 Klein等 [118] 提出了第一个实用的Online-SfM系统,将跟踪和重建分成两个线程,可在双核机器上运行。跟踪线程的任务是根据历史信息估计当前帧的相机参数,把场景中的三维点投影到当前帧上,然后在局部窗口内搜索三维点的FAST匹配点,并估计相机参数。重建线程的任务是恢复场景的三维点,在利用双视几何初始化场景之后,重建线程不断检测并添加新的关键帧,利用已有的关键帧和三维点初始化新

关键帧的三维,并不断调用局部集束调整优化关键帧的参数和场景三维。在后续工作中,Klein等加入边特征 [119] ,使系统更能容忍运动模糊和光照变化。该系统成功地应用于小型桌面的增强现实,但也不能处理大场景。Mei等 [120] 充分利用双目相机的信息冗余,结合了FAST角点,SIFT描述量,FAB-MAP [113] 等算法,可以在校园规模的环境内实时地跟踪摄像机。

实时三维跟踪针对增强现实应用 ,将遵循图橙色方框所注的技术路线。场景的三维模型是已知的:包括基于基准标志的实时三维跟踪,和基于点云的实时三维跟踪,系统的总体框架如下图所示。

CHIA K W, CHEOK A D, PRINCE S J D. Online 6 DOF augmented reality registration

from natural features[C]. ISMAR ’02: Proceedings of the 1st International Symposium on

Mixed and Augmented Reality. Washington, DC, USA: IEEE Computer Society, 2002: 305.