Multinomial Naive Bayes:用于多项式模型的Naive Bayes分类器

一、算法思路

多项式Naive Bayes分类器适用于离散特征分类(如文本分类中的字数)

多叉分布通常需要整数特征计数

不过,在实际应用中,分数计数(如 tf-idf)也可以起作用

二、官网API

官网API

导包:from sklearn.naive_bayes import MultinomialNB

class sklearn.naive_bayes.MultinomialNB(*, alpha=1.0, force_alpha='warn', fit_prior=True, class_prior=None)

这里的参数还是比较多的,具体的参数使用,可以根据官网给的demo进行学习,多动手尝试;这里就以一些常用的参数进行说明。

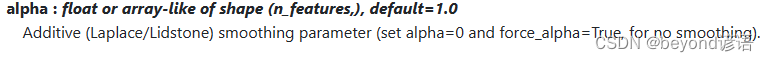

①平滑参数alpha

加法(拉普拉斯/利德斯通)平滑参数(设置 alpha=0 和 force_alpha=True 表示不平滑)

浮点数,默认为1.0

也可以传入array形式,array为各个特征值

具体官网详情如下:

使用方法

MultinomialNB(alpha=1.2)

或者

beyond = ['cat','dog']

multinomial = MultinomialNB(alpha=beyond)

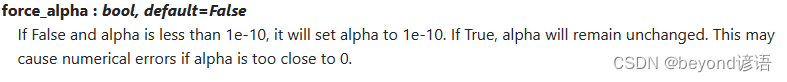

②force_alpha

如果为False,且alpha小于1e-10,则会将alpha设置为1e-10,默认值

如果为True,alpha将保持不变

如果alpha太接近0,可能会导致数字错误

具体官网详情如下:

使用方法

MultinomialNB(force_alpha=True)

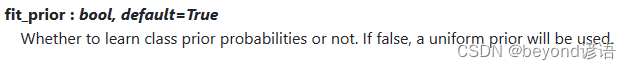

③fit_prior

是否学习类别先验概率。如果为False,将使用统一先验;默认值为True

具体官网详情如下:

使用方法

MultinomialNB(fit_prior=False)

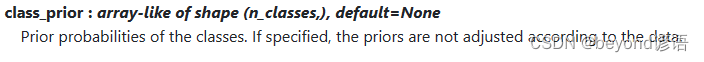

④类别先验概率class_prior

class_prior类别的先验概率;如果指定,则不会根据数据调整先验概率;默认值为None

具体官网详情如下:

使用方法

beyond = ['cat','dog']

multinomial = MultinomialNB(class_prior=beyond)

⑤最终构建模型

MultinomialNB(alpha=1.2,force_alpha=True,fit_prior=False)

三、代码实现

①导包

这里需要评估、训练、保存和加载模型,以下是一些必要的包,若导入过程报错,pip安装即可

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import joblib

%matplotlib inline

import seaborn as sns

from sklearn.preprocessing import LabelEncoder

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import MultinomialNB

from sklearn.metrics import confusion_matrix, classification_report, accuracy_score

②加载数据集

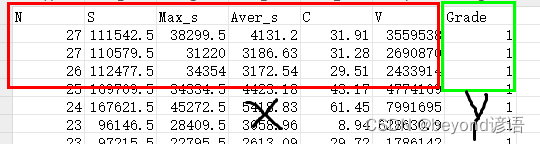

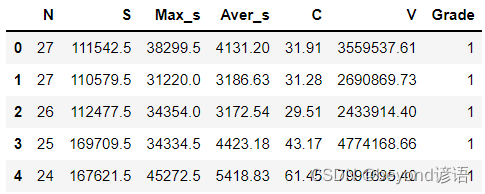

数据集可以自己简单整个,csv格式即可,我这里使用的是6个自变量X和1个因变量Y

fiber = pd.read_csv("./fiber.csv")

fiber.head(5) #展示下头5条数据信息

③划分数据集

前六列是自变量X,最后一列是因变量Y

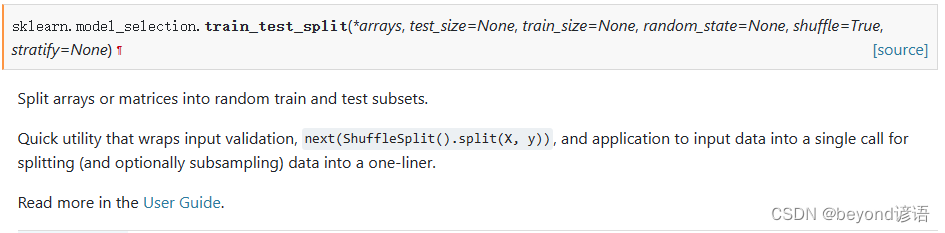

常用的划分数据集函数官网API:train_test_split

test_size:测试集数据所占比例

train_size:训练集数据所占比例

random_state:随机种子

shuffle:是否将数据进行打乱

因为我这里的数据集共48个,训练集0.75,测试集0.25,即训练集36个,测试集12个

X = fiber.drop(['Grade'], axis=1)

Y = fiber['Grade']

X_train, X_test, y_train, y_test = train_test_split(X,Y,train_size=0.75,test_size=0.25,random_state=42,shuffle=True)

print(X_train.shape) #(36,6)

print(y_train.shape) #(36,)

print(X_test.shape) #(12,6)

print(y_test.shape) #(12,)

④构建MultinomialNB模型

参数可以自己去尝试设置调整

multinomial = MultinomialNB(alpha=1.2,force_alpha=True,fit_prior=False)

⑤模型训练

就这么简单,一个fit函数就可以实现模型训练

multinomial.fit(X_train,y_train)

⑥模型评估

把测试集扔进去,得到预测的测试结果

y_pred = multinomial.predict(X_test)

看看预测结果和实际测试集结果是否一致,一致为1否则为0,取个平均值就是准确率

accuracy = np.mean(y_pred==y_test)

print(accuracy)

也可以通过score得分进行评估,计算的结果和思路都是一样的,都是看所有的数据集中模型猜对的概率,只不过这个score函数已经封装好了,当然传入的参数也不一样,需要导入accuracy_score才行,from sklearn.metrics import accuracy_score

score = multinomial.score(X_test,y_test)#得分

print(score)

⑦模型测试

拿到一条数据,使用训练好的模型进行评估

这里是六个自变量,我这里随机整个test = np.array([[16,18312.5,6614.5,2842.31,25.23,1147430.19]])

扔到模型里面得到预测结果,prediction = multinomial.predict(test)

看下预测结果是多少,是否和正确结果相同,print(prediction)

test = np.array([[16,18312.5,6614.5,2842.31,25.23,1147430.19]])

prediction = multinomial.predict(test)

print(prediction) #[2]

⑧保存模型

multinomial是模型名称,需要对应一致

后面的参数是保存模型的路径

joblib.dump(multinomial, './multinomial.model')#保存模型

⑨加载和使用模型

multinomial_yy = joblib.load('./multinomial.model')

test = np.array([[11,99498,5369,9045.27,28.47,3827588.56]])#随便找的一条数据

prediction = multinomial_yy.predict(test)#带入数据,预测一下

print(prediction) #[4]

完整代码

模型训练和评估,不包含⑧⑨。

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import joblib

%matplotlib inline

import seaborn as sns

from sklearn.preprocessing import LabelEncoder

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import MultinomialNB

from sklearn.metrics import confusion_matrix, classification_report, accuracy_score

fiber = pd.read_csv("./fiber.csv")

fiber.head(5) #展示下头5条数据信息

X = fiber.drop(['Grade'], axis=1)

Y = fiber['Grade']

X_train, X_test, y_train, y_test = train_test_split(X,Y,train_size=0.75,test_size=0.25,random_state=42,shuffle=True)

print(X_train.shape) #(36,6)

print(y_train.shape) #(36,)

print(X_test.shape) #(12,6)

print(y_test.shape) #(12,)

multinomial= MultinomialNB(alpha=1.2,force_alpha=True,fit_prior=False)

multinomial.fit(X_train,y_train)

y_pred = multinomial.predict(X_test)

accuracy = np.mean(y_pred==y_test)

print(accuracy)

score = multinomial.score(X_test,y_test)#得分

print(score)

test = np.array([[16,18312.5,6614.5,2842.31,25.23,1147430.19]])

prediction = multinomial.predict(test)

print(prediction) #[2]