谱域图卷积

一 图谱卷积的背景知识

经典卷积神经网络已在多个领域取得成功

- 图片分类

- 视觉语义问答

- 图片分割

- 目标检测

- 看图说话

- 视频处理

但是 经典卷积网络的局限性:无法处理图结构数据

经典卷积网络的局限:无法处理图结构数据

- 经典卷积网络处理图结构数据的局限性

- 只能处理固定输入维度的数据

- 局部输入数据必须有序

- 语音、图像、视频(规则结构)满足以上两点要求,但并不适用于图结构数据(非欧空间数据)

谱域图卷积 - 根据图谱理论和卷积定理,将数据由空域转换到谱域做处理

- 有较为坚实的理论基础

1.1 谱域图卷积实现思路

什么是卷积

根据卷积定理,两信号在空域(或者时域)的卷积的傅里叶变换等于这两信号在频域中的傅里叶变换的乘积。

卷积操作的意义:

- 将空域信号转换到频域,然后相乘

- 将相乘的结果在转换到空域

如何定义图上的傅里叶变换

基于图谱理论,图傅里叶变换

1.2 拉普拉斯矩阵

拉普拉斯矩阵的定义 – 符号设置

拉普拉斯矩阵的定义:度矩阵减邻接矩阵

拉普拉斯矩阵是对称半正定矩阵

作为对称半正定矩阵,拉普拉斯矩阵有如下性质:

- n阶对称矩阵一定有n个线性无关的特征向量

- 对称矩阵的不同特征值对应的特征向量相互正交,这些正交的特征向量构成的矩阵为正交矩阵

- 实对称矩阵的特征向量一定是实向量

- 半正定矩阵的特征值一定非负

拉普拉斯矩阵的谱分解

特征分解又成谱分解,是将矩阵分解为由其特征值和特征向量表示的矩阵之积的方法

n阶对称矩阵一定有n个线性无关的特征向量(对称矩阵性质)。n维线性空间中的n个线性无关的向量都可以构成他的一组基。(矩阵论知识)

拉普拉斯矩阵的n个特征向量都是线性无关的,他们是n维空间中的一组基。

对称矩阵的不同特征值对应的特征向量相互正交,这些正交的特征向量构成的矩阵为正交矩阵(对称矩阵的性质)

拉普拉斯矩阵的n个特征向量是n维空间中的一组标准正交基

结论:拉普拉斯矩阵是图上的一种拉普拉斯算子。

在欧式空间中,二维的拉普拉斯算子可以理解为中心节点与周围节点的差值,然后求和。

类似的在图上的拉普拉斯算子可以定义如下

结论:拉普拉斯矩阵是图上的一种拉普拉斯算子

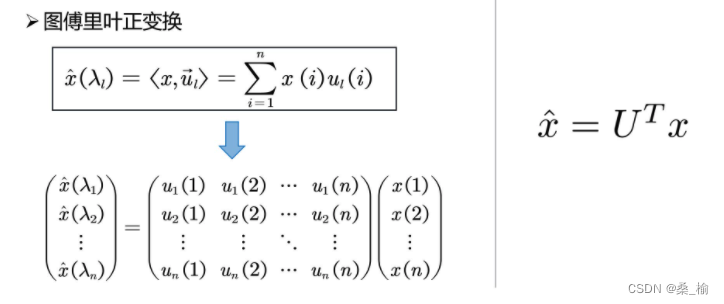

1.3 图傅里叶变换

图上的信号一般表达为一个向量。假设有n个节点,图上的节点记为:

每个节点上有一个信号值,类似于图像上的像素值。i节点上的值为x(i)= xi

傅里叶变换公式:一个是连续的,一个是离散的

傅里叶变换中不同频率的余弦函数可视为基函数,其傅里叶系数表示基的振幅。

傅里叶反变换的本质是:把任意一个函数表示成了若干个正交基函数的线性组合

傅里叶正变换的本质是:求线性组合的系数,具体做法是由原函数和基函数的共轭的内积求得。

傅里叶变换,实际上使用拉普拉斯矩阵的特征向量,作为图傅里叶变换的基函数,任意图上的信号可以表示为:

为什么使用拉普拉斯的特征向量作为基

经典傅里叶变换有如下规律:傅里叶变换的基函数是拉普拉斯算子的本征函数

又因为拉普拉斯矩阵就是图上的拉普拉斯算子,所以,类似的,图傅里叶变换的基函数即为图拉普拉斯矩阵的特征向量

1.4 卷积定理

将两信号分别视为输入信号和卷积核,那么卷积操作可以定义为:

- 将空域信号转换到频域,然后相乘

- 将相乘的结果在转换到空域

二 三个经典图谱卷积模型

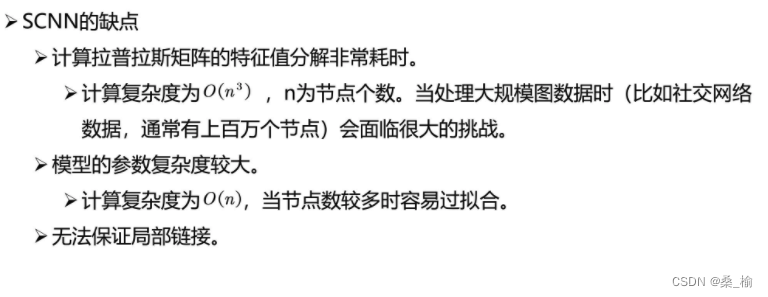

SCNN

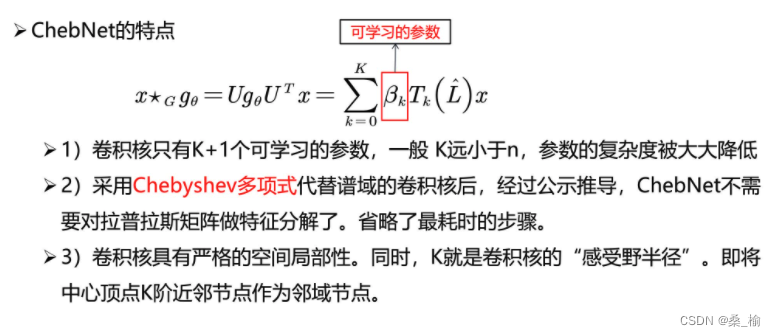

ChebNet

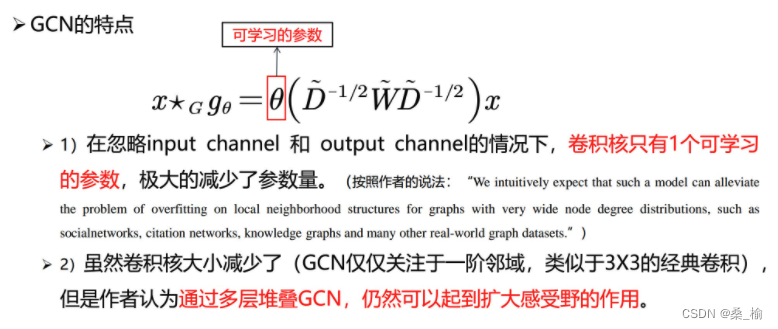

GCN