Y. Ueda, H. Misawa, T. Koga, N. Suetake and E. Uchino, “HUE-Preserving Color Contrast Enhancement Method Without Gamut Problem by Using Histogram Specification,” 2018 25th IEEE International Conference on Image Processing (ICIP), Athens, Greece, 2018, pp. 1123-1127, doi: 10.1109/ICIP.2018.8451308.

- 这是CCF C类会议ICIP的一篇传统方法进行对比度增强的论文,介绍了一个HUE-Preserving空间,挺有意思的

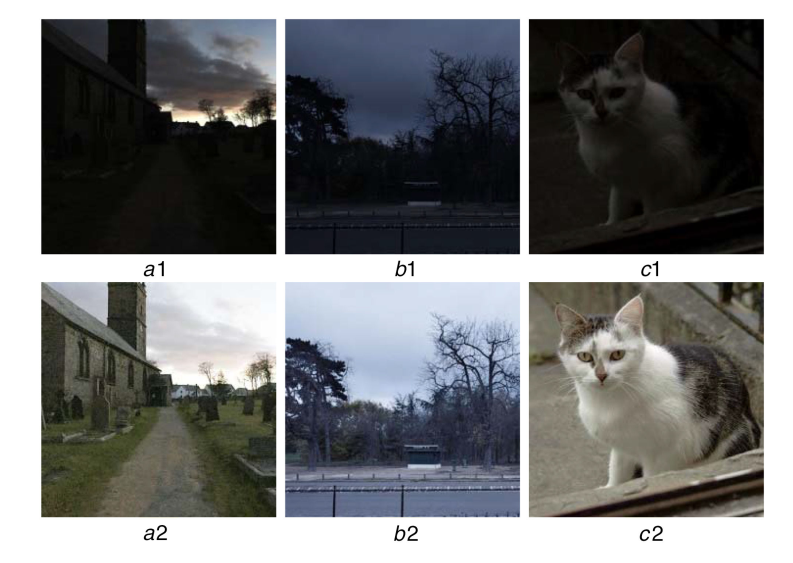

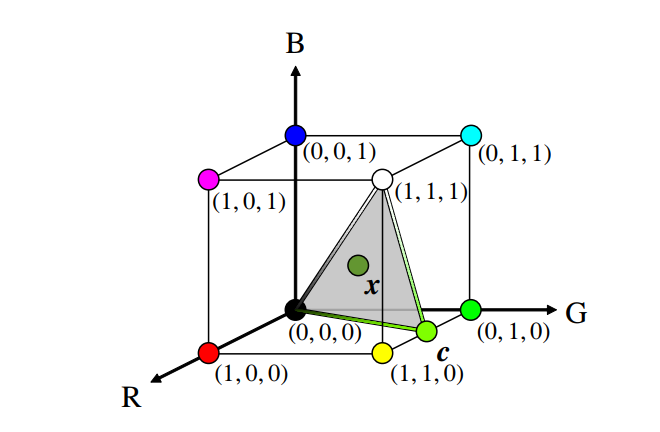

- 如下图所示,文章首先对任意一个RGB像素值求出其饱和值c,即图中的c点,按如下公式可求出c点的rgb坐标(其中R-G-B的点不存在饱和值)

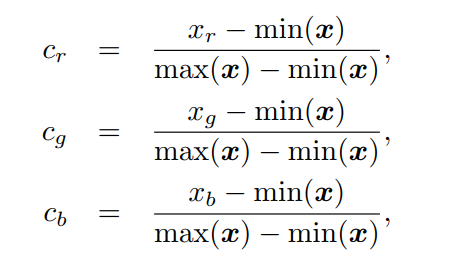

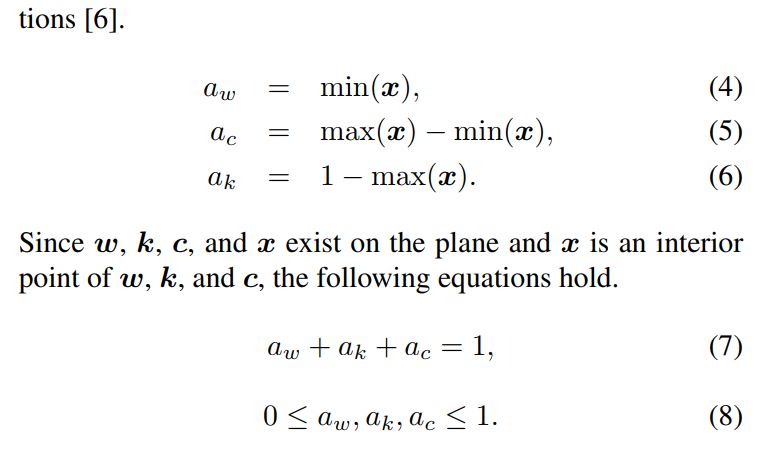

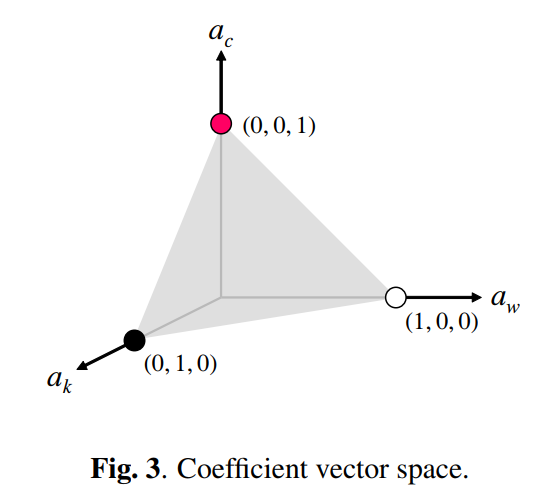

- 根据黑点 ( 0 , 0 , 0 ) (0,0,0) (0,0,0),白点 ( 1 , 1 , 1 ) (1,1,1) (1,1,1)和 c c c点可以求得一个平面,从而可以建立起一个平面坐标系并表示出 x x x点在平面坐标系中的坐标。本来平面坐标系只需要两个向量来表示,可以直接选择白点 ( 1 , 1 , 1 ) (1,1,1) (1,1,1)和 c c c点作为两个向量,从而将 x x x点表示为 x = a w w + a c c x=a_ww+a_cc x=aww+acc,但 x x x在这样的坐标系下可能落到RGB立方体外面去,需要加限制。既然黑点的坐标值是 ( 0 , 0 , 0 ) (0,0,0) (0,0,0),那么可以借助黑点来设置第三个变量,建立如下表达式和约束:

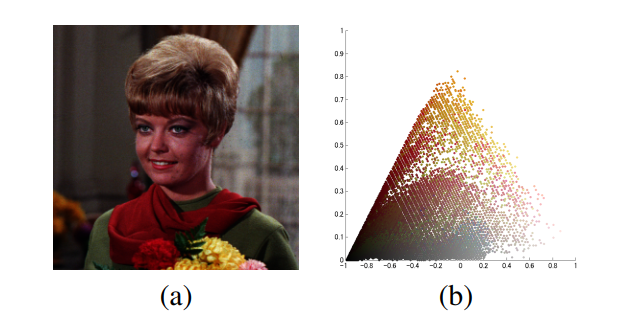

- 到这里为止,可以将所有的像素点转化为其所在hue平面的坐标 ( a w , a k , a c ) (a_w,a_k,a_c) (aw,ak,ac),即使这些像素点并不落在RGB空间的同一平面。由于这些新的坐标点满足 a w + a k + a c = 1 a_w+a_k+a_c=1 aw+ak+ac=1,他们落在新坐标系的同一平面上,如下图所示。然后可以把这些点在这个平面上的为止画出来,以 a w − a k a_w-a_k aw−ak为 x x x轴:

- 可以看到,图片比较暗,对比度比较差的时候,点集中落在平面的左下角。

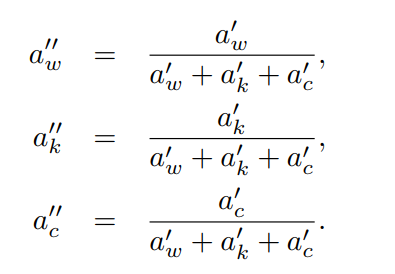

- 为了拉伸图像对比度,可以对 ( a w , a k , a c ) (a_w,a_k,a_c) (aw,ak,ac)三个坐标的分布分别进行直方图均衡化,再归一化使得新的坐标仍然满足和为1,从而不会落到平面外面去(因此保证了像素点增强前后落在同一hue平面,也即色调不变):

- 因此,总结一下,完整的流程就是,先从RGB坐标转为 ( a w , a k , a c ) (a_w,a_k,a_c) (aw,ak,ac)坐标,然后对 ( a w , a k , a c ) (a_w,a_k,a_c) (aw,ak,ac)坐标进行直方图均衡化和归一化,再转回RGB坐标即可得到增强结果。

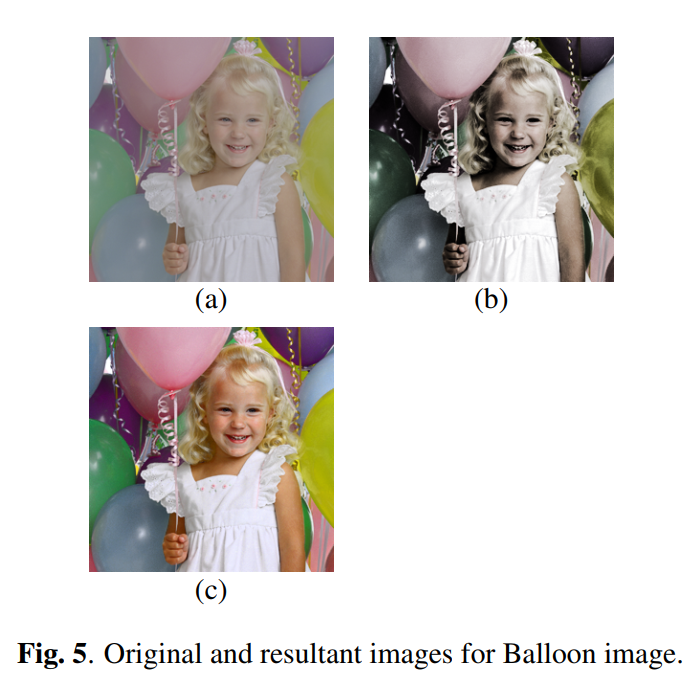

- 可以看到,c是本方法的增强结果,还是不错的。

- 启发是,先转换到一另一个空间,增强后通过在这个空间下的归一化使得颜色(或其他性质)保持不变的idea。

X. Wei, J. Sun, Y. Cai, A. Ma and W. Su, “Zero-DCE with HSV loss for Low-Light Image Enhancement,” 2022 7th International Conference on Image, Vision and Computing (ICIVC), Xi’an, China, 2022, pp. 537-541, doi: 10.1109/ICIVC55077.2022.9887031.

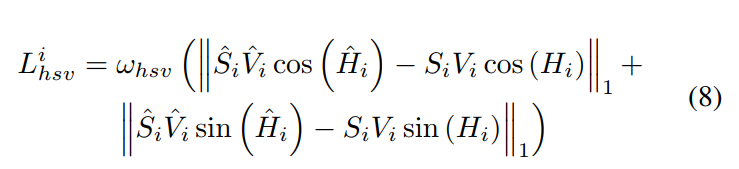

- 这是中国传媒大学发表在ICIVC2022上的文章,提出了一个HSV损失作为额外的损失项,如下:

先将增强结果转到HSV域,再计算的HSV损失,其他的都没有变 - 实验结果一般,看不太出差别,PSNR也没有什么变化,增加了0.22,SSIM不变

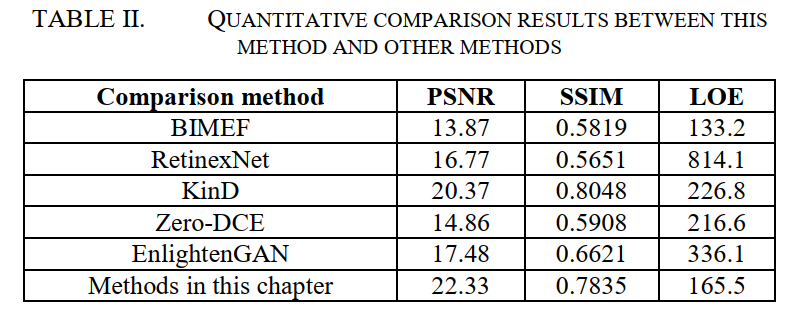

K. Liu, “The Asymmetric Two Branch Network for Low Illumination Image Enhancement,” 2023 International Conference on Distributed Computing and Electrical Circuits and Electronics (ICDCECE), Ballar, India, 2023, pp. 1-6, doi: 10.1109/ICDCECE57866.2023.10151091.

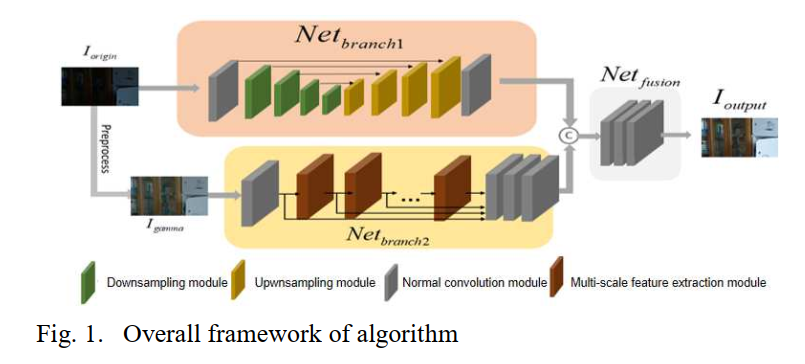

- 这是ICDCECE 2023的一篇有监督暗图增强的论文

- 网络结构如图所示。就是gamma校正后的图像和原图分别送进两个网络提取特征,然后进行concatenate,再得到最终的输出。这里的multi-scale feature extraction module指的是不同dilation rate的卷积之后concate到一起。

- 损失函数是三个损失的加权和,一个是mse损失,一个是GAN的对抗损失,一个是vgg的perceptual 损失

- 实验结果就是和一些方法比较了PSNR,还不错挺高的

- LOE最近看到好多论文在比较,下次可以试试

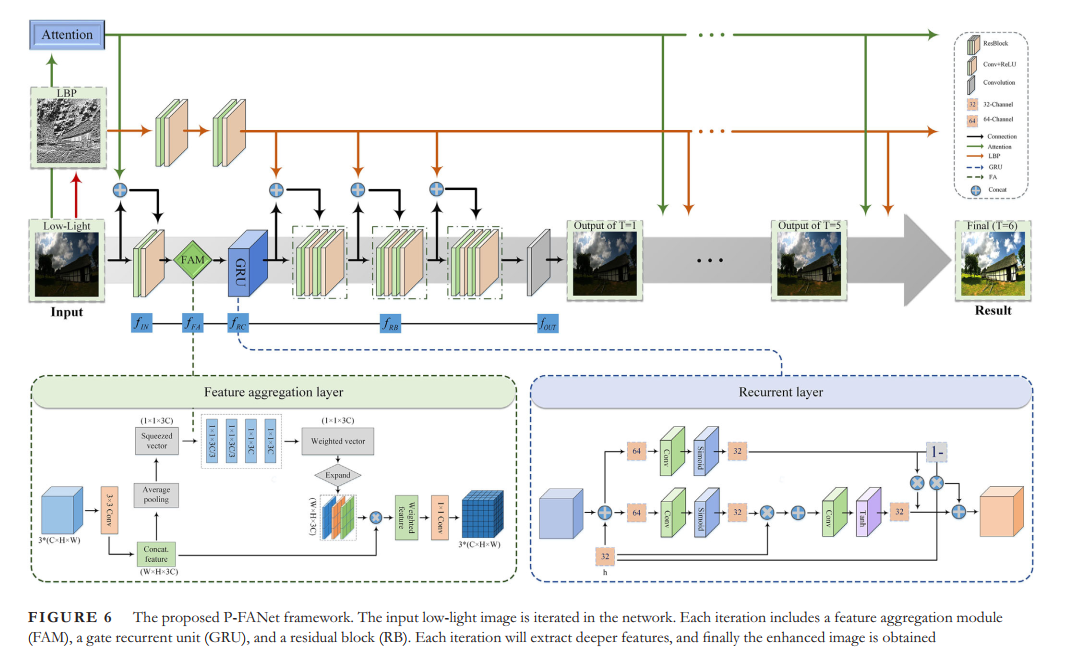

Yu, N., Li, J., Hua, Z. LBP-based progressive feature aggregation network for low-light image enhancement. IET Image Process. 2022; 16: 535– 553. https://doi.org/10.1049/ipr2.12369

- 这是CCF C类期刊 IET Image Processing的一篇有监督暗图增强的论文,网络结构如下所示,十分复杂:

- 这个复杂的网络结构就不展开细说了,太麻烦了。启发是三点,一点是用了recurrent的方式去progressively地增强图像,一点是提取了图片的LBP特征(local binary pattern,他对亮度不敏感,也就是说增强前后图片的LBP特征变化不大)作为辅助信息,一点是在progressive的过程中,有一些不变的信息送到了各个阶段当中(如LBP特征和attention feature)。

- 损失函数用的是SSIM损失

- 实验结果看起来还不错:

Al-Ameen, Z. (2019), Nighttime image enhancement using a new illumination boost algorithm. IET Image Processing, 13: 1314-1320. https://doi.org/10.1049/iet-ipr.2018.6585

- 这同样也是IET Image Processing 期刊2019年的一篇传统方法做暗图增强的论文

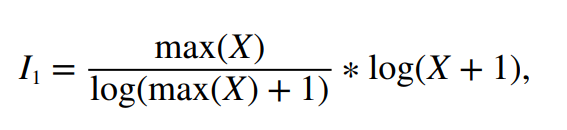

- 首先是这样一个公式,它是基于人眼视觉特性设计的,可以使得low- and mid-intensities 被enhance,同时避免high-intensities被过度增强。从公式看,其实就是对图像的亮度取对数后归一化。

- 第二个公式用于衰减高强度部分,同时修改局部对比度:

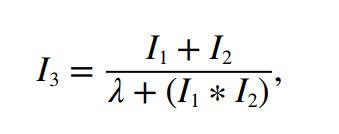

- 第三个公式可以融合前两个图片:

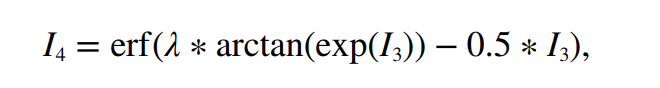

- 然后用一个双曲正切函数的积分函数(s形曲线)来调整亮度和对比度:

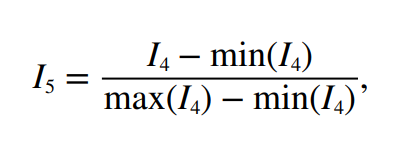

- 最后归一化:

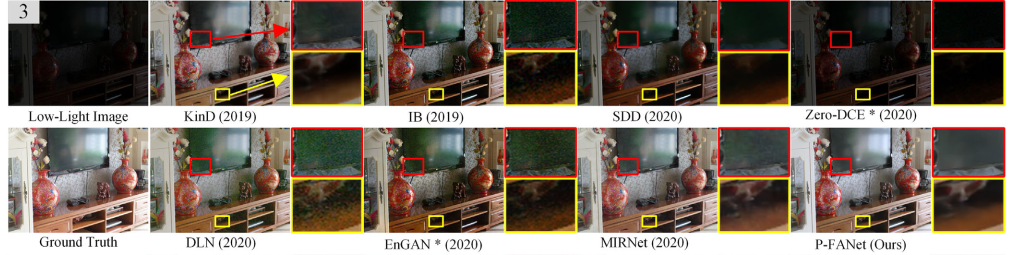

- 增强结果还不错: