reduce(func):通过 func 函数聚集 RDD 中的所有元素,这个功能必须是可 交换且可并联的

scala> val rdd1 = sc.makeRDD(1 to 10,2)

rdd1: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[85] at

makeRDD at <console>:24

scala> rdd1.reduce(_+_)

res50: Int = 55

scala> val rdd2 = sc.makeRDD(Array(("a",1),("a",3),("c",3),("d",5)))

rdd2: org.apache.spark.rdd.RDD[(String, Int)] =

ParallelCollectionRDD[86] at makeRDD at <console>:24

scala> rdd2.reduce((x,y)=>(x._1 + y._1,x._2 + y._2))

res51: (String, Int) = (adca,12)

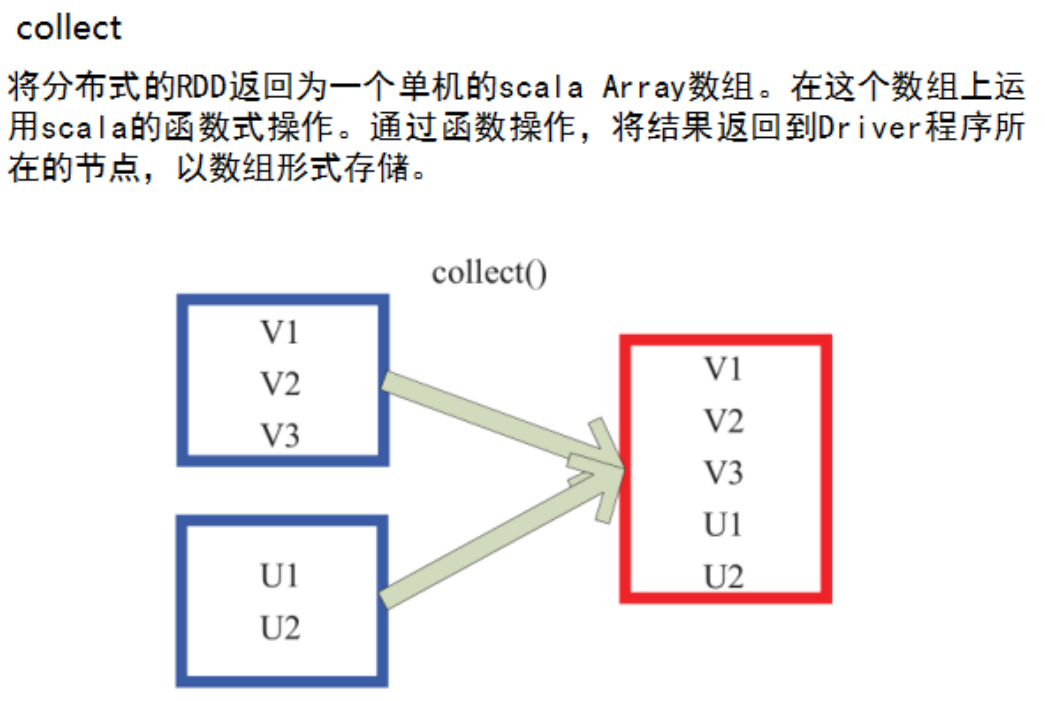

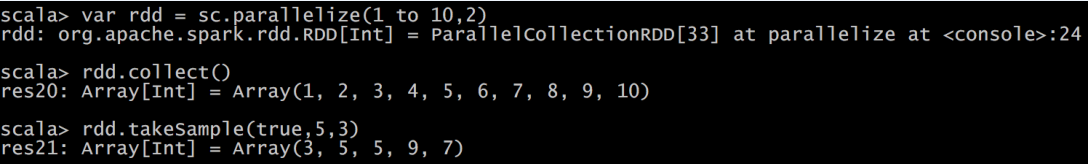

collect() :在驱动程序中,以数组的形式返回数据集的所有元素

count() 返回 RDD 的元素个数

first() 返回 RDD 的第一个元素(类似于take(1)

take(n) 返回一个由数据集的前 n 个元素组成的数组

takeSample(withReplacement,num,[seed])

返回一个数组,该数组由从数据集中随的 机采样的 num 个元素组成,可以选择是否用随机数替换不足的部分,seed 用于指定随机数生成器种子

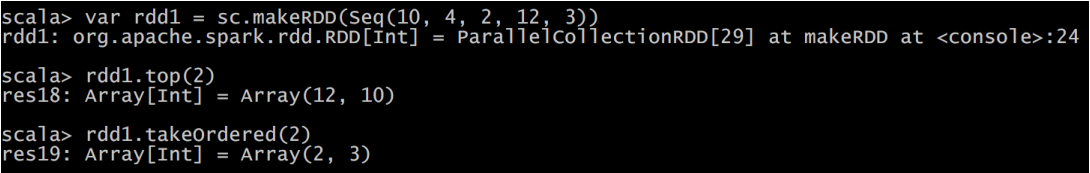

takeOrdered(n) 返回前几个的排序

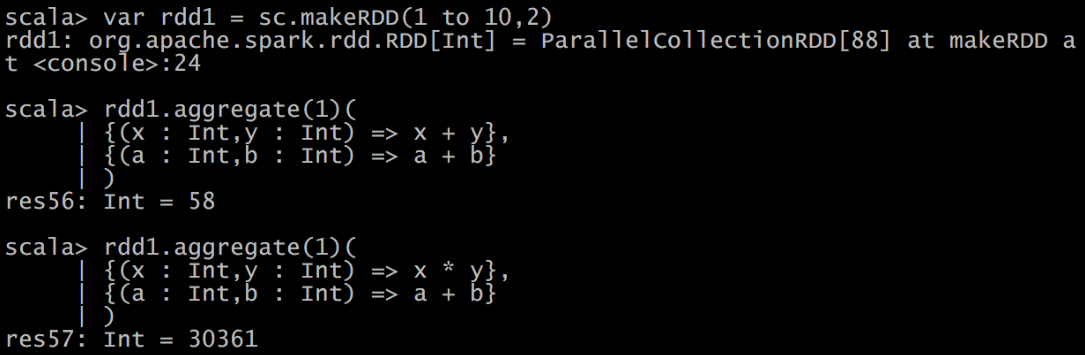

aggregate (zeroValue: U)(seqOp:(U, T) ⇒ U, combOp: (U, U) ⇒ U)

aggregate 函数将每个分区里面的元素过 通过 seqOp 和初始值 进行聚合,然后用 用 combine 函数将每个分区的结果和初始值(zeroValue) 进行 combine 操作。这个函数最终返回的类型不需要和RDD 中元素类型一致。

fold(num)(func) 折叠操作,aggregate 的简化操作,seqop 和 combop 一样。

scala> var rdd1 = sc.makeRDD(1 to 4,2)

rdd1: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[90] at

makeRDD at <console>:24

scala> rdd1.aggregate(1)(

| {(x : Int,y : Int) => x + y},

| {(a : Int,b : Int) => a + b}

| )

res59: Int = 13

scala> rdd1.fold(1)(_+_)

res60: Int = 13

saveAsTextFile(path)

将数据集的元素以 textfile 的形式保存到 到 HDFS 文件系统或者其他支持的文件系统,对于每个元素,Spark 将会调用 用 toString 方法,将它装换为文件中的文本

saveAsSequenceFile(path)

将数据集中的元素以 Hadoopsequencefile 的格式保存到指定的目录使 下,可以使 HDFS 或者其他 Hadoop 支持的文件系统。

saveAsObjectFile(path)

用于将 RDD 中的元素序列化成对象,存储到文件中。

countByKey()

针对(K,V) 类型的 RDD ,返回一个(K,Int)的 的 map ,表示每一个 key 对应的元素个数。

foreach(func)

在数据集的每一个元素上,运行函数func 进行更新。

scala> var rdd = sc.makeRDD(1 to 10,2) rdd: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[107] at makeRDD at <console>:24 scala> var sum = sc.accumulator(0) warning: there were two deprecation warnings; re-run with - deprecation for details sum: org.apache.spark.Accumulator[Int] = 0 scala> rdd.foreach(sum+=_) scala> sum.value res68: Int = 55 scala> rdd.collect().foreach(println) 1 2 3 4 5 6 7 8 9 10