1.多传感器融合的体系结构

在多传感器融合中,按照对原始数据处理方法的不同,多传感器融合系统的体系结构可以分为三种:集中式,分布式和混合式(混合式又分为有反馈结构和无反馈结构)。

- 集中式融合:将各传感器获得的原始数据直接送到CPU进行融合处理,可实现实时融合。由于各传感器没有自己的处理器,只有将数据都传到中央处理器中,然后实现实时融合,其特点是结构简单,数据处理精度较高,融合中心的计算和通信负载过重,系统容错性差,实时性差,早期开发常用这种方式。

- 分布式融合:各个独立传感器使用各自独有的处理器处理数据,然后将结果送入到中央处理器中进行融合处理,优点是带宽要求低,计算快,系统可靠性和容错性高,局部失效不影响全局,缺点就是各传感器模块体积大,成本高,经费充裕可以考虑。

- 混合式融合,是集中式和分布式的混合应用,即部分传感器采用集中式融合架构,其余传感器采用分布式融合架构。 比如毫米波雷达自带处理器,智能相机也自带处理器,其他传感器不带处理器,有处理器的将数据处理完以后传送集中处理单元,没有处理器的直接把原始数据发给集中处理单元,该融合方式结合了上面两种结构的优点,也是绝大多数使用的情况。

2.多传感器融合的分类

多传感器融合的定义:把分布在不同位置的多个同类或不同类传感器所提供的局部数据资源加以综合,采用计算机技术对其进行分析,消除多传感器信息之间可能存在的冗余和矛盾,加以互补,降低其不确实性,获得被测对象的一致性解释与描述,从而提高系统决策、规划、反应的快速性和准确性,使系统获得更充分的信息。

根据传感器信息融合在不同层级上出现,可以分为数据级融合、特征级融合、决策级融合。

(1)数据级融合。针对传感器采集的数据,依赖于传感器类型,进行同类数据的融合。数据级的融合要处理的数据都是在相同类别的传感器下采集,所以数据融合不能处理异构数据。如相机和激光雷达的融合,需要将激光雷达的点云数据(x,y,z)通过标定参数投影到图像上,实现图像和深度的融合。

(2)特征级融合。先把各个传感器获得的原始数据进行初步特征提取,提取的特征信息作为预处理数据,进行分类、聚类和综合,产生特征向量,然后再采用一些基于特征融合的方法融合这些特征向量,最终数据基于融合特征的进行目标的感知输出。这是面向目标对象特征的融合。如在图像数据的融合中,可以采用边沿的特征信息,来代替全部数据信息。

(3)决策级融合。决策级融合,指的是根据特征级融合所得到的数据特征,进行 一定的判别、分类,以及简单的逻辑运算,根据应用需求进行较高级的决策,是高级的融合。决策级融合是面向应用的融合。

3.多传感器融合的同步

多传感器融合的同步主要涉及硬同步、软同步、时间同步、空间同步等概念。

①硬件同步、硬同步:使用同一种硬件同时发布触发采集命令,实现各传感器采集、测量的时间同步。做到同一时刻采集相同的信息。

②软件同步:时间同步、空间同步。

③时间同步、时间戳同步、软同步:通过统一的主机给各个传感器提供基准时间,各传感器根据已校准后的各自时间为各自独立采集的数据加上时间戳信息,可以做到所有传感器时间戳同步,但由于各个传感器各自采用频率不一致,无法保证同一时刻采集相同的信息,这时通常采用“内插外推”得到同一时刻的信息。

④空间同步:将不同传感器坐标系的测量值转换到同一个坐标系中,其中激光传感器在高速移动的情况下需要考虑当前速度下的帧内位移校准。

4.多传感器融合的对比

多传感器融合按数据级融合、特征级融合、决策级融合也简称为前融合、中融合与后融合。

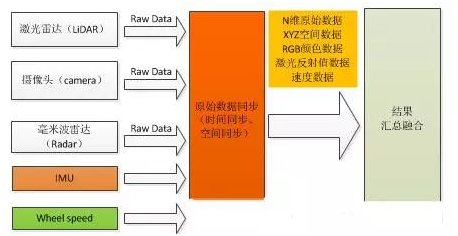

- 前融合算法,也就是数据级融合

- 通常意义上只有一个感知的算法。对融合后的多维综合数据进行感知。

- 在原始层把数据都融合在一起,融合后的数据类似一个Super传感器,而且这个传感器不仅有能力可以看到红外线,还有能力可以看到摄像头或者RGB,也有能力看到Lidar的三维信息,就好比是一双超级眼睛。在这双超级眼睛上面,开发自己的感知算法,最后会输出一个结果层的物体。

前融合试图把相机拍摄得到图像上的像素,激光雷达的点云,毫米波雷达拟合过的一些特征信息(如果用4D毫米就是4D毫米波的点云),把这些信息去做原始数据的时空同步,然后再结合其他的信息,最后得到了一个多维度的Raw Data,再用感知算法去做分类、分隔、识别、跟踪等。其特点是数据融合的阶段早,使得数据更有关联性,数据的损失也比较少,但由于像素级的前融合非常难做,主要难点有如下几点:

- 点云数据与像素去做匹配的时候,时空同步难度很大;

- 对数据处理的实时性要求高,导致算力消耗巨大;

- 不同的传感器硬件系统时间是不一样的,很难知道激光雷达的某一帧到底实际严格意义上对应了摄像头或者毫米波雷达的哪一帧,而且存在运动补偿的误差。

- 场景的适用性差,也就是即使做了非常准确的标定,一旦换硬件或者换车型很多流程又要重新来一遍。

- 中融合算法,也就是特征级融合

中融合这个提法,在比较书面的场合中使用的并不多,多数时候称之为特征级融合。

所谓中融合也就是属于中间层次级融合,先从每个传感器提供的原始观测数据中提取代表性的特征,再把这些特征融合成单一的特征向量;其中选择合适的特征进行融合是关键;特征信息包括边缘、方向、速度、形状等。

特征级融合可划分为两大类:目标状态融合与目标特性融合。

目标状态融合:主要应用于多传感器的目标跟踪领域;融合系统首先对传感器数据进行预处理以完成数据配准,在数据配准之后,融合处理主要实现参数关联和状态估计。

目标特性融合:就是特征层联合识别,实质就是模式识别问题;在融合前必须先对特征进行关联处理,再对特征矢量分类成有意义的组合。

在融合的三个层次中,特征级融合发展较为完善,由于在特征层已建立了一整套的行之有效的特征关联技术,可以保证融合信息的一致性;此级别融合对计算量和通信带宽要求相对降低,但由于部分数据的舍弃使其准确性也有所下降。

目前逐渐称为主流模型的BEV就属于典型的特征级融合,首先在BEV算法里面是用特征级的融合,然后再把它映射到统一的坐标下,即BEV的坐标体系里面。

然后去做融合,融合之后再进行训练学习分类,最终后融合的特征可以保留,那么同时它又不像是前融合阶段要求高精度和高算力,所以它是一个相对折中的一种方法。

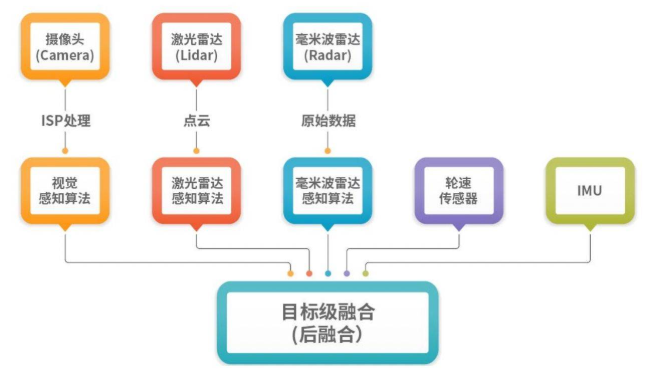

- 后融合算法,也就是目标级融合

1、每个传感器各自独立处理生成的目标数据。

2、每个传感器都有自己独立的感知,比如激光雷达有激光雷达的感知,摄像头有摄像头的感知,毫米波雷达也会做出自己的感知。

3、当所有传感器完成目标数据生成后,再由主处理器进行数据融合。

5.多传感器融合的误差建模与补偿技术

典型的有对温度敏感的IMU传感器温度误差建模及温补、点云畸变补偿、相机图像的校正。

6.多传感器融合的特点

那么,多传感器融合技术有哪些优点呢?为什么自动驾驶要选择多传感器融合技术呢?

多传感器数据融合比单一传感器信息有如下优点,即容错性、互补性、实时性、经济性,所以逐步得到推广应用。