目录

ECANet简介

Efficient Channel Attention Module 简称 ECA,2020年 Qilong Wang等人提出的一种 高效通道注意力(ECA)模块 ;

提出了一种 不降维的局部跨通道交互策略 ,有效避免了降维对于通道注意力学习效果的影响 ;

该模块只涉及少数几个 参数,但具有明显的 效果增益 ;

适当的 跨通道交互 可以在保持 性能 的同时 显著降低模型的复杂性。

研究表明,SENet采用的 降维操作 会对通道注意力的预测产生 负面影响,且获取依赖关系效率低且不必要 ;基于此,提出了一种针对CNN的高效通道注意力(ECA)模块,避免了降维,有效地实现了 跨通道交互 ;

特点:

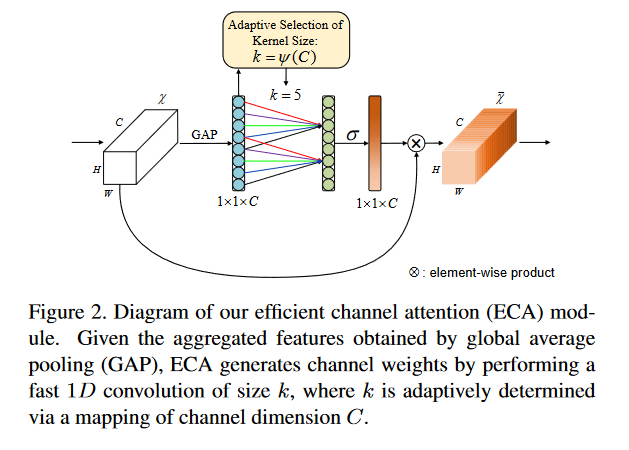

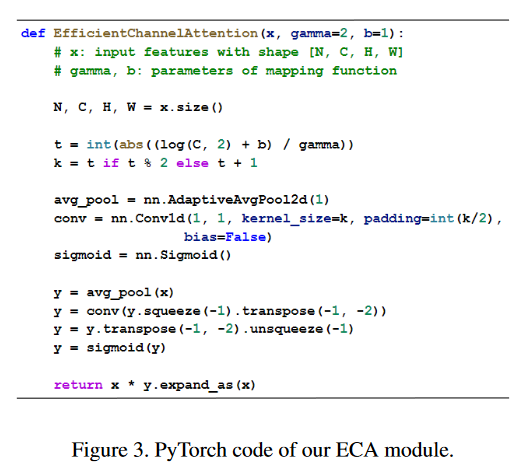

(1)通过大小为 k 的快速一维卷积实现,其中核大小k表示 局部跨通道交互 的覆盖范围,即有多少领域参与了一个通道的注意预测 ;

(2)为了避免通过交叉验证手动调整 k,开发了一种 自适应方法 确定 k,其中跨通道交互的覆盖范围 (即核大小k) 与通道维度成比例 ;

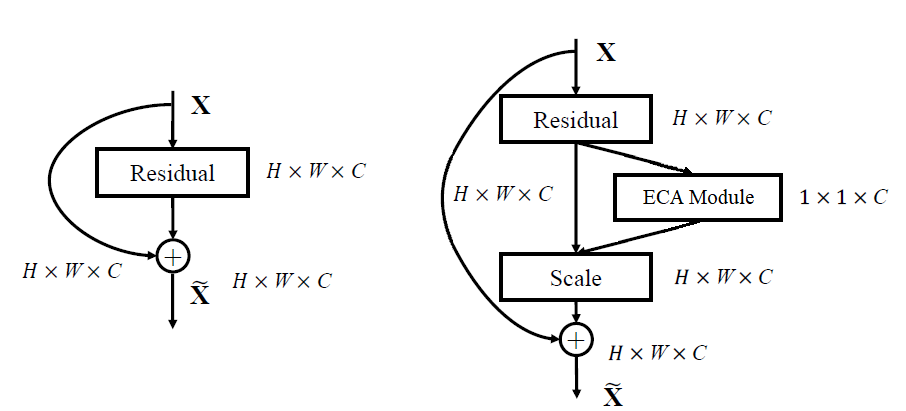

ECA Module

注意力模块的开发 大致可以分为两个方向:

(1)增强特征聚合;

(2)通道与空间注意的结合 ;

ECA模块使用不降维的GAP聚合卷积特征后,首先自适应确定核大小k,然后进行一维卷积,再进行 Sigmoid 函数学习 channel attention ;

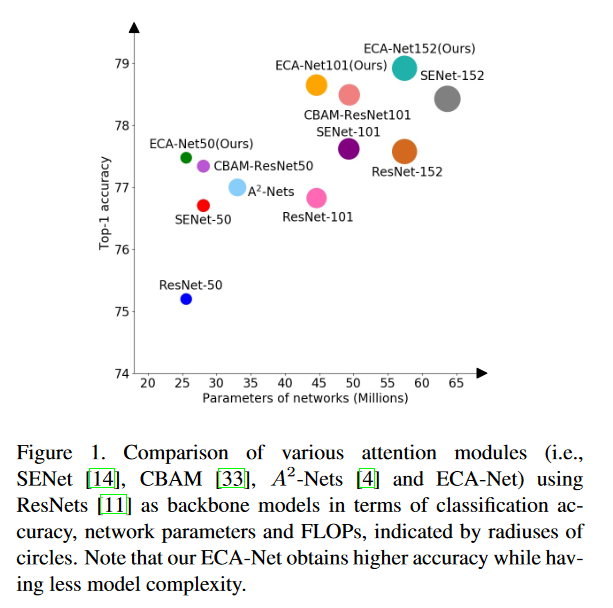

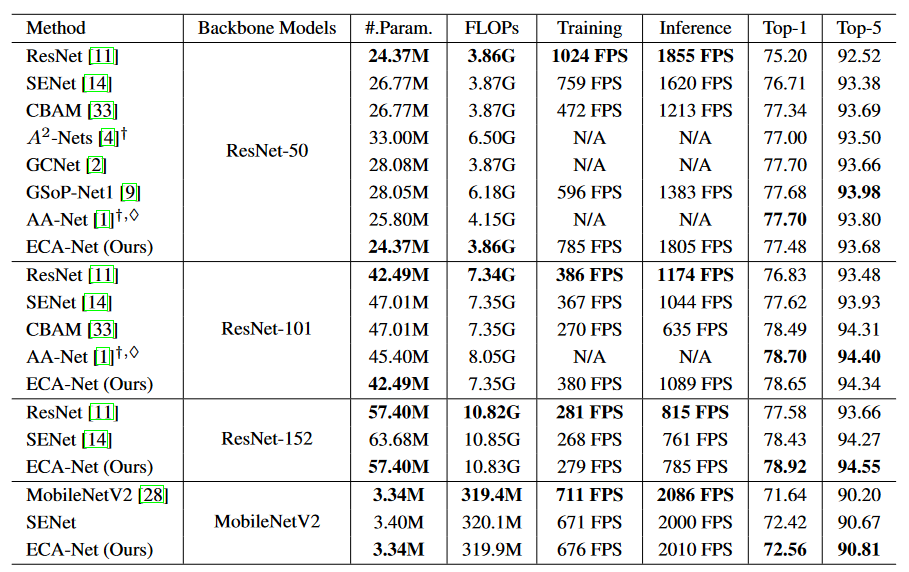

ECANet 性能对比

分别使用 ResNet 、ResNet+SENet 、ResNet+CBAM 、 ResNet+ECANet 进行实验得到 模型参数量-准确率 结果 :

实验表明 ECANet 性能超越了 SENet和CBAM。