先来看几个名词,有些小伙伴会比较懵,弄懂了基础概念,一些衍生的新名词理解起来就相对容易很多。ML,DL,NLP,这三个词不新鲜,已经应用很多年。

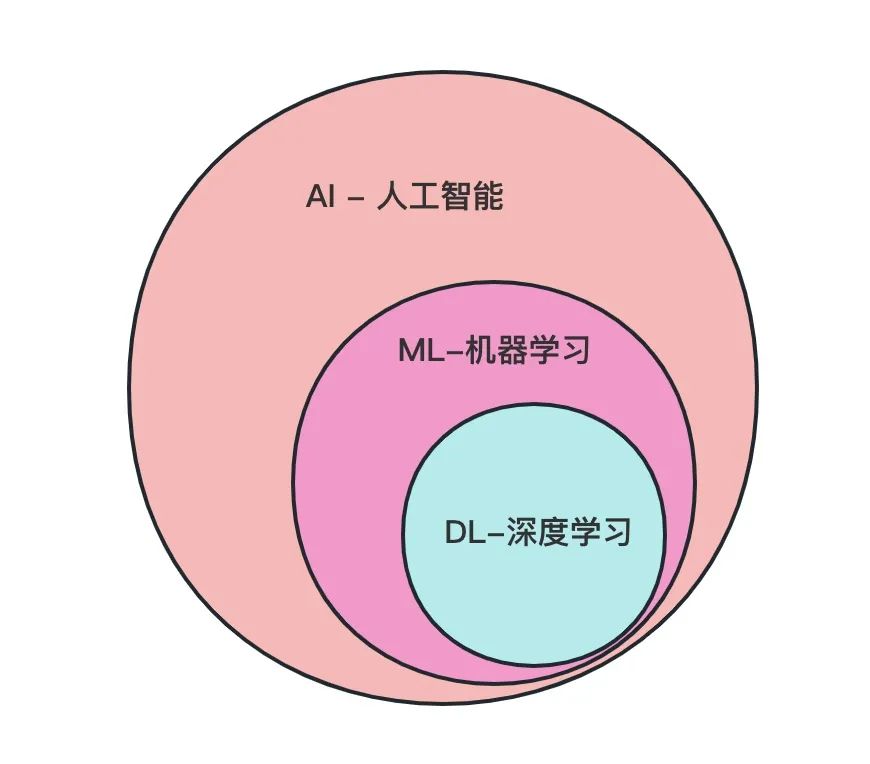

ML - Machine Learning,机器学习。AI 的一个分支,关注使用数据让计算机系统学习的方法。

DL - Deep Learning,深度学习。ML 的一个分支,使用神经网络和大量数据进行学习的方法,目前最成功的 ML 方法。

NLP -Natural Language Processing,是自然语言处理的缩写,是人工智能和语言学领域的一个重要方向,目前很多产品的交互都是基于自然语言的输入,都需要NLP技术作为入口与后端复杂的服务交互。

再看几个新名词,算是近几年里新生的,也都是在ML、DL领域长期深耕之后长出的果实。

LLM - Large Language Model,大规模语言模型的统称,它也是在DL深度学习技术之下的产出物。

GPT - Generative Pre-trained Transformer,GPT是一个基于DL的预训练语言模型,后面携带的数字标记为版本,比如GPT-1,GPT-2,GPT-3,GPT-3.5,最新对外版本是GPT-4。可以看作是LLM下的具体技术架构实现。

ChatGPT,是由OpenAI公司开发的一个基于GPT架构的产品,同类似的产品还是Google公司的Bard,Anthropic公司的Claude,Baidu公司的文心一言

知道自己在哪

一家公司承担做整个技术链条上的所有模块是相当困难的,各自专注自己领域,再对外提供服务,再组合起来形成新(创新性的)技术,比如iPhone里的很多技术并不是自己原创的,而是再次组合之后,整体形成的创新。我们来按链条的方式拆解一下AI领域:

上游,提供底层基础服务,芯片、算力、数据等,比如NVIDIA等

中游,搞大小模型算法的,比如各家的大模型、不同特定领域的算法

下游,做面向用户的应用开发,各种基于模型之上的搭建的应用,常见的套壳程序,基于 ChatGPT 的 New Bing等