官网实时更新版 alphapose 配置运行 win11

一、项目获取

由于官网项目持续在更新中,项目又没有打tag,这里是fork的一份

官网github地址(Alphapose):

链接: https://github.com/MVIG-SJTU/AlphaPose/tree/master

fork的当前配置 下的版本:

链接: 当前配置对应版本

二、环境配置

1.需要先安装vs2019,此处略过

2.第一步: conda中创建虚拟环境

conda create -n alphapose python=3.7 -y

3.cuda 11.3 ,link

4.torch 1.10.0 cu113 , link

三、安装依赖项(总之就是提示缺啥就安啥,安装不了就百度)

pip install cython

…

…

pip install cython_bbox

如果 cython_bbox 安装不成功

python -m pip install git+https://github.com/yanfengliu/cython_bbox.git

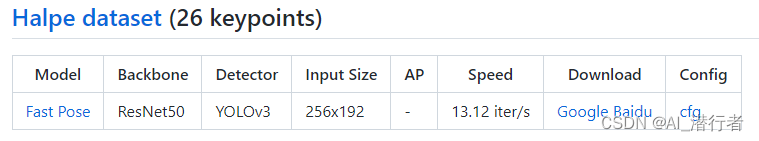

四、下载对应的模型

1、根据需求自己去该链接下载

https://github.com/renyuehe/fork-AlphaPose/blob/master/docs/MODEL_ZOO.md

2、例子

-

下载权重 yolov3-spp.weights

放在 Alphapose/detector/yolo/data -

下载权重 halpe26_fast_res50_256x192.pth

放到 Alphapose/pretrained_models -

下完成后根目录下conda虚拟环境下命令行执行代码

python scripts/demo_inference.py --cfg configs/halpe_26/resnet/256x192_res50_lr1e-3_1x.yaml --checkpoint pretrained_models/halpe26_fast_res50_256x192.pth --indir examples/demo/ --save_img

结果默认保存路径在examples/res/

学习版本 alphapose 配置运行 win11

一、项目获取

https://github.com/Amanbhandula/AlphaPose

二、环境配置

1.conda中创建虚拟环境

conda create -n alphapose-simple python=3.7 -y

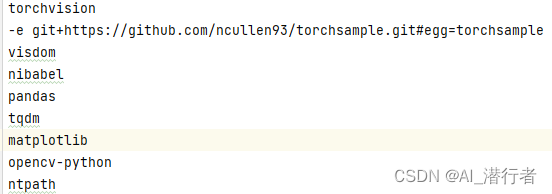

2.在 requirements.txt 列表中逐个实用 pip 安装

3.如果 cv2 无函数提示

对应虚拟环境/site-packages/cv2/cv2.pyd 复制一份到 site-packages 文件夹下即可!

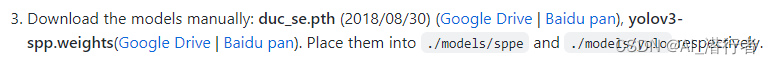

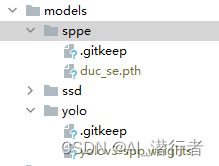

二、模型下载

https://github.com/Amanbhandula/AlphaPose 网站中找到下图下载即可。

下载的模型文件分别放在 models/sppe 和 models/yolo 中。

四、运行

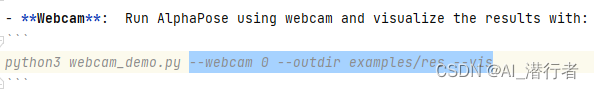

4.1 运行摄像头 webcam_demo.py

-

查看 README.md 找到 摄像头运行命令

python3 webcam_demo.py --webcam 0 --outdir examples/res --vis -

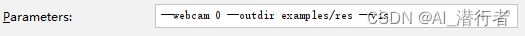

对 webcam_demo.py 进行设置 Run=》Edit Comfiguration =》Parameters

--webcam 0 --outdir examples/res --vis -

右键运行 webcam_demo.py

4.2 运行本地视频 vedio_demo.py

--video E:/Desktop/xiaojiejie.mp4 --outdir examples/res --save_video --sp