今天学习scrapy爬取网络时遇到的一些坑的可能

正常情况:DEBUG: Crawled (200) <GET http://www.techbrood.com/> (referer: None)

错误情况:DEBUG: Crawled (403) <GET http://www.techbrood.com/> (referer: None)

1,网址的错误

一开始看得是scrapy的文档,然后照着文档输出以下代码:

import scrapy

class DmozSpider(scrapy.spiders.Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

filename = response.url.split("/")[-2]

with open(filename, 'wb') as f:

f.write(response.body)

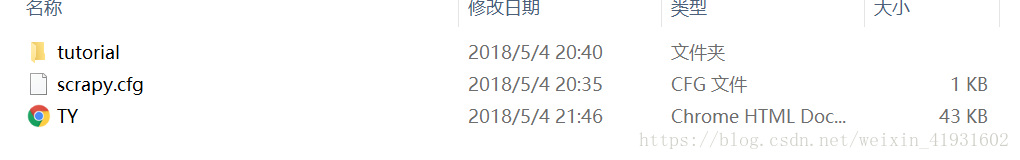

然后出现返回403错误。找了挺久原因,毕竟其他地方没啥问题,只有通过排除法了,最终将注意力放在网址上,于是将网址输入到浏览器上,果然是错误的。两个网址都是错误的。

解决方案:首先检查你的网址没有错误,这是非常关键的一步。当我改过来之后就出现了。

# -*- coding:utf-8 -*-

import scrapy

class DmozSpider(scrapy.spiders.Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"https://blog.csdn.net/weixin_41931602/article/details/80199750",

]

def parse(self, response):

with open("TY.html", "w") as f:

f.write(response.body)

2.缩进问题

在看黑马程序员的scrapy的公开视频时,照着打代码也一样错误,而且一直都没有出现爬取出来的网页的HTML源代码。

#scrapy genspider itcast "itcast.cn"

# -*- coding: utf-8 -*-

import scrapy

import sys

reload(sys)

sys.setdefaultencoding("utf-8")

from mySpider.items import ItcastItem

class ItcastSpider(scrapy.Spider):

name = "itcast"

allowed_domains = ["itcast.cn"]

start_urls = ("http://www.itcast.cn/channel/teacher.shtml#ajavaee")

#一定要记得将parse函数缩进

def parse(self, response):

with open("teacher.html", "w") as f:

f.write(response.text)

print response.text

反反复复看好像也没啥问题吧?这次网址也正确啊!检查了许久,才发现我竟然把parse函数写到外面了,难怪没有写出相关的网页代码出来,毕竟我写的代码运行时是没有调用这个函数的。

顺便提一提,parse(self, response) :解析的方法,每个初始URL完成下载后将被调用,调用的时候传入从每一个URL传回的Response对象来作为唯一参数,主要作用如下:

- 负责解析返回的网页数据(response.body),提取结构化数据(生成item)

- 生成需要下一页的URL请求。

解决方法:一定要记得将parse函数缩进

3.网页有反爬虫,这个暂时还没有遇到,但是凡是使用爬虫去爬取数据时,都应提前想想爬取的网站上有没有反爬虫,你写的代码都应该有代理吧?

解决方案:在请求头部构造一个User Agent。

(余下的以后遇到再来补充)