1 引言

在学习机器学习和深度学习的过程中,基础的数学知识粗略的可以分为两大类:矩阵论和概率论,基本都逃不过这两个框架(除了优化问题)。而在概率论中尤其以变分推断用的最为广泛,无论是最新的深度学习算法还是机器学习基础,各种知识方法总是存在着对变分推断这一部分知识的交叉。因此掌握变分推断是十分重要的(模型要用啊),所以才有了这篇文章,其中内容图片多有参考他人文章,相关参考来源一并在参考文献中给出链接。

2 前置知识

2.1 隐变量

2.2 先验分布

2.3 后验分布

2.4 边缘分布

2.5 贝叶斯公式

3 简单理解变分推断

首先,我们的原始目标是,需要根据已有数据推断需要的分布 p p p;当 p p p 不容易表达,不能直接求解时,可以尝试用变分推断的方法, 即,寻找容易表达和求解的分布 q q q,当 q q q 和 p p p 的差距很小的时候, q q q 就可以作为 p p p 的近似分布,成为输出结果了。在这个过程中,我们的关键点转变了,从“求分布”的推断问题,变成了“缩小距离”的优化问题。

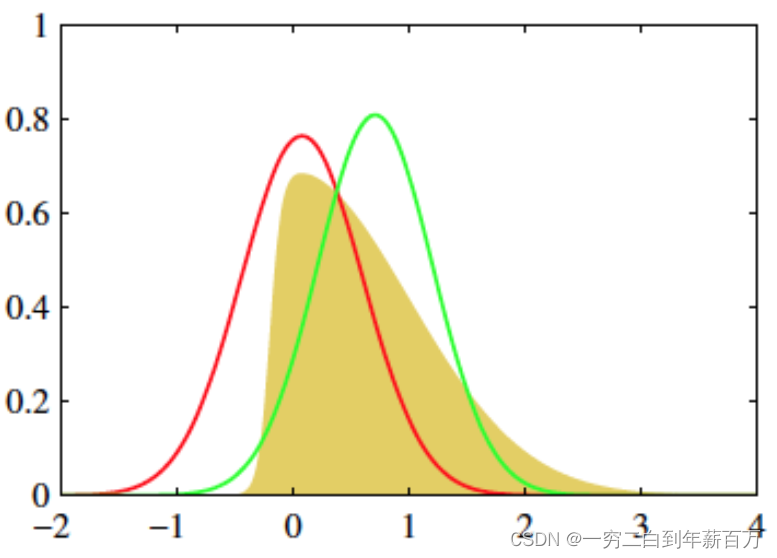

黄色的分布是我们的原始目标 p p p,不好求。它看上去有点像高斯,那我们尝试从高斯分布中找一个红 q q q和一个绿 q q q,分别计算一下 p p p 和他们重叠部分面积,选更像 p p p 的 q q q 作为 p p p 的近似分布。上面是对变分推断的一个直接理解,距离深入理解模型还有距离。

参考文献

[1]如何简单易懂地理解变分推断(variational inference)?

[2]变分推断的本质:用一个简单分布拟合另一个复杂分布

[3][贝叶斯统计] 2 隐变量模型,随机变分推断和VAEs

[4]【机器学习】高斯混合模型详解