一、图像读取

常见图像读取的python库有Pillow和OpenCV。下面分别简单介绍。

- Pillow

Pillow是Python图像处理函式库(PIL)的一个分支。Pillow提供了常见的图像读取和处理的操作,而且可以与ipython notebook无缝集成,是应用比较广泛的库。

用法详见Pillow的官方文档

- OpenCV

OpenCV是一个跨平台的计算机视觉库,最早由Intel开源得来。OpenCV发展的非常早,拥有众多的计算机视觉、数字图像处理和机器视觉等功能。OpenCV在功能上比Pillow更加强大很多,学习成本也高很多。

OpenCV包含了众多的图像处理的功能,OpenCV包含了你能想得到的只要与图像相关的操作。此外OpenCV还内置了很多的图像特征处理算法,如关键点检测、边缘检测和直线检测等。

OpenCV官网

OpenCV Github

OpenCV 扩展算法库

二、数据扩增

- **作用:**增加训练集样本,同时也可有效缓解模型过拟合的情况,也可以给模型带来更强的泛化能力。即增加可训练参数和扩展样本空间。

举例:如现分类模型需要对汽车进行分类,左边的是汽车A,右边为汽车B。如果不使用任何数据扩增方法,深度学习模型会从汽车车头的角度来进行判别,而不是汽车具体的区别。

- **方法:**一般角度:图像颜色、尺寸、形态、空间和像素等。不同的方法可自由组合得到更丰富的数据扩增方法。

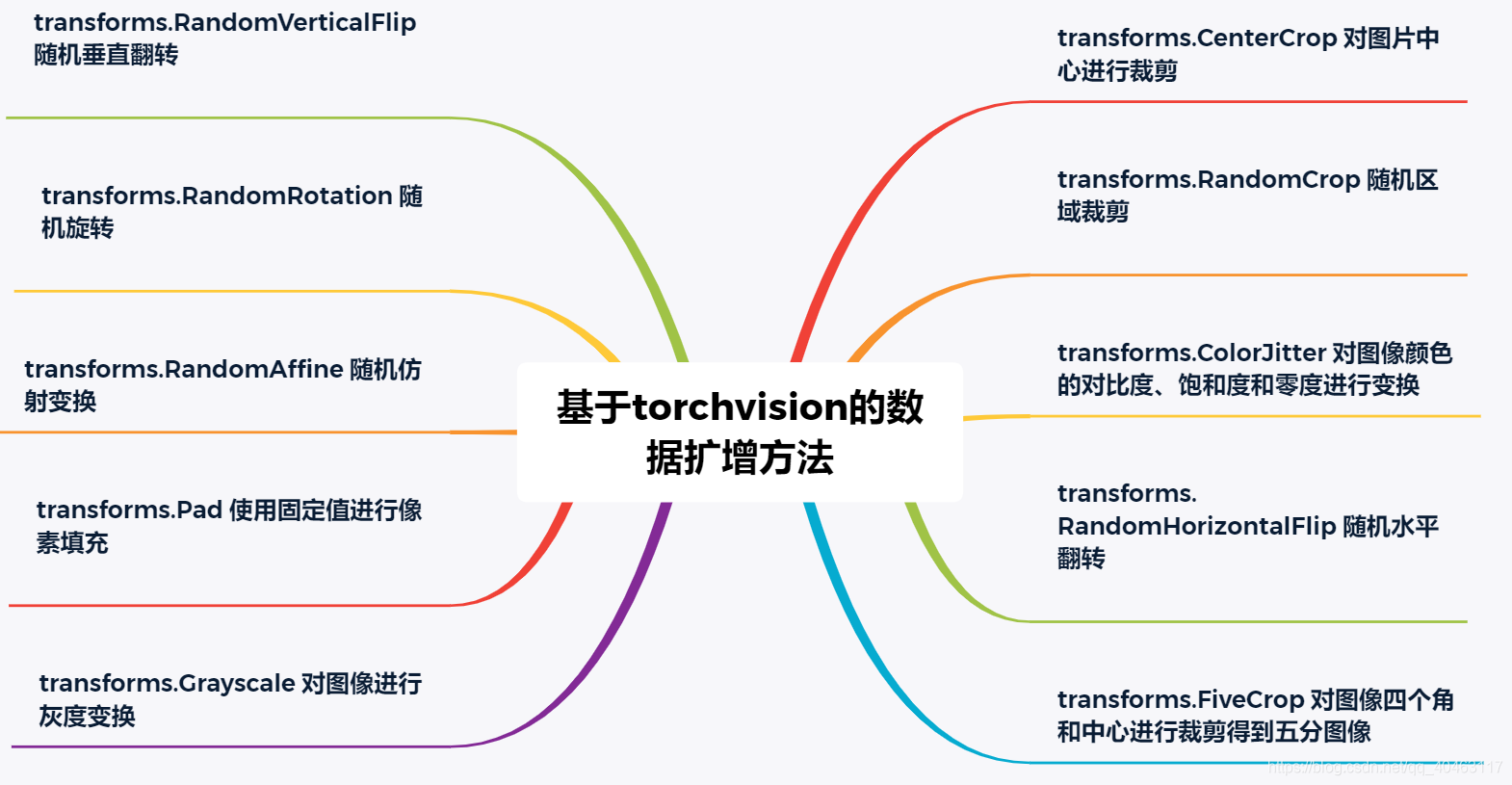

以torchvision为例,常见的数据扩增方法如下图。

在本次赛题中,赛题任务是需要对图像中的字符进行识别,因此对于字符图片并不能进行翻转操作。比如字符6经过水平翻转就变成了字符9,会改变字符原本的含义。 - 常用的数据扩增库

torchvision

https://github.com/pytorch/vision

pytorch官方提供的数据扩增库,提供了基本的数据数据扩增方法,可以无缝与torch进行集成;但数据扩增方法种类较少,且速度中等;

imgaug

https://github.com/aleju/imgaug

imgaug是常用的第三方数据扩增库,提供了多样的数据扩增方法,且组合起来非常方便,速度较快;

albumentations

https://albumentations.readthedocs.io

是常用的第三方数据扩增库,提供了多样的数据扩增方法,对图像分类、语义分割、物体检测和关键点检测都支持,速度较快。

三、Pytorch读取数据

在Pytorch中数据是通过Dataset进行封装,并通过DataLoder进行并行读取。所以我们只需要重载一下数据读取的逻辑就可以完成数据的读取。

import os, sys, glob, shutil, json

import cv2

from PIL import Image

import numpy as np

import torch

from torch.utils.data.dataset import Dataset

import torchvision.transforms as transforms

class SVHNDataset(Dataset):

def __init__(self, img_path, img_label, transform=None):

self.img_path = img_path

self.img_label = img_label

if transform is not None:

self.transform = transform

else:

self.transform = None

def __getitem__(self, index):

img = Image.open(self.img_path[index]).convert('RGB')

if self.transform is not None:

img = self.transform(img)

# 原始SVHN中类别10为数字0

lbl = np.array(self.img_label[index], dtype=np.int)

lbl = list(lbl) + (5 - len(lbl)) * [10]

return img, torch.from_numpy(np.array(lbl[:5]))

def __len__(self):

return len(self.img_path)

train_path = glob.glob('../input/train/*.png')

train_path.sort()

train_json = json.load(open('../input/train.json'))

train_label = [train_json[x]['label'] for x in train_json]

data = SVHNDataset(train_path, train_label,

transforms.Compose([

# 缩放到固定尺寸

transforms.Resize((64, 128)),

# 随机颜色变换

transforms.ColorJitter(0.2, 0.2, 0.2),

# 加入随机旋转

transforms.RandomRotation(5),

# 将图片转换为pytorch 的tesntor

# transforms.ToTensor(),

# 对图像像素进行归一化

# transforms.Normalize([0.485,0.456,0.406],[0.229,0.224,0.225])

通过上述代码,可以将赛题的图像数据和对应标签进行读取,在读取过程中的进行数据扩增,效果如下所示:

接下来我们将在定义好的Dataset基础上构建DataLoder,你可以会问有了Dataset为什么还要有DataLoder?其实这两个是两个不同的概念,是为了实现不同的功能。

Dataset:对数据集的封装,提供索引方式的对数据样本进行读取

DataLoder:对Dataset进行封装,提供批量读取的迭代读取

加入DataLoder后,数据读取代码改为如下:

import os, sys, glob, shutil, json

import cv2

from PIL import Image

import numpy as np

import torch

from torch.utils.data.dataset import Dataset

import torchvision.transforms as transforms

class SVHNDataset(Dataset):

def __init__(self, img_path, img_label, transform=None):

self.img_path = img_path

self.img_label = img_label

if transform is not None:

self.transform = transform

else:

self.transform = None

def __getitem__(self, index):

img = Image.open(self.img_path[index]).convert('RGB')

if self.transform is not None:

img = self.transform(img)

# 原始SVHN中类别10为数字0

lbl = np.array(self.img_label[index], dtype=np.int)

lbl = list(lbl) + (5 - len(lbl)) * [10]

return img, torch.from_numpy(np.array(lbl[:5]))

def __len__(self):

return len(self.img_path)

train_path = glob.glob('../input/train/*.png')

train_path.sort()

train_json = json.load(open('../input/train.json'))

train_label = [train_json[x]['label'] for x in train_json]

train_loader = torch.utils.data.DataLoader(

SVHNDataset(train_path, train_label,

transforms.Compose([

transforms.Resize((64, 128)),

transforms.ColorJitter(0.3, 0.3, 0.2),

transforms.RandomRotation(5),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

])),

batch_size=10, # 每批样本个数

shuffle=False, # 是否打乱顺序

num_workers=10, # 读取的线程个数

)

for data in train_loader:

break

在加入DataLoder后,数据按照批次获取,每批次调用Dataset读取单个样本进行拼接。此时data的格式为:

torch.Size([10, 3, 64, 128]), torch.Size([10, 6])

前者为图像文件,为batchsize * chanel * height * width次序;后者为字符标签。