全部笔记的汇总贴:《机器学习》西瓜书-读书笔记汇总贴

一、神经元模型

神经网络是由具有适应性的 简单单元组成的广泛并行互连的网络,它的组织能够模拟生物神经系统对真实世界物体所作出的交互反应。神经网络中最基本的成分是神经元(neuron)模型,许多的神经元按一定的层次结构连接起来,就得到了神经网络。

二、感知机与多层网络

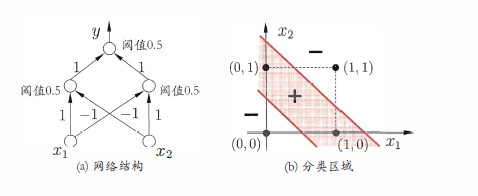

感知机(Perceptron)由两层神经元组成。只有输出层神经元进行激活函数处理,即只拥有一层功能神经元(functional neuron),其学习能力非常有限。

要解决非线性可分问题,需考虑使用多层功能神经元,这样的网络被称为多层前馈神经网络。

三、误差逆传播算法

多层网络的学习能力比单层感知机强得多. 欲训练多层网络,简单感知机学习规则显然不够了,需要更强大的学习算法.误差逆传播(简称 BP)算法就是其中最杰出的代表,它是运今最成功的神经网络学习算法。

正是由于其强大的表示能力,BP神经网络经常遭遇过拟合,其训练误差持续降低,但测试误差却可能上升。

- 早停:将数据分成训练集和验证集,训练集用来计算梯度、 更新连接权和阈值,验证集用来估计误差,若训练集误差降低但验证集误差升高,则停止训练,同时返回具有最小验证集误差的连接权和阈值。

- 正则化:在误差目标函数中增加一个用于描述网络复杂度的部分。

四、全局最小与局部极小

全局最小一定是局部最小。

我们需要试图跳出局部最小以进一步接近全局最小。

- 从多个不同的初始点进行搜索;

- 模拟退火:每一步以一定的概率接受比当前更差的结果;

- 随机梯度下降

- 遗传算法

五、其他常见神经网络

(一)RBF网络

是一种单隐层前馈神经网络,它使用径向基函数作为隐层神经元激活函 数,而输出层则是对隐居神经元输出的线性组合。

(二)ART网络

ART网络是竞争型学习的重要代表。该网络由比较层、识别层、识别 阔值和重置模块构成。其中,比较层负责接收输入样本,并将其传递给识别层神经元,识别层每个神经元对应一个模式类,神经元数目可在训练过程中动态增长以增加新的模式类。

竞争型学习(competitive learning)是神经网络中一种常用的无监督学习策略,在使用该策略时,网络的输出神经元相互竞争,每一时刻仅有一个竞争获胜的神经元被激活,其他神经元的状态被抑制。

(三)SOM网络

SOM网络一种竞争学习型的无监督神经网络,它能将高维输入数据映射到低维空间(通常为二维的),同时保持输入数据在高维空间的拓扑结构,即将高维空间中相似的样本点映射到网络输出层中的邻近神经元。

(四)级联相关网络

级联相关网络是结构自适应网络(将网络结构也当作学习的目标之一,并希望能在训练过程中找到最符合数据特点的网络结构)的重要代表。

(五)Elman网络

Elman网络是最常用的递归神经网络(允许网络中出现环形结构,从而同让一些神经元的输出反馈回来作为输入信号)之一。

(六)玻尔兹曼机

直接看这个视频:白板推导系列笔记(二十八)-玻尔兹曼机

六、深度学习

典型的深度学习模型就是很深层的神经网络。

从增加模型复杂度的角度来看,增加隐层的数目显然比增加隐层神经元的数目更有效,因为增加隐层数不仅增加了拥有激活函数的神经元的数目,还增加了激活函数嵌套的层数。

“预训练+微调 ” 的做法可视为将大量参数分组,对每组先找到局部看来比较好的设置,然后再基于这些局部较优的结果联合起来进行全局寻优。

下一章传送门:西瓜书读书笔记(六)-支持向量机