Style Transfer——A Neural Algorithm of Artistic Style

From:Journal of Vision(2015)

Abstract

人们通过在绘画中内容和图画中的交融创造出独一无二的视觉冲击,但这一过程的运行机制还不清楚。而DNN已在其他领域如物体、人脸识别达到了接近人类的识别水平,因此本文借助DNN分别学习图像的内容和风格,完成艺术图像风格迁移的创作。

Section I Introduction

卷积神经网络是广泛用于图像处理任务的DNN,CNN包含一层层小型计算单元,可以以一种前馈的方式有层次的来处理、学习视觉信息,每一层的图像滤波器负责理解一定层次的图像特征,从而经每一层卷积处理后都会输出称之为特征图的信息。

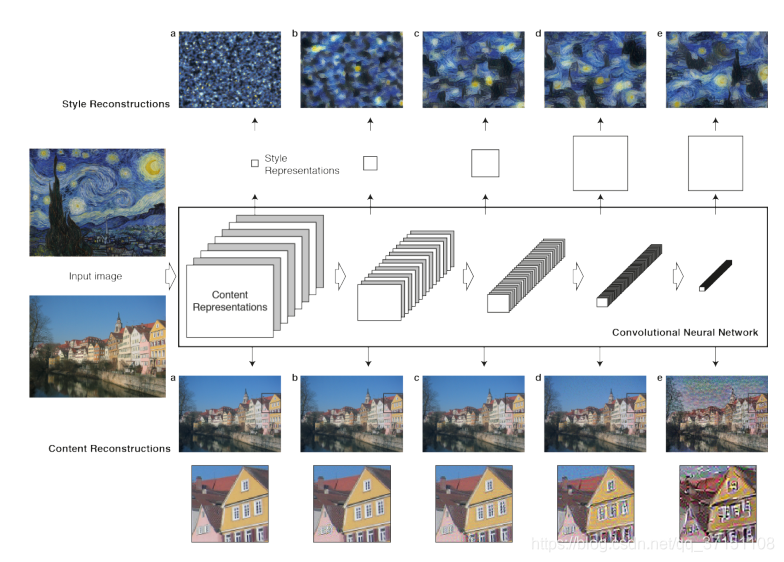

当训练CNN网络用于物体识别时,会随着处理层次的加深提取越来越复杂的特征,因此经卷积神经网络处理后输入图像转变成一系列实际的“内容“而不再仅代表像素值。通过将CNN每一层的特征图可视化,我们看到网络深层次提取的特征捕获的是更高级的内容信息,而低层次往往只是重复了原图的像素值,因此我们将网络更深层次的特征响应叫做内容表征(content reoresentation);

为了获得输入图像的风格表征(style representaton)需要捕获图像的纹理信息,因此在网络每一层第一个filter的响应之间设计了一个特征空间,不同层的关系表征了特征图空间上的关联,这是一种静态的、多层次的描述方式。注意利用的是纹理信息而不是整体的布局。

从Fig1中可以看出,原始图像输入网络后,在每一层由不同filter提取到的feature map表征,并且随着filter的数目增多,每一层feature map的尺寸会通过下采样减少。

内容重构:Content Reconstruction

a,b,c代表低层次featuremap的重构,可以看到几乎完全复原了原图;但conv4_1,conv5_1由于像素信息的丢失损失了图像的细节部分

风格重构:风格信息通过捕获哦不同层次的相关性来获得图像空间上的纹理特征,a-e分别表征不同子空间组合下提取到的风格信息。通过可视化的结果可以看出子集包含不同层次越多,细节信息丢失的会越多但风格更接近原图的整体风格。

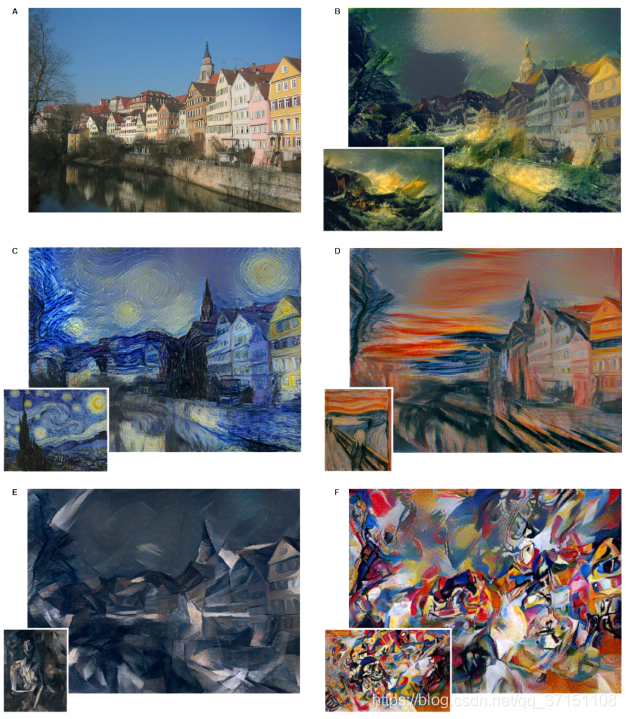

本文的重要发现则是:在卷积神经网络中,图像的内容表征和风格表征是相互分开的。因此可以人为操纵组合生成结合两类不同内容和风格组成新的有意义的图片。为了更好的说明这一发现,本文选取了德国Neckarfront小镇的一张图片作为内容图片,选取一系列艺术名画作为风格图片。

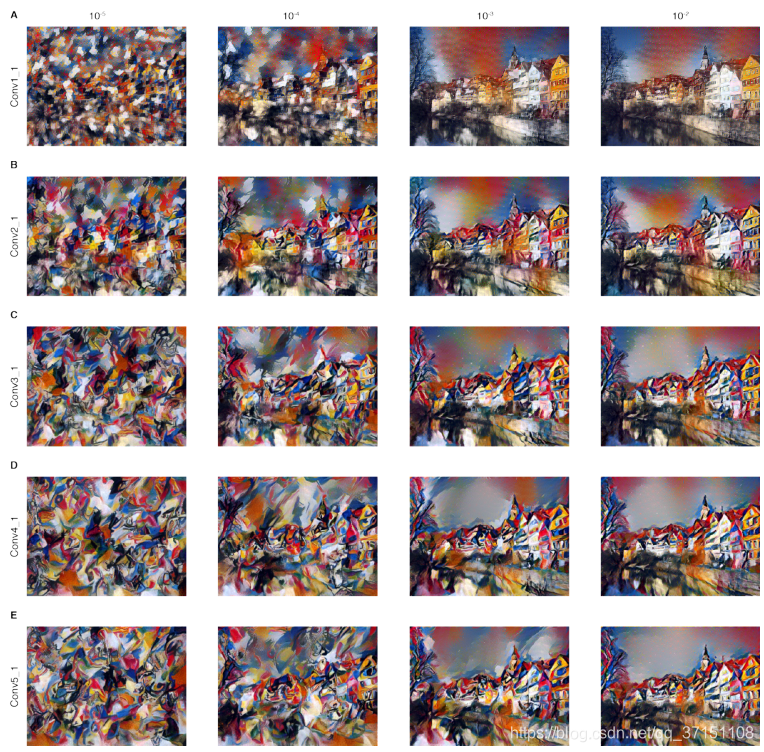

最终的合成效果是不同艺术风格下的原始建筑。Fig2中的Style是集合了所有层后提取的风格表征,也可以选择一部分层组成的Style,如Fig3所示,整张图的迁移一般选用所有层次提取后的风格表征,这样会使得视觉效果更加平和连续。

当然,无向的内容和风格也不可能完全做到毫不相关,在图像生成的过程中,往往不会同时完美的匹配两种图片,可以在训练过程中通过调整损失函数来明确关注点。比如强调风格的学习,会使得生成图片具备艺术图片的纹理信息但有可能不怎么包含照片的内容信息;强调内容的学习也会导致艺术风格的失配,在实际操作中二者需要进行trade off。

因此,本文提出的深度学习框架将图像的内容与风格分离,从而可以将原始图像在保留内容的基础上迁移到其他风格,本文都是通过在DNN做物体识别的预训练框架中获得图像的风格表征和内容表征。本文是首次实现将自然图像的内容与风格特征分离的。

Fig3展示了不同层次下Style的效果,可以看到包含越深的层次在风格上愈加复杂,因为更高层次的感受野和特征的复杂程度都上升了。每一列上方的数字代表content/style的比重,数值越大对内容的强调越多。

之前相关的研究主要使用的是较为简单的风景、手写、人脸等小型图片,本文则是将实景照片完成了一系列艺术图像风格的渲染而且不是直接在像素值上进行操作,而是通过DNN在特征空间进行的操作。

除此之外,本文对Style Representation提供了一种简洁明了、单神经元级别的描述,主要描述的是不同种类神经元之间的相互关系

# Section II Method

基础网络选用的是VGG-19中的卷积核池化层,没有使用全连接层。

在图像生成的过程中我们发现将最大池化替换为均值池化可以帮助梯度流动。

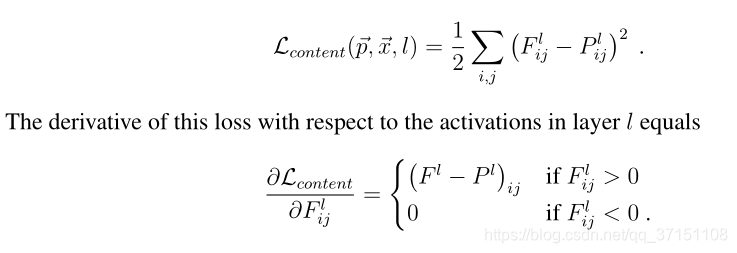

通常网络中的每一层都定义了一组非线性变换,输入的原始图像经每一层的filter编码成不同规格的feature map,loss定义为原图与生成图的均方差。

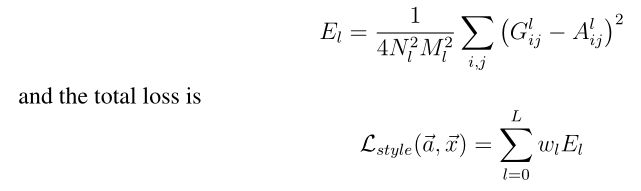

而Style Representation建立在每一层响应的最顶部,计算不同filter的相关性,通过Gram Matrix计算得到,Gram计算的是内积。

Gram Matrix参考:

Gram Matrix

通过优化两者的Gram Matrix达到风格学习的目的,还引入了wl权重因子来表征不同层的权重。

通过Content Loss和Style Loss的联合优化,可以使得生成图片同时学习原始照片的内容和艺术图片的风格,alpha和beta决定了二者的权重。

通过Content Loss和Style Loss的联合优化,可以使得生成图片同时学习原始照片的内容和艺术图片的风格,alpha和beta决定了二者的权重。