最近,anchor-free检测器在精度和速度上都显示出了超越anchor-based检测器的巨大潜力。在这项工作中,我们的目标是找到一个新的平衡速度和准确性的anchor-free检测器。研究了两个问题:1)如何使anchor-free检测器的头更好?2)如何更好的利用特征金字塔的力量?我们分别将注意偏差和特征选择作为这两个问题的主要问题。我们提出了一种新的训练策略来解决这些问题,该策略有两种软优化技术,即软加权anchor点和软选择特征金字塔。为了评估其有效性,我们训练了一种一阶段anchor-free检测器,称为软锚点探测器(SAPD)。实验表明,我们简洁的SAPD将速度/精度权衡提升到了一个新的水平,超过了目前最先进的anchor-free、anchor-based和多阶段检测器。我们最好的模型可以在COCO上实现47.4%的单模型单标度AP,速度可以提升5倍。

当前anchor-free的方法可以分为两类:

1.anchor-point,即FSAF这些,这类方法的优点是结构简单,速度快,自由的特征选择,缺点就 是精度比不上key-point方法。

2.key-point,即CenterNet这些,这类方法的优点是在输入尺寸比较小时,精度很高,缺点就是特征图需要保留高分辨率,推理速度太慢。

文章主要解决anchor-point训练过程中的两个问题:

1.attention bias,我们所说的注意力偏差,是指具有良好视角的物体容易从检测器上吸引更多的注意力,从而使其他物体容易被忽略,因为在训练中忽略了锚点的特征错位。

2.feature selection,特征选择问题则是基于自组织启发法将实例分配到金字塔层次,或将每个实例限制为单个层次,从而导致特征能力的次优利用。

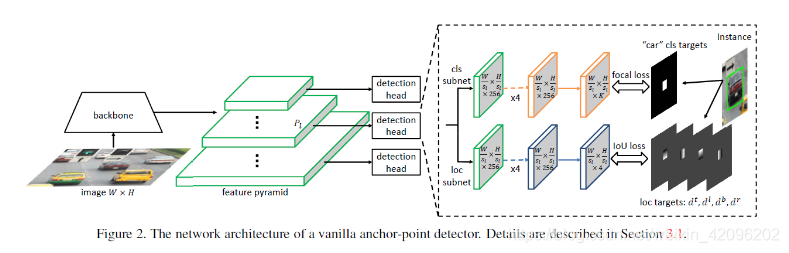

以FSAF为baseline,如下图:

作者首先在上图中可视化了一个注意力偏差的例子。图中包含5名足球运动员,其分类输出的分数图如上图所示。前景中的两名玩家在热图中生成两个大的优势区域,并获得高分。较大的区域倾向于向其他代表不足的区域扩展,这些区域对应于其余的参与者。在更糟的情况下,优势区域甚至可以覆盖代表不足区域的部分。这导致检测器只关注前景实例,从而抑制了对背景的检测。

原因:问题在于在靠近实例边界的位置由于特征不对齐而获得不必要的高分。位于边界附近的锚点没有与实例很好的对齐的特性。它们的特性往往会受到实例之外的内容的影响,因为它们的接受域包含了太多来自背景的信息,导致表达能力下降。因此,信任靠近实例边界的锚点和信任靠近中心的锚点一样多是不合理的。

提出方法:

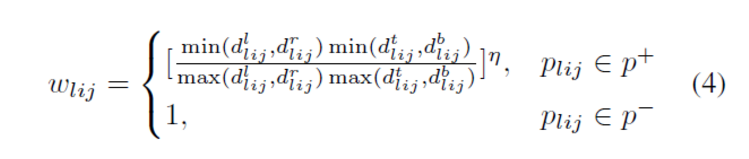

解决方法是对每个锚点赋不同的权重,对于每个正锚点,权值取决于其图像空间位置与对应实例中心之间的距离。距离越长,锚点的降权值越大。因此,远离中心的锚点被抑制,更多地依赖于那些靠近中心的锚点。对于负锚点,它们保持不变,即它们的权重都设置为1。这与关键点检测器不同,后者只有一个关键点是正的。

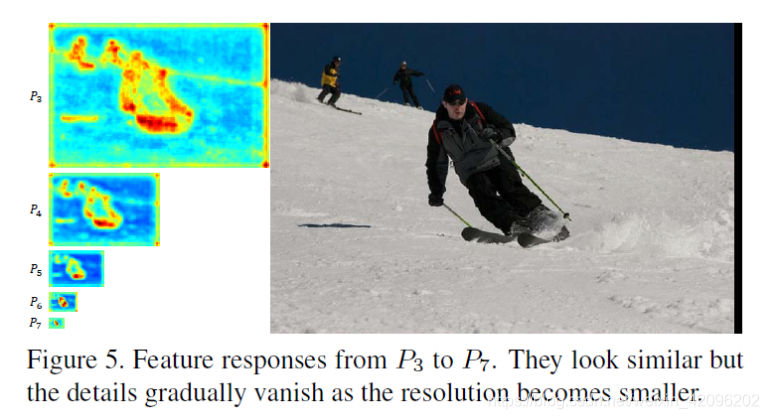

作者首先在上图中可视化所有特征金字塔不同级别的响应。结果表明,如果某个区域激活了某个层次的特征,那么相邻层次的相同区域也可能以类似的方式激活。但是,随着能级之间的距离越来越远,这种相似性也会逐渐消失。这意味着来自多个金字塔级别的特征可以一起贡献到特定实例的检测中,但是不同级别的贡献程度应该有所不同。

解决方法:

anchor-free的方法可以自由选择具体的特征,作者认为不同尺度的特征图对于每个实例都是有帮助,只是贡献不同。

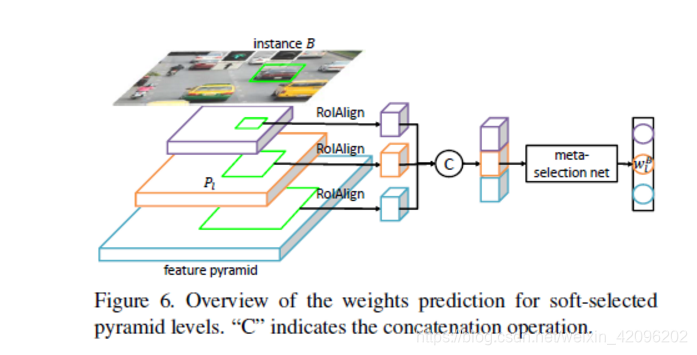

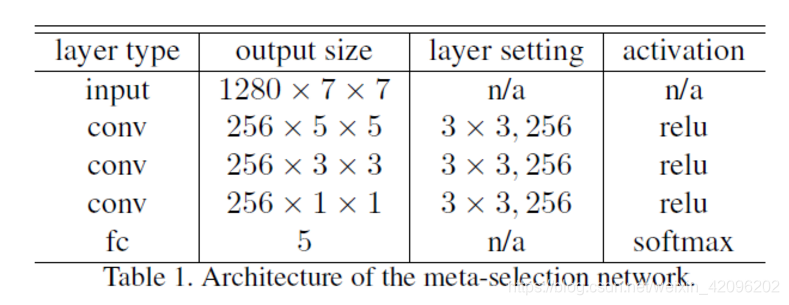

作者提出训练一个元选择网络来预测软特征选择的权重,首先是将不同级别的特征图进行RoiAlign后再进行拼接,然后将提取的特征通过元选择网络输出概率分布向量,如下图所示。我们使用概率作为软特征选择的权重。meta-selection net在网络中的标签是使用FSAF中比较不同特征图进行预测后的损失最小者为1,其余为0。

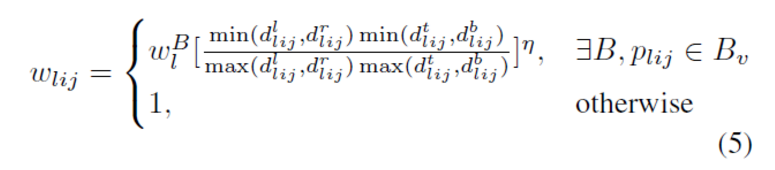

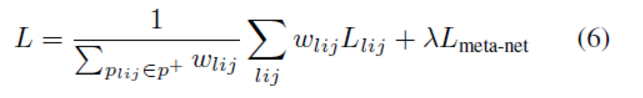

每个anchor在Soft-Weighted Anchor Points和Soft-Selected Pyramid Levels后的权重:

总损失:meta-net部分的损失为交叉熵损失

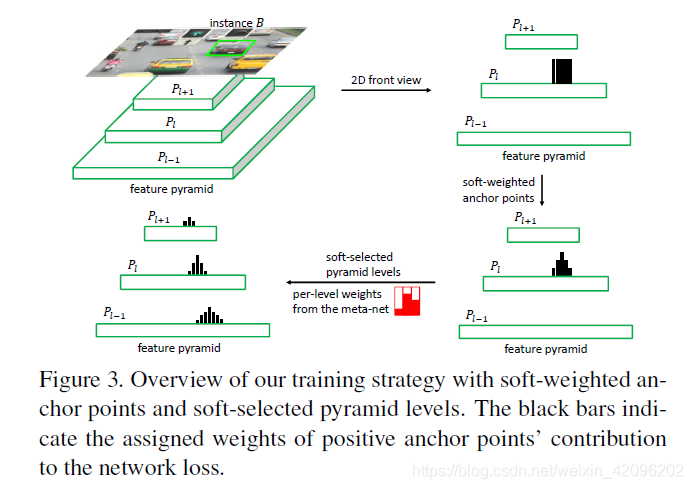

解释一下上图的意思:

1.首先对于一个特定实例,我们会设置很多anchor,每个anchor的系数是等同的,并且一般会匹配到一个最合适的特征层上,如图上方左右两个所示。

2.然后我们会使用Soft-Weighted Anchor Points, 根据anchor位置与实例中心的距离设定权重,如上图右下所示。

3.最后我们会使用Soft-Selected Pyramid Levels,使用meta-net预测前k个特征层概率,这时候anchor关联的特征层是k个,且权重不是固定的,是学习的系数。如上图左下所示。

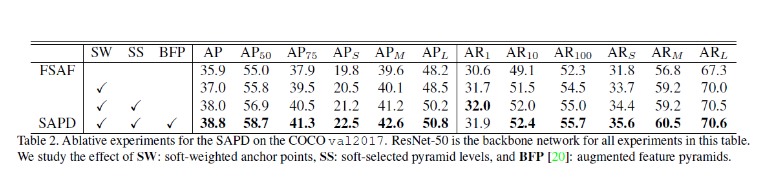

1.消融实验:

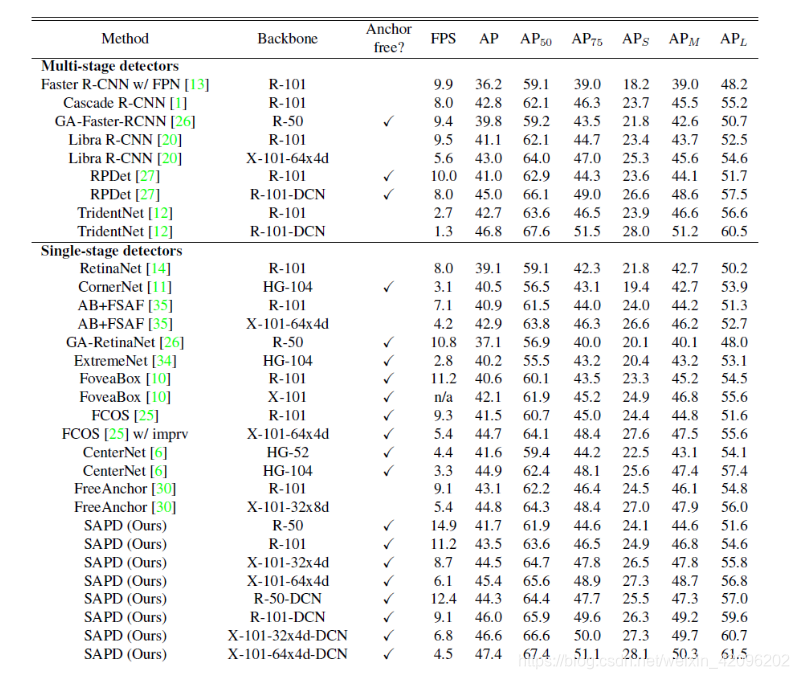

2.全网络比较: