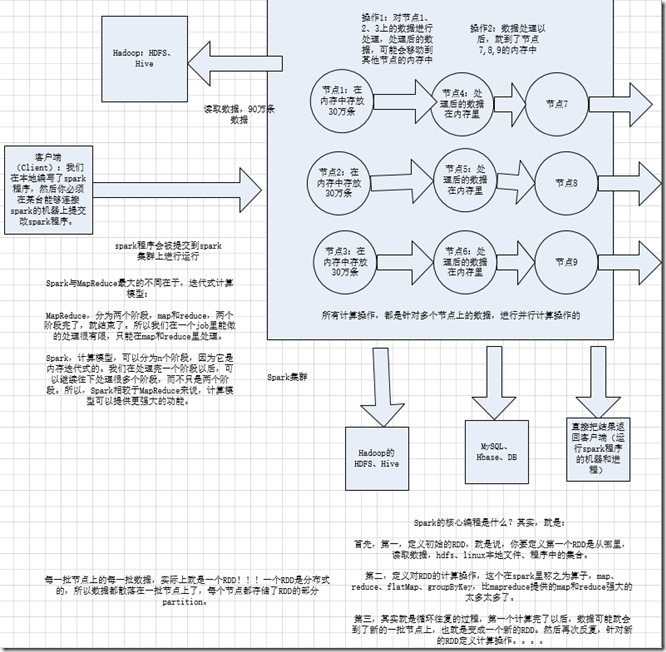

1.spark基本工作原理

分布式

主要基于内存

迭代式计算

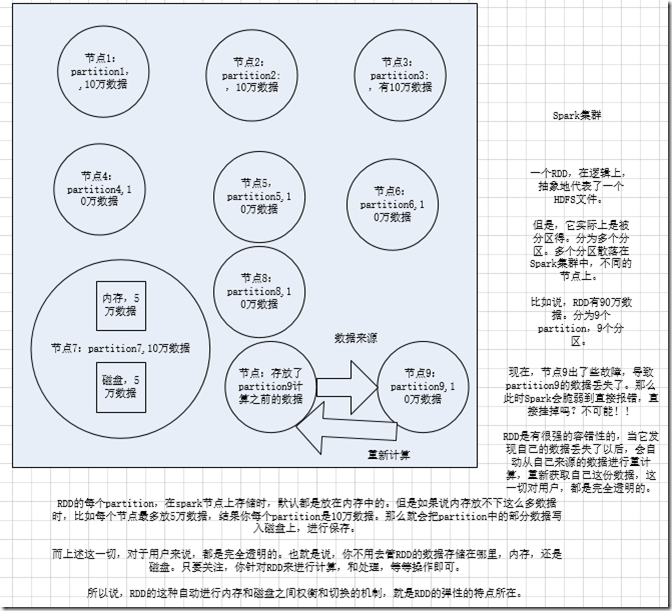

2.RDD及其特点

RDD在抽象上来说是一种元素集合,包含了数据。它是被分区的,分为多个分区,每个分区分布在集群中的不同节点上,从而让RDD中的数据可以被并行操作。(分布式数据集)

RDD最重要的特性就是,提供了容错性,可以自动从节点失败中恢复过来。即如果某个节点上的RDD partition,因为节点故障,导致数据丢了,那么RDD会自动通过自己的数据来源重新计算该partition。这一切对使用者是透明的。

RDD的数据默认情况下存放在内存中的,但是在内存资源不足时,Spark会自动将RDD数据写入磁盘。(弹性)

3.spark开发

a.核心开发:离线批处理 / 延迟性的交互式数据处理

b.SQL查询:底层都是RDD和计算操作

c.实时计算:底层都是RDD和计算操作