第十四章 自编码器

2020-3-8 深度学习笔记14 - 自编码器 1(欠完备自编码器)

2020-3-8 深度学习笔记14 - 自编码器 2(正则自编码器 - 稀疏自编码器(增加惩罚项) / 去噪自编码器(改变重构误差项)/ 惩罚导数作为正则)

2020-3-14 深度学习笔记14 - 自编码器 3( 表示能力、层的大小和深度,随机编码器和解码器)

去噪自编码器详解

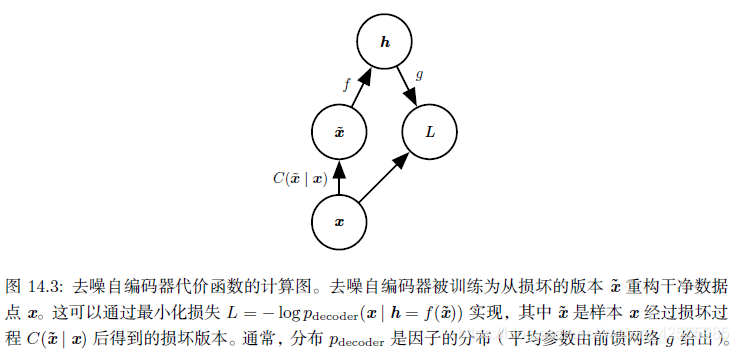

去噪自编码器(denoising autoencoder,DAE)是一类接受损坏数据作为输入,并训练来预测原始未被损坏数据作为输出的自编码器。在前面曾经有过介绍。

自编码器则根据以下过程,从训练数据对

中学习重构分布}(reconstruction distribution)

:

(1)从训练数据中采一个训练样本

。

(2)从

采一个损坏样本

。

(3)将

作为训练样本来估计自编码器的重构分布

,其中

是编码器

的输出,

根据解码函数

定义。

通常我们可以简单地对负对数似然 进行基于梯度法(如小批量梯度下降)的近似最小化。 只要编码器是确定性的,去噪自编码器就是一个前馈网络,并且可以使用与其他前馈网络完全相同的方式进行训练。

得分估计

得分匹配是最大似然的代替。 它提供了概率分布的一致估计,促使模型在各个数据点

上获得与数据分布相同的得分。 在这种情况下,得分是一个特定的梯度场:

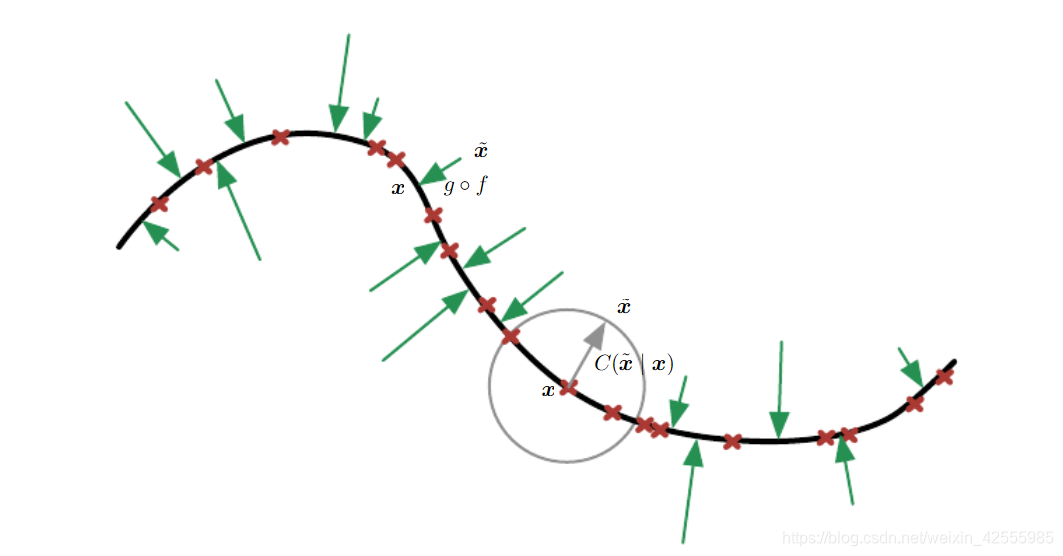

DAE的训练准则(条件高斯 )能让自编码器学到能估计数据分布得分的向量场 ,这是DAE的一个重要特性。

观察上图去噪自编码器被训练为将损坏的数据点

映射回原始数据点

我们将训练样本

表示为位于低维流形(粗黑线)附近的红叉。

我们用灰色圆圈表示等概率的损坏过程

。

灰色箭头演示了如何将一个训练样本转换为经过此损坏过程的样本。

当训练去噪自编码器最小化平方误差

的平均值时,重构

估计

。

对可能产生

的原始点

的质心进行估计,所以向量

近似指向流形上最近的点。

因此自编码器可以学习由绿色箭头表示的向量场

。

该向量场将得分

估计为一个乘法因子,即重构误差均方根的平均。

这里我们所讨论的仅限于去噪自编码器如何学习表示一个概率分布。

历史展望

”去噪自编码器”的命名指的不仅仅是学习去噪,而且可以学到一个好的内部表示(作为学习去噪的副效用)。学习到的表示可以被用来预训练更深的无监督网络或监督网络。

与稀疏自编码器、稀疏编码、收缩自编码器等正则化的自编码器类似, DAE的动机是允许学习容量很高的编码器,同时防止在编码器和解码器学习一个无用的恒等函数 。