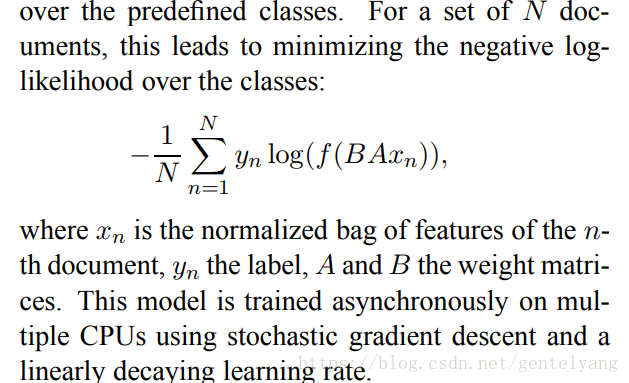

一:fasttext原理

fastText简而言之,就是把文档中所有词通过lookup table变成向量,取平均后直接用线性分类器得到分类结果。fastText和ACL-15上的deep averaging network [1] (DAN,如下图)非常相似,区别就是去掉了中间的隐层。两篇文章的结论也比较类似,也是指出对一些简单的分类任务,没有必要使用太复杂的网络结构就可以取得差不多的结果。

有两个tricks,文章使用了Hierarchical softmax(分层softmax)和n-gram features

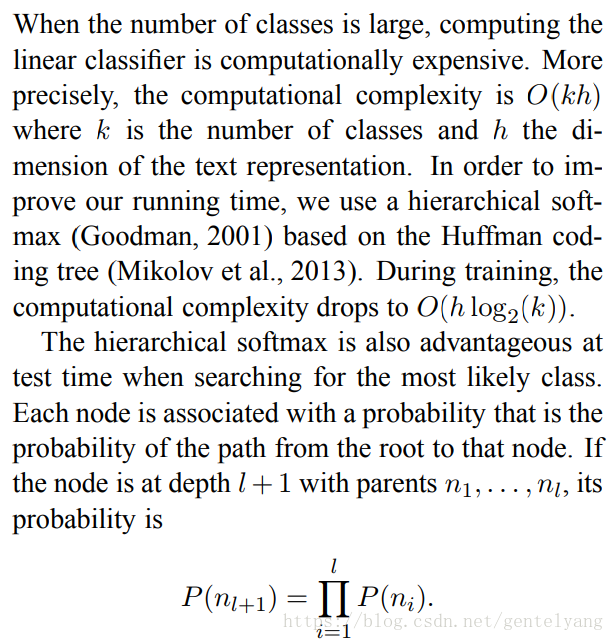

1:Hierarchical softmax

就是类别较多时,通过构建一个Huffman编码树来加速softmax layer的计算,和之前word2vec中的trick是相同的

并且时间复杂度为O(hlog2(k));

2: N-gram features

只用unigram的话会丢掉word order信息,所以通过加入N-gram features进行补充,用hashing来减少N-gram的存储。

二:fasttext代码实现例子

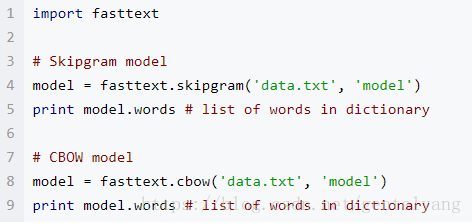

1:词向量模型学习

文本分类

classifier=fasttext.supervised('data.train.txt','model')

data.train.txt是一个含有训练句子,每行加上标签的文本文件,默认情况下,假设标签的话,前缀

字符串_label_.

输出model.bin 和model.vec