笔者并不精通机器学习的相关理论知识,只是最近急着要使用SVM算法,便查阅各方资料了解了SVM的原理,但由于笔者基础实在太薄弱,看了一遍又一遍才大致理解了公式是怎么来的,为防止之后遗忘,便以博客的形式记录下来。

如果发现博客中有任何错误,欢迎在评论区指正,笔者感激不尽。

支持向量机

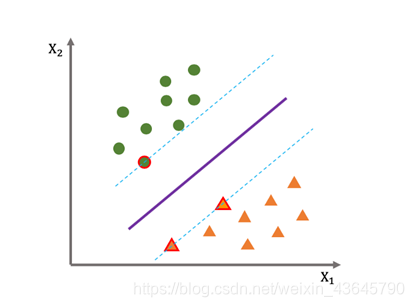

支持向量机(Support Vector Machine,简称SVM),是机器学习中运用较为广泛的一种的算法,在神经网络出现之前,应用十分广泛。SVM算法是一种二分类算法,通过构建超平面函数,来进行样本分类,如下图所示:

模型分析

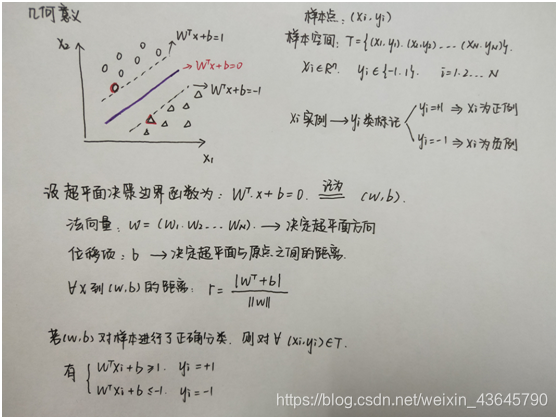

如图所示,我们想要找到一个超平面对我们的训练集进行划分,可以有多种选择,而我们最终选择紫色的边界函数(分类超平面),因为紫色的线有更大的几何间距,对于离群点有更好的兼容性,即泛化能力更好。

笔者不会使用LaTeX,只能画图啦!

有红色边框的样本在上式所表示的平面之上,我们称之为“支持向量”。

两式之间的距离被称作为“间隔”。

我们的目的是为了求得“最大间隔”,求解过程中将最大化问题转化为最小化问题,这就是支持向量机的基本型,也即优化目标函数。

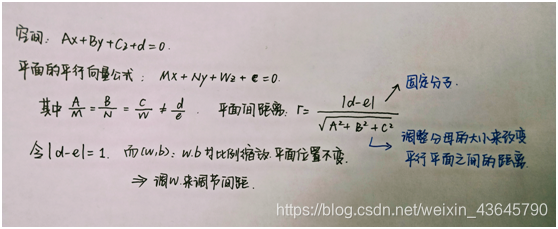

如何选择样本边界平行函数?

我们可以通过改变法向量的大小来改变距离大小。

由于对超平面(w,b)的系数w和b进行等比例缩放不改变平面在空间中的几何位置,所以将函数差值固定为1,通过调节w也可以起到改变间距的目的。

模型求解

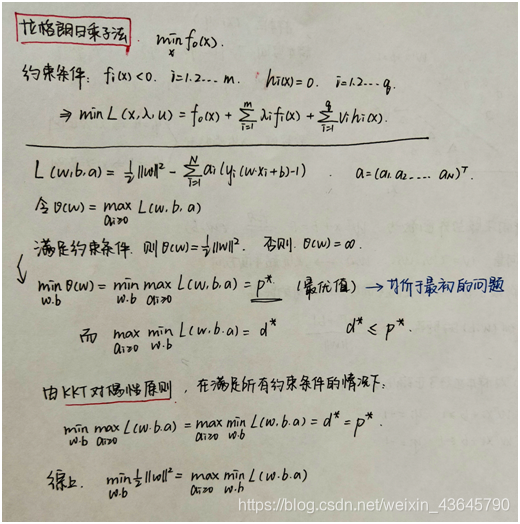

拉格朗日对偶性

接下来的内容就是让我这个初学的渣渣头秃的地方了~

SVM算法要优化的目标函数为:

对于此类问题的优化求解,我们可以利用凸优化的凸二次规划来求解,我看了大概两遍吧,仿佛看懂了,另外一个方法就是采用拉格朗日对偶性求解。

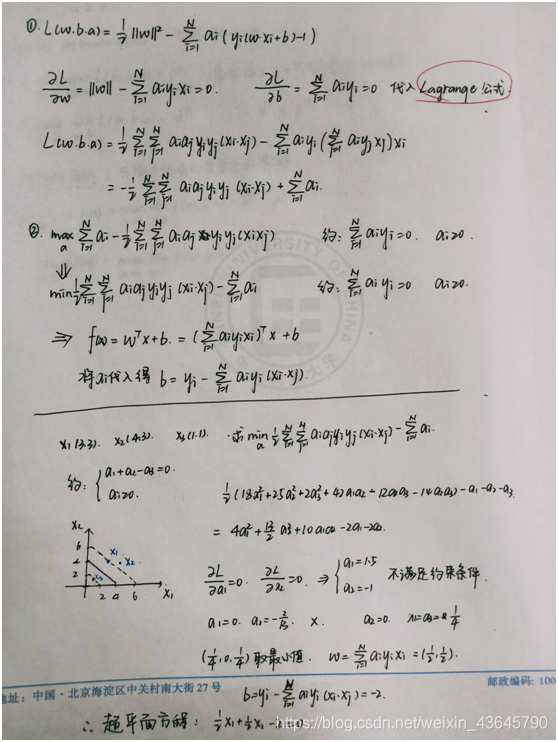

求解过程:

放张草稿吧!

扫描二维码关注公众号,回复:

8832974 查看本文章