慢查询优化神器 - explain命令

关于explain命令相信大家并不陌生,这里需要强调rows是核心指标,绝大部分rows小的语句执行一定很快(有例外,下面会讲到)。所以优化语句基本上都是在优化rows。

慢查询优化基本步骤

-

先运行看看是否真的很慢,注意设置SQL_NO_CACHE

-

where条件单表查,锁定最小返回记录表。这句话的意思是把查询语句的where都应用到表中返回的记录数最小的表开始查起,单表每个字段分别查询,看哪个字段的区分度最高

-

explain查看执行计划,是否与1预期一致(从锁定记录较少的表开始查询)

-

order by limit 形式的sql语句让排序的表优先查

-

了解业务方使用场景

-

加索引时参照建索引的几大原则

-

观察结果,不符合预期继续从0分析

几个慢查询案例

复杂语句写法

很多情况下,我们写SQL只是为了实现功能,这只是第一步,不同的语句书写方式对于效率往往有本质的差别,这要求我们对mysql的执行计划和索引原则有非常清楚的认识,请看下面的语句:

select

distinct cert.emp_id

from

cm_log cl

inner join

(

select

emp.id as emp_id,

emp_cert.id as cert_id

from

employee emp

left join

emp_certificate emp_cert

on emp.id = emp_cert.emp_id

where

emp.is_deleted=0

) cert

on (

cl.ref_table='Employee'

and cl.ref_oid= cert.emp_id

)

or (

cl.ref_table='EmpCertificate'

and cl.ref_oid= cert.cert_id

)

where

cl.last_upd_date >='2013-11-07 15:03:00'

and cl.last_upd_date<='2013-11-08 16:00:00';

-

先运行一下,53条记录 1.87秒,又没有用聚合语句,比较慢

53 rows in set (1.87 sec)

-

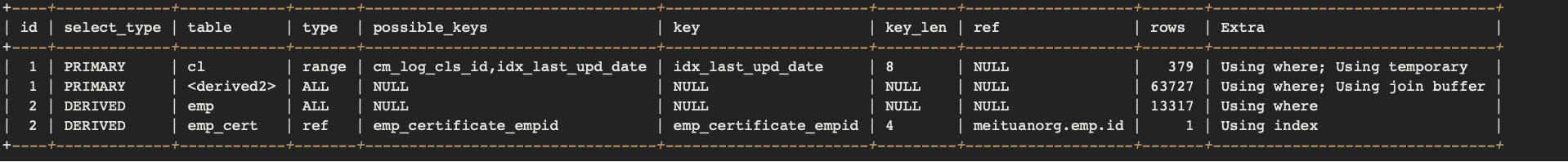

explain

简述一下执行计划,首先mysql根据idx_last_upd_date索引扫描cm_log表获得379条记录;然后查表扫描了63727条记录,分为两部分,derived表示构造表,也就是不存在的表,可以简单理解成是一个语句形成的结果集,后面的数字表示语句的ID。derived2表示的是ID = 2的查询构造了虚拟表,并且返回了63727条记录。我们再来看看ID = 2的语句究竟做了写什么返回了这么大量的数据,首先全表扫描employee表13317条记录,然后根据索引emp_certificate_empid关联emp_certificate表,rows = 1表示,每个关联都只锁定了一条记录,效率比较高。获得后,再和cm_log的379条记录根据规则关联。从执行过程上可以看出返回了太多的数据,返回的数据绝大部分cm_log都用不到,因为cm_log只锁定了379条记录。

如何优化呢?可以看到我们在运行完后还是要和cm_log做join,那么我们能不能之前和cm_log做join呢?仔细分析语句不难发现,其基本思想是如果cm_log的ref_table是EmpCertificate就关联emp_certificate表,如果ref_table是Employee就关联employee表,我们完全可以拆成两部分,并用union连接起来,注意这里用union,而不用union all是因为原语句有“distinct”来得到唯一的记录,而union恰好具备了这种功能。如果原语句中没有distinct不需要去重,我们就可以直接使用union all了,因为使用union需要去重的动作,会影响SQL性能。

优化过的语句如下:

select

emp.id

from

cm_log cl

inner join

employee emp

on cl.ref_table = 'Employee'

and cl.ref_oid = emp.id

where

cl.last_upd_date >='2013-11-07 15:03:00'

and cl.last_upd_date<='2013-11-08 16:00:00'

and emp.is_deleted = 0

union

select

emp.id

from

cm_log cl

inner join

emp_certificate ec

on cl.ref_table = 'EmpCertificate'

and cl.ref_oid = ec.id

inner join

employee emp

on emp.id = ec.emp_id

where

cl.last_upd_date >='2013-11-07 15:03:00'

and cl.last_upd_date<='2013-11-08 16:00:00'

and emp.is_deleted = 0

-

不需要了解业务场景,只需要改造的语句和改造之前的语句保持结果一致

-

现有索引可以满足,不需要建索引

-

用改造后的语句实验一下,只需要10ms 降低了近200倍!

明确应用场景

举这个例子的目的在于颠覆我们对列的区分度的认知,一般上我们认为区分度越高的列,越容易锁定更少的记录,但在一些特殊的情况下,这种理论是有局限性的。

select

*

from

stage_poi sp

where

sp.accurate_result=1

and (

sp.sync_status=0

or sp.sync_status=2

or sp.sync_status=4

);

-

先看看运行多长时间,951条数据6.22秒,真的很慢。

951 rows in set (6.22 sec) -

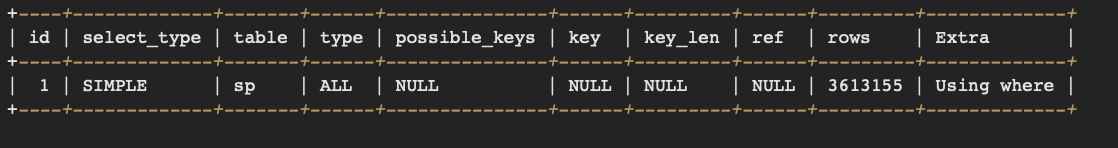

先explain,rows达到了361万,type = ALL表明是全表扫描。

-

所有字段都应用查询返回记录数,因为是单表查询 0已经做过了951条。

-

让explain的rows 尽量逼近951。

看一下accurate_result = 1的记录数:

我们看到accurate_result这个字段的区分度非常低,整个表只有-1,0,1三个值,加上索引也无法锁定特别少量的数据。

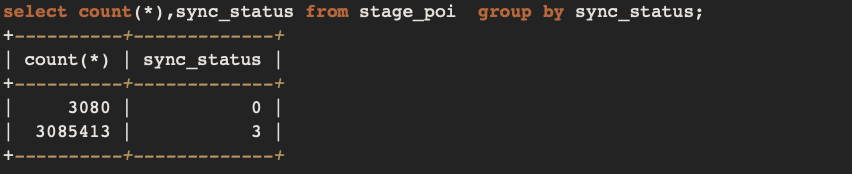

再看一下sync_status字段的情况:

同样的区分度也很低,根据理论,也不适合建立索引。

问题分析到这,好像得出了这个表无法优化的结论,两个列的区分度都很低,即便加上索引也只能适应这种情况,很难做普遍性的优化,比如当sync_status 0、3分布的很平均,那么锁定记录也是百万级别的。

-

找业务方去沟通,看看使用场景。业务方是这么来使用这个SQL语句的,每隔五分钟会扫描符合条件的数据,处理完成后把sync_status这个字段变成1,五分钟符合条件的记录数并不会太多,1000个左右。了解了业务方的使用场景后,优化这个SQL就变得简单了,因为业务方保证了数据的不平衡,如果加上索引可以过滤掉绝大部分不需要的数据。

-

根据建立索引规则,使用如下语句建立索引

alter table stage_poi add index idx_acc_status(accurate_result,sync_status);

-

观察预期结果,发现只需要200ms,快了30多倍。

952 rows in set (0.20 sec)

我们再来回顾一下分析问题的过程,单表查询相对来说比较好优化,大部分时候只需要把where条件里面的字段依照规则加上索引就好,如果只是这种“无脑”优化的话,显然一些区分度非常低的列,不应该加索引的列也会被加上索引,这样会对插入、更新性能造成严重的影响,同时也有可能影响其它的查询语句。所以我们第4步调差SQL的使用场景非常关键,我们只有知道这个业务场景,才能更好地辅助我们更好的分析和优化查询语句。

自己理解:根据本地测试,mysql5.6版本,where or是不会使用索引的。并且在此例中,针对每个查询字段单加索引不但意义不大,而且会影响数据库插入和更新记录的速度。而根据联合索引的最左匹配原则,应该将accurate_result放在前面,这样才会使用到建立的联合索引。

无法优化的语句

select

c.id,

c.name,

c.position,

c.sex,

c.phone,

c.office_phone,

c.feature_info,

c.birthday,

c.creator_id,

c.is_keyperson,

c.giveup_reason,

c.status,

c.data_source,

from_unixtime(c.created_time) as created_time,

from_unixtime(c.last_modified) as last_modified,

c.last_modified_user_id

from

contact c

inner join

contact_branch cb

on c.id = cb.contact_id

inner join

branch_user bu

on cb.branch_id = bu.branch_id

and bu.status in (

1,

2)

inner join

org_emp_info oei

on oei.data_id = bu.user_id

and oei.node_left >= 2875

and oei.node_right <= 10802

and oei.org_category = - 1

order by

c.created_time desc limit 0 ,

10;

还是几个步骤。

-

先看语句运行多长时间,10条记录用了13秒,已经不可忍受。

10 rows in set (13.06 sec)

-

explain

从执行计划上看,mysql先查org_emp_info表扫描8849记录,再用索引idx_userid_status关联branch_user表,再用索引idx_branch_id关联contact_branch表,最后主键关联contact表。

rows返回的都非常少,看不到有什么异常情况。我们在看一下语句,发现后面有order by + limit组合,会不会是排序量太大搞的?于是我们简化SQL,去掉后面的order by 和 limit,看看到底用了多少记录来排序。

发现排序之前居然锁定了778878条记录,如果针对70万的结果集排序,将是灾难性的,怪不得这么慢,那我们能不能换个思路,先根据contact的created_time排序,再来join会不会比较快呢?

于是改造成下面的语句,也可以用straight_join来优化:

select

c.id,

c.name,

c.position,

c.sex,

c.phone,

c.office_phone,

c.feature_info,

c.birthday,

c.creator_id,

c.is_keyperson,

c.giveup_reason,

c.status,

c.data_source,

from_unixtime(c.created_time) as created_time,

from_unixtime(c.last_modified) as last_modified,

c.last_modified_user_id

from

contact c

where

exists (

select

1

from

contact_branch cb

inner join

branch_user bu

on cb.branch_id = bu.branch_id

and bu.status in (

1,

2)

inner join

org_emp_info oei

on oei.data_id = bu.user_id

and oei.node_left >= 2875

and oei.node_right <= 10802

and oei.org_category = - 1

where

c.id = cb.contact_id

)

order by

c.created_time desc limit 0 ,

10;

验证一下效果 预计在1ms内,提升了13000多倍!

10 rows in set (0.00 sec)

自己理解:在mysql执行过程中,排序本身就是一个比较慢的操作,排序记录越多越慢。mysql执行时,join的优先级比order by要高,所以查询时先join表,再排序,当join表得到的数据量大时,排序就时灾难。那么我们可以先排序,取前10条,当排序字段是主表字段,并且该字段上有索引时,排序时就会利用索引,非常快。然后根据取出来的这10条再去join表,由于数据量有限,速度也会非常快。而让mysql先排序再join就要用exists关键字了,因为mysql在执行过程中,mysql会先执行order by 再执行exists。

Exists(包括 NOT Exists)字句的返回值时一个布尔值。如果Exists内部有一个子查询语句(select … from…),我们将其称为Exists的内查询语句。其内查询语句返回一个结果集。Exists子句根据其内查询语句的结果集空或者非空,返回一个布尔值。通俗理解为:将外查询的每一行,代入内查询作为检验,如果内查询返回的结果取非空值,则Exists字句返回TRUE,这一行行可作为外查询的结果行,否则不能作为结果。

在上面的例子中,查询获取的字段都是主表的字段,join表只是为了过滤,所以用exists时可以满足业务需求的。

本以为至此大工告成,但我们在前面的分析中漏了一个细节,先排序再join和先join再排序理论上开销是一样的,为何提升这么多是因为有一个limit!大致执行过程是:mysql先按索引排序得到前10条记录,然后再去join过滤,当发现不够10条的时候,再次去10条,再次join,这显然在内层join过滤的数据非常多的时候,将是灾难的,极端情况,内层一条数据都找不到,mysql还傻乎乎的每次取10条,几乎遍历了这个数据表!

用不同参数的SQL试验下:

select

sql_no_cache c.id,

c.name,

c.position,

c.sex,

c.phone,

c.office_phone,

c.feature_info,

c.birthday,

c.creator_id,

c.is_keyperson,

c.giveup_reason,

c.status,

c.data_source,

from_unixtime(c.created_time) as created_time,

from_unixtime(c.last_modified) as last_modified,

c.last_modified_user_id

from

contact c

where

exists (

select

1

from

contact_branch cb

inner join

branch_user bu

on cb.branch_id = bu.branch_id

and bu.status in (

1,

2)

inner join

org_emp_info oei

on oei.data_id = bu.user_id

and oei.node_left >= 2875

and oei.node_right <= 2875

and oei.org_category = - 1

where

c.id = cb.contact_id

)

order by

c.created_time desc limit 0 ,

10;

Empty set (2 min 18.99 sec)

2 min 18.99 sec!比之前的情况还糟糕很多。由于mysql的nested loop机制,遇到这种情况,基本是无法优化的。这条语句最终也只能交给应用系统去优化自己的逻辑了。

通过这个例子我们可以看到,并不是所有语句都能优化,而往往我们优化时,由于SQL用例回归时落掉一些极端情况,会造成比原来还严重的后果。所以,第一:不要指望所有语句都能通过SQL优化,第二:不要过于自信,只针对具体case来优化,而忽略了更复杂的情况。

慢查询的案例就分析到这儿,以上只是一些比较典型的案例。我们在优化过程中遇到过超过1000行,涉及到16个表join的“垃圾SQL”,也遇到过线上线下数据库差异导致应用直接被慢查询拖死,也遇到过varchar等值比较没有写单引号,还遇到过笛卡尔积查询直接把从库搞死。再多的案例其实也只是一些经验的积累,如果我们熟悉查询优化器、索引的内部原理,那么分析这些案例就变得特别简单了。

番外:

varchar等值比较单引号引发效率问题。

当查询的字段上varchar类型的数字值,但是条件中没有对数字加单引号时,进行的是全表扫描。如果加了单引号,就会应用到字段上的索引。

不是没发走索引,是木有索引可走,这是由于数据类型不一致,没办法比较,右值数据类型是int, 而左值存储的字段类型是varchar, mysql木有严格的检查数据类型,我估计是采用尝试的策略来转换数据类型,发现字段值可以转换成int,于是转换了改列所有的数据,由于记录数很多,所以造成了很慢,而后我又尝试将varchar字段里赋值为’asd测试’ 这样的数据,发现mysql查询报错,这说明确实采用了运行时动态转换的原则,发现转换后的字符编码不再’0’-'9’的字符范畴,这里我觉得mysql以后的版本里最好限制这种隐式转换,不同的数据类型不让比较,便可以防止这种问题的发生:)

本文参考:

https://www.iteye.com/blog/tuhaitao-1260864

https://tech.meituan.com/2014/06/30/mysql-index.html