Introduction

ResNet论文是里程碑级的backbone network,因此获得了 CVPR 2016 Best Paper:

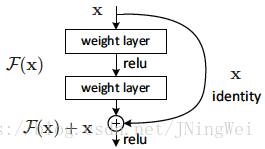

文章受Highway Networks启发,通过在在不相邻的feature map间添加“跨越式”的identity mapping通道,设计出了如下的残差组件模板:

该设计的作用就是让网络的学习目标变成了“残差”:

学习“残差”明显比学习原来的对象要容易:

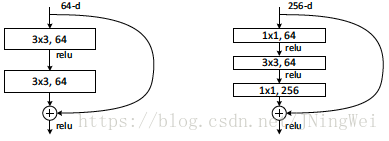

作者还给出了该组件的两种常用型号。左边是适用小网络的residual组件,右边是适用大网络的residual组件(其中的

卷积核用于降维):

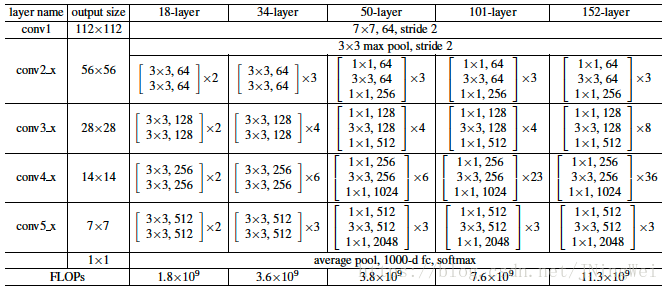

并给出了ResNet系列的各型号说明书:

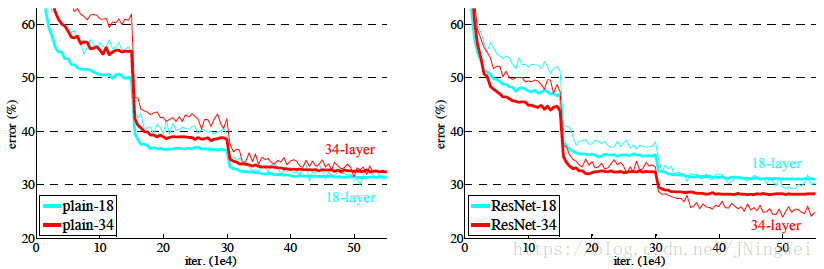

经过试验,ResNet可以有效避免之前plain network在加深网络层后,因为梯度消失问题所导致的训练误差不降反升的问题:

ResNet于2015年横空出世,获得ImageNet 2015的冠军。此后一直独领风骚至今,成为各network的首选backbone,影响极其深远。

Innovation

ResNet受了 Highway Networks 的启发。Highway Networks第一个设计了不同层feature map之间的identity mapping。ResNet极大地简化了Highway Networks的大量mapping设计,只在相邻模块之间进行identity mapping。不仅极大地缓解了梯度问题,使得网络深度得到了一次新的解放,同时该设计也使得训练早期可以极快地收敛。

但其本质就是“隔桌传小抄”。所以尽管ResNet-101看起来有那么多层,其实本身结构比ResNet-18复杂不了不少。

至于为什么要说加上identity mapping后的效果会变好,一种说法是这样的:

要学得的模型中,有一些部分是identity mapping。而原始的“串行式”网络很难学得这种identity mapping。那么ResNet就给模型学习增加了约束,帮模型轻松学得了identity mapping。

Result

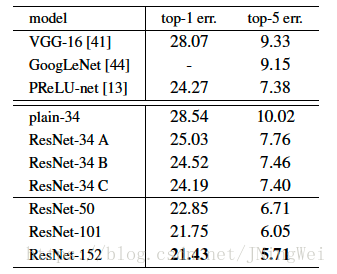

贵为ImageNet 2015冠军,ResNet吊打其他network:

Thinking

ResNet很简单,但非常强大。ResNet与其加强版ResNeXt互为补充。前者因为结构简单,效果好,成为了日常使用时各network的首选backbone。后者结构复杂,在大数据集和更深的网络上效果略略优于ResNet,因此成为打比赛时各network的首选backbone。

Zhang xiangyu等大神先是研究了一整年的Inception,才灵感大发而设计出残差结构。说明ResNet不仅有Highway Networks的影子,也有Inception的影子。

评价ResNet只有三个形容词:

简单,强大,划时代。