版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/qq_33054265/article/details/87970144

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类SQL(HQL)查询功能。Hive是将HQL转化为MapReduce程序,Hive处理的数据存储在HDFS上,执行程序运行在Yarn上。由于执行的是MapReduce程序,延迟比较高(还有一个重要的原因是,没有索引而需要扫描整个表),因此Hive常用于离线的数据分析。

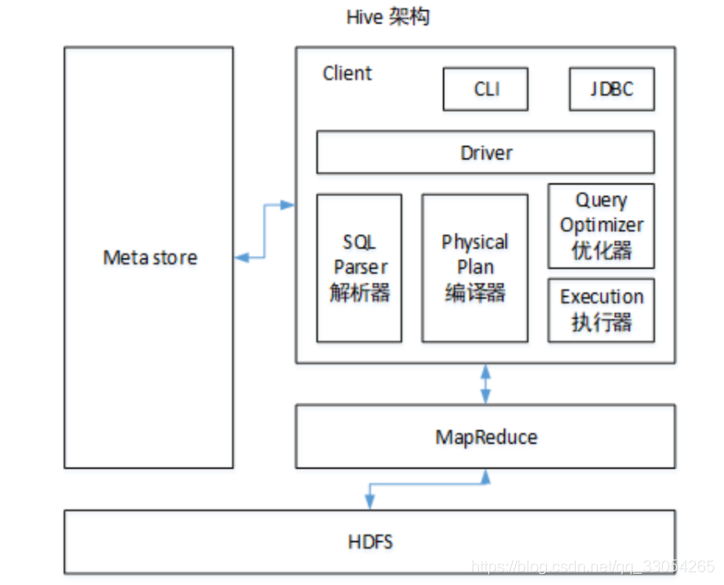

Hive架构图

- Client:用户接口

CLI(command-line interface)、JDBC/ODBC(jdbc访问hive)、WEBUI(浏览器访问hive) - Metastore:元数据

元数据包括表名、表所属的数据库、表的拥有者、列/分区字段、表的类型、表的数据所在目录等;默认存储在自带的derby数据库中,由于开启多个hive时会报异常,推荐使用MySQL存储Metastore。 - Hadoop

使用HDFS进行存储数据,使用MapReduce进行计算。 - Driver:驱动器

解析器(SQL Parser):将SQL字符串转换成抽象语法树AST,对AST进行语法分析,比如表是否存在,字段是否存在,SQL语义是否有误。

编译器(Physical Plan):将AST编译生成逻辑执行计划。

优化器(Query Optimizer):对逻辑执行计划进行优化。

执行器(Execution):把逻辑执行计划转化成可以运行的物理计划,即MapReduce。

Hive通过给用户提供的一系列交互接口,接收到用户的指令(SQL),使用自己的驱动器(Driver),将SQL语句解析成对应的MapReduce程序,并生成相应的jar包,结合元数据(MetaStore)提供的对应文件的路径,提交到Hadoop中执行,最后将执行结果输出到用户交互接口。