最近整理了一下pytorch的笔记,把很简单的pytorch搭建一个回归网络的code贴上来

import torch

import torch.nn.functional as F

x = torch.unsqueeze(torch.linspace(-2, 2, 100), dim=1)#在(-1,1)这个区间内随机生成100个X,并且利用unsqueeze增加维度来满足torch的需求

y = x.pow(3) + 0.9*torch.rand(x.size()) # 生成y

#想把tensor转换成numpy用.data.numpy()

class Net(torch.nn.Module):

def __init__(self, n_feature, n_hidden, n_output):

super(Net, self).__init__()

self.hidden = torch.nn.Linear(n_feature, n_hidden) # hidden layer

self.predict = torch.nn.Linear(n_hidden, n_output) # 全连接层

def forward(self, x):

x = F.relu(self.hidden(x)) # hidden layer 经过激励函数

x = self.predict(x)

return x

net = Net(n_feature=1, n_hidden=10, n_output=1) # 定义神经网络,一个输入,10个神经元(一层),一个输出

optimizer = torch.optim.SGD(net.parameters(), lr=0.1) #优化器,本次采用的是SGD优化

loss_func = torch.nn.MSELoss() #mean squared loss 均值方差,针对回归问题

for t in range(500):

prediction = net(x)

loss = loss_func(prediction, y) # 计算损失函数

optimizer.zero_grad() # 清除本次的梯度

loss.backward() # 反向传播计算梯度

optimizer.step() # 每一步用优化器优化一次

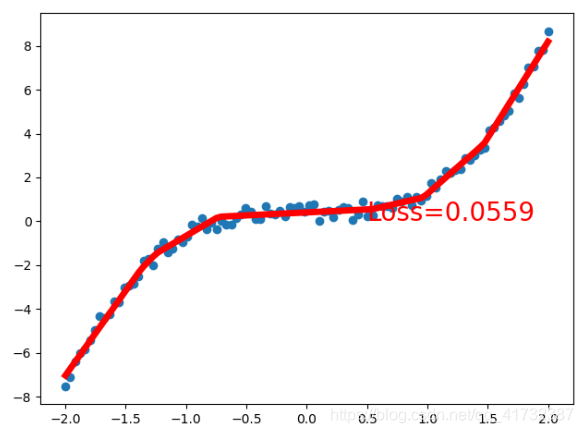

plt.cla()

plt.scatter(x.data.numpy(), y.data.numpy())

plt.plot(x.data.numpy(), prediction.data.numpy(), 'r-', lw=5)

plt.text(0.5, 0, 'Loss=%.4f' % loss.data.numpy(), fontdict={'size': 20, 'color': 'red'})

plt.pause(0.1)

plt.ioff()

plt.show()

运行结果