朴素贝叶斯(Naïve Bayes)法是基于贝叶斯定理与特征条件独立假设的分类方法。对于给定的训练数据集,首先基于特征条件独立假设学习输入、输出的联合概率分布;然后基于此模块,对给定的输入x,利用贝叶斯定理求出求出后验概率最大输出y。

1.1朴素贝叶斯法的学习与分类

1.1.1基本方法

设输入空间 为n维向量的集合,输出空间为类标记集合 ={c1,c2,…,cK} 。输入为特征向量 ,输出为类标记(class label) 。X 是定义在特征空间 上的随机向量,Y是定义在输出空间 上的随机变量。P(X,Y)是X和Y的联合概率分布。训练数据集T={(x1,y1),(x2,y2),…,(xN,yN)}由*P(X,Y)*独立同分布产生。

朴素贝叶斯法通过训练数据集学习联合概率分布P(X,Y)。具体地,学习以下先验概率分布及条件概率分布。先验概率分布

(1.1)

条件概率分布(1.2)

于是学习到联合概率分布 P(X,Y)。条件概率分布P(X=x|Y=ck) 有指数级数量的参数,其估计实际是不可行的。事实上,假设xj 可能的取值有Sj个,j=1,2,…,n,Y可能的取值有K个,那么参数个数为K Sj

朴素贝叶斯法对条件概率做了条件独立性的假设。由于这是一个较强的假设,朴素贝叶斯法也因此而得名。具体的,条件独立性假设是

=

P(Xj=xj|Y=ck)

朴素贝叶斯法实际上学习到生成数据的机制,所以属于生成模型。提哦案件独立假设等于是说用于分类的特征在类确定的条件下是条件独立的。这一假设使朴素贝叶斯变得简单,但是有时会牺牲一些准确率。

1.1.2后验概率最大化的含义

朴素贝叶斯法将实例分到后验概率最大的类中。这等于期望风险最小化。假设选择0-1损失函数:

L(Y,

(X))=

式中

(X)是分类决策函数。这时,期望风险函数为

&emspRexp(

)=E[L(Y,

(X))]

期望是对联合概率分布P(X,Y)取的。由此取条件期望

&emspRexp(

)=EX

[L(ck,

(X))]P(ck|X)

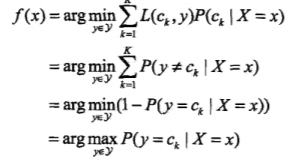

为了使期望风险最小化。只需对X=x逐个最小化,由此可得到:

这样一来,根据期望风险最小化的准则就得到了后验概率最大化的准则:

即朴素贝叶斯法所采用的原理。

2.朴素贝叶斯法的参数估计

2.1极大似然估计

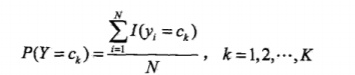

在朴素贝叶斯法中,学习意味着估计P(Y=ck) 和P(Xj=xj |Y=ck)。可以应用极大似然估计是

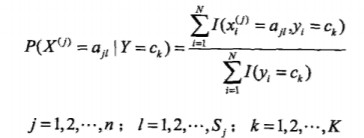

设第j个特征x(j)可能取值的集合为{aj1,aj2,

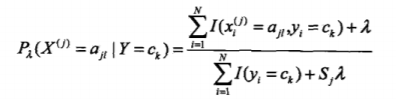

,ajSj},条件概率P(X(j)=ajl|Y=ck)的极大似然估计是

式中,xi(j)是第i个样本的第j个特征;ajl是第j个特征可能取的第l个值;I为指示函数。

2.2学习与分类算法

下面给出朴素贝叶斯法的学习方法与分类算法

算法:朴素贝叶斯算法(Naïve Bayes algorithm)

2.3贝叶斯估计

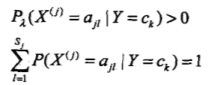

用极大似然估计可能会出现所要估计的概率值为0的情况。这时会影响到后验概率的计算结果,使分类产生偏差。解决这一问题的方法是采用贝叶斯估计。具体的,条件概率的贝叶斯估计是

式中

。等价于在随机变量各个取值的频数上赋予一个正数

。当

时,就是极大似然估计。常取

,这时成为拉普拉斯平滑(Laplace smoothing)。显然,对于任何l=1,2,3,

,K,有

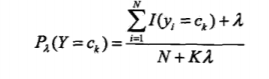

表明上面的式子确为一种概率分布。同样,先验概率分布的贝叶斯估计是