1、线性函数归一化(Min-Max scaling),线性函数将原始数据线性化的方法转换到[0 1]的范围,归一化公式如下:

该方法实现对原始数据的等比例缩放,其中Xnorm为归一化后的数据,X为原始数据,Xmax、Xmin分别为原始数据集的最大值和最小值。

2、0均值标准化(Z-score standardization),0均值归一化方法将原始数据集归一化为均值为0、方差1的数据集,归一化公式如下:

其中,μ、σ分别为原始数据集的均值和方法。该种归一化方式要求原始数据的分布可以近似为高斯分布,否则归一化的效果会变得很糟糕。

以上为两种比较普通但是常用的归一化技术,那这两种归一化的应用场景是怎么样的呢?什么时候第一种方法比较好、什么时候第二种方法比较好呢?下面做一个简要的分析概括:

1、在分类、聚类算法中,需要使用距离来度量相似性的时候、或者使用PCA技术进行降维的时候,第二种方法(Z-score standardization)表现更好。

2、在不涉及距离度量、协方差计算、数据不符合正太分布的时候,可以使用第一种方法或其他归一化方法。比如图像处理中,将RGB图像转换为灰度图像后将其值限定在[0 255]的范围。

///////////////////////////////////////////////////////////////////////////////////////////////////

关于神经网络归一化方法的整理

由于采集的各数据单位不一致,因而须对数据进行[-1,1]归一化处理,归一化方法主要有如下几种,供大家参考:(by james)

1、线性函数转换,表达式如下:

y=(x-MinValue)/(MaxValue-MinValue)

说明:x、y分别为转换前、后的值,MaxValue、MinValue分别为样本的最大值和最小值。

2、对数函数转换,表达式如下:

y=log10(x)

说明:以10为底的对数函数转换。

3、反余切函数转换,表达式如下:

y=atan(x)*2/PI

归一化是为了加快训练网络的收敛性,可以不进行归一化处理

归一化的具体作用是归纳统一样本的统计分布性。归一化在0-1之间是统计的概率分布,归一化在-1–+1之间是统计的坐标分布。归一化有同一、 统一和合一的意思。无论是为了建模还是为了计算,首先基本度量单位要同一,神经网络是以样本在事件中的统计分别几率来进行训练(概率计算)和预测的,归一 化是同一在0-1之间的统计概率分布;

当所有样本的输入信号都为正值时,与第一隐含层神经元相连的权值只能同时增加或减小,从而导致学习速度很慢。为了避免出现这种情况,加快网络学习速度,可以对输入信号进行归一化,使得所有样本的输入信号其均值接近于0或与其均方差相比很小。

归一化是因为sigmoid函数的取值是0到1之间的,网络最后一个节点的输出也是如此,所以经常要对样本的输出归一化处理。所以这样做分类的问题时用[0.9 0.1 0.1]就要比用[1 0 0]要好。

但是归一化处理并不总是合适的,根据输出值的分布情况,标准化等其它统计变换方法有时可能更好。

关于用premnmx语句进行归一化:

premnmx语句的语法格式是:[Pn,minp,maxp,Tn,mint,maxt]=premnmx(P,T)

其中P,T分别为原始输入和输出数据,minp和maxp分别为P中的最小值和最大值。mint和maxt分别为T的最小值和最大值。

premnmx函数用于将网络的输入数据或输出数据进行归一化,归一化后的数据将分布在[-1,1]区间内。

我们在训练网络时如果所用的是经过归一化的样本数据,那么以后使用网络时所用的新数据也应该和样本数据接受相同的预处理,这就要用到tramnmx。

下面介绍tramnmx函数:

[Pn]=tramnmx(P,minp,maxp)

其中P和Pn分别为变换前、后的输入数据,maxp和minp分别为premnmx函数找到的最大值和最小值。

(by terry2008)

matlab中的归一化处理有三种方法

1. premnmx、postmnmx、tramnmx

2. restd、poststd、trastd

3. 自己编程

具体用那种方法就和你的具体问题有关了

(by happy)

pm=max(abs(p(i,:))); p(i,:)=p(i,:)/pm;

和

for i=1:27

p(i,:)=(p(i,:)-min(p(i,:)))/(max(p(i,:))-min(p(i,:)));

end 可以归一到0 1 之间

0.1+(x-min)/(max-min)*(0.9-0.1)其中max和min分别表示样本最大值和最小值。

这个可以归一到0.1-0.9

=============

数据类型相互转换

这种转换可能发生在算术表达式、赋值表达式和输出时。转换的方式有两种:自动转换和强制转换。

========

自动转换

自动转换由编译系统自动完成,可以将一种数据类型的数据转换为另外一种数据类型的数据。

1)算术运算中的数据转换

如果一个运算符有两个不同类型的运算分量,C语言在计算该表达式时会自动转换为同一种数据类型以便进行运算。先将较低类型的数据提升为较高的类型,从而使两者的数据类型一致(但数值不变),然后再进行计算,其结果是较高类型的数据。 自动转换遵循原则——“类型提升”:转换按数据类型提升(由低向高)的方向进行,以保证不降低精度。 数据类型的高低是根据其类型所占空间的大小来判定,占用空间越大,类型越高。反之越低。 例如:算术运算x+y,如果x和y的类型都是int型变量,则x+y的结果自然是int型。如果x是short型而y是int型,则需要首先将x转换为int型,然后再与y进行加法计算,表达式的结果为int型。

2)赋值运算的类型转换

在执行赋值运算时,如果赋值运算符两侧的数据类型不同,赋值号右侧表达式类型的数据将转换为赋值号左侧变量的类型。转换原则是:当赋值运算符“=”右侧表达式的值被计算出来后,不论是什么类型都一律转换为“=”左侧的变量的类型,然后再赋值给左侧的变量。

例如:float a;

a=10;? /*结果为a=10.0(数据填充)*/

int a;

a=15.5 /* 结果为a=15(数据截取)*/

在赋值类型转换时要注意数值的范围不能溢出。既要在该数据类型允许的范围内。如如果右侧变量数据类型长度比左侧的长时,将丢失一部分数据,从而造成数据精度的降低。

3)数据输出时的类型转换

在输出时,数据将转换为格式控制符所要求的类型。同样可能发生数据丢失或溢出。类型转换的实际情况是:字符型到整型是取字符的ASCII码值;整型到字符型只是取其低8位;实型到整型要去掉小数部分;整型到实型数值不变,但以实数形式存放;双精度到实型是四舍五入的。

========

强制转换

一般情况下,数据类型的转换通常是由编译系统自动进行的,不需要程序员人工编写程序干预,所以又被称为隐式类型转换。但如果程序要求一定将某一类型的数据从该种类型强制地转换为另外一种类型,则需要人工编程进行强制类型转换,也称为显式转换。强制类型转换的目地是使数据类型发生改变,从而使不同类型的数据之间的运算能够进行下去。

语法格式如下:

(类型说明符)表达式

功能是强行地将表达式的类型转换为括号内要求的类型。

例如:(int)4.2的结果是4;

又如:int x;

(float)x;x的值被强制转换为实型,但是并不改变的x类型是整型。只是在参与运算处理时按照实型处理。

======

线性函数转转讲一系列数据映射到相应区间,例如将所有数据映射到 1~100

可用下列函数

y=((x-min)/(max-min))*(100-1)+1

1-100 范围内

min是数据集中最小值,max是最大值

///////////////////////////////////////////////////////////////////////////////////////////////////

为什么在距离度量计算相似性、PCA中使用第二种方法(Z-score standardization)会更好呢?我们进行了以下的推导分析:

归一化方法对方差、协方差的影响:假设数据为2个维度(X、Y),首先看0均值对方差、协方差的影响:

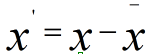

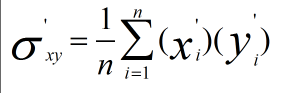

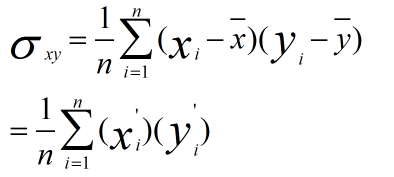

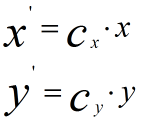

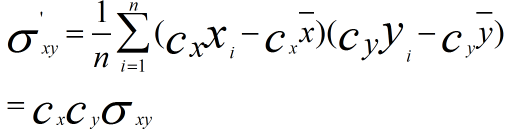

先使用第二种方法进行计算,我们先不做方差归一化,只做0均值化,变换后数据为

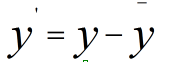

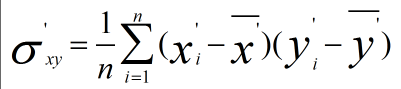

新数据的协方差为

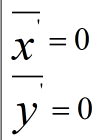

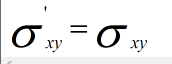

由于

因此

而原始数据协方差为

因此

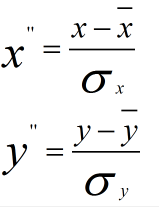

做方差归一化后:

方差归一化后的协方差为:

使用第一种方法进行计算,为方便分析,我们只对X维进行线性函数变换

计算协方差

可以看到,使用第一种方法(线性变换后),其协方差产生了倍数值的缩放,因此这种方式无法消除量纲对方差、协方差的影响,对PCA分析影响巨大;同时,由于量纲的存在,使用不同的量纲、距离的计算结果会不同。

而在第二种归一化方式中,新的数据由于对方差进行了归一化,这时候每个维度的量纲其实已经等价了,每个维度都服从均值为0、方差1的正态分布,在计算距离的时候,每个维度都是去量纲化的,避免了不同量纲的选取对距离计算产生的巨大影响。

总结来说,在算法、后续计算中涉及距离度量(聚类分析)或者协方差分析(PCA、LDA等)的,同时数据分布可以近似为状态分布,应当使用0均值的归一化方法。其他应用中更具需要选用合适的归一化方法。