目录

- 概述

- 工作机制

- 安装部署

- 实战

1.概述

sqoop是apache旗下一款“Hadoop和关系数据库服务器之间传送数据”的工具。

- 导入数据:MySQL,Oracle导入数据到Hadoop的HDFS、HIVE、HBASE等数据存储系统;

- 导出数据:从Hadoop的文件系统中导出数据到关系数据库。

2.工作机制

将导入或导出命令翻译成mapreduce程序来实现,在翻译出的mapreduce中主要是对inputformat和outputformat进行定制。其实就是将导入导出命令转化为mapreduce程序来执行,sqoop在接收到命令后,都要生成mapreduce程序,使用sqoop的代码生成工具可以方便查看到sqoop所生成的java代码,并可在此基础之上进行深入定制开发。

3.安装部署

- 软件准备

安装sqoop的前提是已经具备java和hadoop的环境;

最新版下载地址http://ftp.wayne.edu/apache/sqoop/1.4.6/

- 修改配置文件

$ cd $SQOOP_HOME/conf

$ mv sqoop-env-template.sh sqoop-env.sh

打开sqoop-env.sh并编辑下面几行:

export HADOOP_COMMON_HOME=/home/hadoop/apps/hadoop-2.6.1/

export HADOOP_MAPRED_HOME=/home/hadoop/apps/hadoop-2.6.1/

export HIVE_HOME=/home/hadoop/apps/hive-1.2.1

- 加载驱动

$ cp ~/app/hive/lib/mysql-connector-java-5.1.28.jar $SQOOP_HOME/lib/

- 启动

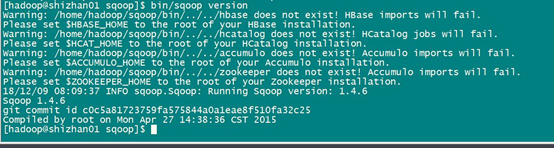

$ cd $SQOOP_HOME/bin

$ sqoop-version

4 .实战

- import :

(1)从mysql数据库 urldb中的url_rule表,导入 HDFS:

$bin/sqoop import \

--connect jdbc:mysql://shizhan01:3306/urldb \

--username root \

--password root \

--table url_rule\

--m 1

(2)从mysql数据库 urldb中的url_rule表,导入 Hive:

$bin/sqoop import \

--connect jdbc:mysql://shizhan01:3306/urldb \

--username root \

--password root \

--table url_rule \

--hive-import \

--m 1

- export :从HDFS导入数据库, 注意提前在数据库中建立表结构。

bin/sqoop export \

--connect jdbc:mysql://shizhan01:3306/db \

--username root \

--password root \

--table employee \

--export-dir /queryresult