数据迁移工具 – Sqoop

文章目录

第一部分 Sqoop概述

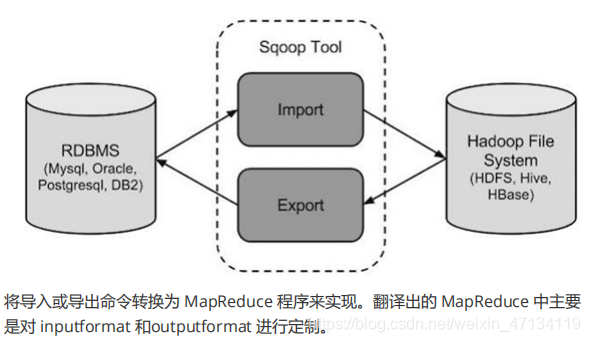

Sqoop是一款开源的工具,主要用于在Hadoop(Hive)与传统的数据库(mysql、postgresql等)间进行数据的传递。可以将关系型数据库(MySQL ,Oracle ,Postgres等)中的数据导入到HDFS中,也可以将HDFS的数据导进到关系型数据库中。

Sqoop项目开始于2009年,最早是作为Hadoop的一个第三方模块存在,后来为了让使用者能够快速部署,也为了让开发人员能够更快速的迭代开发,Sqoop独立成为一个 Apache 项目。

第二部分 安装配置

Sqoop 官网:http://sqoop.apache.org/

Sqoop下载地址:http://www.apache.org/dyn/closer.lua/sqoop/

1、下载、上传并解压

将下载的安装包 sqoop-1.4.6.bin__hadoop-2.0.4-alpha.tar.gz 上传到虚拟机中;

解压缩软件包;

tar zxvf sqoop-1.4.7.bin__hadoop-2.6.0.tar.gz

mv sqoop-1.4.7.bin__hadoop-2.6.0/ ../servers/sqoop-1.4.7/

2、增加环境变量,并使其生效

vi /etc/profile

# 增加以下内容

export SQOOP_HOME=/opt/lagou/servers/sqoop-1.4.7

export PATH=$PATH:$SQOOP_HOME/bin

source /etc/profile

3、创建、修改配置文件

# 配置文件位置 $SQOOP_HOME/conf;要修改的配置文件为 sqoop-env.sh

cp sqoop-env-template.sh sqoop-env.sh

vi sqoop-env.sh

# 在文件最后增加以下内容

export HADOOP_COMMON_HOME=/opt/lagou/servers/hadoop-2.9.2

export HADOOP_MAPRED_HOME=/opt/lagou/servers/hadoop-2.9.2

export HIVE_HOME=/opt/lagou/servers/hive-2.3.7

4、拷贝JDBC驱动程序

# 拷贝jdbc驱动到sqoop的lib目录下(备注:建立软链接也可以)

ln -s /opt/lagou/servers/hive-2.3.7/lib/mysql-connector-java-5.1.46.jar /opt/lagou/servers/sqoop-1.4.7/lib/

5、拷贝 jar

将 H I V E H O M E / l i b 下 的 h i v e − c o m m o n − 2.3.7. j a r , 拷 贝 到 HIVE_HOME/lib 下的 hive-common-2.3.7.jar,拷贝到 HIVEHOME/lib下的hive−common−2.3.7.jar,拷贝到SQOOP_HOME/lib目录下。如不拷贝在MySQL往Hive导数据的时候将会出现错误:ClassNotFoundException:org.apache.hadoop.hive.conf.HiveConf

# 硬拷贝 和 建立软链接都可以,选择一个执行即可。下面是硬拷贝

cp $HIVE_HOME/lib/hive-common-2.3.7.jar $SQOOP_HOME/lib/

# 建立软链接

ln -s /opt/lagou/servers/hive-2.3.7/lib/hive-common-2.3.7.jar /opt/lagou/servers/sqoop-1.4.7/lib/hive-common-2.3.7.jar

将 H A D O O P H O M E / s h a r e / h a d o o p / t o o l s / l i b / j s o n − 20170516. j a r 拷 贝 到 HADOOP_HOME/share/hadoop/tools/lib/json-20170516.jar 拷贝到 HADOOPHOME/share/hadoop/tools/lib/json−20170516.jar拷贝到SQOOP_HOME/lib/ 目录下;否则在创建sqoop job时会报:java.lang.NoClassDefFoundError: org/json/JSONObject

cp $HADOOP_HOME/share/hadoop/tools/lib/json-20170516.jar $SQOOP_HOME/lib/

6、安装验证

[root@linux123 ~]# sqoop version

...

省略警告

...

20/06/19 10:37:24 INFO sqoop.Sqoop: Running Sqoop version: 1.4.7

Sqoop 1.4.7

git commit id 2328971411f57f0cb683dfb79d19d4d19d185dd8

Compiled by maugli on Thu Dec 21 15:59:58 STD 2017

# 测试Sqoop是否能够成功连接数据库

[root@linux123 ~]# sqoop list-databases --connect jdbc:mysql://linux123:3306/?useSSL=false --username hive --password 12345678

Warning: ...

省略警告

...

information_schema

hivemetadata

mysql

performance_schema

sys

第三部分 应用案例

在Sqoop中

- 导入是指:从关系型数据库向大数据集群(HDFS、HIVE、HBASE)传输数据;

使用import关键字; - 导出是指:从 大数据集群 向 关系型数据库 传输数据;

使用export关键字;

测试数据脚本

-- 用于在 Mysql 中生成测试数据

CREATE DATABASE sqoop;

use sqoop;

CREATE TABLE sqoop.goodtbl(

gname varchar(50),

serialNumber int,

price int,

stock_number int,

create_time date);

DROP FUNCTION IF EXISTS `rand_string`;

DROP PROCEDURE IF EXISTS `batchInsertTestData`;

-- 替换语句默认的执行符号,将;替换成 //

DELIMITER //

CREATE FUNCTION `rand_string` (n INT) RETURNS VARCHAR(255)

CHARSET 'utf8'

BEGIN

DECLARE char_str VARCHAR(200) DEFAULT '0123456789ABCDEFGHIJKLMNOPQRSTUVWXYZ';

DECLARE return_str VARCHAR(255) DEFAULT '';

DECLARE i INT DEFAULT 0;

WHILE i < n DO

SET return_str = CONCAT(return_str, SUBSTRING(char_str, FLOOR(1 + RAND()*36), 1));

SET i = i+1;

END WHILE;

RETURN return_str;

END

//

-- 第一个参数表示:序号从几开始;第二个参数表示:插入多少条记录

CREATE PROCEDURE `batchInsertTestData` (m INT, n INT)

BEGIN

DECLARE i INT DEFAULT 0;

WHILE i < n DO

INSERT INTO goodtbl (gname, serialNumber, price, stock_number, create_time)

VALUES (rand_string(6), i+m, ROUND(RAND()*100), FLOOR(RAND()*100), NOW());

SET i = i+1;

END WHILE;

END

//

DELIMITER ;

call batchInsertTestData(1, 100);

第 1 节 导入数据import

MySQL 到 HDFS

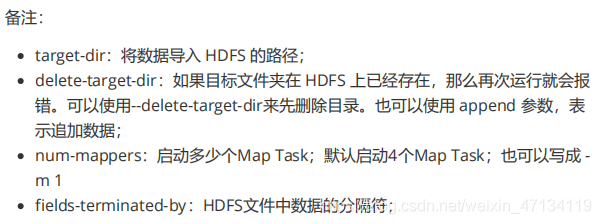

1、导入全部数据

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--table goodtbl \

--target-dir /root/lagou \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t"

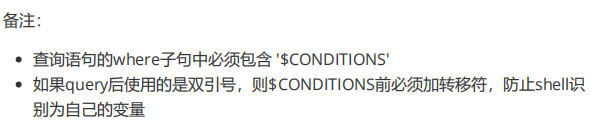

2、导入查询数据

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--target-dir /root/lagou \

--append \

-m 1 \

--fields-terminated-by "\t" \

--query 'select gname, serialNumber, price, stock_number,

create_time from goodtbl where price>88 and $CONDITIONS order by price;'

3、导入指定的列

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--target-dir /root/lagou \

--delete-target-dir \

--num-mappers 1 \

--fields-terminated-by "\t" \

--columns gname,serialNumber,price \

--table goodtbl

备注:columns中如果涉及到多列,用逗号分隔,不能添加空格

4、导入查询数据(使用关键字)

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--target-dir /root/lagou \

--delete-target-dir \

-m 1 \

--fields-terminated-by "\t" \

--table goodtbl \

--where "price>=68"

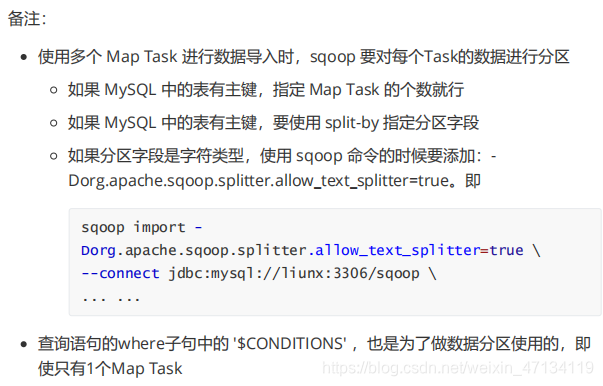

5、启动多个Map Task导入数据

在 goodtbl 中增加数据:call batchInsertTestData(1000000);

# 给 goodtbl 表增加主键

alter table goodtbl add primary key(serialNumber);

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--target-dir /root/lagou/sqoop/5 \

--append \

--fields-terminated-by "\t" \

--table goodtbl \

--split-by serialNumber

MySQL 到 Hive

在 hive 中创建表:

CREATE TABLE mydb.goodtbl(

gname string,

serialNumber int,

price int,

stock_number int,

create_time date);

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--table goodtbl \

--hive-import \

--fields-terminated-by "\t" \

--hive-overwrite \

--hive-table mydb.goodtbl \

-m 1

第 2 节 导出数据

- 进入大数据平台导入:import

- 离开大数据平台导出:export

备注:MySQL表需要提前创建

-- 提前创建表

CREATE TABLE sqoop.goodtbl2(

gname varchar(50),

serialNumber int,

price int,

stock_number int,

create_time date);

sqoop export \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive \

--password 12345678 \

--table goodtbl2 \

-m 4 \

--export-dir /user/hive/warehouse/mydb.db/goodtbl \

--input-fields-terminated-by "\t"

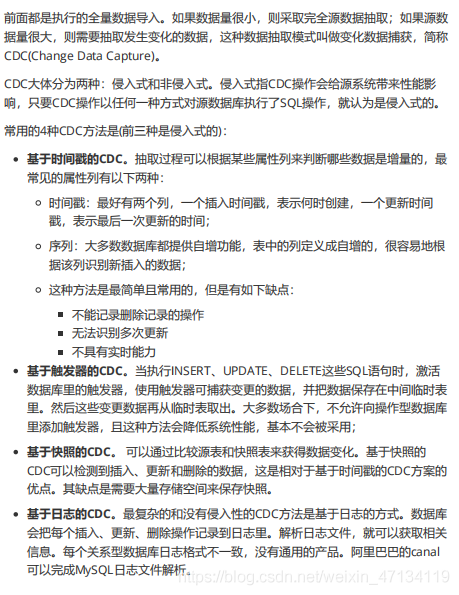

第 3 节 增量数据导入

增量导入数据分为两种方式:

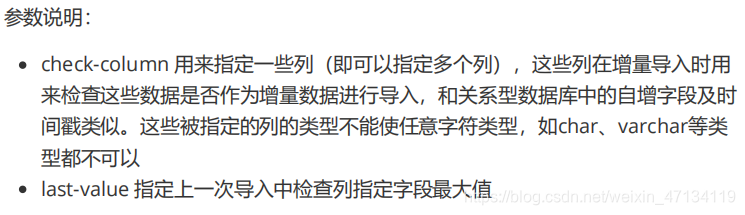

- 基于递增列的增量数据导入(Append方式)

- 基于时间列的数据增量导入(LastModified方式)

Append方式

1、准备初始数据

-- 删除 MySQL 表中的全部数据

truncate table sqoop.goodtbl;

-- 删除 Hive 表中的全部数据

truncate table mydb.goodtbl;

-- 向MySQL的表中插入100条数据

call batchInsertTestData(1, 100);

2、将数据导入Hive

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive --password 12345678 \

--table goodtbl \

--incremental append \

--hive-import \

--fields-terminated-by "\t" \

--hive-table mydb.goodtbl \

--check-column serialNumber \

--last-value 0 \

-m 1

3、检查hive表中是否有数据,有多少条数据

4、再向MySQL中加入1000条数据,编号从200开始

call batchInsertTestData(200, 1000);

5、再次执行增量导入,将数据从 MySQL 导入 Hive 中;此时要将 last-value 改为100

sqoop import \

--connect jdbc:mysql://linux123:3306/sqoop \

--username hive --password 12345678 \

--table goodtbl \

--incremental append \

--hive-import \

--fields-terminated-by "\t" \

--hive-table mydb.goodtbl \

--check-column serialNumber \

--last-value 100 \

-m 1

6、再检查hive表中是否有数据,有多少条数据

第 4 节 执行 job

执行数据增量导入有两种实现方式:.

- 每次手工配置last-value,手工调度

- 使用job,给定初始last-value,定时任务每天定时调度

很明显方式2更简便。

1、创建口令文件

echo -n "12345678" > sqoopPWD.pwd

hdfs dfs -mkdir -p /sqoop/pwd

hdfs dfs -put sqoopPWD.pwd /sqoop/pwd

hdfs dfs -chmod 400 /sqoop/pwd/sqoopPWD.pwd

# 可以在 sqoop 的 job 中增加:

--password-file /sqoop/pwd/sqoopPWD.pwd

2、创建 sqoop job

# 创建 sqoop job

sqoop job --create myjob1 -- import \

--connect jdbc:mysql://linux123:3306/sqoop?useSSL=false \

--username hive \

--password-file /sqoop/pwd/sqoopPWD.pwd \

--table goodtbl \

--incremental append \

--hive-import \

--hive-table mydb.goodtbl \

--check-column serialNumber \

--last-value 0 \

-m 1

# 查看已创建的job

sqoop job --list

# 查看job详细运行时参数

sqoop job --show myjob1

# 执行job

sqoop job --exec myjob1

# 删除job

sqoop job --delete myjob1

3、执行job

sqoop job -exec myjob1

4、查看数据

实现原理:

因为job执行完成后,会把当前check-column的最大值记录到meta中,下次再调起时把此值赋给last-value。

缺省情况下元数据保存在 ~/.sqoop/

其中,metastore.db.script 文件记录了对last-value的更新操作:

cat metastore.db.script |grep incremental.last.value

第四部分 常用命令及参数

第 1 节 常用命令

第 2 节 常用参数

所谓公用参数,就是大多数命令都支持的参数。

公用参数 – 数据库连接

公用参数 – import

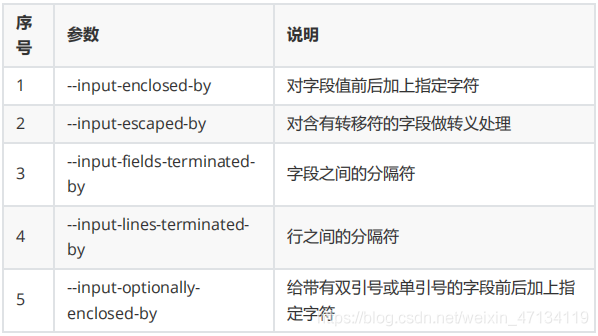

公用参数 – export

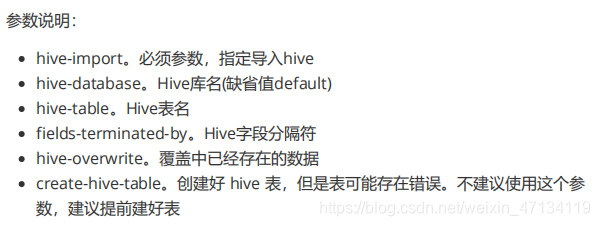

公用参数 – hive

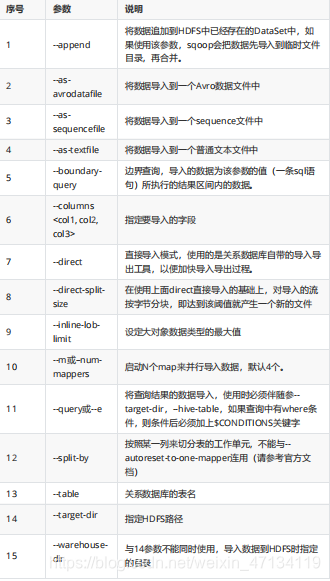

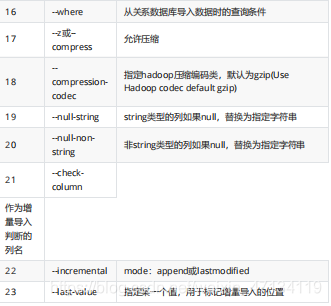

import参数

export参数